特征值和特征向量是线性代数中的基本概念,在各个领域具有深远的影响,尤其是在数据分析和机器学习方面。这些概念协助我们了解数据的底层结构,降低维度,并简化复杂的问题。特征值和特征向量在线性变换分析中占有突出地位。前缀 eigen- 取自德语单词 eigen(与英语单词 own 同源),表明“适当”、“特征”、“拥有”。

了解特征值和特征向量

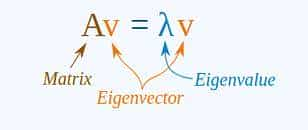

许多线性变换的核心是特征值和特征向量。给定一个 s量子矩阵 A,特征向量是一个非零向量 v,仅当对其应用线性变换 A 时,其比例才会发生变化。比例因子称为特征值 λ(lambda)。在数学上,这种关系表明为:

这里:

- A 是表明线性变换的矩阵。

- v 是特征向量。

- λ 是特征值。

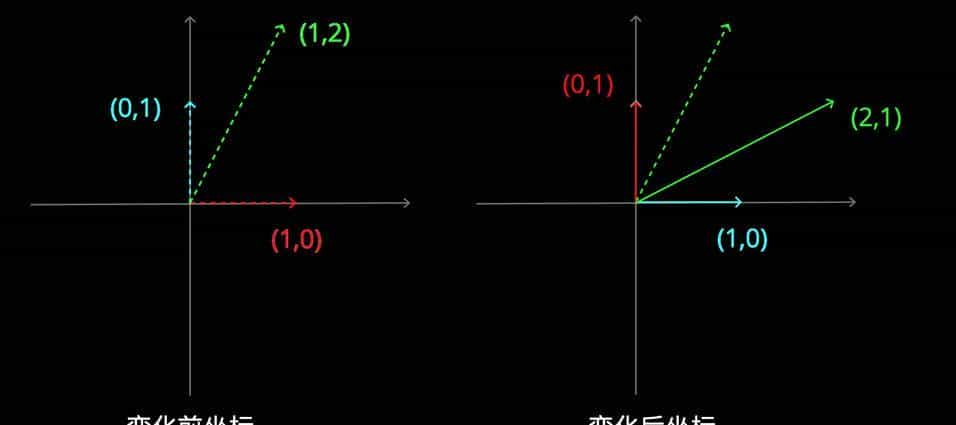

该方程意味着将矩阵 A 应用于特征向量 v 会得到一个向量,该向量是 v 的标量倍数。特征值 λ 告知在这个变换过程中特征向量被拉伸或收缩了多少。

特征值和特征向量在机器学习中的重大性

在机器学习和数据分析中,特征值和特征向量在主成分分析 (PCA) 等算法中起着关键作用。PCA 是一种降维技术,它将一大组变量转换为较小的变量,该变量仍包含原始数据聚焦的大部分信息。

PCA 如何使用特征值和特征向量?

PCA 的工作原理是查找数据协方差矩阵的特征向量(主成分)。这些特征向量对应于数据中方差最大化的方向。关联的特征值给出了沿每个特征向量的方差大小。

实际示例:计算特征值和特征向量

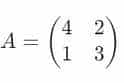

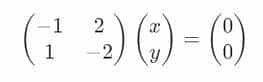

要计算特征值和特征向量,我们可以用一个简单的 2×2 矩阵作为例子。让我们思考一下矩阵:

注意:

请拿起你的笔,一步一步地计算以下内容:

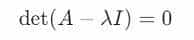

第 1 步:找到特征值

特征值 λ 通过求解特征方程找到:

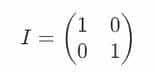

其中 I 是单位矩阵。对于我们的矩阵 A:

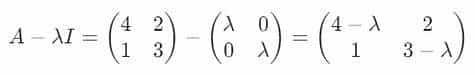

目前,我们计算 A−λI:

第 2 步:计算行列式

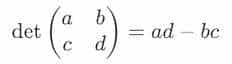

2×2 矩阵的行列式使用以下公式计算:

对于我们的矩阵 A−λI:

- a = 4−λ

- b = 2

- c = 1

- d = 3−λ

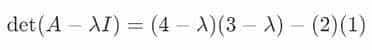

目前使用行列式的公式:

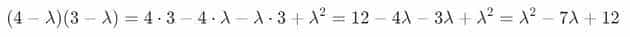

第 3 步:展开行列式

目前我们需要计算:

- 第一学期:

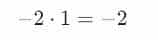

2. 第二学期:

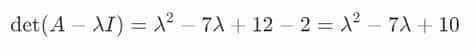

组合两个术语:

目前我们把这些结合起来:

第 4 步:求解特征多项式

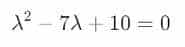

目前我们求解二次方程:

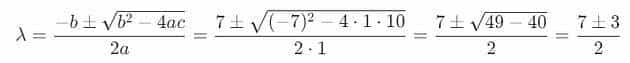

使用二次公式:

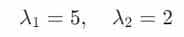

这为我们提供了:

第 5 步:找到特征向量

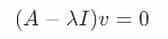

对于每个特征值,通过求解找到相应的特征向量:

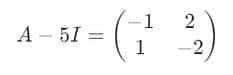

对于 λ1=5:

设置方程:

从第一行开始,我们有:

−x+2y = 0 ⇒ x = 2y

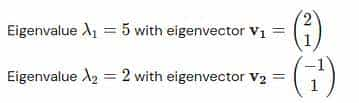

选择 y=1,我们得到 x=2。因此,对应于 λ1=5 的一个特征向量为:

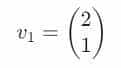

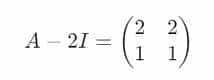

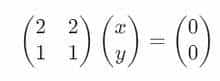

对于 λ2=2:

设置方程:

从第一行开始,我们有:

2x+2y=0⇒x=−y

选择 y=1,我们得到 x=−1。因此,对应于 λ2=2 的一个特征向量为:

总结

实际示例:使用 NumPy 计算特征值和特征向量

让我们来看看如何使用 Python 计算特征值和特征向量的示例。

import numpy as np

# Define a square matrix

A = np.array([[4, 2],

[1, 3]])

# Compute the eigenvalues and eigenvectors

eigenvalues, eigenvectors = np.linalg.eig(A)

print("Eigenvalues:", eigenvalues)

print("Eigenvectors:

", eigenvectors)输出:

Eigenvalues: [5. 2.]

Eigenvectors:

[[ 0.89442719 -0.70710678]

[ 0.4472136 0.70710678]]解释:

- NumPy 中的 np.linalg.eig 函数计算方阵的特征值和特征向量。

- 输出显示特征值及其相应的特征向量。每个特征向量都是变换矩阵 A 拉伸或收缩数据的方向,按特征值进行缩放。

结论

特征值和特征向量不仅仅是抽象的数学概念;它们是机器学习和数据分析的强劲工具。了解这些概念使我们能够掌握 PCA 等算法如何工作以降低数据的复杂性,同时保留其基本功能。

矩阵特征值与特征向量是线性代数中的核心概念,描述矩阵变换的关键特性。其本质是揭示矩阵在特定方向上的缩放效应。核心应用领域:1. 物理系统分析 在结构力学中,特征值对应系统的固有频率(如桥梁振动分析),特征向量描述振动模态;量子力学中,特征值代表粒子能量状态。2. 数据降维与模式识别 PCA(主成分分析)通过协方差矩阵的特征向量确定数据最大方差方向,实现高维数据可视化与去噪。3. 网络与图论 互联网PageRank算法利用链接矩阵的特征向量确定网页权重;社交网络分析中,特征值反映节点影响力。4. 控制与稳定性 系统矩阵的特征值实部符号决定动态系统稳定性(如火箭姿态控制),负实部特征值保证收敛。5. 机器学习与优化 协方差矩阵分解支撑线性判别分析(LDA);深度学习中的Hessian矩阵特征值揭示损失曲面几何特性,指导优化方向。技术延伸:谱聚类利用图拉普拉斯矩阵特征向量分割数据 马尔可夫链转移矩阵最大特征值对应稳态分布 图像压缩奇异值分解(SVD)本质是特征分解的扩展 特征分析通过提取矩阵本质特征,为复杂系统建模提供数学骨架,成为连接抽象代数与工程实践的桥梁。

收藏了,感谢分享