3D生成的下半场(二)

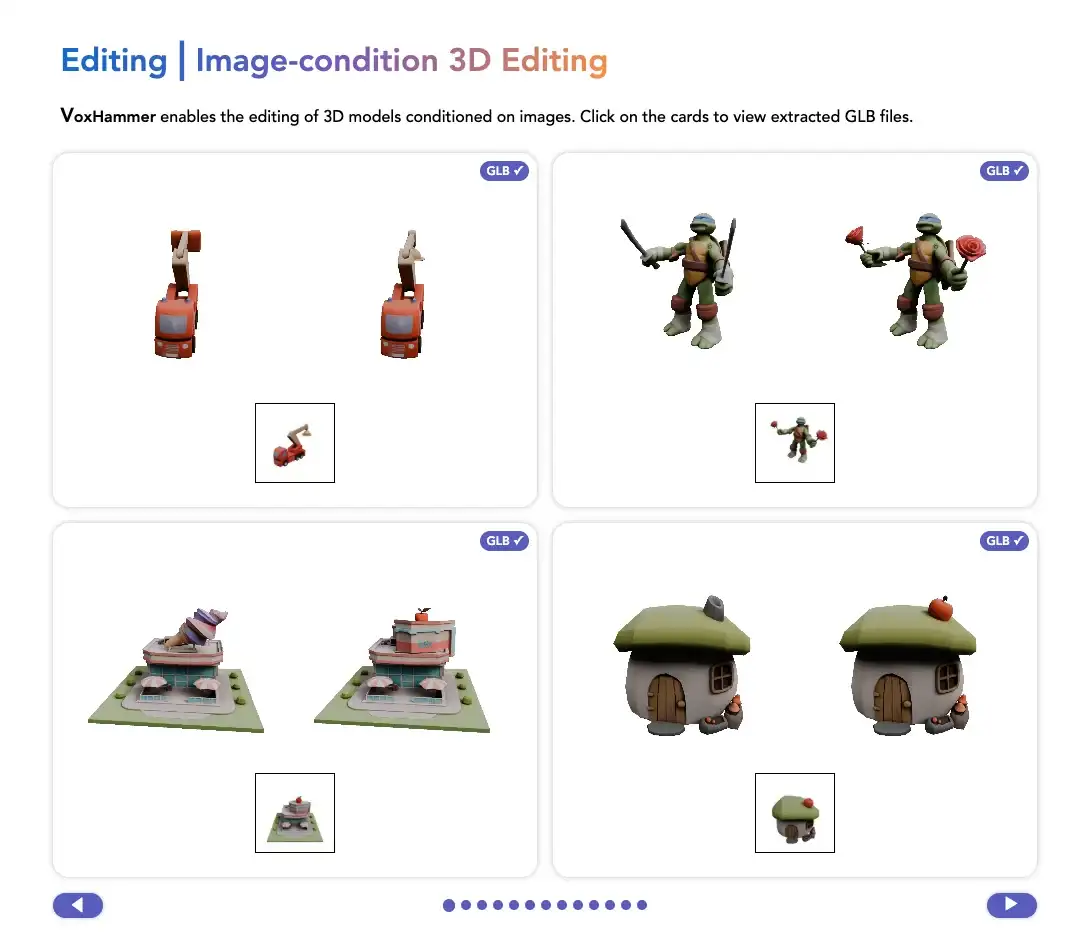

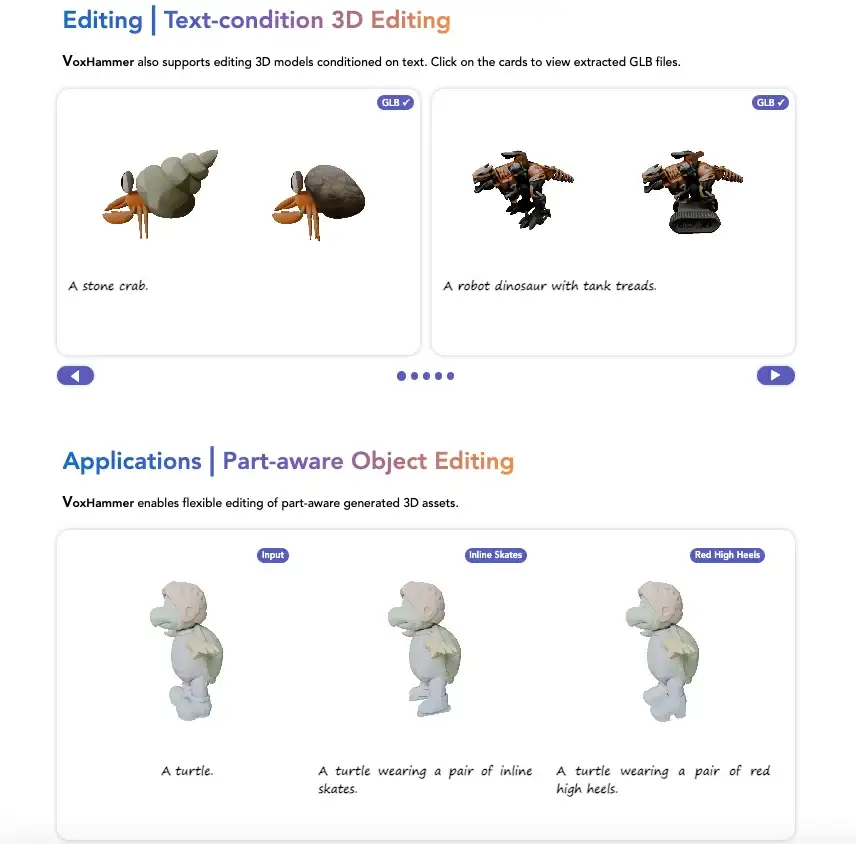

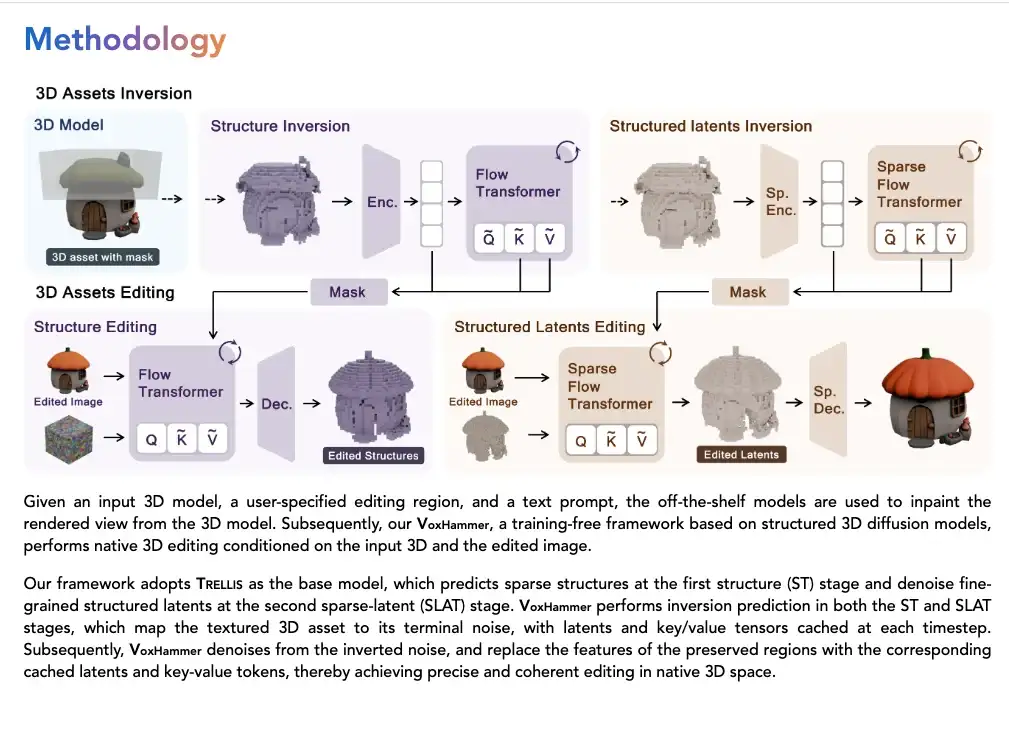

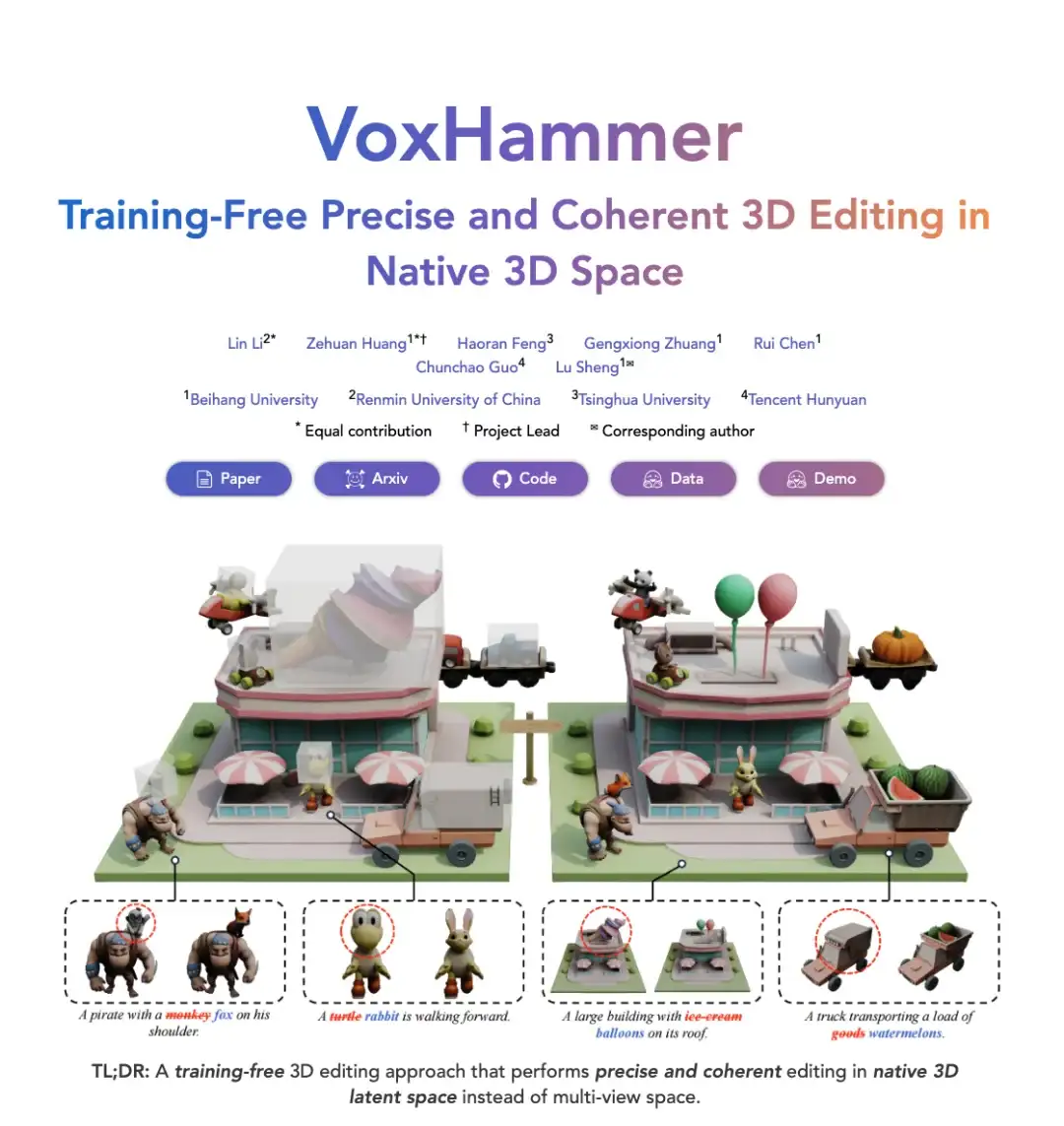

3D 生成基模不断壮大的现在,我们开始往可控生成方向上思考,并关注到,目前似乎还难以实现对 3D 资产的精细的局部编辑,便做了 VoxHammer 这个工作

3D 生成基模不断壮大的现在,我们开始往可控生成方向上思考,并关注到,目前似乎还难以实现对 3D 资产的精细的局部编辑,便做了 VoxHammer 这个工作

以往的 3D 编辑工作通常是通过编辑多视图再投影到 3D 空间,但是受限于多视图编辑的不一致性、和重建的偏差,导致很难做到精准编辑指定区域而保持其他区域不变

为啥我们不用先2d把图改好再生成,而是要升三维再做修改来增加难度呢?

© 版权声明

文章版权归作者所有,未经允许请勿转载。

上一篇

没有更多了...

下一篇

没有更多了...

相关文章

没有相关内容!

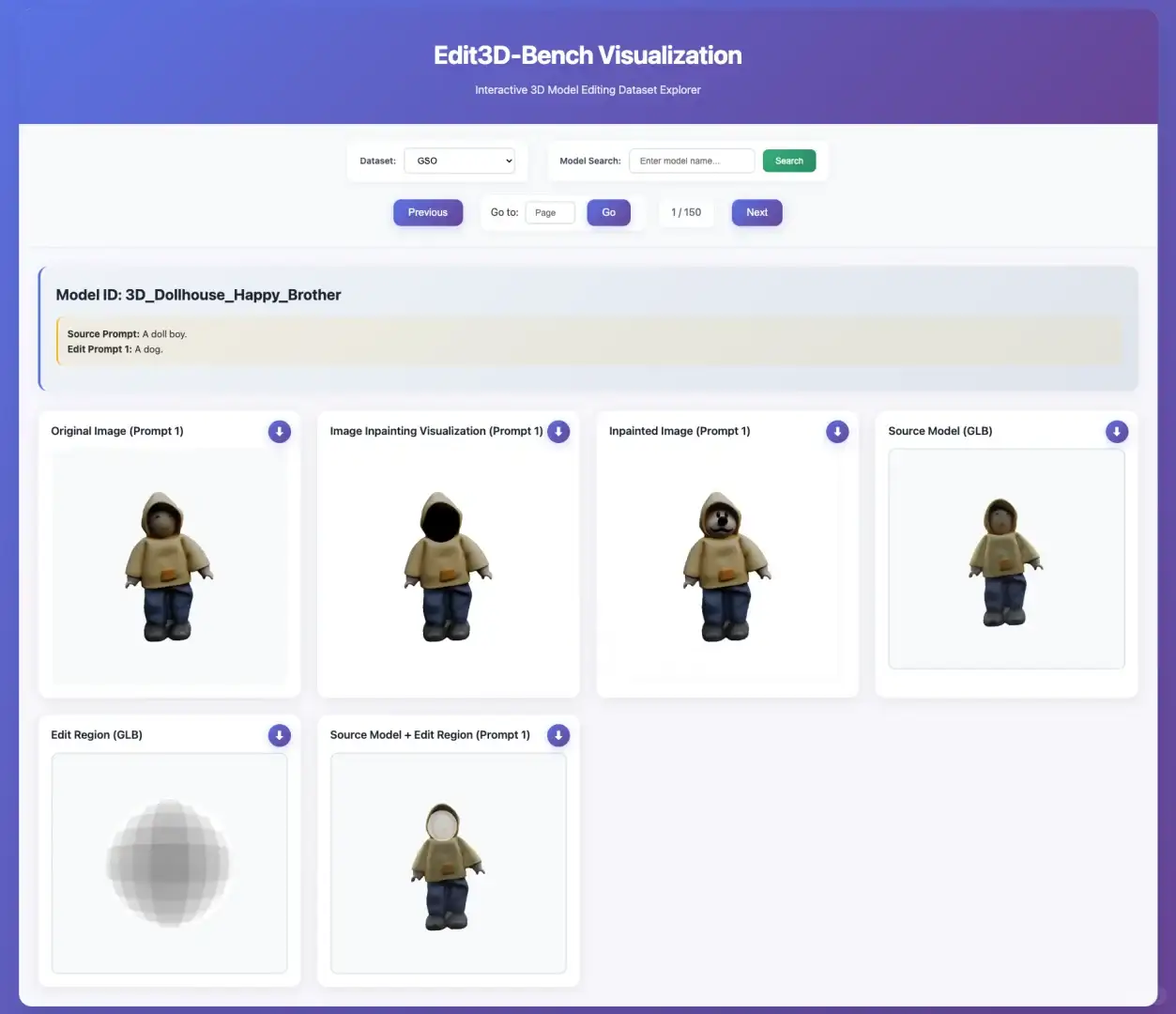

和trellis原论文的repaint很像,都需要用户提供一个3d的mask或者bbox来定位编辑区域,有没有可能仅给一张image就进行编辑呢,这样更方便一些

我理解是task不一样,我们做的是3d局部编辑,输入就是一个3d模型,列如说用户想给一个3d角色加个翅膀、戴个帽子、换双鞋子,且希望其他区域是不动的;和2d改图再生3d的应用不太一样

cvpr+1 [g=bizui]

牛的,看了你们组许多工作

没有没有 [g=huaixiao]

实则原生控制方法还可以参考下视频的编辑方法 列如vace这种

目前是的,我们在这个应用里是想体现part-aware天然就是一种3d mask;但似乎也可以扩展到真的分块,由于指定编辑的part之后,可以认为剩下的part区域是编辑part的表面外,这样是不是可以mc出独立的part呢🤔

我们也尝试过,但从2d编辑区域lift到3D的歧义性有点大,所以还是没没放弃3d标注,另外觉得这种局部编辑还是蛮适合做到blender插件之类的应用上

牛逼啊老哥

不敢呀

part-aware 3d object editing部分,我看图上不同3d区域用不同颜色标记,实际上所有part还是共同组合成一个水密的整体,跟partpacker那种分块不一样对吗

羡慕的发文速度

好牛

可以,学习一下