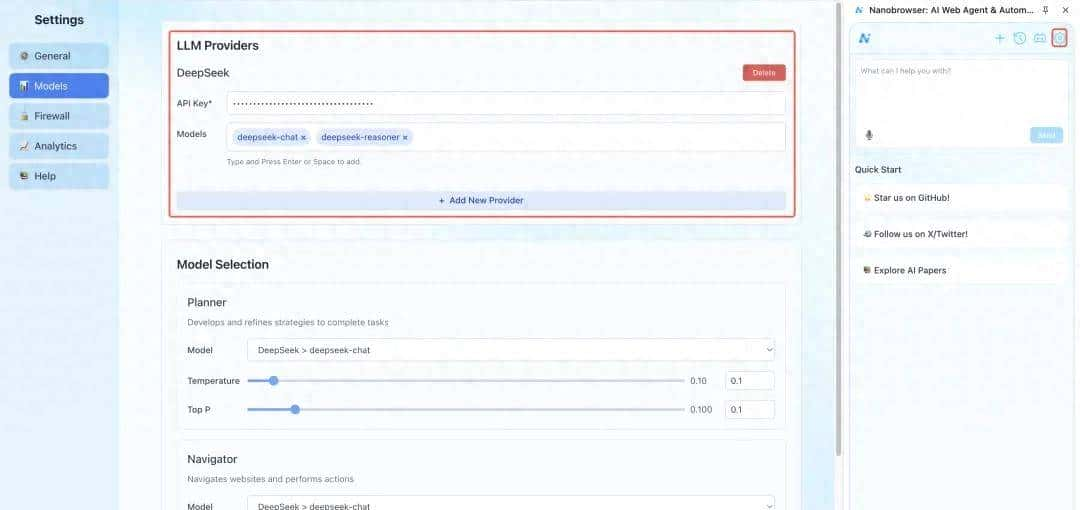

最近在做一个 AI 功能接入 Demo,核心需求不是“模型回答得多惊艳”,而是 API 调用是否稳定。毕竟对开发者来说,线上服务最怕偶发超时、返回格式不一致、同一问题答案波动太大。为了对比不同模型的接口体验,我先在 AI模型聚合平台 t.877ai.cn 做了基础验证,再单独针对 Gemini API 做了连续 100 次调用测试,重点看响应时间、错误率和输出一致性。

这次测试不追求实验室级严谨,更接近日常开发场景:一个普通后端服务,循环调用模型接口,记录每次耗时、状态码、返回内容和异常情况。测试问题固定,参数尽量一致,避免由于提示词变化影响结果。

一、测试环境和任务设计

测试机器是普通云服务器,网络环境稳定,没有额外代理链路。调用方式使用 Python 脚本,请求间隔控制在 1 秒左右,避免过于激进地压测。

提示词设置为一个典型开发场景问题:

“请用三点说明 Redis 缓存击穿的缘由,并给出对应解决方案,要求输出 JSON 格式。”

选择这个问题有两个缘由。

第一,它有明确答案,不容易由于开放式创作导致结果差异过大。

第二,它要求 JSON 输出,可以顺便观察格式遵从度。

每次调用记录四类信息:

- 请求开始时间和结束时间;

- 是否成功返回;

- 返回内容是否为合法 JSON;

- 三点内容是否保持一致。

二、响应时间:整体稳定,但尾部延迟要关注

连续 100 次调用中,大多数请求响应时间聚焦在一个比较稳定的区间。

从开发体验看,Gemini API 的平均响应速度可以接受,日常问答、摘要、轻量代码解释这类任务不会明显拖慢流程。多数请求能在预期时间内完成,适合作为后台智能能力接入。

但也能观察到一个现象:少数请求会出现明显更长的耗时,也就是常说的“尾部延迟”。

这对线上服务影响比较大。由于用户体感往往不是看平均值,而是看最慢的那几次。如果 100 次里有几次响应明显偏慢,前端就需要做好 loading、超时提示或异步处理。

我的提议是,接入 Gemini API 时不要只看平均响应时间,至少要关注 P90、P95 这类指标。平均 2 秒和偶尔 12 秒,是完全不同的产品体验。

三、错误率:低频异常存在,重试机制不能省

在这 100 次调用里,大部分请求都正常返回,没有出现连续失败的情况。整体错误率处在可接受范围内。

不过,低频异常依旧存在,列如请求超时、临时服务不可用、返回被中断等。对于开发测试来说,这可能只是偶发问题;但放到生产环境,就不能假设每次调用都成功。

所以重试机制是必须的。

比较稳妥的做法是:

第一次失败后等待短时间重试;

第二次失败后增加等待时间;

多次失败后降级返回默认结果或提示稍后再试。

也就是常见的指数退避策略。不要在失败后立刻高频重试,否则可能让服务更不稳定。

如果是用户强依赖场景,列如智能客服、代码生成、报告生成,还可以增加任务队列,把调用变成异步执行。这样即便单次请求慢一点,也不会直接阻塞主流程。

四、一致性:结构较稳,措辞会有轻微变化

这次我特别关注了输出一致性。

由于许多开发者接模型 API,不是为了聊天,而是为了让它返回稳定结构。例如 JSON、Markdown 表格、字段抽取结果。如果同一个提示词每次返回格式不同,后续解析会很麻烦。

测试结果看,Gemini 在明确要求 JSON 输出时,整体格式遵从度不错。大多数返回内容都能被正常解析,字段名也比较稳定。

不过,内容层面仍会有轻微差异。

列如同样是缓存击穿缘由,有时写“热点 key 失效”,有时写“高并发访问同一过期 key”;本质一样,但表达不同。如果后续系统要做严格匹配,就不能直接依赖自然语言字段。

实战中更推荐在提示词里固定 schema,例如:

json

{ "reason": "", "impact": "", "solution": ""}同时要求“只返回 JSON,不要添加解释”。这样可以显著减少解析成本。

五、稳定性不是只看模型,也看调用设计

许多人评价 API 稳不稳定,只看模型服务本身。但从工程角度看,稳定性还包括调用方设计。

列如:

- 是否设置合理超时时间;

- 是否处理异常状态码;

- 是否校验返回格式;

- 是否有日志追踪;

- 是否有降级方案;

- 是否限制并发和请求频率。

如果这些都没有,即便模型 API 本身表现不错,线上也容易出问题。

我这次测试的一个感受是:Gemini API 适合接入真实业务,但不能裸用。它更像一个能力组件,需要外层工程架构来兜底。

六、和日常使用体验的差异

在网页端使用模型时,偶尔慢一点问题不大,用户可以等待。但 API 接入后,要求会明显提高。

列如一个后台批处理任务,可以接受 10 秒返回;但一个在线问答入口,最好控制在几秒内给反馈。一个内部工具可以人工复制结果,但线上系统必须保证返回格式可解析。

所以 API 稳定性测试必定要结合业务场景。

如果你只是做个人工具,100 次调用成功率和响应速度基本够用。

如果要接入企业内部系统,就需要做更长时间测试,列如连续 1000 次、不同时间段、不同并发量。

如果是面向用户的服务,还要增加监控和告警。

七、趋势分析:模型 API 会越来越工程化

过去大家更关注模型能力本身,列如会不会写代码、会不会总结长文档。目前越来越多开发者开始关注 API 层面的稳定性。

这是一个明显趋势。

由于大模型正在从“体验工具”进入“业务系统”。一旦进入系统,就必须思考延迟、错误率、一致性、成本和可维护性。

未来模型厂商之间的竞争,不只是回答质量,还包括接口稳定、流式输出、结构化返回、工具调用、并发能力和监控支持。

对开发者来说,也不能只会写 prompt,还要懂工程化接入。

总结

这次连续 100 次 Gemini API 调用测试下来,我的结论是:整体稳定性可用,响应时间大多数情况下比较平稳,错误率不高,结构化输出表现也不错。

但它并不是“接上就万事大吉”。尾部延迟、偶发异常、内容轻微波动都需要在工程层面处理。

如果要在项目中使用 Gemini API,我提议至少做好三件事:设置超时和重试、校验返回格式、保留完整调用日志。

模型能力决定上限,工程设计决定下限。真正能上线的 AI 应用,靠的不是单次回答惊艳,而是每一次调用都尽量可控。

相关文章