手机一响,许多人的第一反应都是立刻接起来,顺口来一句喂,你好,哪位。这个动作太自然了,自然到几乎没人会多想。

可放在今天,这个习惯,真的该改了。

由于你先开口的那几秒,可能已经给了骗子一份可利用的声音样本。钱不会在你接通电话的瞬间消失,但你的声音,可能会在你毫无察觉的时候,被拿去拼成下一场骗局里最关键的一块。

这不是危言耸听。

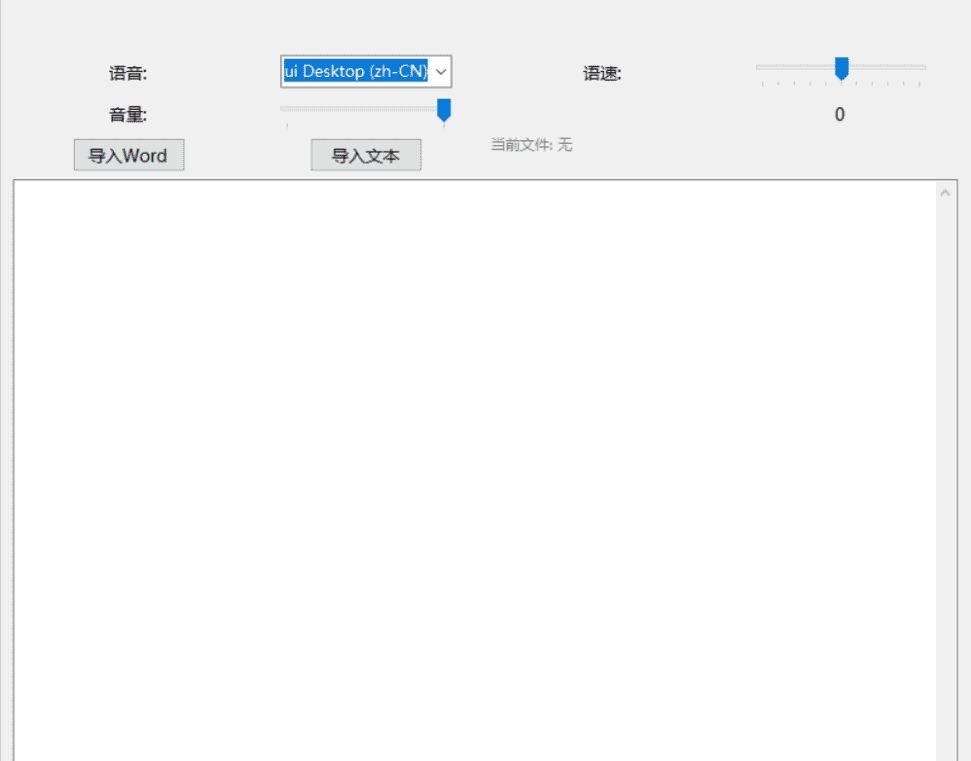

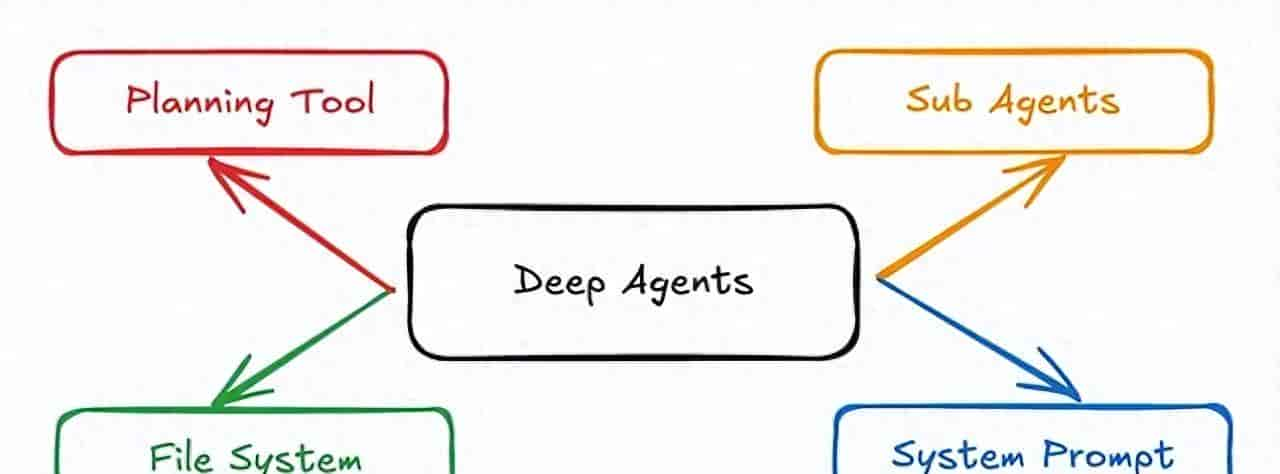

这几年,AI语音合成技术发展得超级快。过去还需要专业设备、复杂操作,普通人很难接触。目前情况已经完全不同了,相关工具越来越容易获得,使用门槛越来越低,生成速度也越来越快。

有些软件,只需要很短的一段录音,就能做出类似度很高的声音样本。对普通人来说,听到熟悉的口音、语气、节奏,本能反应往往就是信任。也正由于这样,AI语音诈骗最可怕的地方,从来都不只是技术本身,而是它专门冲着人的信任去下手。

骗子盯上的,从来不是你的几句话,而是你背后的关系链。

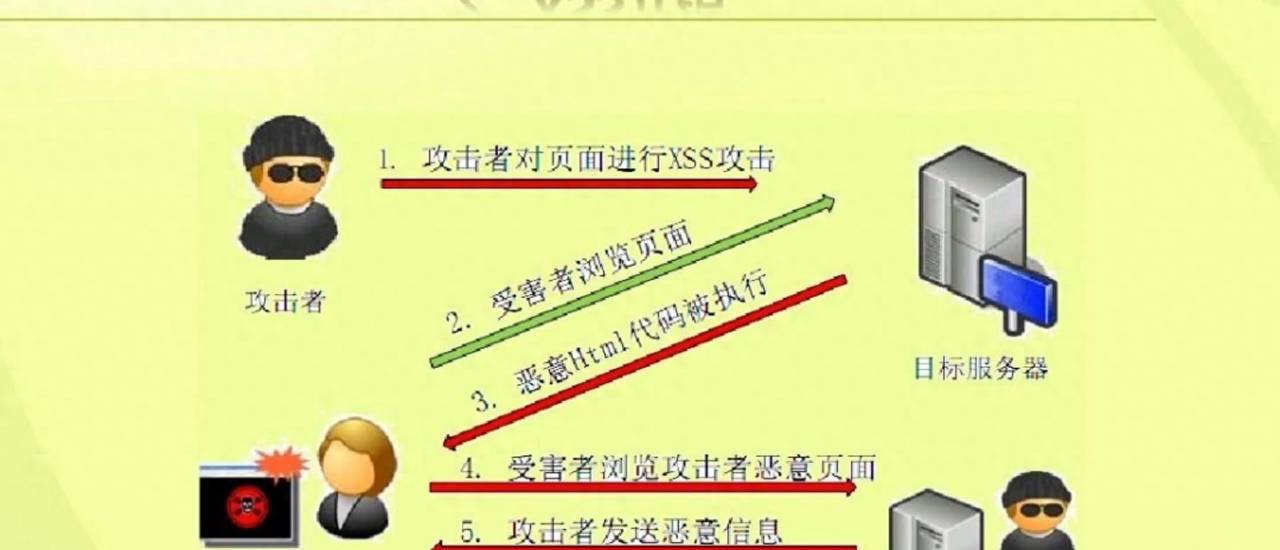

许多人一听说声音会被采集,第一反应都是,我又没说银行卡密码,也没报身份证号,一句你好能有什么用。问题就在这里。目前的诈骗,早就不靠你当场说漏什么秘密信息了。

骗子真正需要的,是一段你的声音。然后再把这段声音,和你公开泄露出去的手机号、社交账号、家庭关系、工作身份拼起来,事情就变得很像真的了。

你朋友圈里的一张合照,短视频里的一段发言,购物收货信息里暴露出的姓名电话,甚至单位公开页面上的职务介绍,都可能成为骗子拼图的一部分。当声音、身份、关系、场景被同时拼接出来时,骗局就会突然变得很真实。

这也是为什么,许多受害者事后都会说一句同样的话,声音听起来太像了,根本没想到会是假的。

真正危险的,不是陌生人来骗你。

更危险的是,骗子会用你最熟悉的人来骗你。

他们会用合成的声音打给你的父母,说自己出了车祸,急需赔钱。会打给你的爱人,说手机坏了,目前借用别人的号码,让立刻转一笔钱。也会打给公司的财务,说情况紧急,马上往某个账户打款。

这类话术并不新鲜,过去也有。可过去更多靠模仿,靠编故事,靠抓人慌乱时的心理漏洞。目前加上AI拟声,整个骗局的可信度一下就被抬高了。

以前大家还能靠一句声音不像来起疑。目前这层防线,正在被快速冲垮。

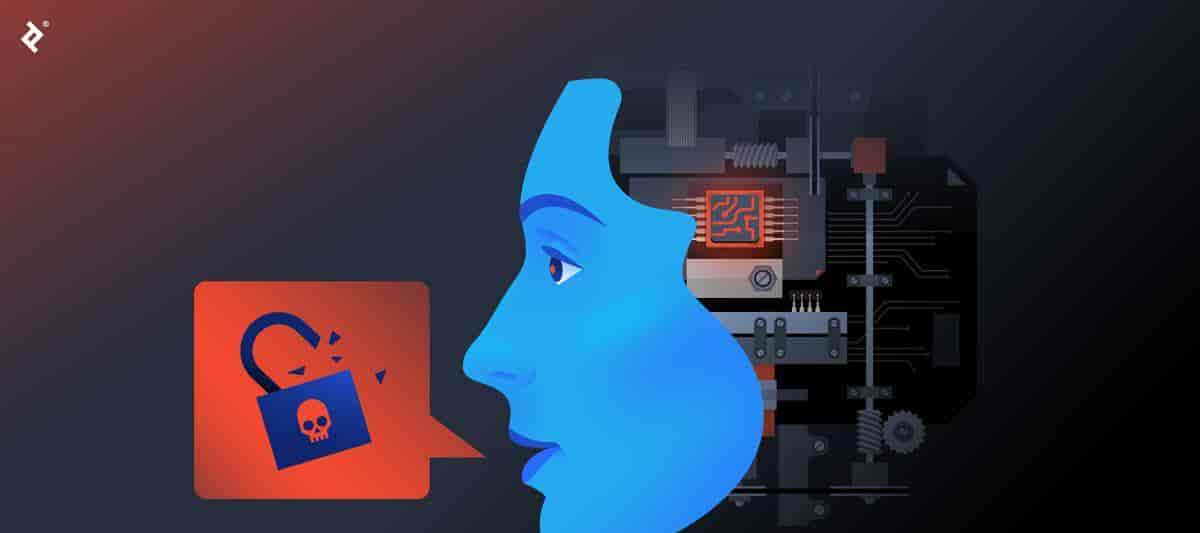

声音,已经成了新的个人信息。

这件事,许多人还没有真正意识到。

过去大家反复强调要保护好验证码、银行卡号、身份证号、支付密码,这当然依旧重大。但在AI时代,声音也该被放进同样重大的位置。由于声音里不仅有说话习惯,还有声纹特征,还有足以让熟人信任的个人识别感。

一句很普通的话,在技术处理后,可能就成了诈骗脚本里最有杀伤力的开场。

许多中年人最容易低估这一点。总觉得自己平时谨慎,不乱点链接,不轻信陌生短信,也不贪小便宜,怎么会轮到自己。可AI语音诈骗恰恰绕开了这些传统防骗经验。

它不必定让你点链接。

它不必定让你扫二维码。

它甚至不必定先骗你。

它可能先骗你的父母,骗你的配偶,骗你的同事,骗那个最容易由于你的声音而放下戒心的人。

所以,这已经不是一个人小心一点就够了的问题。

这是整个家庭、整个工作链条都要一起更新防骗习惯的问题。

家里老人一旦接到孩子的求助电话,往往先慌,后想。尤其一听到熟悉声音,情绪会立刻被带走。许多父母不是不谨慎,而是太信任自己孩子的声音,也太怕孩子真出事。

公司里也一样。员工一旦接到领导打来的电话,听到熟悉语气,又碰上紧急转账、临时付款、项目保证金这类场景,压力感会很快压过判断力。

AI诈骗最阴险的地方,就是它特别擅长制造一种来不及多想的气氛。

它要的,就是你别核实。

它要的,就是你先照办。

它要的,就是你在最短时间里,把最重大的钱转出去。

越着急,越容易中招。

这一点,放在今天比任何时候都更成立。

由于AI拟声不会自己骗钱,真正把钱送出去的,还是人。骗子要做的,就是先把你推到一个情绪高点。只要你一慌,许多平时能发现的问题,当下都会被忽略。

列如号码不对。

列如措辞有点怪。

列如要求转账的账户很陌生。

列如整件事看着就不符合常理。

可一旦前面那道熟悉声音建立起来了,许多本该敲响警钟的细节,就会被慌乱自动盖过去。

所以说到底,AI诈骗是技术在前面开路,情绪在后面推人,最后让信任替骗局完成临门一脚。

这件事最值得警惕的地方,还在于成本越来越低。

如果一项诈骗手段操作复杂、成本高、成功率低,它扩散速度一般有限。可AI语音诈骗恰恰相反。

技术越来越便宜,工具越来越多,教程越来越容易找到,处理时间越来越短。过去需要很高门槛才能做的事,如今普通不法分子也可能摸到边。

这就意味着,未来类似骗局不会少,只会更多。它未必每次都做得天衣无缝,但只要样本足够大,只要总有人在慌乱中上当,骗子就有动力继续干。

许多人总喜爱把诈骗看成个别人倒霉。可放在今天,更应该把它看成一场现实中的技术赛跑。一边是工具越来越快地升级,一边是普通人的防范意识还停留在旧经验里。

旧经验当然还有用,但已经不够用了。

以前的防骗口诀,大多围绕不要点、不轻信、不透露。目前还得多加一条,不要在陌生电话里先暴露自己的声音状态。

这不是让人对所有电话都草木皆兵,也不是提倡谁都别接。现实里工作联系、快递配送、生活服务,电话总归还得接。

真正该改的,是接法。

陌生号码打进来,先别急着连珠炮似地开口。可以先沉默一秒,等对方先说身份和来意。对方如果支支吾吾,或者一上来就催促、套话、引导你反复发声,那就要立刻提高警惕。

有些骚扰电话看上去只是在做问卷,有些电话假装快递、客服、售后、回访,有些甚至会故意让你重复数字、姓名、确认词。这些动作看起来不起眼,放在AI时代,风险含义已经完全变了。

你多说一句,可能就多给了骗子一块可拼接的材料。

更重大的是,涉及钱的事,今后只认核实,不认声音。

这句话,最好记牢。

无论电话那头声音多像,无论语气多急,无论说的是孩子、爱人、领导还是客户,只要提到借钱、转账、垫付、保证金、手续费、保密操作、验证码、共享屏幕,统一按高风险处理。

最稳妥的办法,就是立刻结束当前通话,然后用你自己保存的号码回拨过去。注意,是你自己通讯录里原来就有的号码,不是对方临时发给你的号码。

如果不放心,还可以要求视频确认,或者通过家庭群、单位群、当面联系等其他方式交叉验证。

这个动作看似麻烦,实际上是在替自己争取冷静时间。许多骗局最怕的,就是你脱离它设定的节奏。一旦你不再跟着它走,破绽往往很快就会出来。

电话里越催你马上办,你越要慢下来。

这是今天特别实用的一条防骗原则。

由于正常人遇到真急事,虽然也会着急,但一般不会阻止你核实。反倒是骗子,最怕你多打一个电话,多问一个人,多停一分钟。

所以凡是强调目前就转、马上办、不能告知别人、来不及解释的情况,都要自动亮红灯。

尤其对中年人来说,这条原则更重大。由于你既可能是家庭里管钱的人,也是单位里处理事务的人,许多关键决策都压在你身上。你的一个判断,背后连着一家人的积蓄,也连着一群人的责任。

在这种情况下,谨慎不是多疑,慢一点也不是拖延,而是对家人和工作真正负责。

家庭内部,也该提前做一点准备。

许多骗局能成功,就是由于平时没有形成约定。孩子和父母之间没有固定的核实方式,夫妻之间没有转账前复核的习惯,单位里没有电话指令二次确认的流程。

这些东西,平时觉得没必要,真出事时却最有用。

列如家里可以提前约定一个只有至亲知道的核实方式,遇到紧急借钱必须说清某个细节。列如父母接到所谓孩子出事的电话,不先转钱,先联系另一个家人。列如公司财务遇到领导电话指令,必须通过内部系统或面对面确认后再执行。

许多损失,靠的不是事后追回,而是事前拦住。

真正成熟的防骗,从来都不是谁更机智,而是谁先把习惯改过来。

也有人会问,既然连声音都能造假,那后来是不是连视频也不能信了。答案是,的确 要比过去更谨慎。由于今天的AI技术,已经不只停留在拟声层面,换脸、对口型、伪造场景也在同步发展。

这就意味着,单靠耳朵听、单靠眼睛看,都不再绝对可靠。

可也不用因此陷入恐慌。由于再像的技术,都有一个弱点,它需要你配合它演下去。你只要跳出当下那通电话,改用自己掌控的渠道重新核实,骗局的威力就会大幅下降。

说到底,技术越逼真,人越要掌握主动权。

陌生电话也好,熟人求助也好,所谓紧急通知也好,别让对方决定你的节奏,别让声音取代你的判断,别让情绪抢走你的理智。

这才是面对AI语音诈骗最关键的一层防线。

接陌生电话别先出声,表面看只是一个小动作,背后实则是一种新的安全习惯。

它提醒我们,通信时代的风险边界已经变了。以前我们担心说漏的是密码,目前连声音本身都得当成隐私去保护。以前我们更信任耳听为实,如今这条经验也得打个问号。

今天还能保护你的,已经不只是警惕心本身,而是警惕心加上新习惯。

沉默一秒,让对方先说。

涉及钱款,必须换渠道核实。

只认主动回拨,不认来电催促。

只要情绪被拉高,就先停下来。

这几条,看起来简单,关键时候真能挡掉大麻烦。

别小看那句顺口而出的喂。以前它只是礼貌,今天它可能是一把被别人利用的钥匙。

守住自己的声音,许多骗局连第一步都迈不过来。守住这一步,也是在守住家人的安全感,守住账户里的积蓄,守住本来不该被轻易撬动的信任。

参考资料

新华视点丨你的声音被谁偷走了?——AI声音滥用现象调查|发布平台:新华网|作者/机构:新华社新华视点|发布时间:2025年2月12日

以假乱真的AI诈骗,如何防范?|发布平台:新华网|作者/机构:人民日报|发布时间:2025年4月8日

关于印发《人工智能生成合成内容标识办法》的通知|发布平台:中央网信办官网|作者/机构:国家互联网信息办公室|发布时间:2025年3月14日

人民法院依法惩治电信网络诈骗等侵犯财产犯罪典型案例|发布平台:最高人民法院官网|作者/机构:最高人民法院|发布时间:2026年2月26日

Scammers use AI to enhance their family emergency schemes|发布平台:FTC Consumer Advice|作者/机构:Alvaro Puig|发布时间:2023年3月20日

Fighting back against harmful voice cloning|发布平台:FTC Consumer Advice|作者/机构:Alvaro Puig|发布时间:2024年4月8日

Senior US Officials Impersonated in Malicious Messaging Campaign|发布平台:IC3官网|作者/机构:FBI Internet Crime Complaint Center|发布时间:2025年5月15日

AI Voice Cloning: Do These 6 Companies Do Enough to Prevent Misuse?|发布平台:Consumer Reports Innovation|作者/机构:Consumer Reports|发布时间:2025年1月30日

相关文章