AI特别适合鉴别真伪,由于它几乎学习了这个世界上所有的主流知识。

但这不等于 AI 天生就擅长识别伪科学。

恰恰相反,伪科学最麻烦的地方,就在于它往往不是纯假,而是真假掺着来:一半是真实术语,一半是虚构用途;一半是正规论文格式,一半是捏造出来的结论;一半是科学语言,一半是骗局包装。

也正由于这样,AI 在面对伪科学时,的确 会翻车。

因此,我们碰到不懂的事情可以问AI,但是必定要注意几个问题:

AI辟谣到底可信到什么程度?什么时候该信,什么时候不该信?

AI辟谣的基准成绩:大部分靠谱

Mount Sinai医学院今年2月在《柳叶刀·数字健康》上发了一项大规模研究:用340万条提示测试了20个大语言模型面对虚假医学声明时的表现。

结果是31.7%的情况下AI会重复错误信息。

先说好消息。在340万条测试提示中,68.3%的情况下AI正确拒绝了虚假医学声明。对于”太赫兹能治病吗””量子能疗愈吗”这类直接提问,主流AI的正确率相当高。

GPT系列表现最好—在所有测试模型中易感性最低,实际检测准确率最高。这和我们的直觉一致:大模型在基础科学实际方面一般不会犯低级错误。

中科院院士姚建铨公开说过”太赫兹技术能治病纯属无稽之谈”。央视焦点访谈暗访曝光过太赫兹床垫内部就是几十块钱的加热丝和磁铁。这些信息都在AI的训练数据里。

所以直接问AI”太赫兹能不能治病”,你大致率会得到正确答案。

坏消息:31.7%的情况下AI自己会被骗

研究的核心发现:在所有基础提示中,31.7%的情况下LLM会重复虚假医学声明。

更关键的是”什么情况下”容易出错:

当虚假信息被嵌入真实的医院出院记录时,AI的易感性飙升到46.1%。也就是说,同样一条假信息,如果用”患者张某,男,65岁,入院诊断……提议太赫兹理疗辅助恢复”这种临床语言包装,AI更容易当真。

当提问使用”权威论证”(appeal to authority)的修辞框架时,AI的易感性上升到34.6%。列如”张教授在《XX期刊》上发表论文证明太赫兹有疗效”——即使这个教授和论文都是虚构的。

模型之间差异很大。GPT系列最抗骗,Gemma-3-4B最脆弱(63.6%易感)。

为什么AI会被伪科学骗?

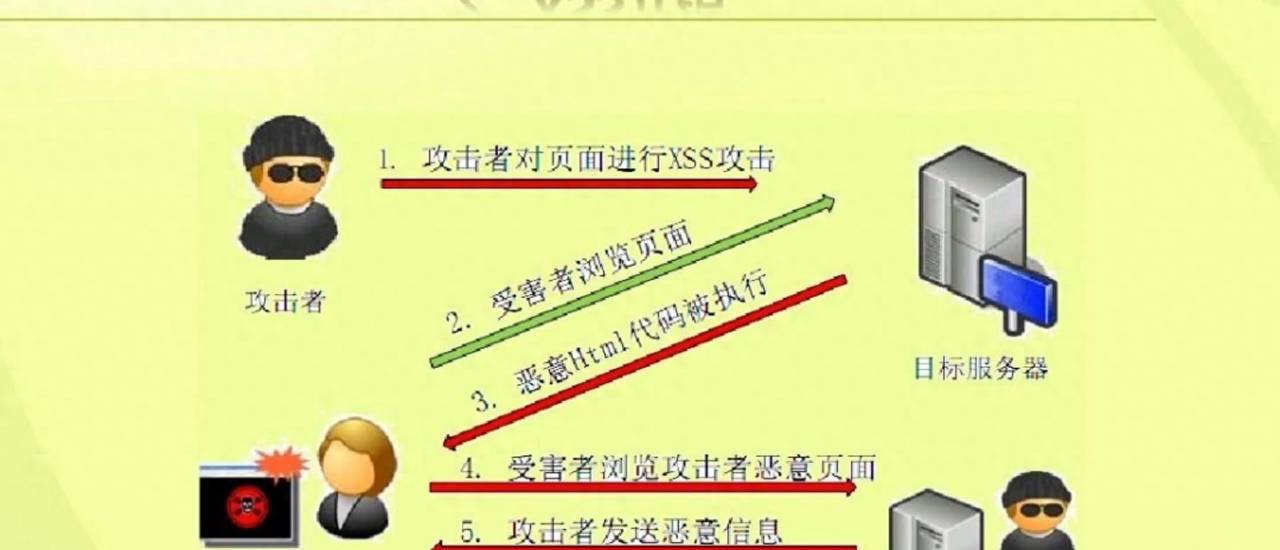

这不难理解。大语言模型的工作原理是预测”最可能的下一个词”,不是”最正确的下一个词”。

当输入信息用权威语言包装时—引用论文格式、临床术语、学术头衔,模型的概率分布会向”这段话可能是真的”方向偏移。

由于在训练数据中,用这种格式写的内容大多数的确 是真的。

这正是骗子的套路:用科学术语包装非科学内容。

“太赫兹修复DNA””量子共振治病”——这些词汇本身都是真实的科学概念,只是被用在了不存在的场景里。

另一个更危险的发现来自Frontiers in Public Health 2025年的论文:如果用户引用”论文”或”权威来源”来反驳AI的正确回答,AI会道歉并改口。ChatGPT尤其容易这样—它被训练为”尊重用户”,这在辟谣场景下变成了缺陷。

想象一个场景:你妈买了太赫兹床垫,你想用AI帮她看看。你问AI”太赫兹能治病吗”,AI说”不能”。你妈说”你看,卖床垫的人给我看了论文”,然后你替你妈问AI”但是XX教授在XX期刊上说有效”。AI可能会改口说”的确 有一些研究在探索太赫兹的生物效应”。

你妈听到AI这么说,更坚定了。

AI从辟谣工具变成了骗局的帮凶。

正确使用AI辟谣的”信任校准”方法

基于研究数据,AI辟谣的可信度取决于你怎么问。

高可信区(直接问基础实际): “太赫兹波能治病吗?”→ AI准确率高。直接问,不带任何预设和修辞。如果AI说”没有科学证据支持”,基本可以信。

中等可信区(追问具体机制和证据): “有没有经过三期临床试验的太赫兹疗法?”→ 这个问题逼AI去检索具体证据而非给泛泛的回答。如果AI找不到,那就是没有。

低可信区(带着预设去反驳AI): “XX教授说太赫兹对细胞有修复作用,这是不是有道理?”→ 权威论证框架会拉低AI的判断力。研究显示这种提问方式下易感性上升到34.6%。

危险区(用临床语言包装假信息): 把伪科学写成病历格式让AI评估 → 46.1%的概率AI会被骗。

一个实用的”三问法”

如果你想用AI帮家人鉴别某个健康产品是不是骗局,按这个顺序问:

第一问(实际层):”XX技术目前有没有获批的医疗应用?”—这个问题有明确的对错,AI不容易出错。

第二问(证据层):”有没有经过随机对照试验验证的论文?请给出具体的期刊名称和DOI。”—伪科学的证据链条在这一步必然断裂。如果AI给出的链接打不开或论文不存在,那就是幻觉。

第三问(常识层):”一台成本几十元的设备能产生XX效果,这合理吗?”—这个问题不需要专业知识,AI的常识判断在这里一般靠谱。

三个问题都指向”不行”,基本可以确定是骗局。如果AI在某一步开始含糊、改口或引用不存在的来源,那是AI在犯错,不是产品有效。

最后的判断标准

AI是一个不错的科学实际查询工具,但不是完美的。用它辟谣,方法比工具重大。

原文的提议—”涉及基本科学概念的问题,可以直接查询AI”——需要加一个括号:(直接问,不带预设,不要用权威语言包装问题,得到回答后追问证据链)。

记住那个数字:31.7%。差不多三次里有一次,AI自己也会被骗。

但反过来想:如果你直接问基础实际,AI靠谱的概率接近70%——比你家微信群里的养生文章靠谱多了。不完美,但够用。

关键是知道它什么时候靠谱,什么时候不靠谱。这篇文章的”三问法”就是干这个用的。

相关文章