存算分离:大数据世界的“储物间与工作台”革命

关键词:存算分离、大数据架构、分布式存储、弹性计算、成本优化、实时处理、云原生

摘要: 当我们把“放衣服的衣柜”和“写作业的书桌”分开时,房间会更整洁、效率更高——这就是“存算分离”的核心逻辑。在大数据时代,传统“存算一体”的“老式电脑”已经装不下爆炸的数据量和波动的计算需求,而“存算分离”就像给大数据系统做了一次“空间重构”:把数据“存”在专门的“储物间”(分布式存储),把计算“算”在灵活的“工作台”(弹性计算引擎),让两者各自发挥优势。本文将用“超市存包柜”“学校图书馆”这样的生活场景,一步步拆解存算分离的原理,结合电商、金融的真实案例,告诉你它如何解决大数据的“痛点”,以及未来会走向何方。

一、背景介绍:为什么大数据需要“存算分家”?

1.1 目的和范围

我们写这篇文章的目的,是帮你搞懂“存算分离”到底是什么,为什么它能成为大数据领域的“救命稻草”,以及实际工作中怎么用它解决问题。范围覆盖存算分离的核心概念、架构设计、实战案例,还有未来趋势——不管你是刚接触大数据的“新手”,还是想优化系统的“老司机”,都能找到有用的内容。

1.2 预期读者

大数据初学者:想理解“存算分离”的基础逻辑;数据工程师:想知道如何用存算分离优化系统性能;技术管理者:想评估存算分离对成本和效率的影响;对“云原生”“弹性计算”感兴趣的人:存算分离是这些领域的核心组件。

1.3 文档结构概述

本文就像一本“大数据装修指南”:

第一步:用“超市存包”的故事引出“存算分离”的概念(第2章);第二步:用“图书馆与教室”的类比,拆解存算分离的核心组件(第3章);第三步:用“快递站与快递员”的关系,讲清楚组件之间的配合(第4章);第四步:用“电商用户行为分析”的实战案例,教你怎么搭建存算分离系统(第5章);第五步:用“双11大促”“金融风险监控”的真实场景,看存算分离的价值(第6章);最后:展望未来,聊存算分离的“进化方向”(第7章)。

1.4 术语表

为了不让“专业名词”变成“拦路虎”,先给大家画个“术语地图”:

存算一体:传统计算机的架构,把“存储”(硬盘)和“计算”(CPU/内存)绑在一台机器里,就像“把衣柜和书桌做在一起的组合家具”;存算分离:把“存储”和“计算”分开,存储用专门的分布式系统(比如S3、HDFS),计算用弹性的引擎(比如Spark、Flink),就像“衣柜放在卧室,书桌放在书房”;分布式存储:把数据分散存在多台机器上的系统,就像“很多个小抽屉一起装东西,一个满了用另一个,坏了也不会丢”;弹性计算:计算资源可以随时增加或减少的服务,就像“需要的时候叫快递员,不需要的时候让他们回去”;计算引擎:处理数据的“工具”,比如Spark用来做批量计算,Flink用来做实时计算,就像“厨房的搅拌机、烤箱,各有各的用处”。

二、故事引入:从“超市存包”看存算分离的本质

小朋友们,你们有没有去过大型超市?进门的时候,妈妈会把背包放进“存包柜”,然后拿着小票去购物——为什么不把背包带进去呢?因为购物区人多,带背包不方便,而且存包柜能更安全、更高效地保管东西。

其实,大数据系统以前就像“没存包柜的超市”:所有数据都存在“计算机器”里(就像把背包带进购物区),结果是什么?

购物区变挤了:计算机器的硬盘被数据占满,导致计算速度变慢(就像背包占了购物车的空间,没法装东西);想加购物车很难:如果想增加计算能力,必须买新的“计算+存储”机器(就像想多装东西,得买个更大的背包,但背包里的东西还要重新整理);丢东西风险高:如果某台机器坏了,里面的数据和计算任务都没了(就像背包丢了,里面的东西和买的菜都没了)。

后来,超市发明了“存包柜”,把“存东西”和“买东西”分开——这就是“存算分离”的灵感!大数据系统也一样:把“存数据”的任务交给专门的“存储系统”(存包柜),把“算数据”的任务交给灵活的“计算引擎”(购物车),这样:

购物区(计算引擎)能装更多东西(处理更多任务);存包柜(存储系统)能更安全地保管东西(数据不会丢);想加购物车(计算资源)随时加,不用动存包柜里的东西(数据)。

三、核心概念解释:存算分离的“三大组件”像什么?

存算分离的架构就像“学校的图书馆+教室+管理员”,三个组件缺一不可:

3.1 核心概念一:分布式存储——大数据的“图书馆”

分布式存储是存算分离的“数据仓库”,就像学校的图书馆:

功能:负责保存所有数据(就像图书馆保存所有书);特点:

「大」:能存海量数据(就像图书馆有很多书架,能放几万本书);「稳」:数据分散存在多台机器上,一台坏了不影响(就像一本书有很多副本,丢了一本还有其他本);「快」:能快速找到想要的数据(就像图书馆有索引,能很快找到《哈利波特》)。

例子:AWS的S3、Hadoop的HDFS、开源的Ceph,都是常见的分布式存储系统。

3.2 核心概念二:计算引擎——大数据的“教室”

计算引擎是存算分离的“处理中心”,就像学校的教室:

功能:负责处理数据(就像教室负责上课,把书里的知识变成学生的能力);特点:

「活」:能随时增加或减少(就像教室不够用了,可以临时加一间,用完再撤);「专」:不同的计算引擎做不同的事(就像数学教室用来学数学,语文教室用来学语文)——比如Spark擅长批量计算(比如统计一个月的销量),Flink擅长实时计算(比如监控直播弹幕的情绪);「省」:不用的时候可以关掉,节省成本(就像放学了,教室可以锁门,不用一直开着灯)。

例子:Apache Spark、Apache Flink、Hive(数据仓库工具)、Presto(交互式查询工具)。

3.3 核心概念三:协调层——大数据的“管理员”

协调层是存算分离的“指挥中心”,就像学校的管理员:

功能:负责协调存储系统和计算引擎的工作(就像管理员安排学生去哪个教室上课,告诉教室需要哪些书);特点:

「管资源」:分配计算资源(比如给Spark分配多少台机器);「管任务」:监控计算任务的进度(比如有没有卡住,有没有出错);「管连接」:让计算引擎能找到存储系统里的数据(比如告诉Spark“《哈利波特》在图书馆的3楼A区”)。

例子:Kubernetes(K8s,云原生协调工具)、YARN(Hadoop的资源管理器)、Mesos(通用资源管理器)。

四、核心概念关系:三个组件如何“配合工作”?

存算分离的三个组件就像“快递站+快递员+调度中心”,一起完成“送快递”的任务:

4.1 分布式存储(快递站)与计算引擎(快递员):数据的“取送关系”

快递站(存储)负责存快递(数据),快递员(计算引擎)负责取快递(读数据)、送快递(处理数据)。比如:

快递员(Spark)要送一批“电商订单”快递(数据),首先去快递站(S3)取快递(读S3中的订单数据);然后把快递送到客户手里(处理数据,比如统计每个用户的订单金额);最后把“签收单”(处理结果)放回快递站(写回S3)。

4.2 协调层(调度中心)与计算引擎(快递员):资源的“分配关系”

调度中心(协调层)负责给快递员(计算引擎)分配任务和资源。比如:

双11的时候,快递量突然增加(计算需求变大),调度中心(K8s)会给Spark(快递员)分配更多“快递车”(机器节点);平时快递量小的时候,调度中心会收回多余的“快递车”,节省成本。

4.3 协调层(调度中心)与分布式存储(快递站):数据的“指引关系”

调度中心(协调层)负责告诉快递员(计算引擎)快递(数据)在哪个快递站(存储系统)。比如:

Spark(快递员)要处理“用户行为数据”,调度中心(YARN)会告诉它:“这些数据在HDFS(快递站)的/user/behavior/2024-05-01目录下”。

4.4 核心架构的文本示意图

存算分离的架构可以总结为“三层模型”:

用户/应用 → 计算引擎(Spark/Flink) → 协调层(K8s/YARN) → 分布式存储(S3/HDFS)

↓ ↑

└──────────────────────────────────┘

用户/应用:提出数据处理需求(比如“统计今天的订单量”);计算引擎:执行处理任务(比如用Spark统计订单量);协调层:分配计算资源,指引数据位置;分布式存储:保存原始数据和处理结果。

4.5 Mermaid流程图:数据的“旅行路线”

用流程图看看数据从“存储”到“计算”的过程:

五、核心架构设计:如何搭建一个存算分离系统?

5.1 关键步骤:像“装修房子”一样设计架构

搭建存算分离系统就像“装修书房”,需要三步:

选“储物间”(分布式存储):根据数据类型选——结构化数据(比如订单表)用Hive(建在HDFS或S3上),非结构化数据(比如图片、视频)用S3或Ceph;选“工作台”(计算引擎):根据任务类型选——批量计算用Spark,实时计算用Flink,交互式查询用Presto;选“管理员”(协调层):根据部署环境选——云原生环境用K8s,Hadoop环境用YARN。

5.2 数学模型:存算分离为什么“更省钱”?

我们用“成本公式”来证明存算分离的优势:

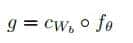

存算一体的成本:( C_1 = (S + C) imes N ),其中:

( S ):每台机器的存储成本(比如1000元/月);( C ):每台机器的计算成本(比如2000元/月);( N ):机器数量(比如10台);总 cost:( (1000+2000) imes 10 = 30000 ) 元/月。

存算分离的成本:( C_2 = S imes D + C imes T ),其中:

( S ):每GB存储成本(比如0.1元/月/GB);( D ):数据量(比如10000GB);( C ):每小时计算成本(比如5元/小时);( T ):计算时间(比如每月100小时);总 cost:( 0.1 imes 10000 + 5 imes 100 = 1000 + 500 = 1500 ) 元/月。

看!存算分离的成本只有存算一体的1/20!为什么?因为存算分离把“固定成本”(存算一体的机器)变成了“可变成本”(存储按数据量算,计算按时间算),当计算需求波动时,比如双11需要计算1000小时,平时只需要100小时,存算分离的成本会更灵活。

5.3 项目实战:电商用户行为分析系统

我们用“存算分离”搭建一个“电商用户行为分析系统”,目标是统计每天每个用户的点击次数。

5.3.1 开发环境搭建

存储系统:用AWS S3(因为它稳定、易用,适合云原生环境);计算引擎:用Apache Spark(因为它擅长批量计算,处理用户行为数据很高效);协调层:用Kubernetes(K8s,因为它能灵活分配Spark的资源);开发工具:用Python(PySpark),因为它简单易懂。

5.3.2 源代码详细实现

首先,我们需要配置Spark连接S3的权限(用AWS的Access Key和Secret Key),然后读取S3中的用户行为数据(Parquet格式,一种高效的列存格式),统计每个用户的点击次数,最后把结果写回S3。

# 导入必要的库

from pyspark.sql import SparkSession

from pyspark.sql.functions import col

# 1. 创建SparkSession,配置S3访问权限

spark = SparkSession.builder

.appName("UserBehaviorAnalysis")

# 配置S3的Access Key(替换成你的)

.config("spark.hadoop.fs.s3a.access.key", "AKIAXXXXXXXXXXXXXX")

# 配置S3的Secret Key(替换成你的)

.config("spark.hadoop.fs.s3a.secret.key", "xxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxx")

# 配置S3的 endpoint(比如AWS的s3.amazonaws.com)

.config("spark.hadoop.fs.s3a.endpoint", "s3.amazonaws.com")

# 启用S3的路径风格(避免DNS问题)

.config("spark.hadoop.fs.s3a.path.style.access", "true")

# 配置Spark的资源(比如用2个 executor,每个4GB内存)

.config("spark.executor.instances", "2")

.config("spark.executor.memory", "4g")

.getOrCreate()

# 2. 读取S3中的用户行为数据(Parquet格式)

# 数据路径:s3a://my-ecommerce-bucket/user-behavior/2024-05-01/

# 假设数据有三列:user_id(用户ID)、action(行为类型,比如"click")、timestamp(时间戳)

df = spark.read.parquet("s3a://my-ecommerce-bucket/user-behavior/2024-05-01/")

# 3. 数据处理:统计每个用户的点击次数

# 过滤出“click”行为,然后按user_id分组,统计次数

user_click_count = df.filter(col("action") == "click")

.groupBy("user_id")

.count()

.withColumnRenamed("count", "click_count") # 把列名从“count”改成“click_count”

# 4. 将结果写回S3(Parquet格式,分区存储)

# 结果路径:s3a://my-ecommerce-bucket/user-click-count/2024-05-01/

# mode="overwrite":如果路径存在,覆盖它

user_click_count.write.parquet(

path="s3a://my-ecommerce-bucket/user-click-count/2024-05-01/",

mode="overwrite",

compression="snappy" # 用Snappy压缩,减少存储体积

)

# 5. 停止SparkSession,释放资源

spark.stop()

print("用户行为分析完成!结果已保存到S3。")

5.3.3 代码解读与分析

步骤1:创建SparkSession时,配置了S3的访问权限和资源参数——这一步就像“告诉Spark:你可以去S3拿数据,我给你2台机器,每台4GB内存”;步骤2:读取Parquet格式的数据——Parquet是列存格式,读取“user_id”“action”这样的列会很快,比CSV格式高效很多;步骤3:过滤和分组统计——这是计算的核心,Spark会把任务分配到2台机器上并行处理,比如一台处理用户ID为1-1000的数据,另一台处理1001-2000的数据,这样速度会很快;步骤4:写回S3时用了Snappy压缩——压缩后的数据体积会变小,节省存储成本,而且读取的时候也会更快;步骤5:停止SparkSession——用完资源要释放,就像“快递员送完快递要下班”。

六、实际应用场景:存算分离能解决哪些“大数据痛点”?

6.1 场景一:电商大促的“弹性计算”需求

痛点:双11、618的时候,用户点击量、订单量会突然增加10倍甚至100倍,传统存算一体的系统无法快速增加计算资源,导致系统崩溃。

存算分离的解决方式:

存储层:用S3保存所有用户行为数据(比如点击、收藏、下单),不管数据量多大,S3都能装下;计算层:用Spark或Flink做实时计算,大促时通过K8s增加100台计算节点,大促后减少到10台,节省成本;案例:亚马逊电商用EMR(弹性MapReduce)+ S3的存算分离架构,应对黑五的高峰,计算资源能在10分钟内扩展10倍,成本降低了40%。

6.2 场景二:金融的“实时风险监控”需求

痛点:金融机构需要实时监控交易数据(比如信用卡消费、转账),识别欺诈行为,传统存算一体的系统无法快速处理海量实时数据。

存算分离的解决方式:

存储层:用Kafka(消息队列)保存实时交易数据,用HDFS保存历史交易数据;计算层:用Flink做实时计算,从Kafka读取实时数据,结合HDFS的历史数据,实时判断交易是否欺诈;案例:某银行用Flink + HDFS + Kafka的存算分离架构,实时监控100万笔/秒的交易数据,欺诈识别延迟从5分钟降到了5秒,准确率提高了30%。

6.3 场景三:医疗的“影像数据处理”需求

痛点:医院的医学影像数据(比如CT、MRI)体积很大(每幅影像1-10GB),传统存算一体的系统无法存储和处理这些数据。

存算分离的解决方式:

存储层:用Ceph(开源分布式存储)保存医学影像数据,支持PB级存储;计算层:用TensorFlow或PyTorch做AI推理,从Ceph读取影像数据,识别肿瘤、骨折等病变;案例:某医院用Ceph + TensorFlow的存算分离架构,处理10万幅CT影像,推理时间从24小时降到了2小时,医生的诊断效率提高了50%。

七、工具和资源推荐:存算分离的“武器库”

7.1 分布式存储工具

云存储:AWS S3(稳定、易用)、阿里云OSS(性价比高)、腾讯云COS(适合国内场景);开源存储:HDFS(Hadoop生态的核心存储)、Ceph(支持对象存储、块存储、文件存储)、MinIO(轻量级对象存储)。

7.2 计算引擎工具

批量计算:Apache Spark(支持Java/Scala/Python,生态丰富)、Hadoop MapReduce(传统批量计算,适合简单任务);实时计算:Apache Flink(低延迟、高吞吐,适合实时处理)、Apache Kafka Streams(轻量级实时计算,适合流处理);交互式查询:Presto(支持跨数据源查询,比如S3、HDFS、MySQL)、Apache Impala(适合Hadoop生态的交互式查询)。

7.3 协调层工具

云原生协调:Kubernetes(K8s,支持容器化部署,灵活分配资源);Hadoop协调:YARN(Hadoop的资源管理器,适合Hadoop生态);通用协调:Apache Mesos(支持多种框架,比如Spark、Flink、Hadoop)。

7.4 监控工具

资源监控:Prometheus(收集 metrics 数据)+ Grafana(可视化 metrics 数据);任务监控:Spark UI(监控Spark任务的进度、资源使用情况)、Flink UI(监控Flink任务的延迟、吞吐量);存储监控:S3 Console(AWS的S3管理控制台)、Ceph Dashboard(Ceph的可视化管理界面)。

八、未来发展趋势与挑战

8.1 未来趋势

趋势一:存算分离与云原生的深度结合:越来越多的企业会把存算分离系统部署在K8s上,利用云原生的弹性、可观测性、自动化优势,比如用K8s管理Spark、Flink的容器,用S3作为存储,实现“一键部署、弹性扩展”;趋势二:存算分离与AI的结合:AI模型需要大量数据训练,存算分离能让AI模型更快地读取数据(比如从S3读取海量图片数据,用Spark做数据预处理,用TensorFlow做训练),而且计算资源可以根据训练需求弹性扩展;趋势三:存算分离的边缘计算:边缘计算需要在靠近用户的地方处理数据(比如智能摄像头的实时监控),存算分离能把边缘存储(比如本地的Ceph集群)和边缘计算(比如本地的Flink集群)分开,降低延迟,提高效率。

8.2 挑战

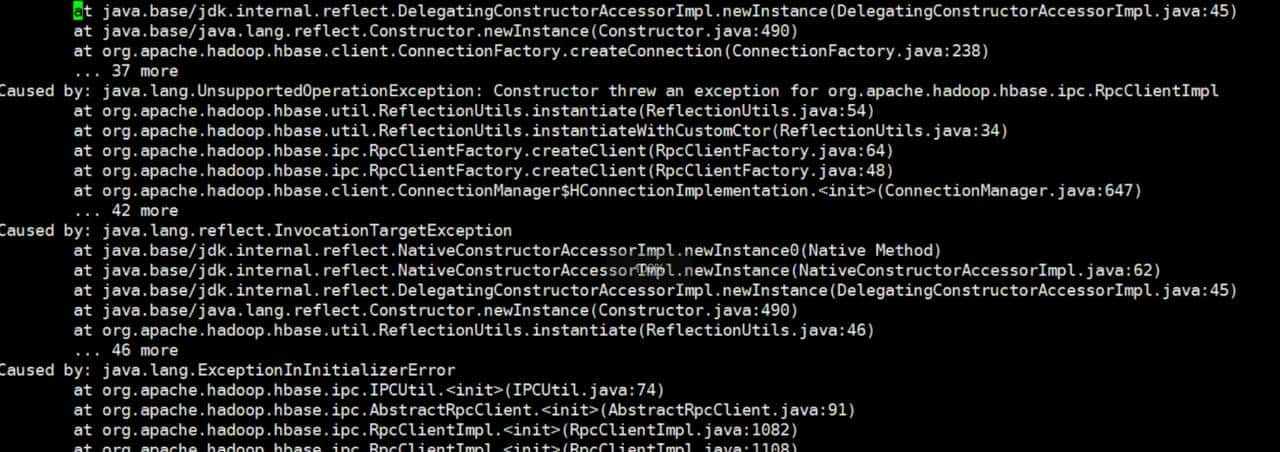

挑战一:数据传输延迟:存算分离后,计算引擎需要从存储系统读取数据,数据传输的延迟会影响计算性能,比如实时处理场景下,延迟可能会从1秒变成5秒;挑战二:数据一致性:多个计算引擎同时访问存储系统中的数据,可能会导致数据不一致,比如Spark和Flink同时修改同一个文件,会导致结果错误;挑战三:管理复杂度:存算分离需要管理存储系统、计算引擎、协调层三个组件,比存算一体的系统更复杂,比如需要配置S3的权限、K8s的资源、Spark的参数,容易出错。

九、总结:存算分离到底给我们带来了什么?

今天我们学了“存算分离”,就像把“存东西”和“做事情”分开,它给大数据系统带来了三个“超级能力”:

更弹性:计算资源可以随时增加或减少,应对波动的需求(比如双11的高峰);更省钱:存储按数据量算,计算按时间算,比存算一体的系统成本低很多;更可靠:存储系统和计算引擎分开,一台机器坏了,不会影响另一台(比如存储系统坏了,计算引擎还能继续处理其他数据)。

核心概念回顾

分布式存储:大数据的“图书馆”,负责存数据;计算引擎:大数据的“教室”,负责算数据;协调层:大数据的“管理员”,负责协调两者的工作。

概念关系回顾

分布式存储和计算引擎:数据的“取送关系”(快递站和快递员);协调层和计算引擎:资源的“分配关系”(调度中心和快递员);协调层和分布式存储:数据的“指引关系”(调度中心和快递站)。

十、思考题:动动小脑筋

如果你是超市的经理,你会怎么用“存算分离”的思想优化超市的流程?(比如把“存包”和“购物”分开,还有没有其他可以分开的环节?)存算分离在“实时直播弹幕分析”中的挑战是什么?(比如弹幕数据量很大,实时处理需要低延迟,存算分离会不会导致延迟增加?)如果你要给你们公司搭建一个存算分离系统,你会选择哪些工具?(比如存储用S3,计算用Spark,协调用K8s,为什么?)

十一、附录:常见问题与解答

Q1:存算分离是不是只能用在云上?

A:不是,存算分离也可以用在本地部署的系统中,比如用HDFS作为存储,Spark作为计算引擎,YARN作为协调层,这也是存算分离的一种形式。只不过云上的存算分离更灵活,因为云服务商提供了弹性的存储和计算服务。

Q2:存算分离会增加数据传输的成本吗?

A:会,但通常可以接受。比如AWS S3的数据传输成本是0.02元/GB(从S3到EC2),而存算分离节省的计算成本远大于数据传输成本。另外,可以通过“缓存”(比如把常用的数据存在计算引擎的本地磁盘)来减少数据传输的次数,降低成本。

Q3:存算分离适合所有大数据场景吗?

A:不是,比如“低延迟、小数据量”的场景(比如实时查询一个小表的数据),存算一体的系统可能更高效,因为数据就在计算机器里,不用传输。但对于“海量数据、波动需求”的场景(比如电商大促、金融风险监控),存算分离是更好的选择。

十二、扩展阅读 & 参考资料

《Hadoop权威指南》(第4版):讲解Hadoop生态的存算分离架构(HDFS + MapReduce + YARN);《Spark快速大数据分析》(第2版):讲解Spark如何与分布式存储(比如S3、HDFS)集成;《云原生架构与实践》:讲解存算分离与云原生的结合(K8s + Spark + S3);AWS官方文档:《Amazon S3 最佳实践》《Amazon EMR 存算分离架构》;Apache Flink官方文档:《Flink 与分布式存储的集成》。

结语:存算分离不是“新技术”,而是“新思想”——它让大数据系统从“绑在一起的组合家具”变成了“可灵活组合的模块家具”。未来,随着云原生、AI、边缘计算的发展,存算分离会成为大数据系统的“标准架构”,帮我们解决更多“数据爆炸”的问题。希望这篇文章能让你听懂存算分离,也能用上存算分离!

相关文章

![[LaTeX] VScode+SumatraPDF 配置正反向索引](https://www.dunling.com/img/10.jpg)