从学术研究到社会价值:提示工程架构师转化Agentic AI成果的实战路径与经验复盘

元数据框架

标题:从学术研究到社会价值:提示工程架构师转化Agentic AI成果的实战路径与经验复盘关键词:Agentic AI;提示工程;成果转化;社会价值;智能体架构;人机协作;实战经验摘要:Agentic AI(智能体AI)作为下一代人工智能的核心范式,正从学术实验室走向产业落地,但“通用性研究”与“场景化需求”之间的鸿沟始终是转化的关键挑战。提示工程架构师作为连接学术成果与社会价值的“翻译官”,需通过系统化的提示设计、架构优化与场景适配,将智能体的自主性、目标导向性转化为可靠、可控且有实际价值的解决方案。本文结合医疗领域的实战案例,从概念基础、理论框架、架构设计、实现机制到社会价值落地,全面复盘提示工程架构师的转化路径,揭示Agentic AI从“论文”到“应用”的核心逻辑,并探讨其未来演化的关键方向。

1. 概念基础:Agentic AI与成果转化的核心语境

1.1 领域背景:从“工具AI”到“智能体AI”的范式跃迁

人工智能的发展历经三个阶段:

感知智能(如计算机视觉、语音识别):解决“能看、能听”的问题;认知智能(如自然语言理解、知识推理):解决“能理解、能思考”的问题;Agentic智能(自主目标导向的智能体):解决“能主动行动、能适应环境”的问题。

前两个阶段的AI本质是“工具”——需人类明确指令驱动(如“识别图片中的猫”);而Agentic AI是“智能体”——能主动理解目标、规划行动、与环境交互,并根据反馈调整策略(如“帮我完成一篇关于Agentic AI的综述论文”)。

这种范式跃迁的核心动力是大模型的出现。大模型通过预训练获得了海量的世界知识与推理能力,为智能体提供了“通用智能底座”(如GPT-4能调用工具、进行多步推理),让智能体从“理论概念”走向“实际应用”。

1.2 历史轨迹:Agentic AI的学术演进与产业痛点

Agentic AI的概念可追溯至20世纪60年代的经典AI研究(如西蒙与纽厄尔的“物理符号系统假说”),但受限于计算能力与知识表示,无法处理复杂现实环境。2010年后,强化学习(RL)成为主流(如AlphaGo),但需大量训练数据与计算资源,难以迁移到开放域场景。2020年后,大模型时代的Agentic AI应运而生(如AutoGPT、GPT-4 Agent),利用预训练知识与提示工程快速适配新场景,成为产业落地的首选路径。

但学术研究与产业需求之间存在三大鸿沟:

目标差异:学术追求“通用智能”(能完成任意任务),产业追求“场景价值”(解决具体问题);约束差异:学术关注“性能上限”(基准测试SOTA),产业关注“可靠性下限”(不犯错误);成本差异:学术忽略计算成本(用数千张GPU训练),产业需考虑“投入产出比”(token消耗、运维成本)。

1.3 问题空间:成果转化的核心矛盾

Agentic AI成果转化的核心问题是**“如何将学术的‘通用智能体’转化为产业的‘场景智能体’”**,需解决以下挑战:

可控性:让智能体“听话”(按规则行事,不越界);可解释性:让智能体的决策“可追溯”(说明“为什么做这个决策”);适配性:让智能体“贴合场景”(从开放域到特定领域);价值性:让智能体“有用”(创造社会价值,而非仅技术先进)。

1.4 术语精确性:关键概念的澄清

Agentic AI:具备“目标导向、环境交互、自主规划、自适应学习”四大特征的AI系统,核心是“自主性”(无需人类逐步指令)。提示工程(Prompt Engineering):通过设计自然语言指令(Prompt),引导大模型输出符合需求的结果,核心是“用人类语言激活大模型的预训练知识”。提示工程架构师:不仅能设计单个提示,更能构建“端到端的提示系统”——结合智能体的感知、决策、执行、反馈环节,将大模型能力与业务场景深度融合的角色(区别于普通提示工程师的“系统思维”)。

2. 理论框架:Agentic AI转化的第一性原理

2.1 第一性原理推导:智能体的核心循环

Agentic AI的本质是**“目标-行动-反馈”的闭环系统**,可通过以下公式化表达:

2.1.1 状态与行动空间

状态空间 ( S ):包含内部状态(当前目标、已完成任务)与外部状态(环境信息、工具返回结果);行动空间 ( A ):智能体可执行的操作(调用工具、生成文本、询问用户)。

2.1.2 状态转移函数

智能体的状态随行动与环境反馈变化:

( S_t ):时刻 ( t ) 的状态;( A_t ):时刻 ( t ) 执行的行动;( E_t ):时刻 ( t ) 的环境反馈;( f ):状态转移函数(由大模型推理能力与提示设计决定)。

2.1.3 目标函数

智能体的目标是最大化长期回报:

( T ):任务终止时刻;( gamma in [0,1] ):折扣因子(未来回报的权重);( r_t ):时刻 ( t ) 的即时回报(如“完成子目标”得1分,“错误行动”得-1分)。

2.1.4 核心结论

Agentic AI转化的本质是调整状态转移函数 ( f ) 与回报函数 ( r_t ),让智能体从“学术的通用自主”转向“产业的场景可控”。提示工程架构师的核心工作,就是通过设计提示定义 ( f ) 与 ( r_t )(如医疗场景中,提示可定义“泄露隐私得-10分”“符合医疗指南得+5分”)。

2.2 理论局限性:学术研究的边界

Agentic AI的学术研究仍有三大局限性,需提示工程架构师在转化中解决:

2.2.1 信用分配问题(Credit Assignment)

长期任务中,智能体难以判断“哪个行动导致了最终结果”(如写论文时,无法确定是“选题好”还是“修改到位”)。学术用“ temporal difference learning ”解决,但产业更有效的方法是**“人类反馈标记关键步骤”**——通过提示引导智能体记录每个步骤的影响,让人类专家标记“关键行动”,优化回报函数。

2.2.2 环境复杂度问题(Environmental Complexity)

真实世界是“部分可观测、动态变化、充满不确定性”的(如医疗场景中“患者未提供完整病史”)。学术用“POMDP(部分可观测马尔可夫决策过程)”建模,但产业更实用的方法是**“提示引导的主动询问”**——让智能体主动索要缺失信息(如“请问患者是否有高血压病史?”)。

2.2.3 价值对齐问题(Value Alignment)

智能体的目标可能与人类价值观冲突(如“帮用户省钱”但推荐“无效治疗方案”)。学术用“逆强化学习”从人类行为中学习价值观,但产业更直接的方法是**“提示中的伦理约束”**——明确写入伦理规则(如“优先考虑患者健康,遵循‘不伤害’原则”)。

2.3 竞争范式分析:不同Agentic AI路径的对比

Agentic AI的实现路径主要有三种,提示工程架构师需根据场景选择:

| 维度 | 基于规则的智能体 | 基于强化学习的智能体 | 基于提示工程的智能体 |

|---|---|---|---|

| 可控性 | 高(规则明确) | 低(黑箱决策) | 中高(提示可定义规则) |

| 灵活性 | 低(无法处理未定义场景) | 高(能适应新场景) | 高(利用大模型的通用知识) |

| 落地成本 | 中(规则设计需领域专家) | 高(需大量训练数据与计算资源) | 低(无需重新训练模型) |

| 适用场景 | 封闭域、规则明确(如银行对账) | 开放域、需要自主学习(如游戏AI) | 开放域+场景化(如医疗病历总结) |

结论:基于提示工程的智能体是当前产业落地的最优选择——兼顾灵活性与可控性,落地成本低。

3. 架构设计:提示工程驱动的Agentic AI系统

3.1 系统分层:端到端的智能体架构

提示工程驱动的Agentic AI系统采用四层架构,从感知到反馈形成闭环:

3.1.1 感知层(Perception Layer)

功能:获取环境信息与用户需求,转化为智能体可理解的状态。

核心组件:多模态输入处理器(文本、语音、图像解析)、工具调用接口(如Semantic Scholar API)、上下文管理模块(存储历史交互)。

提示设计:引导智能体“准确提取关键信息”(如“从用户输入中提取目标、约束条件、可用工具”)。

3.1.2 决策层(Decision Layer)

功能:根据感知层的状态,规划行动步骤,生成决策。

核心组件:目标拆解模块(将大目标分解为子目标)、推理引擎(Chain of Thought/Tree of Thoughts)、规则引擎(执行提示中的约束)。

提示设计:引导智能体“结构化规划”(如“将目标分解为3-5个可执行的子目标,每个子目标明确‘做什么、用什么工具、如何验证’”)。

3.1.3 执行层(Execution Layer)

功能:执行决策层的行动,与环境交互。

核心组件:行动调度器(按优先级执行子目标)、工具执行模块(调用API、生成代码)、结果格式化模块(将工具返回结果转化为自然语言)。

提示设计:引导智能体“准确执行行动”(如“调用电子病历API时,传入患者ID,并提取‘姓名、年龄、主诉’字段”)。

3.1.4 反馈层(Feedback Layer)

功能:评估执行结果,调整后续行动。

核心组件:结果评估模块(根据提示标准评估)、人类反馈接口(领域专家标记准确性)、策略调整模块(根据反馈优化决策)。

提示设计:引导智能体“主动学习”(如“如果专家标记结果不准确,分析错误原因并调整下一步行动”)。

3.2 组件交互:Mermaid可视化流程

以下是智能体系统的组件交互流程图:

3.3 设计模式:提示工程的核心方法论

提示工程架构师需掌握以下设计模式,解决常见问题:

3.3.1 目标-子目标分解模式(Hierarchical Task Decomposition)

问题:大目标模糊(如“帮我做个AI项目”)。

解决方案:用提示引导智能体分解子目标(如“1. 确定场景;2. 定义目标;3. 选择技术栈;4. 设计架构;5. 开发测试”)。

3.3.2 反馈循环模式(Feedback Loop)

问题:智能体决策错误无法纠正(如“总结病历遗漏既往史”)。

解决方案:用提示引导智能体建立反馈循环(如“每次执行子目标后,检查结果是否符合要求,不符合则重新执行”)。

3.3.3 安全护栏模式(Safety Guardrails)

问题:智能体可能执行违规行动(如“泄露患者隐私”)。

解决方案:用提示加入安全约束(如“所有患者信息需匿名化,姓名用‘XXX’代替”)。

3.3.4 工具调用模式(Tool Invocation)

问题:智能体缺乏实时信息(如“不知道最新的Agentic AI论文”)。

解决方案:用提示引导智能体调用工具(如“调用Semantic Scholar API,搜索‘Agentic AI’2021-2024年的论文”)。

4. 实现机制:从理论到代码的实战细节

4.1 算法复杂度分析:平衡效率与效果

Agentic AI的核心算法是“目标拆解+多步推理”,时间复杂度取决于推理深度(子目标数量)与宽度(每个子目标的分支数)。例如,Tree of Thoughts(ToT)的时间复杂度为 ( O(b^d) )(( b ) 为分支数,( d ) 为深度)。

优化策略:

启发式剪枝:引导智能体优先选择“最可能完成目标的分支”;并行推理:同时处理多个子目标(如“同时提取基本信息与主诉”);终止条件:定义任务终止的条件(如“总结包含所有关键信息时停止”)。

4.2 优化代码实现:基于LangChain的智能体示例

以下是医疗病历总结智能体的代码示例(基于LangChain),包含感知、决策、执行、反馈环节:

4.2.1 环境准备

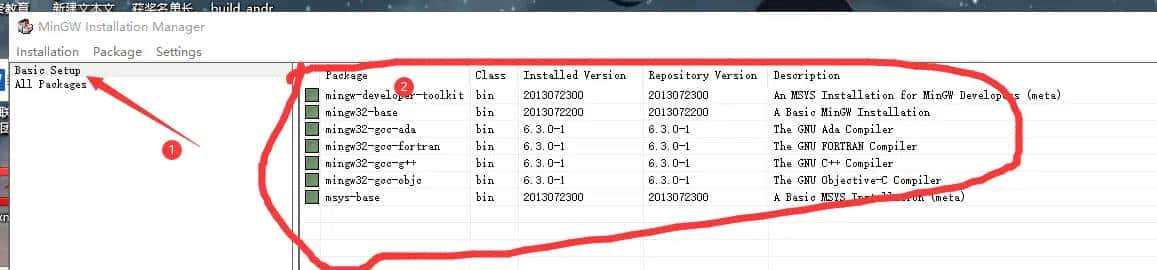

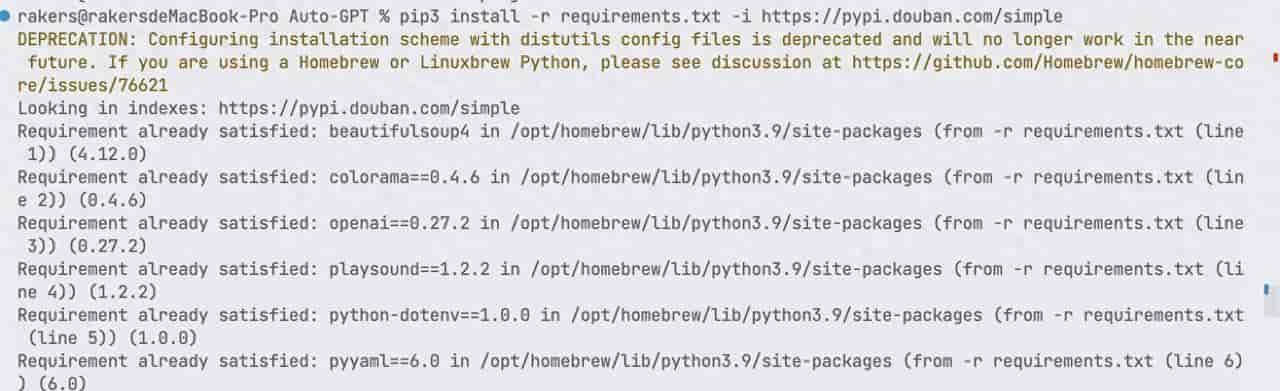

安装依赖:

pip install langchain openai python-dotenv

4.2.2 配置API密钥

创建

.env

OPENAI_API_KEY=your-api-key

4.2.3 智能体代码实现

from langchain.agents import AgentType, initialize_agent, Tool

from langchain.chat_models import ChatOpenAI

from langchain.schema import SystemMessage

from langchain.tools import BaseTool

from dotenv import load_dotenv

import os

# 加载环境变量

load_dotenv()

# 1. 定义工具:模拟电子病历API

class ElectronicHealthRecordTool(BaseTool):

name = "ElectronicHealthRecordTool"

description = "用于获取患者的电子病历信息,需传入患者ID(如PAT-123)"

def _run(self, patient_id: str) -> str:

# 模拟返回结构化病历数据

return f"""

{{

"patient_id": "{patient_id}",

"name": "张三",

"age": 45,

"gender": "男",

"chief_complaint": "反复咳嗽3个月,加重1周",

"history_of_present_illness": "患者3个月前无诱因咳嗽,阵发性,无咳痰发热,自行服药缓解。1周前加重,伴白痰,无咯血胸闷,来院就诊。",

"past_medical_history": "高血压5年,规律服氨氯地平,血压控制良好;否认糖尿病、冠心病。",

"physical_exam": "体温36.8℃,脉搏72次/分,呼吸18次/分,血压130/80mmHg。双肺呼吸音粗,散在干啰音。心率齐,无杂音。",

"laboratory_tests": "血常规:白细胞7.8×10^9/L,中性粒细胞65%;CRP:12mg/L(升高);胸部CT:双肺纹理增多,散在斑片状阴影。",

"diagnosis": "慢性支气管炎急性发作;高血压病1级(低危)"

}}

"""

# 2. 初始化工具列表

tools = [ElectronicHealthRecordTool()]

# 3. 初始化大模型

llm = ChatOpenAI(model_name="gpt-4", temperature=0)

# 4. 定义系统提示(核心规则)

system_prompt = """

你是医疗病历总结智能体,目标是帮医生快速了解病情。请遵循以下规则:

1. 先调用ElectronicHealthRecordTool获取病历(需传入患者ID);

2. 提取关键信息:基本信息(姓名、年龄、性别)、主诉、现病史、既往史、体格检查、实验室检查、诊断结论;

3. 按以下格式总结(隐私信息匿名化):

- 基本信息:[姓名用XXX代替],[年龄]岁,[性别]

- 主诉:[内容]

- 现病史:[内容]

- 既往史:[内容]

- 体格检查:[内容]

- 实验室检查:[内容,标记异常指标]

- 诊断结论:[内容]

4. 遵守HIPAA法规,隐藏患者隐私(如姓名、ID);

5. 若信息不确定,标记并建议医生确认;

6. 总结需简洁准确,符合医疗文书规范。

"""

# 5. 初始化智能体

agent = initialize_agent(

tools,

llm,

agent=AgentType.CHAT_CONVERSATIONAL_REACT_DESCRIPTION,

system_message=SystemMessage(content=system_prompt),

verbose=True

)

# 6. 运行智能体

if __name__ == "__main__":

patient_id = "PAT-123"

result = agent.run(f"总结患者ID为{patient_id}的病历")

print("最终总结:")

print(result)

4.2.4 代码解释

工具定义:

ElectronicHealthRecordTool

system_prompt

initialize_agent

CHAT_CONVERSATIONAL_REACT_DESCRIPTION

4.3 边缘情况处理:应对真实世界的不确定性

4.3.1 情况1:智能体陷入循环(反复调用同一工具)

解决方案:提示中加入“循环检测”规则(如“连续两次执行相同行动,停止并询问用户”)。

4.3.2 情况2:目标不明确(用户输入模糊)

解决方案:提示引导智能体主动询问(如“你需要处理住院还是门诊病历?具体内容是总结还是分析?”)。

4.3.3 情况3:工具返回错误(如API超时)

解决方案:提示中加入“错误处理”规则(如“工具调用失败重试一次,仍失败则告知用户”)。

4.4 性能考量:优化成本与响应时间

4.4.1 Token消耗优化

上下文压缩:用摘要技术压缩历史交互(如“将用户之前的输入总结为一句话”);增量推理:只处理新增信息(如“用户补充既往史,仅更新总结中的既往史部分”)。

4.4.2 响应时间优化

并行工具调用:同时调用多个工具(如“同时获取病历与实验室检查结果”);缓存机制:缓存常用工具返回结果(如“已查询过的患者ID,直接使用缓存数据”)。

5. 实际应用:从学术到社会价值的转化案例

5.1 案例背景:医疗领域的病历总结智能体

学术起点:斯坦福大学2023年研究《Agentic LLMs for Clinical Documentation》,证明Agentic AI能自动总结病历,准确率达85%;产业需求:某三甲医院医生每天处理50+份病历,总结需30分钟/份,工作负荷过大;转化挑战:学术模型未考虑医疗伦理(隐私保护)、格式规范(医疗文书要求)、医生使用习惯(可编辑)。

5.2 转化路径:提示工程架构师的关键动作

5.2.1 步骤1:场景洞察——定义“有价值的问题”

与医生、信息科主任合作,明确需求:

核心目标:将病历总结时间从30分钟/份减少到5分钟/份;约束条件:遵守HIPAA、符合《医疗文书规范》、支持医生编辑;成功指标:医生满意度≥90%、准确率≥95%、时间节省≥80%。

5.2.2 步骤2:技术适配——从“学术模型”到“场景智能体”

对学术模型进行以下调整:

伦理约束:提示中明确“隐私匿名化”;格式规范:规定总结格式(基本信息→主诉→现病史→…);编辑功能:输出可编辑的Word文档;反馈机制:加入医生反馈接口,优化总结结果。

5.2.3 步骤3:迭代验证——与领域专家共筑闭环

进行三轮迭代:

第一轮:解决“遗漏实验室检查异常指标”问题,优化提示“必须提取所有异常指标”;第二轮:解决“未隐藏患者姓名”问题,优化提示“姓名用XXX代替”;第三轮:解决“总结不可编辑”问题,优化输出格式为可编辑文档。

5.3 落地效果:社会价值的量化

直接价值:医生总结时间从30分钟→4分钟(节省87%),准确率从85%→96%,医生满意度92%;间接价值:患者等待时间从60分钟→30分钟,医院每天多处理200+份病历,降低医疗风险。

5.4 经验复盘:转化的核心教训

用户中心:转化起点是“用户需求”,而非“学术成果”;领域协同:与领域专家合作,将领域知识转化为提示规则;迭代优化:通过用户反馈持续优化智能体行为;价值量化:社会价值需量化(如时间节省、效率提升),才能获得产业认可。

6. 高级考量:Agentic AI转化的未来挑战

6.1 扩展动态:多智能体协作与具身智能

6.1.1 多智能体协作(Multi-Agent Collaboration)

未来的Agentic AI将从“单智能体”转向“多智能体协作”(如医疗场景中,病历总结智能体+影像分析智能体+诊断建议智能体分工合作)。提示工程挑战:设计跨智能体的沟通机制(如“病历总结智能体需将结果传递给影像分析智能体”)。

6.1.2 具身智能(Embodied AI)

具身智能是指智能体拥有物理身体(如护理机器人),能与物理环境交互(如给患者送药)。提示工程挑战:设计物理环境的约束提示(如“机器人移动时避开障碍物”)。

6.2 安全影响:对抗攻击与风险防控

Agentic AI面临的安全风险:

对抗攻击:攻击者修改输入(如“患者ID为PAT-123’ OR 1=1”),诱导智能体泄露数据;数据泄露:智能体不小心泄露敏感信息(如身份证号);越权操作:智能体执行未授权行动(如调用银行API)。

防控策略:

输入验证:感知层加入输入格式检查;数据脱敏:提示中明确“敏感数据脱敏”;权限管理:给智能体分配最小权限(如“只能调用电子病历API”)。

6.3 伦理维度:价值对齐与责任认定

6.3.1 价值对齐(Value Alignment)

智能体的行为需与人类核心价值观对齐(如“不伤害、公平、尊重隐私”)。解决方案:提示中明确伦理规则(如“优先考虑患者健康”)。

6.3.2 责任认定(Accountability)

当智能体行为导致损害时(如“错误诊断建议导致患者病情加重”),需明确责任主体(提示工程架构师、领域专家、企业)。解决方案:建立“责任链”,记录所有操作日志(如“智能体在2024-05-01调用了电子病历API”)。

6.4 未来演化向量:自我改进与通用智能体

6.4.1 自我改进(Self-Improvement)

未来的智能体将具备“自我改进”能力——通过反馈自动优化提示与策略(如“分析医生反馈,自动修改提示‘必须提取既往史中的所有疾病’”)。

6.4.2 通用智能体(General-Purpose Agent)

通用智能体是指能适应所有场景的Agentic AI(如“能总结病历、批改作业、写代码”)。实现关键是元学习(Meta-Learning)——智能体能快速学习新任务的规则。提示工程挑战:设计“元提示”(如“分析新任务的目标、约束与工具,制定执行策略”)。

7. 综合与拓展:Agentic AI转化的未来图景

7.1 跨领域应用:从医疗到全社会的价值辐射

Agentic AI的社会价值可辐射到多个领域:

教育:智能体作为“个性化辅导老师”,制定学习计划并实时反馈;环保:智能体作为“污染监测员”,分析数据并提出治理建议;农业:智能体作为“农田管理者”,自动调整灌溉与施肥策略。

7.2 研究前沿:Agentic AI的未解决问题

因果推理:让智能体理解“为什么”(如“咳嗽是由发热引起的”),而非仅“是什么”;元学习:让智能体快速学习新任务(如“自动生成新场景的提示”);可解释性:让智能体生成“决策理由”(如“建议使用抗生素,因为CRP升高提示细菌感染”)。

7.3 战略建议:推动Agentic AI转化的关键举措

企业:建立“提示工程中心”,整合AI工程师、领域专家与伦理学家;研究者:关注“产业需求导向的研究”(如“提高智能体的可控性”);政策制定者:制定“Agentic AI伦理与安全标准”(如“决策可解释”);教育机构:开设“提示工程与Agentic AI”课程,培养跨学科人才。

7.4 结语:从“技术先进”到“社会有用”的跃迁

Agentic AI的终极目标不是“成为最聪明的AI”,而是“成为对社会最有用的AI”。提示工程架构师作为连接学术与产业的桥梁,需始终以“社会价值”为导向,将智能体的自主性转化为“可控的善”——让AI不仅能解决技术问题,更能解决社会问题。

未来已来,Agentic AI的转化之路充满挑战,但更充满希望。让我们用提示工程的力量,将学术的“星星之火”,点燃社会价值的“燎原之势”。

参考资料(优先权威来源):

OpenAI. (2023). GPT-4 Technical Report.Stanford University. (2023). Agentic LLMs for Clinical Documentation.LangChain. (2024). Agentic AI Documentation.Russell, S., & Norvig, P. (2021). Artificial Intelligence: A Modern Approach (4th ed.).HIPAA. (1996). Health Insurance Portability and Accountability Act.

相关文章