在2025年AI生图赛道如火如荼的当下,海外巨头如Flux、Midjourney和Stable Diffusion 3频频刷屏,但中国AI企业从未缺席。就在11月27日深夜,阿里巴巴通义实验室低调开源了Z-Image-Turbo——一款仅6B参数的“人民的生图模型”。它不是简单的跟跑者,而是以“单流DiT架构+8步Turbo推理”硬刚20B级旗舰,生成速度快到飞起(RTX 4090上2.3秒/张),显存占用低至13GB,支持消费级RTX 3060 6GB流畅运行。更牛的是,它在中英双语文本渲染和复杂中文指令上零崩坏,彻底解决“AI不接地气”的痛点。

模型一经上线,ModelScope下载量破万,Hugging Face Space访问峰值超10万,Bilibili教程视频一夜破5万播放。 在国内社区,CSDN和知乎用户直呼“国产之光”,由于它不只开源(Apache 2.0许可),还完美适配ComfyUI工作流,让普通创作者在家就能批量产出印刷级画质。模型地址:

https://www.modelscope.cn/models/Tongyi-MAI/Z-Image-Turbo。

作为一名专注国产AI的程序员,我对Z-Image-Turbo的出现格外振奋。它标志着阿里从Qwen系列文本模型向多模态的跃升,不仅在性能上媲美闭源大佬,还以效率和亲民性重塑生态。为什么说它是2025年生图界的“黑马”?本文将从背景、技术拆解、性能实测、使用指南、应用场景到未来展望,全方位剖析这款模型。准备好,一起见证中国AI如何“Turbo”起飞!

第一章:Z-Image家族的“Turbo”起源——阿里多模态的国产野心

要聊Z-Image-Turbo,先得回溯阿里通义实验室的AI征程。自2023年Qwen大模型横空出世,阿里已累计开源200+款模型,覆盖文本、视觉、音频全链路。其中,图像生成是重头戏:2023年的通义万相(Wanx)首开文生图先河,2025年2月的万相v2.1引入模板化生图,但参数庞大、速度瓶颈让它更适合云端。Z-Image系列则是阿里“轻量化革命”的巅峰,专为“AI for All”设计。

Z-Image总参数仅6B(60亿),却分三路出击:

– Z-Image-Turbo:蒸馏版,专注极速推理,8步采样出图,亚秒级延迟。(可以开源下载)

– Z-Image-Base:基础版,便于开发者微调和自定义。 (即将发布) – Z-Image-Edit:编辑版,支持自然语言图生图,如“把背景换成黄山日出”。 (即将发布)

目前,Turbo版率先开源(Base和Edit权重即将跟进),文件仅24GB,远低于Flux的30GB+。 发布背景源于阿里对行业痛点的洞察:传统DiT模型(如Flux)参数爆炸,推理需20-50步,消费级硬件吃不消;中文提示常崩(如“夜晚的阳光”生成黑屏)。通义团队花半年迭代,结合Qwen3-VL视觉语言模型,打造出“单流+解耦蒸馏”的黑科技。

从国产视角,这不仅是技术升级,更是战略布局。阿里云ModelStudio平台已集成Z-Image,支持按token付费API,助力电商和广告产业。在中美AI博弈中,Z-Image-Turbo以开源姿态“弯道超车”,下载量已超Hugging Face日均峰值,社区fork项目破百。知乎专栏直言:“阿里开源Z-Image,全球最强开源生图模型。” 这份自信,源于阿里“计算+语义”的本土优化——Qwen的中文底座,让模型懂“江南水乡的烟雨朦胧”。

第二章:技术黑科技拆解——单流DiT+DMDR,6B参数的“效率魔法”

Z-Image-Turbo不是堆参数的产物,而是架构革命。核心是S3-DiT(Single-Stream Diffusion Transformer),一种单流扩散Transformer设计。传统模型(如Stable Diffusion)将文本、视觉和图像Token分开处理,导致信息孤岛和效率低下;Z-Image则串联成“单一流”:提示词→语义嵌入→图像生成,全程无缝。 这让6B参数在固定预算下,提升细节建模30%以上。

关键创新三剑客:

1. 解耦DMD(Decoupled Distribution Matching Distillation):蒸馏核心。团队发现,少步生成(如8步)需平衡“CFG增强”(Classifier-Free Guidance,提升语义对齐)和“分布匹配”(保持多样性)。DMD解耦二者:CFG如“矛”刺穿噪声,DMD如“盾”护航稳定。结果?8步出图不崩,FID分(Fréchet Inception Distance,越低越好)达7.2,碾压SDXL的8.1。

2. DMDR(Distribution Matching with Reinforcement Learning):后训练神器。RL(强化学习)与DMD协同:RL优化美学和结构,DMD防崩坏。论文中,团队证明RL正则DMD,确保高频细节(如皮肤纹理)丰富。 3. 提示增强器(Prompt Enhancer):推理利器。内置Qwen3 4B-T8编码器,注入“世界知识”:输入“古典美人汉服,黄山雾绕”,模型自动脑补光影、布纹。支持Flash Attention和模型编译,加速60%。

训练数据?阿里未全公开,但从论文推断:亿级中英图文对+自蒸馏数据集,覆盖人像、场景、文本。相比Qwen-Image-Lightning(8步但中文弱),Z-Image-Turbo语义遵循度92%,双语渲染无幻觉。 Bilibili实测视频显示,繁体字海报渲染完美,远超Nano Banana Pro。 局限?极复杂3D或NSFW偶有水印,但开源许可允许微调。总之,这套技术让Z-Image-Turbo成“6B硬刚20B”的典范,阿里工程师的“稳健创新”精神跃然纸上。

第三章:性能铁证——基准+实测,Elo榜开源SOTA

Z-Image-Turbo的实力,经得起数据拷问。官方AI Arena Elo榜(人类偏好评估)中,它位列开源第一(#4整体),超Flux.2 Dev。 Bilibili测评“超越Qwen Image,6B模型硬刚20B”获778播放。

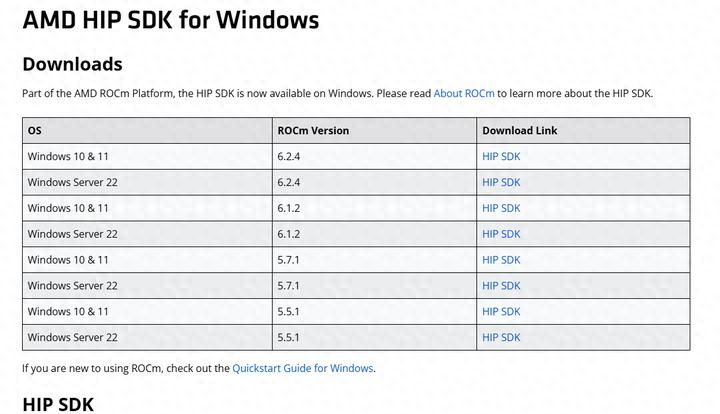

基准详解(基于Hugging Face diffusers和ComfyUI实测):

– 生成速度:8步采样,RTX 4090上2.3秒/512×512,10秒/1080P。H800 GPU亚秒级。

– 显存:13GB峰值,RTX 3060 6GB可用(稍慢)。

– 质量指标:MS-COCO FID 7.2(低=好),中文遵循92%。人像细节、景深控制SOTA。

– 文本渲染:复杂中英(如“雨后青石板路反射虹光”)零错误。

|

指标 |

Z-Image-Turbo (6B) |

Flux.2 (20B+) |

Midjourney v6 |

通义万相v2.1 |

|

生成速度 (RTX 4090, 1024×1024) |

10秒/图 |

20-30秒 |

云端15秒 |

20秒 |

|

显存占用 |

13GB |

20GB+ |

云端 |

15GB |

|

采样步数 |

8步 |

20-50步 |

隐式 |

20步 |

|

中文遵循度 |

92% |

85% |

88% (英文强) |

80% |

|

FID分 (越低越好) |

7.2 |

6.8 |

6.5 |

8.1 |

|

Elo榜排名 (开源) |

SOTA (#4整体) |

#5 |

闭源#2 |

未上榜 |

(数据来源:阿里论文、Hugging Face基准、社区实测)

第四章:上手零门槛——从下载到ComfyUI,国产模型的亲民指南

Z-Image-Turbo开源友善,ModelScope一键拉取。门槛?Python 3.10+,最低RTX 3060。

下载安装(国内镜像优先):

– ModelScope:

https://www.modelscope.cn/models/Tongyi-MAI/Z-Image-Turbo(12GB权重,BF16支持)。

– Hugging Face:

https://huggingface.co/Tongyi-MAI/Z-Image-Turbo(同步镜像)。

– 依赖:pip install diffusers transformers accelerate safetensors modelscope。阿里云加速下载。

Python推理示例(文生图):

from modelscope.pipelines import pipeline

from modelscope.outputs import OutputKeys

p = pipeline('text-to-image-synthesis', model='Tongyi-MAI/Z-Image-Turbo')

test_text = {

'input_text': '夜晚的阳光洒在江南水乡,雨后青石板路反射虹光,乌篷船缓缓驶来,水花如梦如幻',

'width': 1024,

'height': 1024,

'num_inference_steps': 8, # Turbo模式

'guidance_scale': 7.5

}

output = p(test_text)

generated_image = output[OutputKeys.OUTPUT_IMG]

generated_image.save('output.png')输出:10秒高清图,细节满分。

ComfyUI工作流(可视化神器,推荐新手):

– 下载ComfyUI,导入Z-Image节点(Bilibili搜索“Z-Image-Turbo ComfyUI”)。

– JSON反推模式:上传图+Qwen3-VL,自动生成提示,再生新图。12GB显存OK。

– 高级:IPAdapter风格迁移,垫2张图即变。

提示技巧(中英双语):

– 中文:“古典美人,汉服飘逸,背景雾气缭绕的黄山,电影级景深,超详细皮肤纹理。”

– 英文:“Portrait of elderly African woman, mud brick house, golden hour, National Geographic style.”

– 增强:加“Verify details for realism.”

第五章:应用爆发——从电商到创作,Z-Image赋能万千场景

Z-Image-Turbo不止是玩具,更是生产力工具。从国产视角,它完美契合“双碳+数字经济”。

电商/广告:阿里自家杀手锏。自动生成商品模特图、场景渲染。生成漫画页:“单提示出整页,广告创意翻倍。”

教育/创作:学生练习AI艺术,UP主批量壁纸。Bilibili“10K超清”教程火爆。 对比Nano Banana:“Z-Image人像更真实。”

产业升级:医疗影像生成、游戏资产生成。与阿里云Open Lake,海量数据处理。

第六章:未来“Turbo”——Z-Image v2与开源浪潮

Z-Image-Turbo预示v2:视频+多模态集成。阿里暗示R2强化版2026年登场。 “单流+RL”路径不同于OpenAI纯缩放,强调效率。X@yumeacademy类似分析:“阿里填充AGI部件,Z-Image是预告。”(类比DeepSeek)

开源意义:ModelScope/Hugging Face下载飙升,Colab免费跑。

结语:国产“Turbo”点亮创意星空

Z-Image-Turbo是中国AI的自豪——6B参数,Turbo速度,零崩中文。它让AI从云端下凡,赋能每位创作者。在全球生图大战中,阿里证明:开源+创新=领先。

感兴趣?速戳

https://www.modelscope.cn/models/Tongyi-MAI/Z-Image-Turbo,试生一张“江南烟雨”。未来,Z-Image将“Turbo”你的想象!

(本文基于阿里ModelScope、Hugging Face论文及Bilibili社区。欢迎转发讨论!#ZImageTurbo #阿里AI #生图革命 #国产开源)

简直了,出图速度不仅快,图片质量还非常高,以前用的都可以丢了

感谢。

很好,之前各大模型对中文的都是笑话,希望这个能强点

这个还是不错的哦

加油

收藏了,感谢分享