作为一名长期关注AI智能体(Agent)发展的从业者,我曾经也深陷这样的误区:认为智能体的数量越多,系统的性能就越强。就像许多人想的那样,多智能体协作就像人类公司里的不同部门分工配合,你负责策划,我负责执行,他负责审核,各司其职、协同推进,怎么看都比单个智能体“单打独斗”更高效、更强劲。尤其是在AutoGen、LangChain等多智能体框架陆续走红之后,整个行业都掀起了一股“堆叠智能体”的热潮,似乎只要凑齐一群“专家智能体”,就能解决所有复杂任务,“More Agents is All You Need”这句话,也一度成为许多开发者的信条。

但随着智能体技术在实际场景中不断落地,我和身边许多从业者都逐渐发现,多智能体架构的表现并没有想象中那么完美,甚至在许多场景下会适得其反。有时候,我们花费大量精力搭建起复杂的多智能体协作系统,最终的效果反而不如一个简单的单智能体系统稳定高效。这种困惑一直萦绕在我们心头,直到最近谷歌研究团队发布了一篇题为《Towards a science of scaling agent systems: When and why agent systems work》(迈向规模化智能体系统科学:智能体系统何时以及为何有效)的研究论文,才终于为我们解开了谜团,也狠狠打破了“智能体越多越好”的固有认知。

这篇发布于2026年1月28日的论文,由谷歌研究的实习生韩宇彬和资深研究科学家刘欣主导,研究团队通过对180种AI智能体配置的大规模受控评估,推导出了首个针对AI智能体系统的量化扩展原则,不仅揭示了多智能体系统的性能边界,还开发出了一个能精准预测最优架构的模型。看完这篇论文的完整内容和实验数据,我实则并不意外,由于其中的许多结论,都和我们实际落地中的经历高度契合。今天,我就结合这篇论文的核心内容,以及自己对AI智能体行业的观察,和大家好好聊聊,为什么多智能体并非万能,以及我们该如何科学地设计智能体系统。

在聊论文的核心发现之前,我们第一要清楚一个问题:为什么“多智能体越多越好”的误区会在行业内广泛流传?实则,这背后既有直觉上的误导,也有早期研究的片面性。从直觉上来说,我们很容易将人类的协作模式套用在AI智能体上,认为“人多力量大”,多个智能体协作,总能弥补单个智能体的不足,尤其是在面对复杂任务时,分工协作似乎是理所当然的选择。

而在早期的研究中,也有不少成果强化了这种认知。列如之前有一篇题为《More Agents Is All You Need》的研究报告就声称,大语言模型(LLM)的性能会随着智能体数量的增加而不断提升;还有一些关于协作扩展的研究发现,多智能体协作常常能通过集体推理超越单个智能体的表现。这些研究成果,加上多智能体框架Demo带来的视觉冲击,让许多从业者陷入了“盲目堆叠智能体”的怪圈,不管什么任务,都想着搭建多智能体系统,仿佛不这样做,就跟不上行业潮流。

但实际上,这些早期研究大多存在一个共同的问题:它们往往只针对特定的简单任务进行测试,没有思考到实际场景中任务的复杂性和多样性,也没有量化多智能体协作带来的额外成本。而谷歌的这篇论文,最核心的价值就在于,它通过严谨、全面的实验,打破了这种片面认知,让我们看到了多智能体系统的真实面貌——多智能体并非万能药,其性能表现高度依赖于任务的具体特性,盲目增加智能体数量,不仅可能无法提升性能,还会导致效率下降、错误放大,甚至增加落地成本。

要理解这一点,我们第一要看看谷歌研究团队是如何开展这项研究的。不同于早期研究的片面性,这次的研究堪称“全面且严谨”,无论是实验设计、任务选择,还是评估指标,都做到了尽可能的全面和公平,这也是其结论具有说服力的关键所在。

研究团队第一明确了一个核心前提:要搞清楚智能体系统如何扩展,第一要定义什么是“智能体化任务”。在他们看来,真正适合智能体系统处理的任务,必须具备三个核心属性,这也是我们判断一个任务是否适合用智能体处理的重大标准。第一个属性是,需要与外部环境进行持续的多步交互,而不是简单的单次问答;第二个属性是,需要在部分可观察性下进行迭代信息收集,也就是说,任务的信息不是一次性全部给出的,智能体需要逐步探索、收集信息;第三个属性是,需要基于环境反馈进行自适应策略优化,列如智能体在执行任务的过程中,需要根据环境的变化调整自己的行动策略。

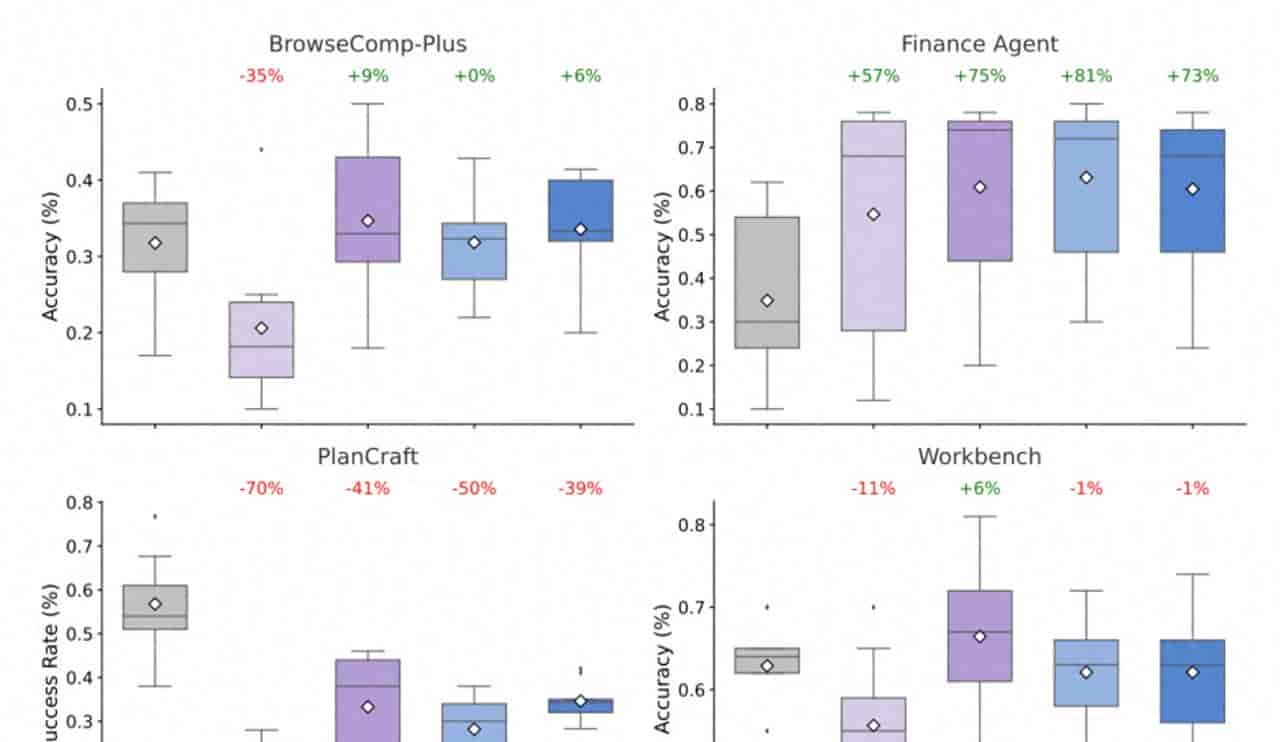

在明确了“智能体化任务”的定义之后,研究团队选择了四种不同类型的基准测试任务,覆盖了实际场景中常见的多种任务类型,分别是Finance-Agent(金融推理任务,列如分析公司的营收趋势、成本结构和市场对比)、BrowseComp-Plus(网页导航任务,模拟人类浏览网页、收集信息的过程)、PlanCraft(规划任务,类似游戏中的资源合成、任务规划,需要严格按照顺序推进)和Workbench(工具使用任务,列如编码智能体需要调用多种工具完成编码工作)。

而在智能体架构方面,研究团队评估了五种典型的架构,涵盖了单智能体和多智能体的主要形态,这样可以更全面地对比不同架构的性能差异。第一种是单智能体系统(SAS),可以理解为“全能独行侠”,一个智能体独自完成所有的推理和行动步骤,拥有统一的记忆流,这种架构的优势是简单直接,没有任何协调开销。第二种是独立多智能体系统(Independent),多个智能体并行处理不同的子任务,彼此之间不进行任何通信,只在任务最后汇总结果,这种架构追求最大程度的并行化,协调开销最低,但缺乏相互校验的机制。

第三种是聚焦式多智能体系统(Centralized),采用“中心辐射”模型,相当于一个“项目经理+员工”的模式,有一个中央协调者(Orchestrator)负责将任务分配给各个工作智能体,然后整合它们的输出结果,这种架构有明确的分工和汇总机制,协调性更强。第四种是去中心化多智能体系统(Decentralized),相当于“圆桌会议”模式,没有中心协调者,各个智能体之间直接通信、共享信息、达成共识,协作更灵活,但协调复杂度更高。第五种是混合式多智能体系统(Hybrid),结合了层级监督和点对点协调,既有中心协调者的控制,又允许智能体之间进行灵活的点对点沟通,是五种架构中功能最丰富的一种。

为了保证实验的公平性,研究团队还做了一个超级关键的设计:控制所有架构的“计算预算”。也就是说,不管是单智能体系统,还是多智能体系统,它们总的Token消耗量是保持一致的。这就意味着,多智能体系统虽然智能体数量多,但每个智能体能使用的Token数量会相应减少,这样就能真正对比出不同架构的效率差异,而不是由于多智能体拥有更多的计算资源而获得优势。此外,研究团队还选用了三种主流的模型家族——OpenAI GPT、Google Gemini和Anthropic Claude,分别对五种架构进行测试,确保实验结果的通用性,避免因模型差异导致结论片面。

正是基于这样严谨、全面的实验设计,研究团队得出了一系列颠覆行业认知的结论,而这些结论,也彻底打破了“多智能体越多越好”的误区。其中,最核心的发现可以概括为一句话:多智能体系统的性能表现,完全取决于任务的结构特性,在可并行任务中能发挥巨大优势,在顺序推理任务中则会大幅失效,同时还会受到工具使用数量和架构可靠性的影响。

第一个核心发现,也是最颠覆认知的一点:任务结构决定多智能体系统的成败,并行任务和顺序任务的表现天差地别。研究团队将这种差异总结为“对齐原则”和“顺序惩罚”,用通俗的话来说,就是多智能体系统在可并行、可拆解的任务中如鱼得水,在需要严格顺序推理的任务中则举步维艰。

在可并行的任务中,列如Finance-Agent的金融推理任务,多智能体系统展现出了惊人的优势。金融推理任务天然具备可拆解的特性,列如分析一家公司的投资价值,我们可以将其拆解为三个独立的子任务:一个智能体专门分析公司的收入趋势,一个智能体专门分析公司的成本结构,还有一个智能体专门做市场对比分析。这些子任务之间互不依赖,完全可以并行推进,不需要频繁沟通协调。

实验数据显示,在这类任务中,聚焦式多智能体系统的表现最佳,相比单智能体系统,性能提升了80.9%。这背后的缘由很简单,聚焦式架构的中央协调者能够合理分配任务,让每个智能体专注于自己擅长的子任务,同时还能对各个智能体的输出结果进行校验和整合,避免出现重复工作或遗漏,从而大幅提升效率。而独立多智能体系统虽然也能实现并行处理,但由于缺乏协调和校验,性能提升幅度不如聚焦式架构。

但在需要严格顺序推理的任务中,情况就完全相反了,这也是研究团队提出的“顺序惩罚”。列如PlanCraft的规划任务,类似游戏中合成一把镐子,必须先收集木材,再制作木棍,最后才能合成镐头,每一步都有严格的先后顺序,不能跳过任何一个步骤,也不能颠倒顺序。这种任务的核心是完整、连贯的推理链条,一旦推理链条被打断,任务就无法顺利完成。

实验结果显示,在这类任务中,所有的多智能体变体都出现了明显的性能下降,降幅在39%到70%之间,也就是说,多智能体系统不仅没有提升性能,反而比单智能体系统差许多。这背后的缘由,实则和我们实际工作中的体验很像:当一个任务需要严格按顺序推进时,过多的沟通协调反而会打断推理链条,消耗大量的“认知预算”。

这里的“认知预算”,我们可以通俗地理解为智能体处理任务的“注意力”或“精力”。单智能体系统拥有完整的认知预算,能够专注于整个推理链条,一步步推进任务;而多智能体系统中,各个智能体之间需要频繁沟通,商量下一步该做什么、谁来做,这些沟通开销会占用大量的认知预算,导致真正留给任务本身推理的预算不足,进而碎片化整个推理过程,出现逻辑断层、步骤遗漏等问题,最终导致任务失败。

列如在PlanCraft的规划任务中,一个多智能体系统可能会出现这样的情况:负责收集木材的智能体还没完成任务,负责制作木棍的智能体就开始催促,双方沟通的过程中,又忘记了任务的先后顺序,最终导致整个规划流程混乱,无法合成镐子。而单智能体系统则不会出现这种问题,它会按照“收集木材—制作木棍—合成镐头”的顺序,一步步专注推进,效率反而更高。

除了任务结构,研究团队还发现了第二个核心问题:工具使用数量会成为多智能体系统的瓶颈,这就是“工具协调权衡”。简单来说,任务需要调用的工具越多,协调多个智能体的“管理费”就越高,当工具数量超过必定阈值时,多智能体系统的效率会大幅下降,甚至不如单智能体系统。

在Workbench的工具使用任务中,研究团队做了一个对比测试:当任务需要调用的工具数量较少(列如5个以下)时,多智能体系统和单智能体系统的性能差异不大,甚至多智能体系统能通过分工协作略微提升效率;但当工具数量增加到16个以上时,多智能体系统的协调成本就会不成比例地增加,性能开始大幅下降。

这背后的缘由很容易理解:当任务需要调用的工具较少时,智能体之间的协调工作相对简单,不需要花费太多精力商量“谁用什么工具”“什么时候用工具”;但当工具数量增多,尤其是超过16个时,协调工作会变得异常复杂。多个智能体需要频繁沟通,确认每个工具的使用权限、使用顺序,甚至会出现多个智能体争抢同一个工具、重复调用同一个工具的情况,这些都属于协调的“管理费”。

更关键的是,这些协调成本会占用大量的计算资源和认知预算,导致智能体无法专注于任务本身,进而影响任务的执行效率。列如一个编码智能体系统,需要调用代码编辑器、调试工具、数据库查询工具、文档生成工具等16个以上的工具,多智能体系统需要协调各个智能体分别负责不同的工具调用,沟通成本会超级高;而单智能体系统虽然需要独自完成所有工具的调用,但不需要任何协调成本,反而能更高效地推进任务。

研究团队还发现了一个有趣的现象:当基座模型的能力足够强时,多智能体系统反而会出现“能力饱和”,也就是“机智人不需要委员会”。具体来说,如果单个智能体的成功率已经超过45%,说明基座模型的能力已经能够很好地应对当前任务,这时候再引入多智能体协作,不仅无法提升性能,反而会由于协调开销和沟通噪音,导致性能下降。

这一点在实际落地中超级有指导意义。许多从业者误以为,只要增加智能体的数量,就能弥补基座模型的不足,但实际上,当基座模型的能力不够时,即使增加再多的智能体,也无法从根本上解决问题,反而会增加协调成本;而当基座模型的能力足够强时,盲目增加智能体,只会画蛇添足。这也提醒我们,在设计智能体系统时,不能只关注智能体的数量,更要注重基座模型的能力,以及智能体数量与基座模型能力的匹配度。

除了性能表现,研究团队还关注了一个对实际落地至关重大的问题:架构与可靠性的关系,这也是许多从业者在落地过程中容易忽略的一点。对于实际应用来说,智能体系统的可靠性往往比极致的性能更重大,一旦出现错误,可能会造成巨大的损失,而不同的智能体架构,其错误放大率有着天壤之别。

研究团队引入了“错误放大率”这个指标,用来衡量单个智能体的错误传播到最终结果的速率。实验数据显示,不同架构的错误放大率差异超级大:独立多智能体系统的错误放大率高达17.2倍,也就是说,一个智能体出现的小错误,经过无约束的传播,最终会被放大17.2倍,导致整个系统的结果出现严重偏差;而聚焦式多智能体系统的错误放大率仅为4.4倍,能够有效控制错误的传播。

为什么会出现这样的差异?核心缘由就在于是否有错误校验机制。独立多智能体系统中,各个智能体之间不进行任何通信,也不相互校验工作成果,一旦某个智能体出现错误,这个错误会一直保留,直到任务结束汇总结果时才会被发现,但此时错误已经无法挽回,甚至会影响其他智能体的结果汇总,导致错误滚雪球式放大。

而聚焦式多智能体系统中,中央协调者起到了“验证瓶颈”的作用,它会在分配任务的同时,对各个智能体的输出结果进行校验和审核,一旦发现某个智能体出现错误,会及时纠正,避免错误传播到下一步。列如在金融推理任务中,一个智能体分析收入趋势时出现了数据错误,中央协调者在整合结果时会发现这个错误,并要求该智能体重新分析,从而避免错误影响整个投资分析结论。

这一点对实际落地的启示超级大。列如在金融风控、医疗诊断等对可靠性要求极高的场景中,我们绝对不能使用独立多智能体系统,否则一个小小的错误,可能会导致巨大的经济损失或医疗事故;而应该选择聚焦式多智能体系统,通过中央协调者的校验机制,控制错误放大,提升系统的可靠性。即使在对可靠性要求不那么高的场景中,也应该思考加入错误校验机制,避免错误无限放大。

如果说以上这些发现,是帮我们认清了多智能体系统的“真面目”,打破了固有误区,那么研究团队开发的预测模型,则是给我们提供了一套“实用工具”,让我们能够科学地设计智能体系统,摆脱对经验的依赖。

在过去,我们设计智能体系统时,往往依赖于个人经验和直觉,列如“这个任务看起来很复杂,应该用多智能体系统”“聚焦式架构好像更稳定,就用它了”,这种设计方式超级盲目,很容易导致系统性能不佳、落地失败。而谷歌研究团队开发的这个预测模型,彻底改变了这种局面,它让智能体设计从“经验主义”走向了“定量科学”。

这个预测模型的核心逻辑超级简单:它通过分析任务的两个关键属性——顺序依赖性和工具密度,来预测哪种智能体架构的表现最佳。其中,顺序依赖性指的是任务需要严格按顺序推理的程度,顺序依赖性越高,越不适合用多智能体系统;工具密度指的是任务需要调用的工具数量,工具密度越高,多智能体系统的协调成本就越高。

实验数据显示,这个预测模型的拟合度R²达到了0.513,能够在87%的情况下,准确识别出 unseen 任务(未见过的任务)的最优架构。也就是说,只要我们输入任务的顺序依赖性和工具密度这两个关键参数,模型就能告知我们,这个任务适合用单智能体系统,还是多智能体系统,以及适合用哪种多智能体架构,准确率高达87%。

举个例子,当我们要设计一个金融推理任务的智能体系统时,第一分析任务属性:金融推理任务的顺序依赖性较低,工具密度也较低(一般只需要调用数据查询、数据分析等少数几种工具),根据预测模型,这种任务的最优架构是聚焦式多智能体系统,这和我们之前的实验结果完全一致;而当我们要设计一个规划任务的智能体系统时,任务的顺序依赖性很高,工具密度较低,模型会推荐我们使用单智能体系统,避免多智能体系统的“顺序惩罚”;如果我们要设计一个需要调用16个以上工具的编码任务智能体系统,工具密度很高,顺序依赖性中等,模型会推荐我们使用去中心化多智能体系统,由于去中心化架构在工具密集型任务中,协调灵活性更高,能够在必定程度上降低协调成本。

这个预测模型的价值,不仅在于提升了智能体系统的设计效率,降低了设计成本,更在于它让智能体系统的落地变得更加可控。我们不再需要花费大量精力去测试不同的架构,也不再需要担心由于设计失误导致系统性能不佳,只需要根据任务属性,借助模型就能做出科学的设计决策。尤其是对于那些缺乏丰富经验的从业者来说,这个预测模型更是一个“救命稻草”,能够协助他们快速上手,设计出高性能、高可靠的智能体系统。

看完谷歌这篇论文的所有内容,结合我自己在实际落地中的经历,我最大的感受是:AI智能体行业,正在从“盲目追逐潮流”走向“理性落地”。在过去的一两年里,多智能体框架层出不穷,各种Demo让人眼花缭乱,许多从业者陷入了“为了做多智能体而做多智能体”的怪圈,忽略了任务的实际需求和系统的落地价值。而谷歌的这篇论文,就像一盆“冷水”,浇醒了那些盲目跟风的从业者,也为整个行业指明了未来的发展方向。

总结一下这篇论文的核心观点,实则可以凝练为一句话:更智能的模型不会取代多智能体系统的需求,它们会加速多智能体系统的发展,但这一切的前提是,我们必须选对架构,让架构与任务特性相匹配。多智能体并非万能,单智能体也并非落后,没有最好的架构,只有最适合任务的架构。

结合论文的发现和实际落地经验,我也想给正在设计智能体系统的从业者,提几点实用提议,希望能协助大家少走弯路。

第一,先分析任务属性,再决定是否使用多智能体系统。在设计智能体系统之前,不要盲目决定用单智能体还是多智能体,先仔细分析任务的两个关键属性:顺序依赖性和工具密度。如果任务顺序依赖性低、工具密度低,列如金融推理、简单数据汇总等,适合用聚焦式多智能体系统,能够通过分工协作提升效率;如果任务顺序依赖性高,列如规划、复杂逻辑推理等,适合用单智能体系统,避免多智能体的“顺序惩罚”;如果任务工具密度高,列如需要调用16个以上工具的编码、复杂数据处理等,提议慎用多智能体系统,若必须使用,可选择去中心化多智能体系统,提升协调灵活性。

第二,根据基座模型能力,调整智能体数量。不要盲目堆叠智能体数量,当基座模型的能力足够强(单智能体成功率>45%)时,尽量使用单智能体系统,避免“能力饱和”带来的负收益;当基座模型能力不足,单智能体无法很好地完成任务时,再思考引入多智能体协作,但也要控制智能体数量,优先保证协调效率,而不是数量越多越好。

第三,根据可靠性需求,选择合适的架构。在对可靠性要求高的场景(金融风控、医疗诊断、工业控制等),优先选择聚焦式多智能体系统,通过中央协调者的校验机制,控制错误放大;在对可靠性要求不高、追求灵活协作的场景(列如创意生成、简单客服),可以选择去中心化或混合式多智能体系统;尽量避免使用独立多智能体系统,尤其是在关键场景中,防止错误无限放大。

第四,借助预测模型,提升设计效率。如果没有丰富的设计经验,可以借助谷歌研究团队开发的这种预测模型,输入任务的顺序依赖性和工具密度,快速确定最优架构,减少测试成本,提升系统设计的成功率。如果无法直接使用该模型,也可以参考模型的核心逻辑,根据任务属性自主判断。

第五,重点关注协调成本和错误校验,不要只追求性能。在设计多智能体系统时,不要只关注性能提升,还要重点关注协调成本和错误校验。可以通过简化协调流程、明确分工、加入错误校验机制等方式,降低协调成本,控制错误放大,提升系统的稳定性和效率。列如在聚焦式架构中,优化中央协调者的任务分配和结果校验逻辑;在去中心化架构中,建立简单的沟通规则,避免无效沟通。

最后,我想聊聊对AI智能体行业未来发展的展望。随着Gemini、GPT-5等基础模型的不断进步,智能体系统的能力会不断提升,但这并不意味着我们要一味追求更复杂的多智能体架构。相反,未来的智能体设计,会更加注重“精准匹配”,即架构与任务的匹配、智能体数量与模型能力的匹配、系统设计与实际需求的匹配。

谷歌的这篇论文,不仅打破了行业误区,更建立了智能体扩展的量化原则,为整个行业的发展奠定了基础。未来,会有更多的研究围绕“智能体架构设计”展开,会有更精准的预测模型、更高效的协调机制、更可靠的错误控制方法出现,让智能体系统能够真正落地到更多场景中,赋能金融、医疗、工业、生活等各个领域。

作为从业者,我们也应该摆脱“盲目跟风”的心态,理性看待多智能体系统的价值,专注于任务需求,科学设计智能体架构,让智能体系统不仅“数量多”,更“质量高”;不仅“功能全”,更“效率高、可靠性强”。只有这样,我们才能真正发挥AI智能体的价值,推动整个行业健康、可持续发展。

说到底,AI智能体的核心价值,是协助我们解决实际问题,提升效率、降低成本,而不是追求“高大上”的架构和数量。多智能体并非万能,选对架构、贴合需求,才是智能体系统落地成功的关键。谷歌的这篇研究论文,不仅给我们上了生动的一课,也为我们指明了未来的方向,期待在不久的将来,能看到更多贴合需求、高效可靠的智能体系统,走进我们的生活和工作,真正改变世界。

相关文章