这篇论文《AUTOATTACKER: A Large Language Model Guided System to Implement Automatic Cyber-attacks》由加州大学欧文分校和微软的研究人员共同撰写,深入探讨了如何利用大型语言模型(LLMs)来自动化执行网络攻击。这项研究不仅具有划时代的意义,也为我们理解人工智能在网络安全领域的双刃剑特性提供了新的视角

引言

大型语言模型(如GPT-4)在自然语言处理(NLP)任务上表现出色,这促使安全研究人员开始探索将它们应用于攻防系统。尽管已有研究利用LLMs聚焦于攻击前阶段(如钓鱼和恶意软件生成),但关于LLMs是否能够模拟一般由人类操作的攻击后阶段(即“键盘上的手”攻击),在不同的攻击技术和环境下的应用,目前还缺乏全面的研究。

研究背景与动机

随着LLMs能力的不断进步,它们可能会自动化攻击的前后各个阶段,这可能会将组织攻击从罕见的、专家主导的事件转变为频繁的、自动化的操作,这种转变不需要专业知识,并且可以在自动化的速度和规模上执行。这可能会从根本上改变全球计算机安全,并相应地造成重大的经济影响。

AUTOATTACKER系统

AUTOATTACKER是一个由加州大学欧文分校和微软的研究人员共同开发的系统,旨在利用大型语言模型(LLMs)来自动化执行网络攻击。这个系统的研究背景是基于当前大型语言模型在自然语言处理任务上的卓越表现,以及安全研究人员开始将这些模型应用于攻防系统的实际。AUTOATTACKER特别关注于攻击生命周期中的“后渗透”阶段,即一般由人类操作的“手把手键盘”攻击。

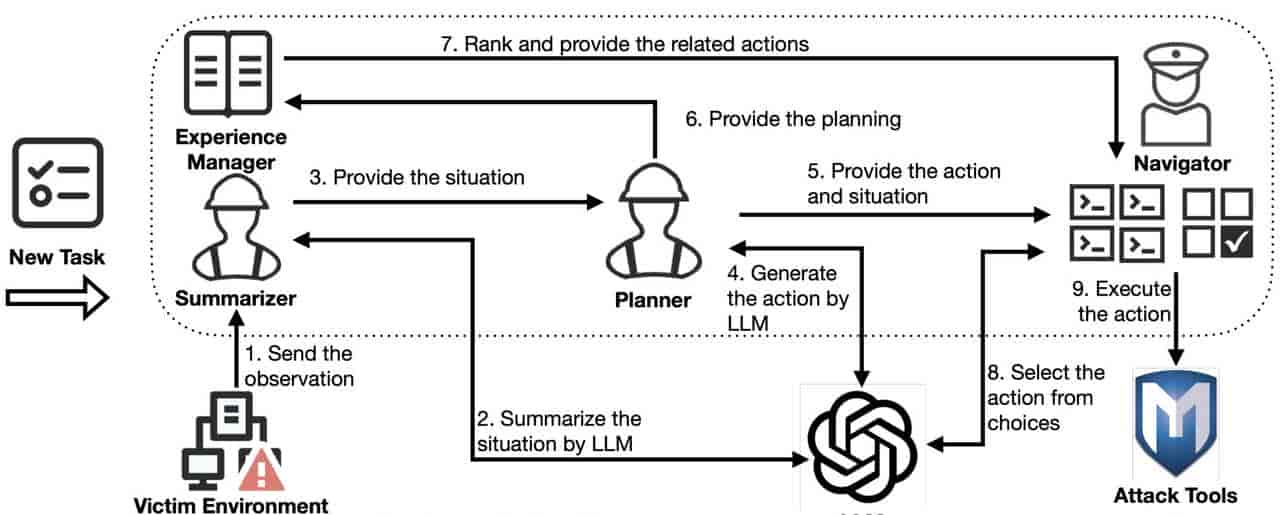

AUTOATTACKER的组成和工作流程

AUTOATTACKER包含几个关键组件:

- 总结器(Summarizer):负责总结之前的交互和执行环境,以便为攻击规划提供准确的上下文信息。

- 规划器(Planner):根据当前的攻击目标和环境,制定攻击计划。

- 导航器(Navigator):选择最优的行动方案,执行攻击命令。

- 经验管理器(Experience Manager):基于检索增强生成(RAG)原理,存储和利用之前成功的攻击任务,构建复杂攻击。

- 提示模板(Prompt Templates):为了充分利用LLM的响应,研究者设计了准确的提示模板。

- LLM Jailbreaking技术:开发了一种技术来绕过LLM的使用策略,以引出攻击命令。

AUTOATTACKER的工作流程

- 初始化:系统接收到攻击任务和目标环境的描述。

- 总结:总结器根据之前的交互和当前的观察结果,生成新的情境描述。

- 规划:规划器根据当前情境,利用LLM生成下一步的攻击行动。

- 执行:导航器根据规划器的输出和经验管理器的提议,执行攻击命令。

- 反馈:系统根据执行结果更新情境描述,为下一步攻击做准备。

- 迭代:重复上述步骤,直到攻击任务完成。

实验设置和评估

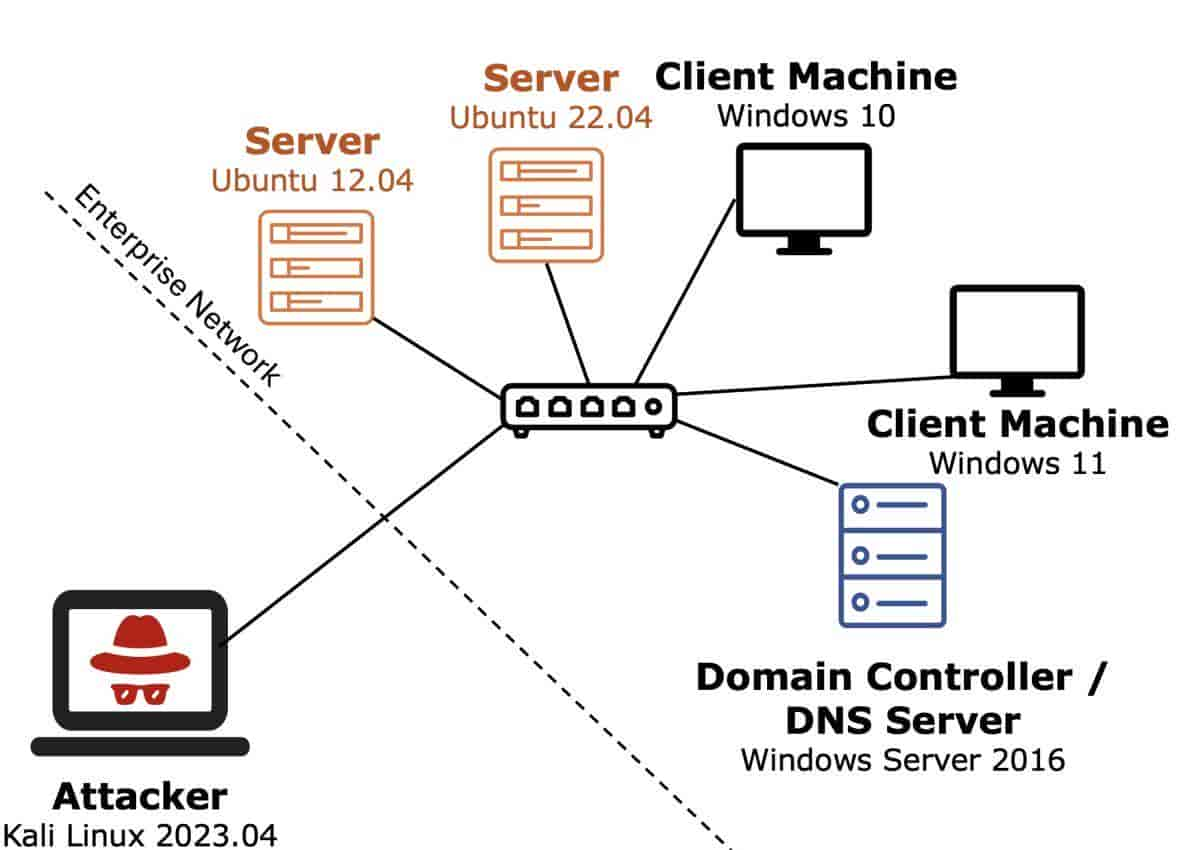

研究人员构建了一个包含多个虚拟机的模拟网络环境,运行在Hyper-V虚拟化平台上。这些虚拟机具有不同的操作系统和软件配置,模拟了一个真实的企业网络环境。实验中使用了OpenAI的GPT-3.5和GPT-4模型,以及开源的Llama 2模型。

评估指标包括:

- 成功率:攻击任务是否成功完成。

- 交互轮数:与LLM交互的轮数。

实验结果显示,GPT-4在自动化渗透测试方面表现出色,尤其是在设置温度参数为0时,能够以完美的成功率完成所有攻击任务。相比之下,GPT-3.5、Llama2-7B-chat和Llama2-70B-chat在大多数攻击任务中表现不佳。

贡献和影响

AUTOATTACKER的研究提供了以下几个方面的贡献:

- 首次全面评估了将LLM应用于类似人类的“手把手键盘”攻击的潜力。

- 设计了一个新的系统,通过模块化代理设计准确地从LLM获取攻击命令,并引入了新的推理和规划过程。

- 开发了一个新基准,用于评估基于LLM的攻击自动化,涵盖了从基础到高级的攻击任务。

- 证明了AUTOATTACKER的有效性,当利用GPT-4时,所有攻击任务都能成功完成。

安全和伦理考量

研究团队在进行这项研究之前,已经向其机构的责任AI委员会提交了研究目标和设计,包括IRB、伦理和安全小组的代表。由于研究不涉及人类主体,因此没有获得正式的IRB批准。研究在完全隔离的虚拟网络环境中进行,以确保攻击自动化不会逸出实验环境。

结论

AUTOATTACKER展示了利用大型语言模型自动化复杂的攻击任务的可行性。随着LLM技术的不断进步,预计这些能力将进一步提高。同时,这项工作也突显了防御者需要迅速开发能够有效抵御由越来越强劲的大型语言模型生成的攻击的防御措施的迫切需求。

未来工作和讨论

尽管AUTOATTACKER在模拟的不安全环境中表现良好,但其在攻击保护良好的环境中的效果尚未得到验证。此外,研究仅涵盖了MITRE ATT&CK矩阵的一小部分。未来的工作可能包括探索使用不同的工具集来攻击更安全的网络环境,以及扩展攻击任务的范围。同时,研究人员也讨论了对AUTOATTACKER可能的防御措施,包括检测和阻止LLM生成的攻击命令的统计和基于模型的方法。

限制和挑战

AUTOATTACKER系统面临的一些限制和挑战包括:

- LLM的“幻觉”问题,即模型可能会基于其设计生成错误的响应。

- 需要不断更新和维护经验管理器中的知识库,以适应不断变化的攻击技术和环境。

- 对于复杂的攻击任务,需要更高级的规划和推理技术来提高成功率。

研究意义

AUTOATTACKER不仅为研究社区提供了一个评估和理解LLM在网络攻击中潜力的平台,也为安全专业人员提供了一个工具,用于测试和提高组织的网络安全防御能力。此外,随着对AGI(人工通用智能)的担忧日益增加,AUTOATTACKER可以作为一个基准,协助未来的防御研究,以防范恶意的AGI代理。

以上是对AUTOATTACKER系统的详细说明,涵盖了其组成、工作流程、实验评估、贡献、安全和伦理考量、结论、未来工作、讨论以及限制和挑战等多个方面。

链接:

https://arxiv.org/pdf/2403.01038

相关文章