阿尼尔·塞斯

Anil Seth

萨塞克斯大学(University of Sussex)认知与计算神经科学教授意识科学研究中心主任 曾发表研究论文逾200篇,连续多年被Web of Science评为全球顶尖0.1%的研究者。著作《意识机器:成为你自己》(Being You: A New Science of Consciousness)出版即登上《星期日泰晤士报》畅销书榜,并被多家媒体评为年度好书。

几百年来,人们梦想自己能够扮演上帝的角色,去创造真实人类的人工版本。每一次突破性的新技术浪潮的到来,都会一次次引燃这个梦想,而这一次人工智能(AI)带来的浪潮尤其巨大。至少从某些方面来讲,目前我们周围的AI系统,已经算得上具有了智能。我们可以肯定,它们还会变得越来越智能。但问题是,它们具有,或可能具有意识吗?

人工意识这个想法,历史虽悠久,却不怎么美好。从犹太神话里的泥人约瑟利,到玛丽·雪莱的弗兰肯斯坦、斯坦利·库布里克《2001太空漫游》里的电脑HAL、亚历克斯·加兰的《机械姬》,以及石黑一雄《克拉拉与太阳》里的机器人克拉拉,人类文化没完没了痴迷于对人工身体与合成心灵的创造——这些被造出来的东西不仅能够思考,而且有所感受。不过,至少对于牵涉其中的人类而言,事情的进展往往没有那么顺利。如果按照目前的道路发展下去,人工智能可以具有真正的意识,那么,大量麻烦的问题就会一涌而出。

有人认为我们已经做到了。2022年接受《华盛顿邮报》采访时,谷歌工程师布莱克·勒莫因(Blake Lemoine)就他当时正在研究的AI系统(一个名叫LaMDA的聊天机器人)做出了一个惊人断言,他说这个机器人具有意识,拥有感受,并且在很重大的意义上,就像是一个真正的人。 1 尽管媒体对此争相报道,勒莫因的说法却并未受到严肃对待。谷歌随后以违反公司保密政策为由,将他解雇了。但AI的车轮却依旧滚滚向前。

但是勒莫因提出的问题并未消失。由于一个人违反了保密政策而解雇他,不意味着他说的就是错的。随着AI技术不断提升,机器意识这一问题浮现的频率越来越高。该领域里最前卫的思想者大卫·查默斯(David Chalmers)认为,有意识的机器在不太远的将来就可能出现(文献1)。AI先驱、诺贝尔奖获得者杰弗里·辛顿(Geoffrey Hinton)甚至认为,这已经实现了。22024年末,一群知名学者发表了一篇广为流传的文章,认为有必要严肃对待AI系统的福利问题(文献2)。对于包括AI专家与神经科学家在内的许多人而言,目前的问题在于机器意识何时出现,而非能否出现。

我们如何看待有意识的人工智能的前景至关重大。这对于AI系统自身而言是重大的,由于意识赋予了它们道德地位。这对我们人类也很重大。如果我们真的觉得我们的AI伴侣能够感知一些事情,那么我们心理上的脆弱性就可能会被利用,我们伦理上的轻重缓急也会被扭曲。如果我们像对待无感觉事物那样对待看起来有意识的机器,那么我们自己的心灵也会变得残忍。

或许更重大的一点在于,对于AI意识的思考,会影响我们对于人性的理解,以及我们对于意识经验之本性的理解;而生命之所以值得一过,恰恰是由于我们拥有意识经验。如果我们轻易地把自己臣服于被我们创造的机器,那么在高估了机器的同时,我们也低估了自己。

认为AI有意识的几个诱因

我们究竟为何要开始思考“AI是否可能有意识”这个呢?毕竟,计算机与生物有机体截然不同。而在目前关于意识为数不多的共识里,就包括这样一个主张:意识的载体是肉体,而不是金属。

我们认为AI可能有意识的第一个理由,来自我们的心理结构。作为人类,我们知道自己是有意识的,且我们乐于信任我们也是有智能的。因此,我们自不过然认为,智能与意识这两个东西往往一起出现。但是,二者仅仅在我们身上一起出现,不代表它们总是如此。

智能与意识是不同的事物。智能主要围绕的是“做事”(doing):解决字谜、组装家具、应对棘手的家庭状况、步行去商店——这些都涉及某种类型的智能行为。关于智能的一个有用的通行定义如下:智能指的是通过灵活的手段完成复杂目标的一种能力。当然还有许多其他定义,但它们都会强调一个系统的功能性能力:一种将特定输入转化为特定输出的能力,把事做成!

因此,一个人工智能系统的好坏,就取决于其完成某种智能行为的能力,尽管这里的行为不仅限于类人的形式。相比之下,通用人工智能(AGI)的概念里,的确 明确了以整体的人为参考对象。AGI的目标在于,完全匹配甚至超越人类的认知能力(文献3)。(还有另一个概念——超级人工智能(ASI),即当AI自身进化到一种超出我们的理解并且失控时产生的现象。这种超级智能往往在我们各类未来世界中,伴随着更为严峻的存在境况而横空出世。)

与智能不同,意识主要围绕的是“存在”(being)。半个世纪以前,哲学家托马斯·内格尔(Thomas Nagel)便提出了一个著名的观点:“一个有机体具有有意识的心灵状态,当且仅当存在某种东西能够解释‘作为那个有机体是什么样子’(what it is like to be that organism)”(文献4)。意识恰恰是正常的清醒状态与深度的昏迷状态之间的差异。大脑功能,尤其是知觉(如颜色、形状、味觉、情绪与思想等等)具有体验性的一面,而正是这个侧面赋予了我们的生命以质感与意义,如晴朗天空的蔚蓝色,第一口咖啡的苦涩滋味与刺激感等等。

AI系统在某种程度上的确 具备某种形式的智能,由于它们显然能够做一些事情,但是要说有“作为ChatGPT的样子”这回事,就难说得多了。

人们之所以倾向于将智能与意识绑定,可以追溯于三种内置的心理偏见:第一种偏见是人类中心主义。我们倾向于透过人类的视角看待事物——将人类的情况当作是标准的典范,而不仅仅是多样的属性组合在一起的一个具体例子。第二种偏见是人类例外主义。很不幸,我们习惯于将人类物种放置于各类序列的顶端,有时候甚至将其归入完全不同的一个序列(如中世纪的自然阶梯观所说,与其他各类动物相比,我们可能更加接近神与天使)。第三种偏见是拟人主义。这是指,仅从一些表浅的类似性出发,将人类特质投射在非人类事物上的倾向。

将这些偏见放在一起思考,我们要解释的事情就不奇怪了:当事物展现出我们认为具有典型人类特征的能力(列如智能)的时候,我们会自不过然将我们觉得独属于人类的其他典型特质,列如理解、心灵与意识,也投射到那些事物上。

在诱惑我们产生误导性的直觉这一点上,语言这种智能行为显得特别有效。这大致是由于语言是人类例外主义的一个基石。(在特定的立场看来,至少就我们目前所知,尤其是与其他动物相比,人类语言的确 看起来体现了不同的秩序。)如OpenAI的ChatGPT或Anthropic的Claude等大语言模型(LLMs),已经成为人工意识研究热潮里的主要焦点。据我所知,没有人主张DeepMind的AlphaFold是有意识的,尽管它在底层机制上与LLM超级类似。所有这些系统都在硅基上运行,它们都含有人工神经网络,以及其他激动人心的算法创新,列如Transformer。由于AlphaFold的主要领域是预测蛋白质的结构,而不是语言,因此它无法像其他热门模型那样,触动我们的心弦。

我们自己使用的语言也很关键。试想当大语言模型生成了错误信息的时候,我们会超级自然地说它产生了“幻觉”。人类所具有的幻觉主要是一种有意识的体验,只不过它没有与现实建立稳健的连接(有人称之为“不受控的知觉”)。当我们听到不存在的声音时,当我们眼前浮现出逝去亲人站在床脚时,我们就处于幻觉状态。当我们说AI系统有“幻觉”时,我们已隐隐地赋予其一种拥有体验的能力。如果非要类比于人,说它们在“瞎扯”(confabulate)或许准确得多。对人而言,瞎扯就意味着编造一些东西,却没有意识到自己是在胡编乱造。这里涉及的主要是“做”,而不是“体验”。

当我们将意识体验与据说独属于人的属性(如智能或语言)相等同时,在意识明明不存在的地方,我们更容易觉得自己找到了意识;而在意识的确存在的地方,反而会错过它。可以肯定,我们不应简单地预设,随着AI越来越智能(机智),意识必定会随之而来。如果你听到有人说真正的人工意识会在AGI发展的某一个临界点突然涌现出来,那肯定是人类例外主义在作祟。

也有其他偏见在起作用。一种有力的观点认为,AI里的一切都在经历指数级的变化。无论是摩尔定律衡量的原始算力,还是每次大型科技基础模型迭代带来的新功能,技术的变化的确 超级快速。指数级的增长动摇了我们心理上的安全感,让我们觉得我们曲线前方的图景总是更加陡峭,而过去的发展显得稀松平常。关键在于,不论你在曲线的哪一个位置,情况一直是这样——这就是指数级增长的本质。恰恰是由于这个特点,我们的心理总倾向于去信任自己正处在重大转变的拐点上——而有什么转变能比创造出真正的人工意识更加“重大”呢?但是,在一条指数曲线上,每个点都是转折点。3

最后,技术狂热主义也颇具诱惑性。在电影《机械姬》开头,程序员凯勒对发明家内森说:“如果你创造出了有意识的机器,那不是人类的历史,而是造物主的历史。”如果我们感觉我们身处一个技术-历史的拐点,且我们恰巧是其中的一位建筑师,那么,那种普罗米修斯式的诱惑——那种给人类带去曾经只属于天国之物的感觉——必定是极难抵御的。随着奇点的到来,那种狂喜带来的标志性成果就是永生——承诺我们可以逃离日渐腐朽的生物性身体并永远活下去(或至少是存在下去),在硅基云端达到永恒。这或许解释了这套“机器意识即将到来”的宣言为什么在技术圈内,而不是圈外更加流行。

学者亚当·别克(Adam Becker,文献5)将这种把意识投射给AI的倾向描述为一种幻想性视错觉(pareidolia)——一种在事物中看出特定模式的现象,列如从一片吐司里看出一张脸,或者在一个肉桂面包里看到特蕾莎修女等(图1)。这是一个贴切的描述。但是,承认我们具有引发视错觉的心理偏见仅仅是第一步。为了处理真正的人工意识到底是否可能这个问题,我们需要更深入的探索。

▷ 图1: 肉桂面包里的特蕾莎修女

意识与计算

“有意识的人工智能”这个想法,预设了意识是一种计算或“信息处理”。更具体而言,它预设了只要提供某种恰当类型的计算,就足以让意识从中产生。这一预设被哲学家称为计算功能主义(computational functionalism,文献6)。该预设处于理论超级底层的位置,以至于要意识到这个预设本身就很难。但这个预设就是计算功能主义,实际就是如此。如果如我所认为的那样,这个预设错了,那么真正的人工意识根本无从谈起,至少对于我们熟悉的AI形态而言就是这样。

要挑战计算功能主义,就要深入讨论什么是“计算”,并理解对于一个计算机或大脑这样的物理系统而言,“做计算”到底是什么意思。根据那个预设,计算(至少是我们熟悉的那种计算)对于意识是充分的。接下来,我将概述四种相关的直觉,来动摇上述预设。

直觉1:大脑不是计算机

第一也是最重大的是,大脑不是计算机。大脑是一个碳基计算机这个隐喻,影响巨大,并且看起来很有吸引力:心灵是软件,大脑是硬件(文献7)。这个隐喻产生了许多丰硕的成果,它为我们理解大脑的功能提供了许多洞见,也启迪了当今大部分AI。为了理解这个隐喻的深刻影响并发现其局限,我们回到早期的计算机科学与神经生物学,重访那些先驱们的思想。

这个故事里的巨人,非阿兰·图灵(Alan Turing)莫属。早在20世纪50年代,他就萌生了机器可能具有智能的想法(文献8)。这比他提出关于计算的正式定义还要早十几年,他提出的定义后来成了我们技术的基础,并定义了后世所理解的计算机(文献9)。

图灵对于计算的定义是极其有力且高度普适的(尽管我们将看到,也不是完全普适)。它涉及的是将一个数集映射到另一个数集——换句话说就是一种算法。我正在使用的笔记本电脑,以及运行最新AI模型的服务器,都奠基于“通用图灵机”这个抽象概念之上。“通用图灵机”指的是,一个原则上能够运行任何算法的系统。这种满足通用目的的能力,是图灵计算强劲且无处不在的一个缘由。

这个概念从实际的工程学角度来说,还有另一个主要优点,即它可以用来清晰地区分软件与硬件。图灵计算——算法——应当做同样的事情,与具体在什么计算机上运行无关。图灵计算原则上独立于具体基质,它不依赖于任何具体的物质材料。(实践来说,图灵计算最好被描述为具有必定的基质“灵活性”,但你并不能从随意任何材料里建构出一台可用的计算机,列如奶酪就无法胜任。)图灵计算的这一特质使得它在实践中超级有用,这就是为什么计算机可以出目前手机上,而不仅仅存在于我们的心灵中。

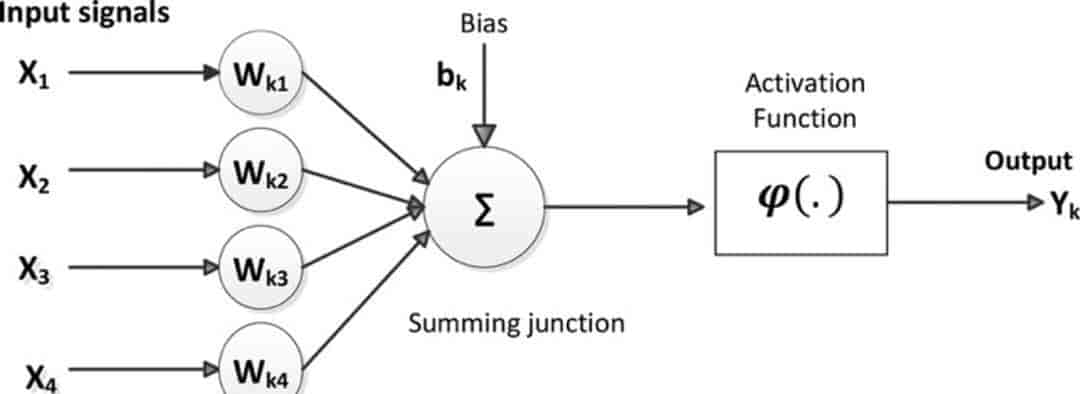

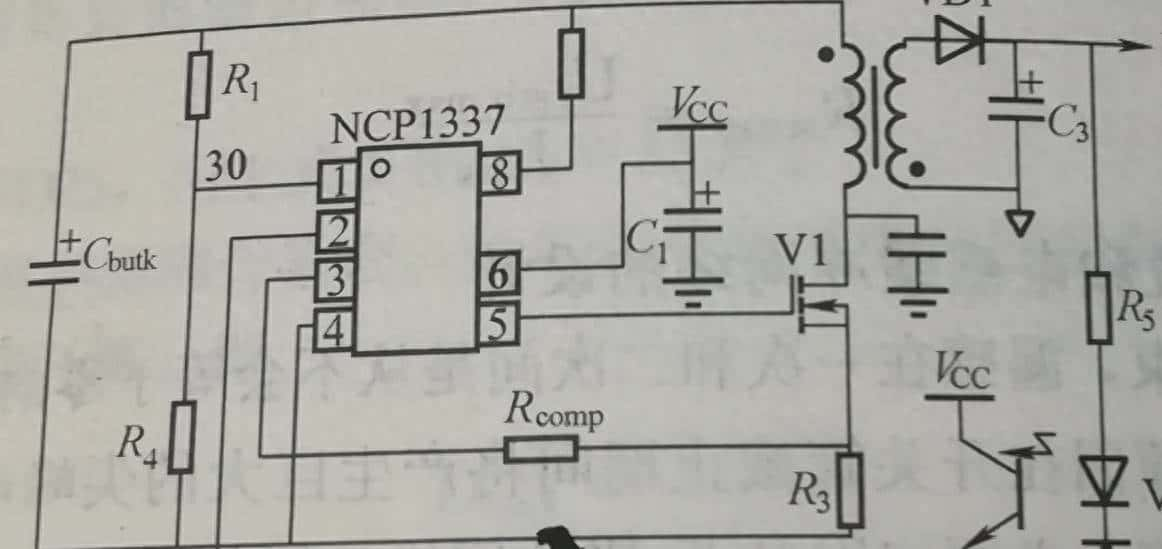

就在图灵留下其历史印记的同一时期,神经生物学家沃尔特·皮茨(Walter Pitts)和沃伦·麦卡洛克(Warren McCulloch)在一篇具有里程碑意义的论文中指出,由高度简化、抽象的“神经元”组成的网络可以进行逻辑操作(文献10,图2)。学者S. C. 克莱尼(S. C. Kleene)后来证明,这些人工神经网络具有“图灵完备性”(Turing complete),即它们理论上可以实现任何图灵计算与算法(文献11)。

▷ 图2:麦卡洛克-皮茨网络。输入信号X1-X4,乘以权重w,和一个偏差量(另一个输入)一起求和,然后经过一个激活函数,一般是某种Sigmoid函数(‘S’形曲线),最终得到输出Y。

把这些想法合在一起,我们就获得了在数学上兼具便捷性、有效性、简单性以及美感的“强强联姻”。一方面,我们可以忽略复杂的关于大脑的神经生物学,只把它当作简化的抽象神经网络,每个神经元只是整合输入然后再输出。另一方面,这样可以使得我们获得图灵计算能够提供的一切——而这本身已经足够了。

这种强强联姻的好处,清楚体目前了它所生的孩子们身上——如今AI驱动的那些人工神经网络。它们直接继承了麦卡洛克、皮茨与克莱尼的遗产,同时也具有图灵意义上的基质灵活性。因此毫不令人意外,“大脑无非就是神经网络算法的碳基版本”这一想法,通过目前AI浪潮所带来的种种令人印象深刻的诱惑,而被不断地强化。

但这里就开始有麻烦了。当我们观察大脑内部的时候,并没有发现类似于软件与硬件的、所谓“心件”(mindware)与“湿件”(wetware)的明显区分。我们对于生物大脑的复杂性了解越多,就越会发现,里面的丰富性与动态性远超无生命的一堆硅。

大脑活动模式的演化,发生在多个空间与时间尺度上——从大规模的皮层区域,到神经递质和神经回路的细枝末节——所有这些,都与分子层面的激烈的代谢活动深度交织在一起。即使是单一的某个神经元,也具有令人叹为观止的复杂性。作为一部生物机器,它始终在繁忙地运作与调控,维持着自身存在的统一性与延续性。 4

与计算机(即使是运行神经网络算法的计算机)不同,对于大脑这东西而言,区分其“所做”与“所是”是超级困难甚至是不可能的。

实际上,我们也没有好的理由指望这样的一种清晰区分。现代计算机里所谓软件与硬件的清晰区分,是人类根据图灵提出的原理设计出来并外加于计算机的。生物进化遵从不同的限制,并且具有不同的目标。从进化的视角来看,并不存在明显的选择压力能够使得不同的大脑类似于不同的计算机:就计算机而言,硬件与软件的区分可以使得不同计算之间具有完美的互操作性,但是不同大脑之间并不存在这样的互操作性。实际上,情况恰恰相反:与大脑的自然进化不同,持续维护软件与硬件的明确区分十分耗费能源——从现代服务器农场所需要的巨额预算中,这昭然若揭。

这一点很重大,由于那种认为大脑就是人肉图灵机的想法,恰恰来自尺度上的清晰区分,来自图灵一开始定义计算机时所强调的那种基质独立性。如果你无法区分大脑之所做与大脑之所是,那么上面所说的那种简洁性与功能性的数学联姻,就会分崩离析。相对应地,我们更没有理由去认为,生物“湿件”的意义就是单纯服务于算法“心件”。

真实大脑在多个尺度上的深度整合性——哲学家有时称之为“生成性固守”(generative entrenchment,文献13)的另一个后果在于,下面这种情况也将变得不可能:用一个硅基对应体去替换某一个神经元后,依旧可以完美地保持该神经元的功能,保持其输入输出的行为。5列如,某些神经元会通过尖峰放电去清除新陈代谢所产生的废物(文献14)。如果想要用一个完美的硅去替代这些神经元,就要求我们创造出一种基于硅的全新代谢机制,但硅可能根本不适合做这种事情。无缝替代一个生物神经元的唯一方法,就是使用另一个生物神经元,更理想而言,只能用同一个神经元。

这一点的重大性在于,它揭示了那种流行的“神经元替代”思想实验里的薄弱之处。我们被诱导去想象这样一种情景:大脑的各个部分被功能上的硅基对应物逐步替代(文献15)。这个思想实验尝试说明的结论是,认知或意识这类属性也具有基质独立性(或者对于硅而言,具有基质灵活性)。这类思想实验在今天的人工意识研究中占据显要位置,它尝试支持人工意识的可能性。杰弗里·辛顿最近在一个采访里援引了这一观点,他声称有意识的AI已经在我们周围出现了。 6 但是一旦我们注意到用完美的硅去替代大脑的任何部分实则都不可能,这个论证一开始就会不成立。 7

还有一点值得说明:在与时间的关系上,数字计算机与大脑差异巨大。在图灵世界里,重大的只有序列:A到B,0到1。任意的两个状态转化之间,可能间隔1微秒或一百万年,但它们依旧是同一个算法,同一个计算。但是对于大脑或一般性的生物系统而言,时间是物理的、连续的、无处不在的。生命系统必须在熵增的轨道上,持续地对抗衰老与无序,由于热力学第二定律是不可违背的。这意味着神经生物学活动与设计出来的算法不同,前者依赖连续性的时间。 8 此外,如哲学家们很早就强调过的(文献17),意识经验自身具有丰富的动态性与内在的时间性。它是流动的,而不是从一个状态跳闪到另一个。将大脑抽象成枯燥的算法与序列空间,既歪曲了生物学,也歪曲了意识流的现象学。

隐喻最终只是隐喻,一旦混淆了隐喻与物自体,我们就总是容易陷入困境。通过“图灵眼镜”去分析大脑,将会低估其生物上的复杂性,同时高估其发挥功能时所具有的基质灵活性。当我们真正从大脑本身出发理解大脑的时候,就会发现,那种认为多尺度的生物活动无非是实现抽象算法的一个底层硬件的想法,看起来相当幼稚。大脑并不是肉制图灵机。

直觉2:市面上的其他竞争理论

第二个直觉是,目前存在其他的理论可能性。我先前提到,图灵计算功能强劲,但具有局限性。图灵计算——算法——在一组有限离散数字与另一组数字之间建立映射,只强调序列的意义。图灵算法诚然有效,但存在超出此种计算的许多类别的动力学特性与函数。图灵本人就发现了许多不可计算函数,列如著名的“停机问题”,即在一般情形下,是否存在一种方法来判定某个算法在给定特定输入的情况下是否会终止(文献9)。令人震惊的是,凡是连续的(无限可分的)或随机的(具有内在不确定性)函数,都不属于图灵计算所能涵盖的范围。(算法的确 可以模拟非计算过程,但模拟并不等于生成或实现该过程;这一点将在后文第四种直觉中详述。)

生物系统充斥着连续的或随机的动力学过程,它们深嵌于物理时间之中。认为只有严格意义上的图灵可计算过程才与意识或认知、心灵的某些方面有关,显得超级武断。电磁场、神经递质流以及其他许多过程,都超出了算法的边界,但它们在理解意识方面都可能具有关键作用。

这些限制鼓励我们以更宽广的视角去理解大脑,在理解其工作机理的时候,超越图灵世界,去思考更宽泛意义上的计算与动力学形式。这里有着丰富的历史经验可供参考,未来也激动人心。

最早的计算机并非数字图灵机,而是一种在连续时间里运作的模拟装置。一个极佳的例子是约2000年前、用于天文计算的“安提凯希拉天体仪”(Antikythera mechanism)。 9

模拟计算机的再度兴起是在AI早期,以被目前忽视的“控制论”形式出现;其核心是反馈与控制,而不是抽象的符号操作(文献18)。最近,神经形态计算(neuromorphic computation)重新兴起(文献19),它利用了神经系统中比当前人工神经网络方法所采用的那种“卡通化”神经元模型更为细致的特性。较新的“可朽计算”(mortal computation)概念则强调,通过开发与其物质基质不可分割的算法,我们有希望实现能耗节约;所以当某一具体基质不再存在时,那些算法也会“死掉”(文献20)。

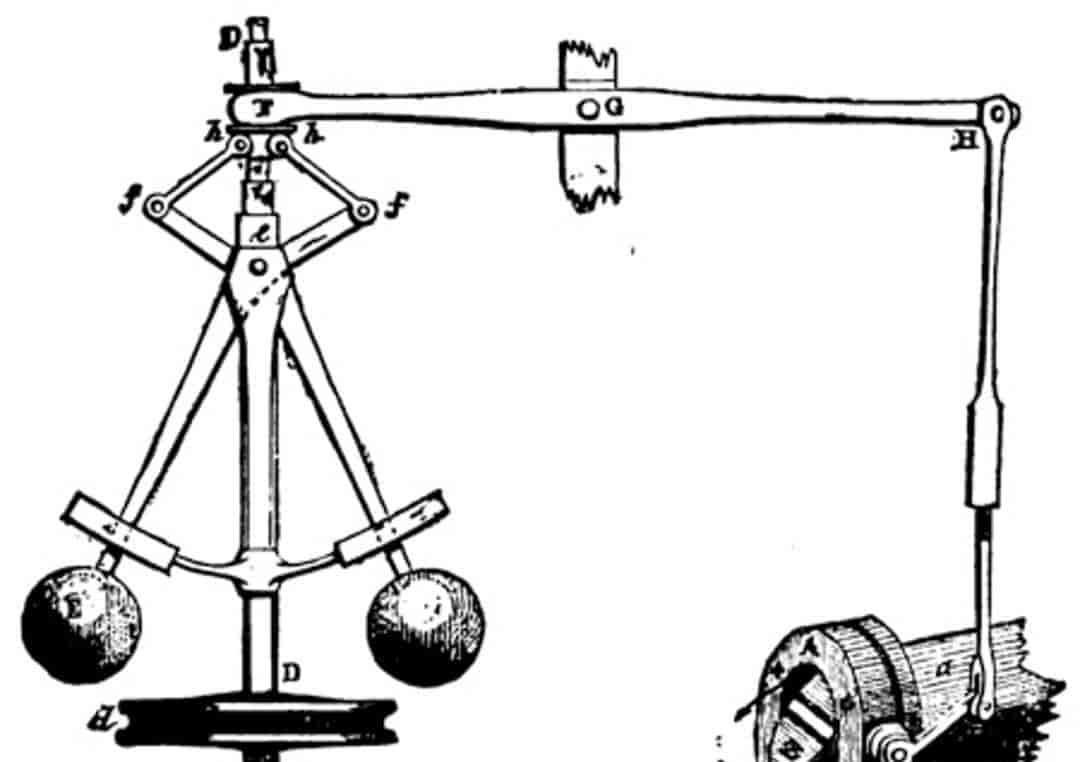

▷ 图3:瓦特调速器(Watt Governor)。它并不是一台计算机。

有许多正常发挥功用的系统,人们并不会将它们叫作“计算”系统,由于那样做没有必要或者用处不大。约三十年前,认知科学家蒂姆·凡·杰尔德(Tim Van Gelder)通过蒸汽机调速器的形式,给出了一个经典案例(图3,文献21)。这些调速器通过简单的机械结构和物理原理来调节蒸汽在发动机中的流量:当发动机转速升高时,两颗沉重的悬臂球会向外摆动,关闭阀门,减少气流。相比之下,如果我们采用“计算式调速器”,让它先感知转速,再计算所需的控制操作,然后发送准确的信号来开启或关闭执行器,不仅会极其低效,而且会完全误解真实的运作机制。

与凡·杰尔德的洞见相呼应,围绕“动力学系统”的认知科学研究、强调心灵之生成性(enactive)、具身性(embodied)、嵌入性(embedded)和延展性(extended)的研究(所谓4E认知科学),都会拒斥完全用算法去解释心灵与大脑。它们都尝试基于研究连续动力学过程的数学——如吸引子、相空间等(文献22,23)——去探索其他可能性。对于意识而言,大脑的这些特征都是必要的,而它们依赖的是非计算性的过程,或者说,一种宽泛意义上的计算(文献24)。 10

这些其他的市面理论与哲学上所谓的功能主义依旧是相容的,即认为心灵的属性(包括意识)依赖于大脑的功能架构(文献27)。这个领域里有一个容易导致混淆的倾向,那就是将十分自由的功能主义立场与“计算功能主义”等同。前者所谓的“功能架构”可以包含许多东西,而后者则给前者添加了一个额外的设定,即唯一有效的架构必定是计算性的,然后进一步就转化成了特定的图灵计算(文献6)。

机器意识的问题在这里的挑战在于,我们的探索越是远离图灵世界,我们就面临越多的随机性、动力学特性与熵,就越是要去了解某一物质基质的具体特性。问题不再是何种算法能够产生意识,而是转化成:对于一个类似于大脑的系统,如果想要实现具有意识的潜能,它究竟应该是什么样子的?

直觉3:生命很重大

我的第三个直觉是,生命(大致率而言)是重大的。这里指的是,生命的属性对于意识而言是必要的,虽然未必是充分的——这个想法被哲学家约翰·塞尔(John Searle)称为“生物学自然主义”(biological naturalism,文献28)。我在此第一要声明,我并没有一个支持该立场的板上钉钉的论证,且我觉得根本上不存在这类论证。但这个立场值得严肃对待,至少出于一个前文提到的简单缘由:目前大多数人公认的具有意识的那些对象,都同时也是有生命的。

意识为什么需要有生命呢?关于这一点要说的还有许多(文献16,29),但由于篇幅有限,我只展开讲其中的一个思路。

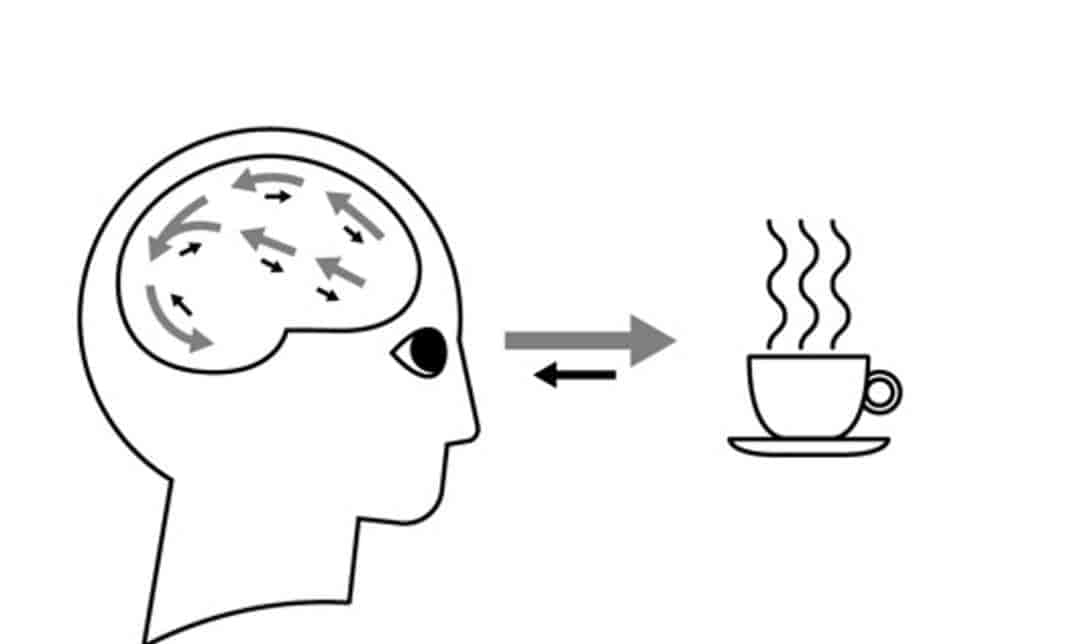

我们可以从这样的一个观察开始:我们有意识地知觉到的关于世界的信息,取决于大脑“最佳猜测”,而不是一种对于感觉输入的直接“读取”。这来自著名的“预测加工”理论。该理论认为,基于对缘由的预测,大脑会持续对接收到的感官输入进行解释与更新(文献30,31)。此处,感官信号被诠释为一种预测误差,反映在各知觉层次上,大脑所期待的内容与实则际获得的内容之间存在差异,而大脑会随时随地不断调整,将这类预测误差最小化。这种观点认为,意识经验属于一种“受控幻觉”——一种从顶部到底部、从内部到外部的知觉推理,其中大脑关于当下发生之事的预测会不断被感觉信号校准(文献16)。

▷ 图4:作为受控幻觉的知觉。对于咖啡杯的意识经验,根植于大脑对于感觉数据起因(黑色箭头)的预测(灰色箭头)。

让我们继续看:这类知觉上的“最佳猜测”不仅成就了关于世界的经验,也成就了“自我”的经验,即成为经验主体的那种经验。一个典型的例子就是关于身体的知觉:身体既是世界内的一个对象,也是自我性的某些重大维度(如情感与情绪)更基本的来源。这些维度都是一种知觉的“最佳猜测”形式:关于什么属于或不属于身体的一部分的推理,关于身体之内生理状况的推理——这一过程也被叫作“内感推理”(interoceptive inference)(文献32)。 11

知觉预测不仅有助于识别什么正在发生,也有助于控制与调节:当你能够预测时,你就能够控制。这最主要适用于对身体生理状态的预测,由于大脑的首要职责就是保证身体处于活着的状态,保证特定的生理指标(列如心率与血氧)处于合理的区间。从我们的具身体验所感受到的样子本身出发,这些也是可以理解的。列如,与视觉不同,情感与情绪的经验主要是通过效用价值(如情况是变好,还是变坏)来刻画的(文献34)。

这种生命的驱动力并不产生于某个特定的底层;它遍布在每一个细胞里,遍布在代谢之分子熔炉里。将预测误差最小化,是生命烈焰里一直存在的过程,它与生命的物质性本身密不可分。生物材料的自生特征,与支撑我们知觉经验的贝叶斯机制之间,存在着直接的数学关联。 12

这些思路现如今交融在一起。第一,我们依稀看到了解释生命与解释意识之间的联系。关于情感或情绪的意识经验,甚至最基本的“活着的感受”,都与身体控制及调节过程中所体现的知觉预测完美对应。第二,知觉预测背后的过程可能与我们的生物本性深度绑定在一起;作为生物系统,我们持续地对抗着熵增,不断进行着自我的重生。第三,这一切都是非计算性的,至少是非算法性的。在真实身体与真实大脑中,预测误差的最小化是一个连续动力学过程。它很可能与其物质基础密不可分,而并不单单是纯粹算法(那些只存在于纯净宇宙里的序列与符号)的一个肉体实现。 13

把这些放在一起思考,就会获得这样的一个图景:我们对于周遭世界的体验,以及对于沉浸在其中的自我体验,都是通过(through)、伴随(with)且依凭于(because of)活生生的身体而展开的。或许能够点燃意识方程的,并不是信息处理,而是生命本身。

直觉4:模拟不是例示

第四个也是最后一个直觉,把握起来相对容易,即承认模拟(simulation)不同于例示(instantiation)。由于其通用性,图灵计算机最强劲的能力之一就是能够模拟任何事物,甚至是(或者说尤其是)本身非计算性的事物。但是我们不应混淆地图与真实的地表,不应混淆模型与实际的机制。

计算性模拟一般缺乏被模拟物的因果效力与内在属性。对一个消化系统的模拟,实际上并不能消化任何东西。对暴风雨的模拟,并不能弄湿任何事物。如果我们模拟一个活着的被造物,我们并没有因此创造生命。一般而言,一个对X的计算性模拟,并不会导致X的存在;或者说,并不会例示(instantiate)X,除非X本身就代表着那个计算过程(算法)。换个方向说,X能被计算式模拟这一实际,并不代表X本身就是计算性的。

在多数情况下,模拟与例示的区分显而易见,没有争议。就意识而言也理应如此。一个关于大脑或身体的计算性模拟,无论做得多么细致,只有在意识的本质就是计算的时候,才能够产生意识。换句话说,想要成功通过某种高精度的“全脑模拟”去例示意识,已经预设了计算功能主义。但我们在论述第一个直觉时已经说了,这个假设很可能是不成立的,尤其不应被接受为一条公理。

这便揭示了“大脑作为计算机”这个隐喻的贫乏之处。如果你认为关于大脑,一切要紧的东西都可以通过抽象的神经网络加以刻画,那么认为对大脑的模拟能够例示所有大脑的属性(包括意识)将看起来十分自然。由于在这种情况下,事物的计算性已被预设好了。这就是通过图灵眼镜看的大脑。不过,如果你感兴趣的是更为精致的大脑模型,其中每一个神经元与其他精细的生物物理过程所体现出来的复杂性,都可以得到刻画,那么认为模拟大脑可以实现大脑的属性,就显得没那么自然了。由于那样精致模型的有趣之处恰恰在于,它表明,除了图灵计算,依旧存在着其他重大的事情。

因此,梦想将心灵意识上传到高精度的模拟大脑,并投入大量资本,以便于能在硅基王国获得永生的人们,可能面临一个矛盾——如果真的存在一个十分精致的大脑模型,那么你在其中存在的概率,并不高于英国气象局的计算机里能够产生一场冰雹的概率。

但是,请大家坐稳!有没有可能,万事万物早已全部处于模拟之中?可不可能我们整个宇宙,包括星球里的几十亿身体、大脑与心灵,以及冰雹与气象局的计算机,全部都是一个高级计算机模拟出来的代码片段?而这个计算机可能正在被神一样的技术狂人操控着?这就是“模拟假说”,其主要提出者是哲学家尼克·博斯特罗姆(Nick Bostrom,文献37)。这个想法依旧风行于技术圈。

博斯特罗姆指出,如果上述模拟真的发生过,类似情况的数量将远远多于一开始的“基底现实”。这反过来说明,我们生活在模拟世界里的概率远高于实在本身。他整理了许多统计学论证去发展这个想法。但值得注意的是,他曾指出这些论证所需要的一个必要前提,却默认它是成立的。或许有点令人意外,这个前提就是:“一个运行了合适程序的计算机,将具有意识”(文献同上,p.2)。但如果这个假设不成立,我们具有意识这一简单实际,就足以证明我们并不处于模拟世界之中。在哲学家仔细讨论各类假设的有效性的时候,这么强的一个假设,居然在没有被仔细考察的情况下被直接接受了。这一实际本身就暗示了关于心灵与大脑的计算主义对我们产生的深远影响。这也表明,当我们不能成功区分现实的模型与现实的本身时,就会将自己陷入存在性的混乱。

直觉总结

让我们来总结一下。许多社会与心理学要素,包括已经被充分理解的认知偏见,会令我们倾向于过度向机器投射意识。计算功能主义(主张算法计算足以产生意识)是一个超级强的预设,但一旦思考到大脑与(经典)计算机许多深刻的差异之后,这个预设就会被动摇。存在着许多其他的市面理论,既涉及不同的技术(如神经形态计算、脑类器官等),也涉及理解大脑的不同框架(如动力学系统理论)。将关于知觉的预测加工理论与生理学上的调节与代谢理论相结合,我们会看到一种新的可能性,也就是说,意识与我们作为活生物这一本性密切相关。最终,无论多么精细,模拟意识的生物学机制并不能带来真正的意识,除非计算功能主义恰好成立。

上述每一处直觉都可以单独成立。你或许可以赞成反计算功能主义的论证,同时却不支持生物自然主义。模拟与例示的区分,也不依赖于对我们认识偏见的承认。但是这些想法放在一起,它们会相互支持。对计算功能主义的质疑,将强化区分模拟与例示的重大性。除了图灵计算之外的市面理论,会使得基于生命去理解意识的想法变得更加可信。

总体而言,这些论证共同说明,即使AI越来越智能,意识也不太可能突然出现;甚至一般而言,我们目前熟悉的、以图灵机为核心的硅基AI系统,都不太可能产生意识。但同时,我们所说的一切,并没有彻底排除人工意识之可能性。

在这些思考的基础上,我们应该做什么呢?

我们要做(或不做)什么?

涉及意识这个,实际本身至关重大。这不仅由于祖先模拟、心智上传等等依旧只是神话,更由于具有意识体验的事物拥有其他事物所不具备的伦理与道德地位。至少,如果关于道德的判断都建立在拥有意识能力这个基础上,那么,把这些事物的道德地位纳入考量就显得十分自然了。

因此,清晰思考真正的人工意识之前景,在此时此地显得至关重大。我已经提出了反对AI具有意识的一些论证,但我也可能犯错。这个领域里,生物自然主义依旧是少数立场。有许多关于意识的理论,其框架也是基于计算过程的(文献38,参见文献39的综述)。这些理论并没有提出产生意识的充分条件,它们也一般会绕过对于计算功能主义的承诺。这些理论对于计算功能主义或许是满意的,却不会去预设它。但这不意味着它们都是错的。所有关于意识的理论都充满着不确定性,没有人知道创造真正的人工意识到底需要什么,或必定不需要什么。对此,任何对自己的理论确信无疑的人,理性上讲都是言过实则。

这种不确定性使得我们进退两难。虽然这听起来是废话,没有人应当去故意制造有意识的AI,不论是出于某种思虑欠佳的技术狂热,或是基于其他理由。创造有意识的机器,将会造成伦理上的灾难(文献40)。如果我们那样做了,我们将给世界引入新的道德主体,并可能带来新的苦难形式,且这种苦难(可能)会以指数级的速率增长。即使我正确论证了以图灵机为原型的计算机不能产生意识,其他新兴技术依旧有这个可能,或许是通过另外的计算形式(如模拟式的计算或神经形态式的计算等),或许是通过快速发展的合成生物学方法。在我看来,相比任何新一波的大语言模型,我们更应当担忧的是,意识在大脑类器官(一般由人类胚胎干细胞(文献41)培育出的、类似大脑的结构)中意外涌现的可能性。

但我们还有其他担忧。当谈到AI对社会的影响时,把实际上具有意识的AI系统与那些看起来仅仅像是有意识的AI系统区分开来至关重大。虽然前者不可避免存在很大的不确定性,但那些仅仅是看起来有意识的系统却已近在咫尺。正如谷歌工程师布莱克·勒莫因(Blake Lemoine)所论证的那样,对我们中的一部分人而言,它们已经在那了。那些看起来有意识的机器带来了严肃的伦理问题,但这些问题与实际上拥有意识的机器引发的伦理问题完全不同(文献29)。这里的问题第一关心的是那些被造物对我们的影响。我们要么决定去关心它们,重新划定我们的道德关怀圈,要么决定什么都不做,听凭我们的心灵变得残暴——这个论证至少可以追溯到康德的伦理学讲义。看起来具有意识的AI所带来的伦理问题,已经引起了AI领域内一些重大人物的关切,列如穆斯塔法·苏莱曼(Mustafa Suleyman,微软AI首席执行官) 14 、约书亚·本吉奥(Yoshua Bengio,文献42)等。但这毫不意味着相关问题已经得到了有效控制。

此处常常被忽视的一个要素在于,即使我们知道或信任AI不具有意识,我们可能也难以拒斥那种它们具有意识的感觉。我们的心灵关于人工意识产生的错觉,或许与许多视错觉一样,难以琢磨。缪勒—莱尔错觉(图5)中的两条线具有一样的长度,但它们依旧看起来是不同的。这一点与我们见过这个错觉的次数无关,哪怕你见过这个图许多次,你依旧无法拒斥你所感觉到的内容。我们对于AI可能有意识的感觉,可能与我们关于“AI意识”的思考和理解毫无关系。

▷ 图5:缪勒—莱尔错觉。两根线长度相当。

此外,由于尚不存在关于意识的必要与充分条件的共识,因此也不存在任何决定AI是否具有意识的定义性测试(文献43)。《机械姬》的情节就是围绕着这个困难而展开的。影片借鉴了著名的图灵测试(正如图灵本人清楚认识到的,它测试的是机器智能而非意识),机器人Ava的创造者内森认为,“真正的测试”在于:在告知其造物是一台机器的前提下,观察那个被测试的工具人Caleb,是否依旧会觉得它/她是有意识的。这后来被称为“加兰测试”(Garland test,文献44)。该测试并非测试机器意识本身,而是在什么条件下,人类会被说服去信任一台机器具有意识。

尽管面对诸多不确定性,我们仍有必要采取一些有根据的伦理立场,这一点的重大性点明了人类的另一个习惯:很不幸,我们面对那些值得被赋予道德考量的对象时,向来反应很迟钝,列如在对待许多非人类动物乃至其他人类的问题上。因此,我们可以很合理地猜想,拒绝赋予AI以意识,是否会让我们再次站在历史发展的对立面?最近关于“AI福祉”的呼吁,很大程度上便来自这一担忧(文献2)。但是,我们有许多理由认为,AI的情况很有可能与之前不同。我们的心理偏见让我们更容易错误肯定而不是错误否定。与非人类动物的情况不同,AI的那些明显奇特之处或许在于,它与人类相比,二者的类似性更多的是在与意识无关的方面。

灵魂机器

尽管泥沙俱下,AI无疑在改变社会。辨明AI带来的明显挑战,充分利用它带来的机遇,已经够困难了;而宣传“机器意识时代即将到来”等夸张言论,将加剧我们面临的混乱。思考到技术本身与公众认知的快速变化,对AI意识的希望与隐忧形成清晰的认识,就显得十分迫切而必要了。

真正的人工意识将改变一切,且在许多方面会朝向坏的方向。误以为AI有意识的那些人类错觉,本身就具有独特的风险,尤其是当我们持续被真正的可感机器这个想法所吸引和迷惑的时候。我希望本文能够提供一些回应这些危机的思想工具,对那些关于必然性或绝对不可能的过度自信的断言加以反思,最终为理解我们自身作为人类、作为动物、作为生物之本性,也为我们的未来,提供一些希望。

AI的未来史尚待书写。AI可发展的方向也不存在什么必然性。否则,我们就会过度受制于我们的概念惯习,被劣质的科幻小说忽悠,被那些苟延残喘的技术公司所编造出来的故事随意摆布。时间很有限,但总体来看,我们依旧有机会去决定我们真正想要或不想要的AI是什么样子的。

哲学家香农·瓦洛尔(Shannon Vallor)将AI描述为一面镜子,我们在镜中可以看到身后的入射光线,这些光线就是我们被数字化的过去(文献45)。我们设计的算法里反映着我们的存在,但我们自身也反映了能被设计的算法。疯狂追捧通用AI或具有意识潜能的AI所带来的最新恶果,就是这种对于心灵的机械化。一方面是生物大脑与人类经验的丰富性,另一方面是具有深度伪造技术的聊天机器人(或任何最新的AI魔法)的信息处理机制。如果我们把这二者混为一谈,就会对自己——我们的心灵、大脑和身体——造成严重的伤害。如果我们轻易委身于被造的机器,我们便高估了它们,也低估了我们自己。

或许出人意料,这些思考最终把我引向了灵魂的问题。对于许多人,尤其是被理性与科学启蒙的现代人来说,灵魂的概念早已过时,仿佛只应存在于石器时代。如果这里所谓的灵魂,指的是理性与意识背后的某种非物质本质,并且可以独立于身体而存在,那么抛弃这个概念,算不上什么严重的错误。但还有许多其他对于灵魂的理解。早在笛卡尔之前,古希腊的psychē概念就把灵魂与呼吸联系在一起。 15 在世界的另一端,印度教所谓的灵魂,Ātman,则将我们最内在的本质与一切经验的基础状态相联系:那是一种不受理性思维或任何特定意识内容影响的、纯粹的、证悟性的觉识。

对于硅基天堂的卡通幻想,以及心智上传、离体的外在存在、在云端与其他蒙召者重逢等主题,恰恰回到了笛卡尔的灵魂观。计算机,或者更准确地说,计算,毕竟是不朽的,对于算法的根本信仰许诺了某种不被身体玷污的纯粹理性(尽管已经有许多证据表明,理性与情感之间存在紧密关联,文献47)。但这些大致率都是南柯一梦,它们带来的并不是一片后人类时代的乐土,而是硅基的荒原。

真正重大的不是笛卡尔式的灵魂。灵魂,不应当是你或我的那种无躯体的人类例外主义不朽本质。或许使得我们成为我们的,需要在更根本的源头去追溯:我们可能需要回到古希腊与印度的平原,在那里,我们最为内在的本质呈现为一种尚待生发的、纯粹的“活着”的感觉,更像是呼吸而非思想,更像是肉身而非机器。

社会学家雪莉·特克尔(Sherry Turkle)曾说,技术会让我们忘记自己对生命的认知(文献48)。目前,是时候重新记起这些了。

[db:评论]