Gemma 4端侧模型主要适合三类人:天天需要离线查资料的“百科向”用户、依赖离线工具干活的“工具向”用户,以及想亲手玩转端侧AI的“尝鲜用户”。

它为什么能同时满足这三类人?核心在于一个数字:1.5GB。经过INT4量化,E2B模型的内存占用可以压到这个水平,这意味着它能在你的千元安卓机、树莓派甚至更老的设备上流畅运行,实现完全离线、零延迟的AI交互。

如果你需要随时随地的离线知识库

这类用户的核心是“知识好奇心”,典型场景包括学生课间查资料、出差时查行业术语,或者单纯想弄清楚一个历史事件。

- 它知道什么:Gemma 4 E4B模型的知识截止到2023年10月,在此之前的历史、科学、文化等公开知识,理论上你都能问。它甚至能解答一些细分问题,列如“吴越国为何能在重税下维持八十余年繁荣”,这个答案让非历史专业的人都觉得“够用”了。

- 它不知道什么:它偶尔会犯低级错误,列如记错《将进酒》的作者和内容。对于2023年10月之后的事件,它也无能为力。

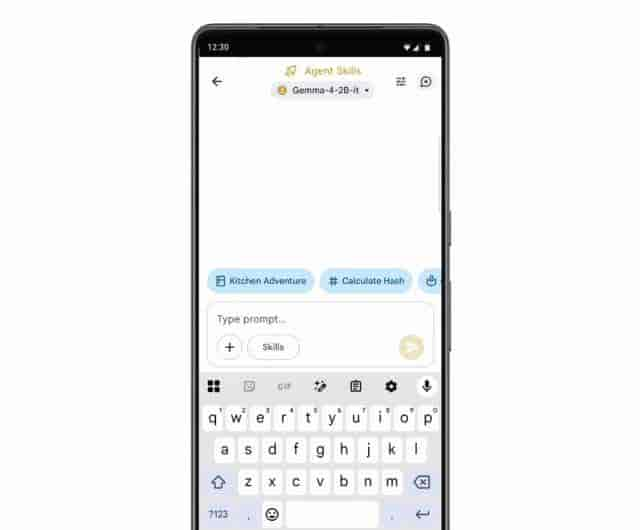

- 怎么解决知识盲区:它支持Agent Skills功能。你可以为它安装一个“查询维基百科”的技能,这样它就能突破自身训练数据的限制,实时检索最新知识,相当于把一个可扩展的云端知识库装进了手机。

如果你需要断网环境下的生产力工具

这类用户的核心痛点是网络依赖和隐私安全。典型人群包括程序员、翻译、外勤人员以及任何需要处理敏感文件的人。

- 它能做什么:

- 离线翻译:原生支持140多种语言实时互译,外贸经理反馈在无网络的飞机上用它处理英文合同“速度快、翻译准确”。

- 文档处理:凭借128K上下文窗口,可以离线总结长文档、提取关键信息、生成学习闪卡。

- 代码辅助:E4B模型在LiveCodeBench评测中达到**52.0%**的准确率,能在无网络时提供基础的代码生成和解释。

- 对比云端工具的优势:

- 零成本:本地运行,没有API调用费,长期使用成本为0。

- 零延迟:端侧推理,输入问题后立即开始生成,E2B模型在移动端速度超过40 Token/s,比许多云端API的首响应还快。

- 绝对隐私:所有数据在设备内处理,无需上传云端,适合处理企业涉密文档或个人敏感信息。

如果你是想折腾技术的开发者或极客

这类用户关注的是技术自由度与可玩性。Gemma 4端侧对他们而言是一个绝佳的实验平台。

- 彻底开源,商用无忧:采用Apache 2.0协议,允许自由修改、分发和商用,没有任何用户规模限制,彻底解决了法律合规的顾虑。

- 部署极其简单:通过Ollama工具,一行命令 ollama run gemma4:e2b 就能在电脑或服务器上跑起来。在手机端,可以通过Google AI Edge Gallery应用直接下载体验。

- 强劲的自定义能力:

- 你可以利用Agent Skills框架,为它开发专属技能,列如连接智能家居、调用特定数据库。

- 可以通过Prompt Lab精细控制模型参数,或使用社区工具对模型进行量化微调,定制专属版本。

所以,Gemma 4端侧的本质,是一个在成本(零花费)、隐私(数据不出门)和便利性(离线即用) 之间找到了最佳平衡点的AI工具。它不追求回答每个问题都完美无缺,而是确保在最常见的离线场景里,给你一个立刻就能用上的“80分答案”。

对于上述三类用户来说,这个确定性价值,远胜于一个更强但受制于网络、成本和隐私的云端模型。

© 版权声明

文章版权归作者所有,未经允许请勿转载。

相关文章

暂无评论...