2026年,一个56岁的北京程序员想给手机装一个能离线运行、懂代码的AI助手。他试过几个模型,要么太大,手机跑不动;要么太小,回答不靠谱。直到他下载了谷歌的Gemma 4 E2B模型,这个总参数仅20亿的“小不点”,不仅流畅运行,还能帮他分析代码片段,响应速度几乎零延迟。

这背后,是谷歌在2026年4月打出的一记“降维打击”。当整个行业还在为万亿参数模型的算力账单发愁时,Gemma 4用一套外科手术式的精密架构,实现了“小参数,强性能”的奇迹:其31B稠密版在部分能力上对标6000亿级闭源模型,而2B的端侧版可以直接在你的手机里离线工作。

它如何做到“小算力,大效果”,核心是“双核”策略

理解Gemma 4的突破,可以把它想象成一台经过深度改造的“双核”CPU。传统的AI模型就像一个单核巨兽,处理任何问题都要动用全部“脑细胞”(参数),功耗巨大。而Gemma 4的26B-A4B型号,则设计了一套机智的分工协作系统。

- 一个“通用核”:负责处理所有任务都需要的基础语言理解,列如语法、常识。这确保模型不会在简单问题上“翻车”。

- 一个“专家调度核”:它管理着128个“小专家”子网络,分别擅长代码、数学、多语言等不同领域。当你问一个编程问题时,调度核只激活最相关的8个编程专家,外加那个始终在线的通用核。

结果就是,这个总参数量260亿的模型,每次推理实际动用的“脑细胞”只有约38亿个。它用4B级别模型的算力成本,跑出了26B级别模型的质量。这不是魔法,而是把“好钢用在刀刃上”的工程哲学。

为了省内存和算力,它还做了哪些“减法”

光有分工还不够,Gemma 4在信息处理的每个环节都做了极致优化,目标就是:让数据跑得更快,让内存占用更少。

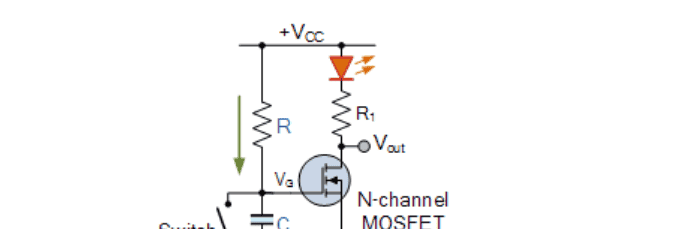

第一招,分组查询注意力(GQA)。你可以把它理解为“课堂提问优化”。传统模型里,每个学生(Query)都要单独向老师(Key-Value)提问和获取答案,超级耗时。Gemma 4让每4个学生共享一份答案。

这样,需要搬运和存储的“答案库”(KV Cache)体积直接减少了75%,推理速度自然就上去了。

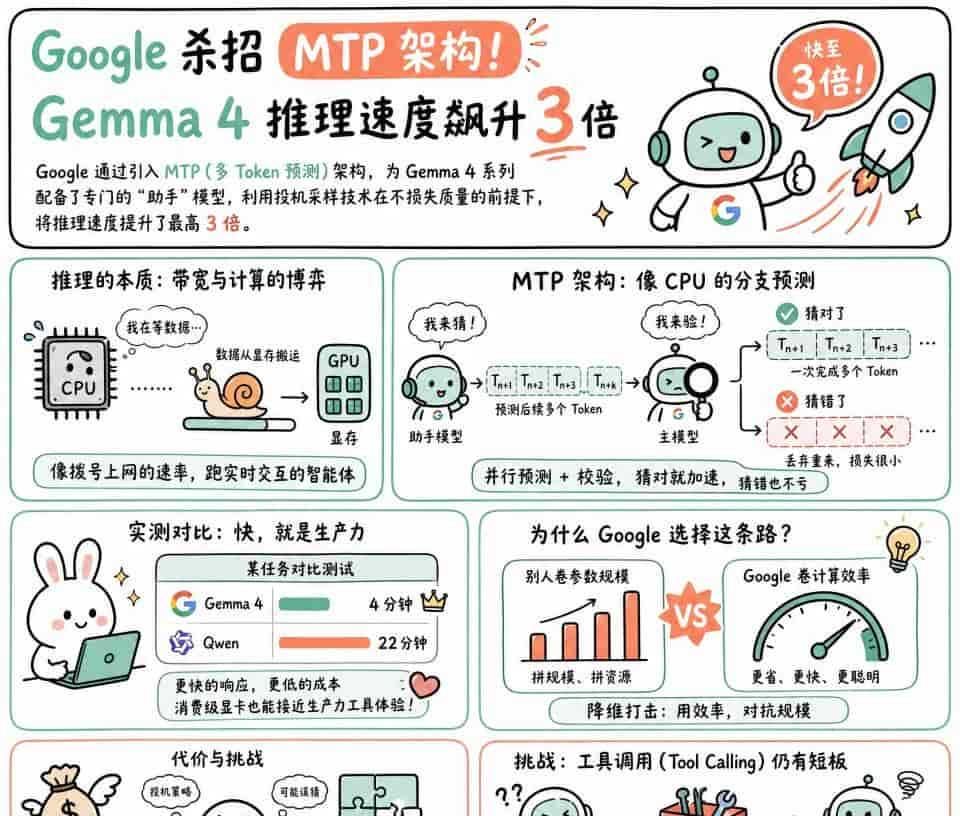

第二招,多Token预测(MTP)。这就像CPU里的“分支预测”技术。Gemma 4配备了一个极小的“助手”模型,专门用来预测你接下来可能会说的几个词。主模型则并行校验这些预测。猜对了,就一次性输出多个词,效率倍增;猜错了,代价也很小。

这项技术让Gemma 4在某些任务上的推理速度提升了最高3倍,用4分钟完成竞品22分钟的计算量。

正是这些层层叠加的“减法”,让Gemma 4的E2B端侧模型在量化后能压缩到1.5GB以下,轻松在手机和树莓派上运行,并且实现超过40 token/s的本地响应速度,体验上“近乎零延迟”。

追平GPT-5,究竟是在什么意义上

这里必须明确一个关键:Gemma 4追平的,并非GPT-5在所有复杂任务上的巅峰能力,而是在特定场景和效率维度上的体验。

根据行业分析,两者的技术路线已经分化:

- GPT-5(推测):代表“大力出奇迹”的路线。依靠可能高达万亿级的参数和OpenAI每年500亿美元的算力预算,追求通用智能的极致上限,擅长跨模态生成、复杂逻辑推理。

- Gemma 4:代表“效率至上”的路线。通过架构创新,在低成本、低延迟的端侧和设备端场景中,提供“足够好且即时”的服务。

所以,所谓的“追平”发生在这些场景:当你需要手机离线实时翻译、快速进行本地文档摘要、或者让一个IoT设备拥有基础对话能力时,Gemma 4端侧模型的零延迟、零网络消耗、数据本地化的体验,完全超越了需要调用云端API、等待网络往返的GPT-5。

斯坦福HAI 2026年的报告指出了一个趋势:AI行业正从“追求模型规模”转向“追求场景效率”。Omdia的研究更预测,未来将形成 “大模型负责能力上限,中小模型负责规模应用” 的分层生态。

Gemma 4的成功,正是这一趋势的缩影。它证明,通过极致的工程优化,完全可以在不堆砌参数的前提下,将AI能力 democratize(民主化),塞进每个人的口袋。这或许比单纯刷榜,更能定义AI的下一阶段。

相关文章