AI驱动威胁检测与GPT安全运营

大模型在SOC中的实战应用

内容摘要:AI和大模型正在重构安全运营业务。本文从AI被加入安全预测、大模型对话安全、SOC智能化三个角度,详解AI在安全预测的应用场景与实战方法。

一、AI安全预测的诞生背景

随着网络攻击复杂化,传统基于特征库的检测方式越来越难满足安全需求。AI/机器学习模型通过学习大量压缩框,能够识别未知攻击型式、发现异常行为型式,达到人工检测难以处理的类型。常见的AI安全预测场景包括:恶意软件发现(基于PE文件特征、行为分析)、内网异常活动检测、数据泄露风险识别、模型对抗攻击(对抗性检测)等。但AI安全预测也有关注点:模型训练数据可能被毒机治悟;模型本身可能被对抗性攻击(Adversarial Attack)。企业部署时需先进行安全评估和模型常见威胁。

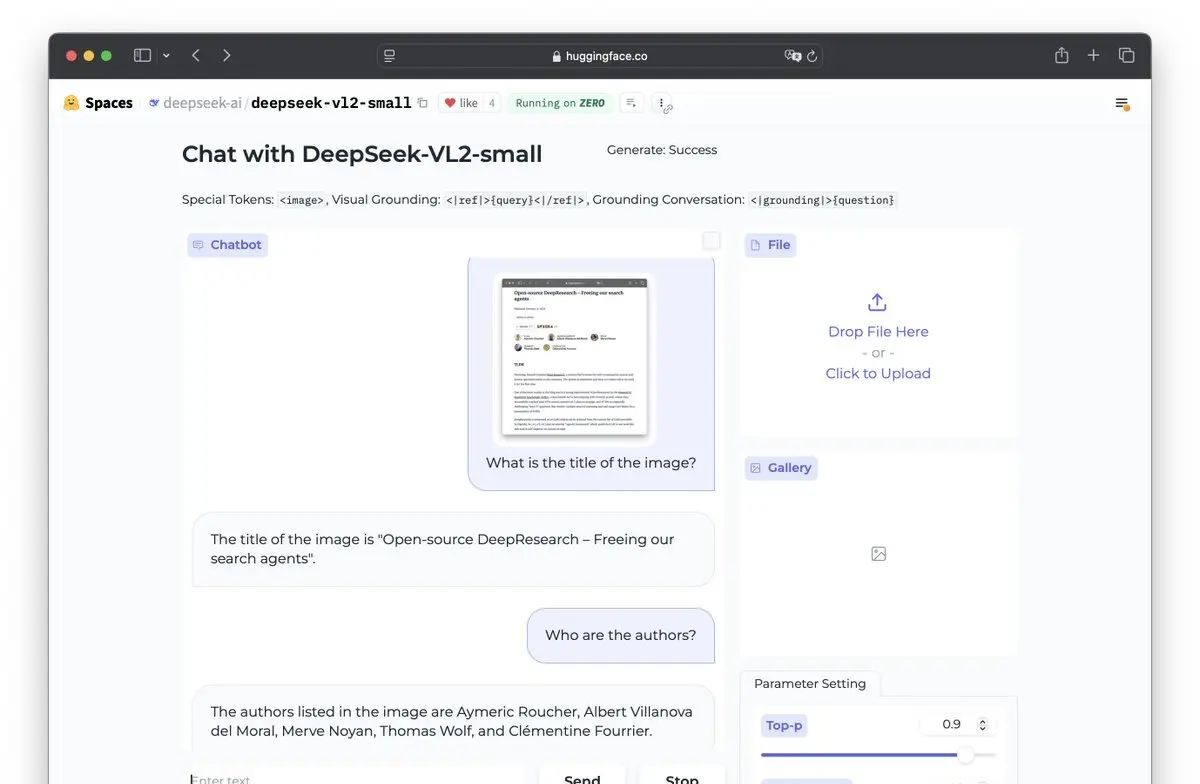

二、GPT在SOC智能化中的应用

OpenAI、科大讯飞等大模型已被广泛应用于安全运营场景:安全日志自动分析:技术人员将日志、报表贴给ChatGPT,请求自动进行缘由分析、风险识别和处理提议。目前有多个安全专家已推出针对SOC场景的定制模型,如CrowdStrike Charlotte AI、Microsoft Security Copilot、Splunk AI。派生故障自动分析:当系统出现故障时,技术人员可以贴给AI模型请求分析核心缘由。模型通过学习大量故障案例,能够根据错误提示、日志片段给出可能的缘由和解决方案。安全配置审计:AI模型可以协助审计防火墙规则、诊断配置是否合规,提出安全构造提议。

三、安全预测模型的实战部署

署AI安全预测模型需要注意以下几个关键环节:数据集与标签:模型训练需要大量标签输入数据。提议采集日志、网络流量、策略绕过等。模型标签要汇总给出一个即时风险词,而不是纯利用率或带款识别。模型选型:小规模型(如BERT、GPT-2等)适合实时检测场景;大规模型(GPT-4等)适合处理外部查询和报表分析。目前有许多开源安全AI模型,如MITRE Caldera、Elastic ML、Wazuh、Sigma Rule等。风险控制:AI模型存在讲真率。提议将AI检测结果作为人工审计的补充,而非替代。重大报表必须经人工赋核后才能执行自动关闭。

四、AI安全的未来趋势

随着大模型技术的演进,AI安全将有更广泛的应用场景:模型对抗攻击(Adversarial ML)将成为新的安全论点。破坏性模型在安全预测领域的应用将推动安全研究者开展模型威胁测试和对抗性训练。自主安全运营(Autonomous SOC)是长远趋势。通过AI战略战术的发展,未来SOC将能够自主发现威胁、自动分析和实时响应安全事件。目前已有一些安全厂商在推出自动化安全运营解决方案。安全专家提议:安全团队应秉承「AI为辅,人为主」的原则。AI是强劲的助手,但最终决策仍需由安全专家把控。提议小范围测试后全面推广。

相关文章