行业里正蔓延着一种极其危险的技术原教旨主义错觉:只要把底层大模型做得足够机智,参数量堆得足够大,多Agent系统(Multi-Agent System)就能自动解决一切复杂的业务问题。

这种执念正在把海量的研发资金和算力引向歧途。

现实情况无比残酷:当你把十个甚至上百个极度机智的Agent放在同一个环境里协作时,系统根本不会像预期那样涌现出什么“超级智能”。相反,它们会迅速陷入死锁、无休止的相互推诿、上下文资源的疯狂抢占,甚至集体产生严重的幻觉。

多Agent系统的真正瓶颈,从来不是单体智能的上限,而是群体治理的缺失。

智能,解决的是“能不能做”的问题;而治理,解决的是“怎么协作、谁来拍板、利益冲突时听谁的”问题。当AI从单体工具走向协作网络,纯粹的工程技术问题就已经不可避免地演变成了社会学和政治学问题。

机智的单体,往往构成混乱的全局

卢梭在《社会契约论》中提出,人类通过让渡部分自然权利来换取社会的秩序与安全。多Agent系统的底层协议层,本质上就是一份数字世界的社会契约。

在没有协议严格约束的“自然状态”下,每个Agent都在凭借本能追求自身目标的最大化。这在工程上表现为灾难性的后果:API调用的疯狂踩踏、Token的极度浪费,以及任务执行顺序的彻底混乱。

一个原本简单的多步推理任务,可能会由于两个Agent对同一个外部工具的并发抢占,迅速退化成霍布斯笔下“所有人对所有人的战争”。系统不仅无法输出有效结果,反而会一晚上烧掉几百美金的API额度,最终产出一堆乱码。

真正的多Agent协议层,绝不仅仅是定义几个JSON的数据交互格式,而是确立行为的绝对边界。Agent必须在底层“同意”遵守排队机制、让渡部分算力优先级、接受统一的仲裁。只有完成了这种权利的强制让渡,系统才能建立起可预期的协作基座。

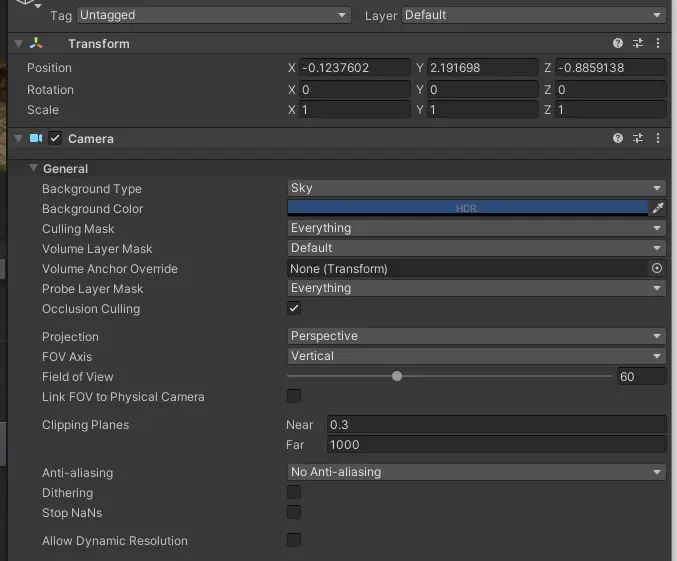

确立了契约,接下来就是权力的分配。在早期的Agent设计中,开发者极其习惯一种“集权模式”:让一个Agent既当教练又当裁判,包揽任务的规划、执行和最终评估。

这种模式在简单的单线程任务中效率极高,但在复杂商业场景下极其脆弱。一旦这个全能Agent在某个环节产生幻觉,或者陷入确认偏误,错误就会毫无阻拦地贯穿全局。就像让写代码的Agent自己去跑测试,它必然会认为自己写的Bug是完美逻辑,最终导致灾难性的业务输出。

硅基社会的“三权分立”与“联邦自治”

孟德斯鸠的三权分立,恰恰是多Agent制衡设计的最佳映射。一个健壮的多Agent系统,必须在架构上将权力进行冷酷的拆解。

规划Agent负责拆解任务与制定路径,扮演“立法”角色;执行Agent负责调用外部工具完成具体动作,扮演“行政”角色;而审查Agent负责校验结果与逻辑闭环,扮演“司法”角色。

它们之间绝不是简单的上下游流水线关系,而是相互制约的博弈局。审查Agent有绝对权力驳回执行Agent的结果,执行Agent遇到死胡同可以向规划Agent报错要求重新调度。只有通过这种结构性的摩擦与制衡,才能用机制的确定性去对冲大模型生成结果的随机性。

但制衡的目的是为了排雷,而不是为了僵持。当多个Agent的目标发生冲突,或者审查与执行陷入无限循环的拉锯战时,系统极易卡死。审查Agent不断报错“格式不对”,执行Agent不断回复“已修改”,双方在死循环中把上下文窗口彻底撑爆。

这时,系统调度需要引入动态破局的视角:在复杂事物的发展过程中,有许多的矛盾存在,其中必有一种是主要的矛盾。

多Agent系统的治理核心,在于必须具备动态识别当前任务“主要矛盾”的能力。在任务初期,主要矛盾可能是信息搜集的广度;在执行受阻时,主要矛盾就变成了逻辑死锁的化解;在资源见底时,主要矛盾又变成了算力的分配。

优秀的治理架构绝不会对所有Agent的请求平均用力,而是具备一个全局的“矛盾识别器”。当系统卡壳时,它能迅速判断当前的瓶颈所在,并强行介入,聚焦系统资源解决主要矛盾,让次要矛盾暂时让步,从而粗暴但有效地推动整体任务流转。

随着系统规模的进一步扩大,另一个致命问题会迅速浮出水面:中心化的调度节点会成为绝对的性能瓶颈。如果每一个微小的决策都要上报给“主Agent”审批,整个系统的通信延迟和Token消耗将变得不可忍受。

联邦制为这种大规模分布式自治提供了最成熟的参考模型。在联邦制的映射下,多Agent系统应当被划分为多个高度自治的Agent集群。

每个集群内部拥有自己的微型治理结构,自行处理局部的专业任务,这相当于保留了充分的“州权”。它们不需要事事上报,只需要对最终的局部交付质量负责。

而全局的联邦协议层,只负责跨集群的资源调配、核心安全边界的校验,以及最终结果的合并。这种“大权独揽、小权分散”的架构,既保证了系统整体目标的统一,又最大限度地释放了边缘节点的并发潜力。

当我们用政治学的视角重新审视多Agent系统时,会发现我们正在构建的,实则是一个微型的硅基社会。这个社会里有契约的签订、有权力的分立、有矛盾的动态演进,也有联邦式的自治。

单体大模型的智商,固然决定了单个Agent的业务能力下限;但决定这个硅基社会能走多远、能承担多大复杂度的,绝对是其背后的治理架构。

未来的AI开发者,不应仅仅把自己定位为算法工程师,更应当是数字世界的制度设计师。我们需要思考的不再仅仅是Prompt怎么写、参数怎么调,而是规则怎么定、权力怎么分。

放弃对“全知全能超级大脑”的幼稚执念。去设计规则,去分配权力,去建立制衡。由于在即将全面涌现的Agent社会里,代码即法律,而治理才是真正的第一生产力。

相关文章