01 什么是 Token?

Token 不是代币,也不是积分。

在 AI 领域,Token 是大语言模型理解和处理文本的基本单位。

你可以把它想象成:

文字世界的”原子”

AI 阅读和写作的”最小颗粒”

你和模型沟通的”计价单位”

一个 Token 大约等于 3/4 个英文单词,或者 1.5 个中文字符。

"你好,今天天气不错"

→ 约 7 个 Token

"Hello, how are you today?"

→ 约 6 个 Token02 Token 是怎么来的?

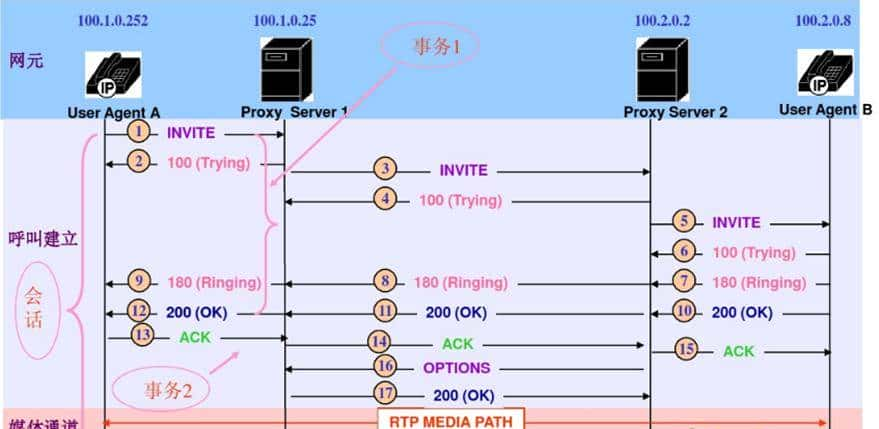

大模型”看”到的文字,和你我看到的不一样。

你的输入 → Tokenizer(分词器)→ Token 序列 → 模型处理

举个例子:

原文:"我喜爱人工智能"

分词后:["我", "喜爱", "人工", "智能"]

Token ID: [128, 4562, 789, 1024]模型实际上是在处理这些数字 ID,而不是文字本身。

中文分词比英文更复杂:

英文有空格天然分界

中文需要算法判断哪里”断开”

同一个词可能有多种分法

03 为什么 Token 如此重大?

1. 它决定了成本

几乎所有大模型 API 都按 Token 收费:

模型输入价格输出价格

GPT-4$ 输入:0.03/1K 输出:$0.06/1K

Claude 3.5 输入:$0.03/1K 输出:$0.015/1K

文心一言 输入:¥0.012/1K¥ 输出:0.012/1K

一次长对话可能消耗数千 Token,成本差异巨大。

2. 它决定了速度

Token 越多 = 处理时间越长

短问题:秒回

长文档:可能需要几分钟

整本书:可能超时或截断

3. 它决定了模型的”记忆力”

每个模型都有上下文窗口(Context Window)限制:

GPT-4 Turbo 上下文窗口:128K Token

Claude 3.5 上下文窗口:200K Token

通义千问 上下文窗口:32K-256K Token

128K Token ≈ 10 万汉字 ≈ 一本小说的篇幅

超过这个限制,模型就会”忘记”最早的内容。

04 Token 消耗在哪里?

每次对话 = 输入 Token + 输出 Token

你问:"请帮我写一份 2026 年市场营销计划,

包括目标、策略、预算、执行步骤"

→ 输入:约 50 Token

AI 回答:(一份 2000 字的详细计划)

→ 输出:约 1500 Token

总消耗:1550 Token注意:AI 输出的 Token 一般比输入多得多!

05 如何节省 Token?

技巧 1:问题要精准

❌ “请帮我写一篇关于人工智能的文章,要包括历史、发展、应用、未来趋势,还要有案例,字数 3000 字左右”

✅ “写一篇 3000 字 AI 科普文,包含:历史、应用、趋势”

技巧 2:利用系统提示

把重复的指令放在系统提示里,避免每次都重复。

技巧 3:分段处理长文档

不要一次扔整本书,分章节处理更高效。

技巧 4:选择合适模型

简单任务用小模型,复杂任务用大模型。

06 Token 的未来

Token 机制正在被挑战。

2025-2026 年,多个研究团队在探索替代方案:

字节级建模:更细粒度的处理

图像化文本:把文字当图片处理

无限上下文:突破 Token 限制

但至少在短期内,Token 依旧是 AI 世界的”通用货币”。

07 给普通用户的提议

理解计费方式:看清输入/输出分别怎么算

合理预期长度:长回答 = 高成本

善用摘要功能:先让 AI 总结,再决定是否深入

保存重大对话:避免重复输入一样背景

写在最后

Token 看似技术细节,实则关乎每个人使用 AI 的成本和体验。

下次当你看到”剩余 Token”时,希望你能会心一笑:

这不仅是数字,更是你和 AI 对话的”燃料”。

善用 Token,让每一次对话都值得。

收藏提示: 本文约 2000 Token,适合快速了解 AI Token 核心概念。

#token##openclaw##人工智能##AI技术##ai##头条AI创作计划#

相关文章