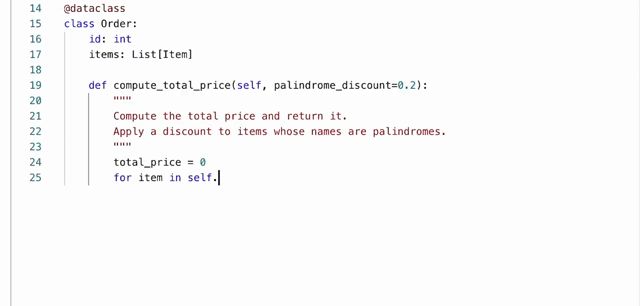

Seedance2.0物理准确性97.55%:Veo3.1音画同步优势何在?

假设你是一位戏曲导演,正筹划一部新戏。剧本里有个场景:旦角的水袖要随锣鼓点翻飞,同时舞台背景需从传统戏楼幻化为水墨山水。 过去,这需要演员反复排练、特效团队逐帧制作,耗时耗力。

目前,你听说最新的AI视频模型或许能帮忙。但当你搜索时,会发现两个最常被提起的名字:Seedance2.0和Veo3.1。它们都能“生成视频”,可谁更适合你手里的戏曲本子?

答案是:它们都还没为戏曲“开小灶”,但各自拿手的“厨艺”完全不同,能帮你解决的“菜式”也截然不同。 一个像精通十八般武艺、能快速复刻动作的“武行指导”;另一个则像对布料、声音有极致追求的“服化道和音效总监”。

动作学习:是“模仿”还是“理解”?

先看Seedance2.0。它的核心能力,可以理解为一个极度擅长“模仿”和“组合”的AI导演。

想象一下,你把一段旦角的水袖动作视频、几张不同角度的脸谱照片,甚至一段锣鼓经的音频,一起塞给这个AI。它能同时“吃下”这些素材,然后生成一段全新的、动作连贯的表演视频。

这就像你给武行指导看了几个经典招式片段,他就能为你设计出一套全新的、但风格统一的对打动作。

这种“多模态联合建模”的能力,让它在处理戏曲元素时超级灵活:

- 学动作:上传身段视频,它能学习并生成连贯的表演序列,其人体动作生成的物理准确性可用率达到了97.55%。

- 定风格:上传脸谱、戏服图片,生成的人物能保持这些视觉特征。

- 卡节奏:输入锣鼓经音频,生成的视频动作会尝试与节奏点同步[子代理1]。

它的优势是快和创意融合。如果你需要快速生成一个概念片,或者想把不同戏曲元素(如南方的身段和北方的脸谱)融合在一个新创意里,它会是不错的工具。2026年总台春晚的《贺花神》等节目,就曾用它来制作动态背景,验证了其对传统舞蹈动作的生成能力。

物理真实:当水袖拂过空气的轨迹都必须“对”

再看Veo3.1。它的追求完全不同,它不想当导演,只想做最顶级的“物理世界还原者”。

谷歌DeepMind团队在它身上投入的核心,是“世界模型”级别的物理仿真。这意味着,它生成视频时,内在有一套复杂的物理引擎在计算:布料的垂坠感、水花的飞溅、烟雾的扩散,都必须符合现实世界的动力学规律。

这对戏曲视频意味着什么?意味着那些极度依赖物理真实感的部分,可能是它的潜力所在:

- 服装动态:京剧里水袖的抛、收、拂、扬,昆曲中裙裾的轻摆。Veo3.1可能能更精准地模拟出丝绸的质感与运动的轨迹,减少不自然的穿帮或僵硬动画感。

- 特效仿真:舞台上的烟雾、兵器交锋时的火星、水袖击鼓时溅起的“虚影”。这些需要高精度物理模拟的效果,是其技术优势区[子代理2]。

- 原生音画同步:更关键的是,Veo3.1能同步生成画面与匹配的环境声音。想象一下,生成一个老生靴子踏在石板地上的脚步声,声音的质地能与画面中的地面材质匹配;叫好声与锣鼓声能有真实的空间混响感。

这对于需要营造沉浸式舞台氛围的戏曲视频,是一个巨大的潜在优势。

但它的“缺点”也很明显:它不太理解“螺旋上升环绕”这种复杂的艺术化运镜指令,它的镜头语言更偏向纪实,而非戏剧性设计。而且,它主要靠“文本描述”驱动,不像Seedance2.0那样可以“喂”给它那么多视频图片直接参考。

如何选择:你的创作流程卡在哪一环?

所以,作为戏曲创作者,你的选择不取决于“哪个AI更懂戏曲”,而取决于你创作流程中的核心痛点是什么。

- 如果你需要快速构思、融合创意、低成本试错:

你应该关注Seedance2.0。它像一位高效的“创意副导演”,能帮你把脑海中的碎片灵感(一段动作、一个脸谱创意、一段鼓点)快速拼接成可视化的动态小样。它的多模态输入支持(3段视频+9张图片+3段音频) 和强劲的中文语境理解能力,让这种快速迭代成为可能。

在第三方评测SeedVideoBench 2.0中,它在多数任务维度排名第一,也印证了其综合能力的强劲[子代理2]。

- 如果你追求最终的视效质感、物理真实和音画一体:

你应该关注Veo3.1的潜力。它更像一个昂贵的“顶级后期特效与音效包”,单次生成成本更高,但首过成功率(即一次就生成可用结果的比例)比Seedance2.0高出20-30%。

当你的剧本、分镜都已确定,需要生成那些对服装动态、物理特效、环境声音有极高要求的“高光片段”时,它的技术路线可能更能满足你对“质感”的苛求。

最终,这两个模型揭示的,是AI进入传统艺术领域的两种路径: 一种是降低创作门槛,激发更多融合性创意;另一种是追求技术极致,为精品内容提供新的制作工具。戏曲视频的AI延伸,目前还没有“标准答案”,但你已经可以根据自己想做的“菜”,去挑选更顺手的“厨具”了。

相关文章