不知道你有没有遇到过这种痛点:

同时对接了OpenAI、Anthropic、Gemini、AWS Bedrock等多家大模型,每家都有不同的SDK、不同的认证方式、不同的调用格式,改来改去烦死了?

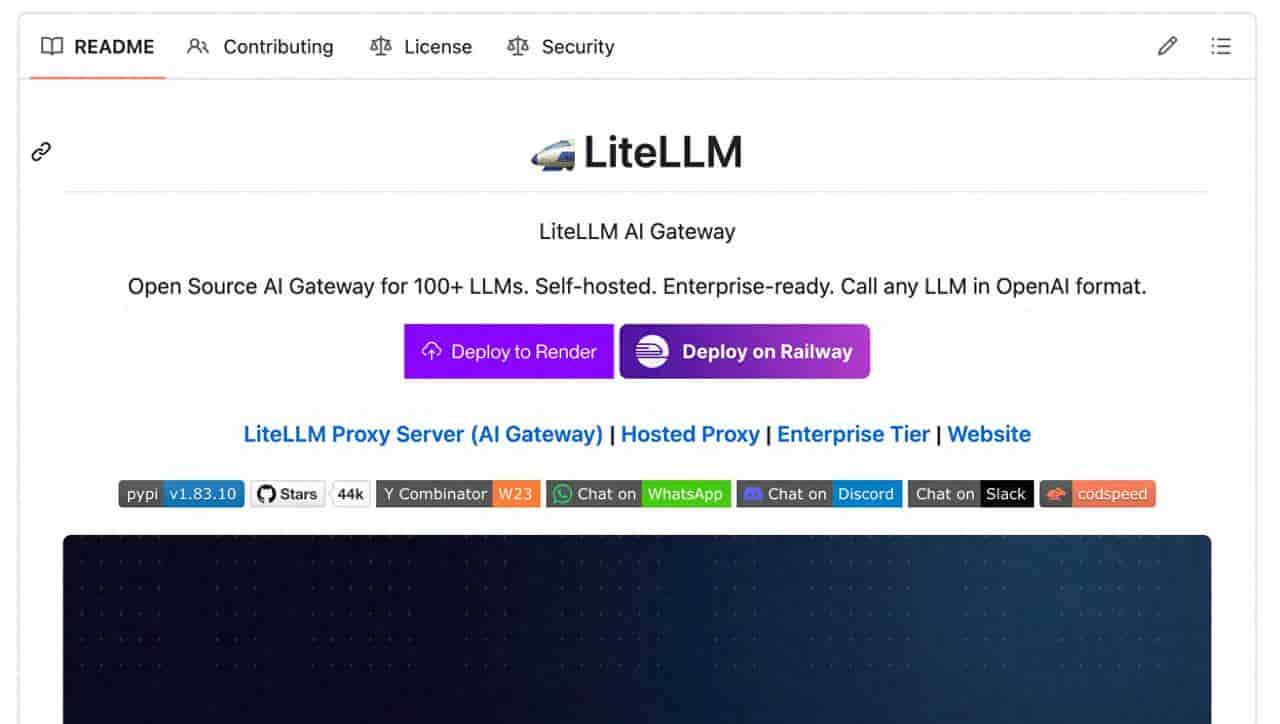

今天给大家推荐一款超级实用的开源神器——LiteLLM,它帮你统一了100+大模型的调用接口,不管你用哪家的模型,都能用完全一致的OpenAI格式调用,省心省力!

目前项目已经斩获 43.9k Star,是Y Combinator孵化项目,Stripe、Netflix都在用,绝对靠谱!

1️⃣ 什么是LiteLLM到底解决了什么问题

开发AI应用时,你是不是常常遇到这些麻烦:

- 每家大模型都要单独集成SDK,代码改到你怀疑人生

- 切换模型供应商,整个调用代码要重写一遍

- 团队多人开发,每个人用不同模型,格式不统一很难维护

- 想要做负载均衡、密钥管理、花费追踪,全都要自己写

LiteLLM就是来解决这些问题的!它是一个开源AI网关,给你提供:

- 统一API接口:100+大模型,全部用OpenAI格式调用

- 可本地部署:完全私有化,数据安全自己掌控

- 企业级功能:虚拟密钥、花费追踪、防护栏、负载均衡开箱即用

- 超低延迟:P95延迟仅8ms @ 1000 QPS,性能拉满

简单说就是:一次对接,全家通吃,所有大模型随意换!

2️⃣ 核心功能拆解

统一接口,开箱即用

LiteLLM支持100+ 大模型提供商,几乎涵盖了你能想到的所有主流模型:

|

厂商 |

支持情况 |

|

OpenAI |

✅ 完整支持 |

|

Anthropic |

✅ 完整支持 |

|

Google Gemini |

✅ 完整支持 |

|

AWS Bedrock |

✅ 完整支持 |

|

Azure OpenAI |

✅ 完整支持 |

|

字节豆包 |

✅ 完整支持 |

|

通义千问 |

✅ 完整支持 |

|

文心一言 |

✅ 完整支持 |

|

DeepSeek |

✅ 完整支持 |

|

Groq |

✅ 完整支持 |

|

本地部署模型 |

✅ 支持VLLM/Ollama等 |

不止聊天补全、嵌入、图片生成、语音转录全都支持,统一接口格式完全和OpenAI一致!

两种使用方式,超级灵活

方式一:直接用Python SDK,快速集成

uv add litellm

代码超简单,不管你调用哪个模型,写法几乎一模一样:

from litellm import completion

import os

# 设置各厂商API Key

os.environ["OPENAI_API_KEY"] = "你的openai-key"

os.environ["ANTHROPIC_API_KEY"] = "你的anthropic-key"

# 调用OpenAI GPT-4o

response1 = completion(

model="openai/gpt-4o",

messages=[{"role": "user", "content": "Hello!"}]

)

# 调用Anthropic Claude,只需要改model名字!

response2 = completion(

model="anthropic/claude-sonnet-4-20250514",

messages=[{"role": "user", "content": "Hello!"}]

)

# 调用DeepSeek,还是一样的写法!

response3 = completion(

model="deepseek/deepseek-chat",

messages=[{"role": "user", "content": "Hello!"}]

)

看到没?**只需要改model名字,其他代码完全不用变!**这就是统一接口的魅力!

方式二:部署AI网关服务,团队共用

如果你想给整个团队统一管理所有大模型调用,LiteLLM提供了开箱即用的代理服务器:

uv tool install 'litellm[proxy]'

litellm --model gpt-4o

启动之后,它会在本地4000端口启动服务,你就可以像调用OpenAI一样调用它:

import openai

client = openai.OpenAI(

api_key="任何字符串",

base_url="http://0.0.0.0:4000"

)

response = client.chat.completions.create(

model="gpt-4o",

messages=[{"role": "user", "content": "Hello!"}]

)

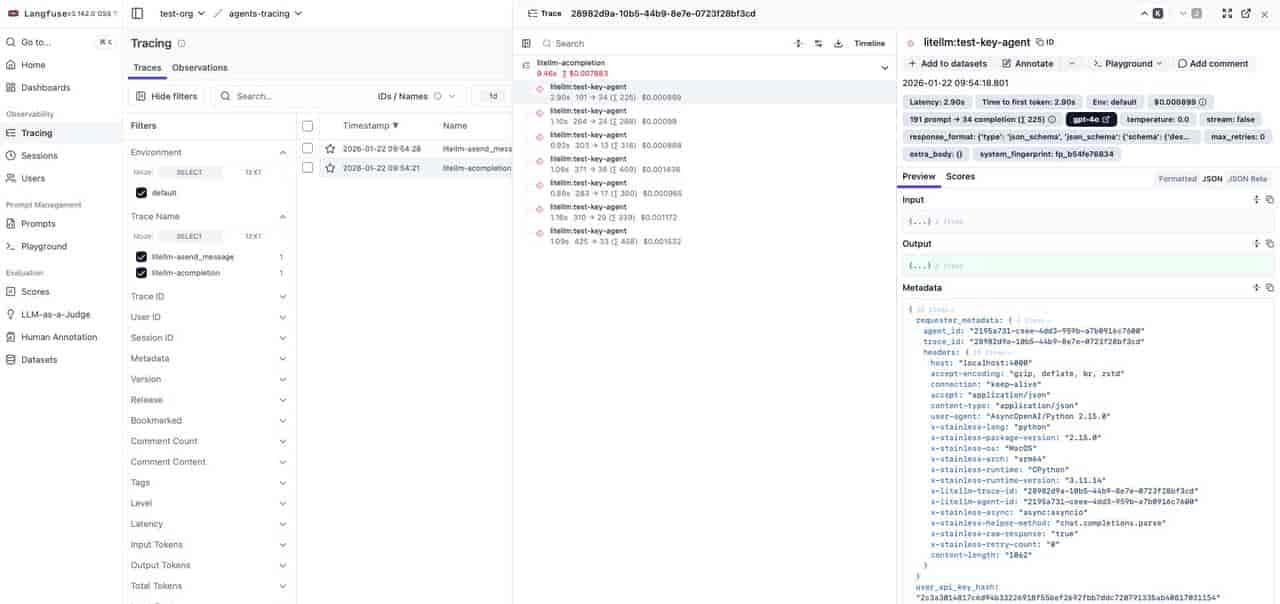

作为团队统一网关的好处太多了:

- ✅ 虚拟密钥管理:给不同团队/项目分发不同密钥,方便管理

- ✅ 花费追踪:谁用了多少钱,一目了然,控制成本

- ✅ 负载均衡:多个API Key轮询,自动分摊压力

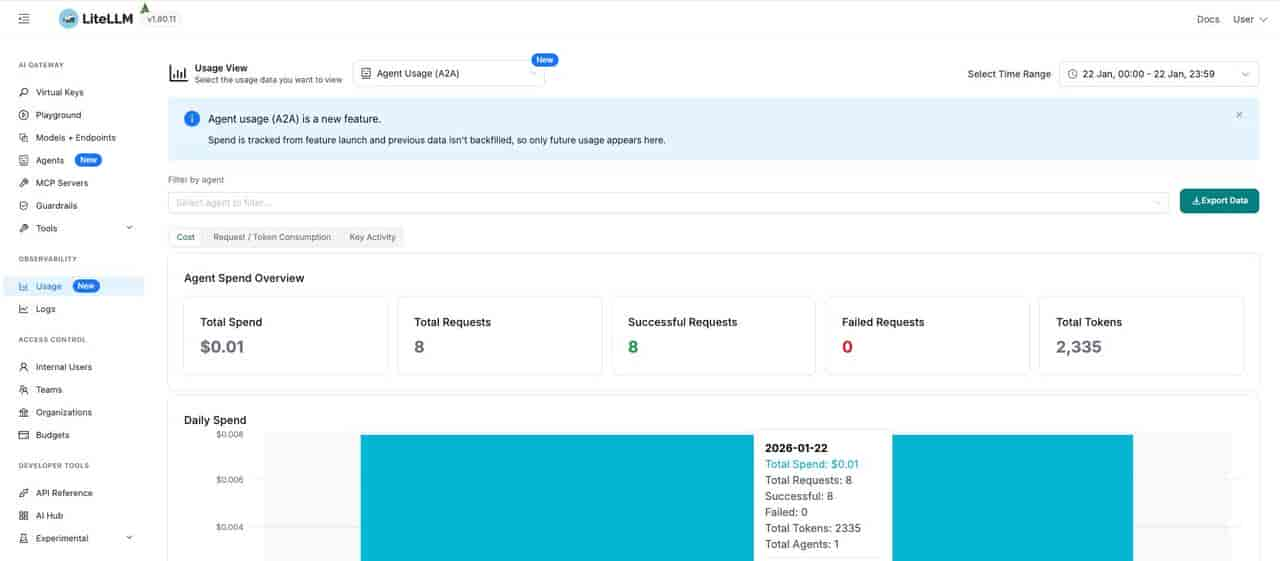

- ✅ 内置管理面板:可视化查看用量、监控请求,超级方便

- ✅ 防护栏:可以设置内容安全防护,防止违规内容

3️⃣ LiteLLM vs 直接调用,优势对比

我整理了一个简单的对比,看看LiteLLM到底好在哪里:

|

功能 |

直接各家SDK |

LiteLLM统一网关 |

|

多模型统一接口 |

❌ 每家格式都不一样 |

✅ 全OpenAI格式 |

|

代码复用 |

❌ 切换模型要重写 |

✅ 只改model名 |

|

密钥统一管理 |

❌ 分散在各个项目 |

✅ 网关统一管控 |

|

花费统计追踪 |

❌ 需要自己做 |

✅ 开箱即用 |

|

负载均衡 |

❌ 需要自己做 |

✅ 开箱即用 |

|

本地私有化部署 |

❌ 不支持 |

✅ 完全支持 |

|

开源免费 |

✅ 部分收费 |

✅ 完全免费 |

看得出来,只要你对接超过1个大模型,LiteLLM绝对是刚需!

4️⃣ 5分钟快速部署教程

我这里说一下用Docker快速部署网关服务,这是最简单的方式:

第一步:创建配置文件

model_list:

- model_name: gpt-4o

litellm_params:

model: openai/gpt-4o

api_key: os.environ/OPENAI_API_KEY

- model_name: claude-sonnet

litellm_params:

model: anthropic/claude-3-5-sonnet-20241022

api_key: os.environ/ANTHROPIC_API_KEY

- model_name: gemini-pro

litellm_params:

model: gemini/gemini-pro

api_key: os.environ/GEMINI_API_KEY

把你的API Key配置到环境变量就好了。

第二步:启动Docker容器

docker run -p 4000:4000

-v $(pwd)/config.yaml:/app/config.yaml

-e OPENAI_API_KEY=your_key

-e ANTHROPIC_API_KEY=your_key

-e GEMINI_API_KEY=your_key

ghcr.io/berriai/litellm:main-latest

三分钟就启动好了!

第三步:测试调用

curl http://localhost:4000/v1/chat/completions

-H "Content-Type: application/json"

-H "Authorization: Bearer sk-1234"

-d '{

"model": "gpt-4o",

"messages": [

{

"role": "user",

"content": "Hello!"

}

]

}'

就这么简单!返回格式跟OpenAI一模一样。

启动之后,你还可以访问 http://localhost:4000/ui 看到管理后台,查看所有模型的使用情况,超级方便。

5️⃣ 谁适合用LiteLLM?

✅ 推荐使用:

- 正在开发AI应用,需要对接多个大模型

- 团队开发,需要统一管理API密钥和花费

- 想自由切换不同厂商,避免被某一家绑死

- 需要私有化部署,对数据安全有要求

- 追求极简开发,不想重复写适配代码

❌ 不推荐使用:

- 只调用一个OpenAI模型,不需要对接多个,那的确 没必要

- 完全不想自己维护服务,那直接调用官方API就行

6️⃣ 总结

LiteLLM真的是一款解决痛点的好工具,统一接口这个想法实则不难,但是做到这么成熟稳定真的不容易。

我觉得它最大的价值就是解耦:你的应用代码和具体的大模型厂商解耦了。今天你用OpenAI,明天想换成Anthropic,后天想换成国产模型,代码完全不用改,只需要改个配置就行。

对于企业团队来说,这个价值更大,统一入口,统一管理,成本可控,数据安全也有保障。

项目完全开源免费,Star增长超级快,社区超级活跃,最近一天一个版本,值得一试!

7️⃣ 互动环节

你目前项目里对接了几个大模型?有没有被不同API格式折磨过吗?欢迎在评论区留言交流!

喜爱这篇文章别忘了点个赞,关注我,持续分享国产开源替代好工具!

相关文章