谷歌Gemini最近又完成了一轮界面调整,这次只动了叠加层和Live功能,主应用首页分毫未改。不少人只把这当成普通的体验优化,但我却注意到一个被忽略的细节:谷歌把快捷交互和深度任务拆成了两条独立产品线。AI助手的竞争,已经从拼模型能力转到拼交互位置了。这种拆分,真的能解决移动AI的核心痛点吗?

手机屏幕上的Gemini交互界面 · 三屏展示Gemini同屏交互的不同状态

双轨制拆分:把碎片时间还给快捷入口

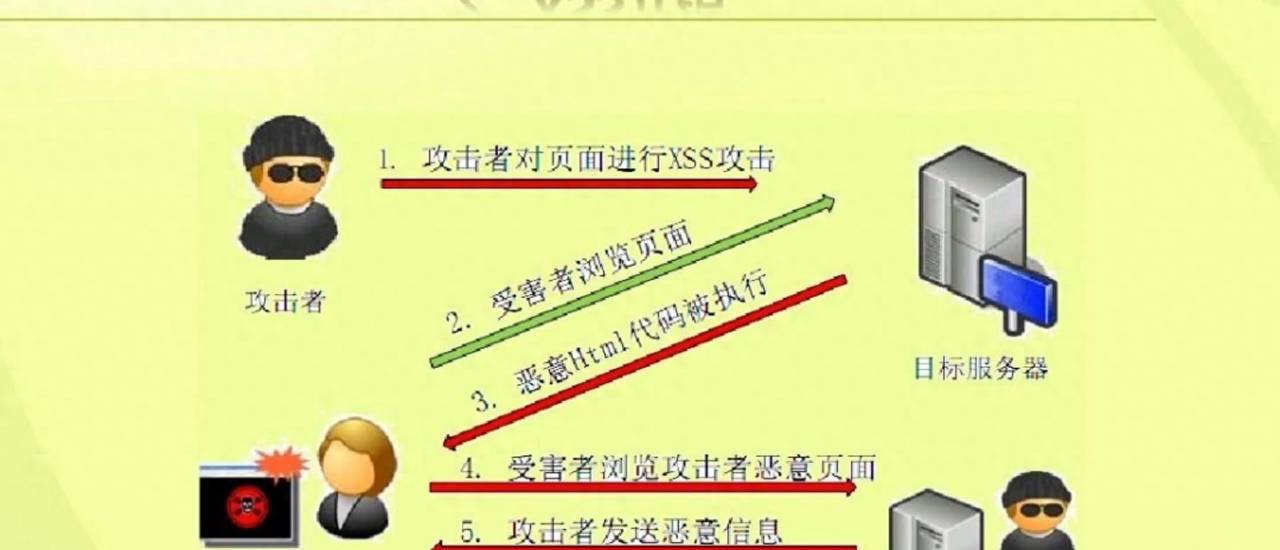

这次更新最值得玩味的一点,是谷歌完全没碰Gemini主应用的首页,所有改动都聚焦在overlay叠加层和Gemini Live。根据披露的产品思路,谷歌已经把这两个模块当成了独立产品线迭代:叠加层负责抢占用户的碎片化时间,主应用则承接深度创作、复杂查询这类重任务。

这种拆分思路实则并不新鲜,国内不少AI产品早就用过类似逻辑,但谷歌这次的执行细节,暴露了和国内厂商完全不同的产品认知。国内AI产品的悬浮窗默认都是全屏唤起,而谷歌这次反其道而行之,非全屏同屏运行才是默认状态。

这个细节刚好戳中了移动AI助手最尴尬的痛点:大多数时候,用户只是想查个信息、捋个思路,并不想彻底放下手头正在做的事。全屏启动AI,本质上还是把AI当成了一个独立应用,而不是系统级的辅助工具。

谷歌把同屏运行做成默认,本质上是把AI从「需要你切换过来的应用」,变成了「趴在当前屏幕上的助手」。这个认知转变,比十项功能更新都更有价值。

好的AI助手不应该抢你的屏幕,它应该帮你做好手头的事。

手机Gemini叠加层界面 · 展示Gemini简洁的叠加层及功能图标

设计细节里的认知反转:去语音中心主义

这次更新里,还有一个小到绝大多数用户都不会注意的改动:麦克风图标从实心改成了描边样式。在谷歌的设计系统里,描边图标的定义是「可交互但非主要行动点」。

这个改动很有意思:Gemini Live本身主打的就是实时语音对话,目前却在入口设计上弱化麦克风的视觉权重。谷歌为什么要这么做?答案实则写在产品数据里——大致率是用户行为反馈显示,移动场景下,用户实则没那么爱对着手机说话。

行业里喊了好几年「语音是AI交互的未来」,目前头部厂商先用实际数据推翻了这个结论。大部分移动场景里,打字输入比语音更低调、更准确,也更符合用户的社交习惯。

这次调整里,谷歌还把「Ask Gemini」字样放大,把输入药丸收窄,本质上是在强化文本输入的核心地位,把打字和语音放在完全平等的位置,不再强制优先推送语音。这种放下执念的调整,反而比强行推新概念更贴近用户真实需求。

另一个值得注意的细节是,这次叠加层把屏幕共享按钮直接放在了一级界面,而非藏进二级菜单。这个功能让Gemini可以实时读取用户当前浏览的内容,配合Live做实时对话,技术门槛不高,但体验打磨极难,延迟、隐私提示、误触发每一个都是坑。谷歌敢把它放在一级入口,说明对体验打磨已经有了足够信心。

多任务进化:从抢占屏幕到后台待命

这次Gemini的更新,还补上了多任务场景最后一块拼图:新增了浮动图标最小化机制。用户目前可以把Gemini窗口最小化成一个底部小图标,让AI在后台独立处理复杂查询,完成后再通过通知提醒用户。

放在过去,用户关闭叠加层就意味着结束会话,想要继续查询就得重新输入一遍问题。新的持久会话机制,彻底解决了这个痛点:你可以让Gemini帮你搜索资料、生成内容,自己先去刷社交软件,等它处理完再回来拿结果。

这个改善看似只是功能小补全,实际是对AI助手定位的又一次修正:AI助手不需要时刻占着你的屏幕,它更应该像个秘书,你交代完任务就可以去忙别的,它办完会主动找你。

|

旧交互模式 |

新交互模式 |

|

必须全屏切换 |

默认同屏运行 |

|

关闭即结束会话 |

后台运行结果通知 |

|

语音优先推荐 |

打字语音平等 |

|

功能藏二级菜单 |

核心功能放一级入口 |

从工程角度看,这个改善并不简单,它依赖Android系统层的代码调整,涉及后台进程管理和通知框架的优化,还要平衡功耗和响应速度,避免AI后台处理过度消耗电池。能落地这个功能,说明谷歌在系统级AI集成上已经走通了核心路径。

手持手机的Gemini界面 · 展示Gemini的Ask Gemini输入栏及Live功能

AI助手的终极形态:看不见,却无处不在

三个月两次改动界面,谷歌对Gemini交互的迭代速度,已经快过了许多人想象。从最开始的独立应用,到浮动胶囊,再到目前的同屏运行、后台持久会话,Gemini正在沿着一条清晰的路径演进:从「独立App」变成「系统级的能力嵌入」。

整个移动AI行业都在慢慢达成一个共识:最好的AI交互,就是用户感觉不到它是一个独立应用。它应该能随时出目前你需要的地方,不打断你的当前任务,用完就可以安静退到后台。

这个方向实则刚好对应了谷歌早在2024年I/O大会上提出的Project Astra愿景:做一个能看见世界、懂你需求的实时通用助手。这次叠加层的屏幕共享功能,本质上就是这个愿景的第一步落地——给Gemini装上眼睛,让它能看懂你屏幕上的内容,和你当前的任务自然衔接。

目前这轮更新还只在beta渠道推送,稳定版还需要等一段时间。但从过去三个月的迭代节奏看,谷歌对Gemini交互的打磨还远没结束,说不定第四版设计已经在路上了。

许多人聊AI,开口就是参数规模、模型能力,但却很少有人聊交互体验。可实际落到普通用户身上,最能影响日常使用感受的,恰恰是交互设计:会不会打断任务、找得到找不到功能、要不要反复切换界面。

当所有巨头都把模型参数卷到顶的时候,交互体验的比拼,才是AI助手真正的决赛场。谷歌提前三个月开始磨细节,这盘棋,下得比许多人想的更远。你更愿意用功能全摊开但有点乱的AI,还是功能藏得深但界面干净的AI?答案实则已经写在每个用户的日常使用习惯里了。

#Gemini##Google##人工智能##AI助手##界面优化#

相关文章