① 没有发布会,但全网都在等它

没有任何预热铺垫,4月24日,DeepSeek-V4预览版直接上线并同步开源。没有倒计时,没有噱头,DeepSeek就这样甩出了时隔15个月的“大招”。消息一出,科技媒体的版面几乎全部让给了它,连OpenAI也沦为了陪衬。

这次发布的两个版本:旗舰版V4-Pro,总参数1.6万亿,对标全球顶级闭源模型;经济版V4-Flash,总参数2840亿,主打极速、低价。两款均默认支持100万token超长上下文,而且——全部开源。

所以,它到底有多能打?实测来了。

② 跑分硬刚闭源巨头,代码能力炸裂

先看硬数据。在Codeforces编程竞赛评测中,V4-Pro-Max拿下了3206分,超过GPT-5.4的3168分和Gemini 3.1 Pro的3052分,创下全新标杆。在LiveCodeBench上,V4-Pro得93.5分,把Claude Opus 4.6的88.8分远远甩在身后。

第三方评测机构Vals AI直接发文:“DeepSeek-V4目前是我们Vibe Code Benchmark上排名第一的开源权重模型,差距明显,甚至击败了Gemini 3.1 Pro这样的前沿闭源模型。”

在Agent能力、世界知识和STEM推理等维度上,V4-Pro均达到了开源模型的领先水平,多项指标比肩全球顶级闭源模型。

③ 性能不是满分,但有个“价格屠夫”的灵魂

DeepSeek很坦诚。技术报告里白纸黑字写着:V4能力水平仍落后于GPT-5.4和Gemini-3.1-Pro,大致3—6个月的差距——这种“主动认输”的姿态在国产大模型圈里实属罕见。

但短板归短板,真正的杀手锏在定价上。

V4-Flash每百万token输出仅2元人民币,约0.28美元。对比一下:Claude Opus 4.7是25美元,GPT-5.5是30美元。DeepSeek的价格只相当于对手的百分之一!

从“高端功能”到“水电煤”级别的公共服务,DeepSeek重新定义了百万上下文的价格坐标。

④ 效率革命:一个字“省”

便宜,不是靠亏钱换来的。技术报告的底层逻辑极其清醒。

V4在百万token场景下做到了极致效率优化:相比上一代V3.2,单token推理算力需求下降73%,KV缓存压缩到原来的十分之一。最新测试中,Light版本的单token算力消耗甚至只有V3.2的10%,显存更是压缩到了7%。

这也让DeepSeek有底气喊出:“从目前开始,1M上下文是所有官方服务的标配!”

换算成日常体验:一次性读完《三体》三部曲的全部内容(约75万汉字),再也不用把长文档切片分段喂给AI了。

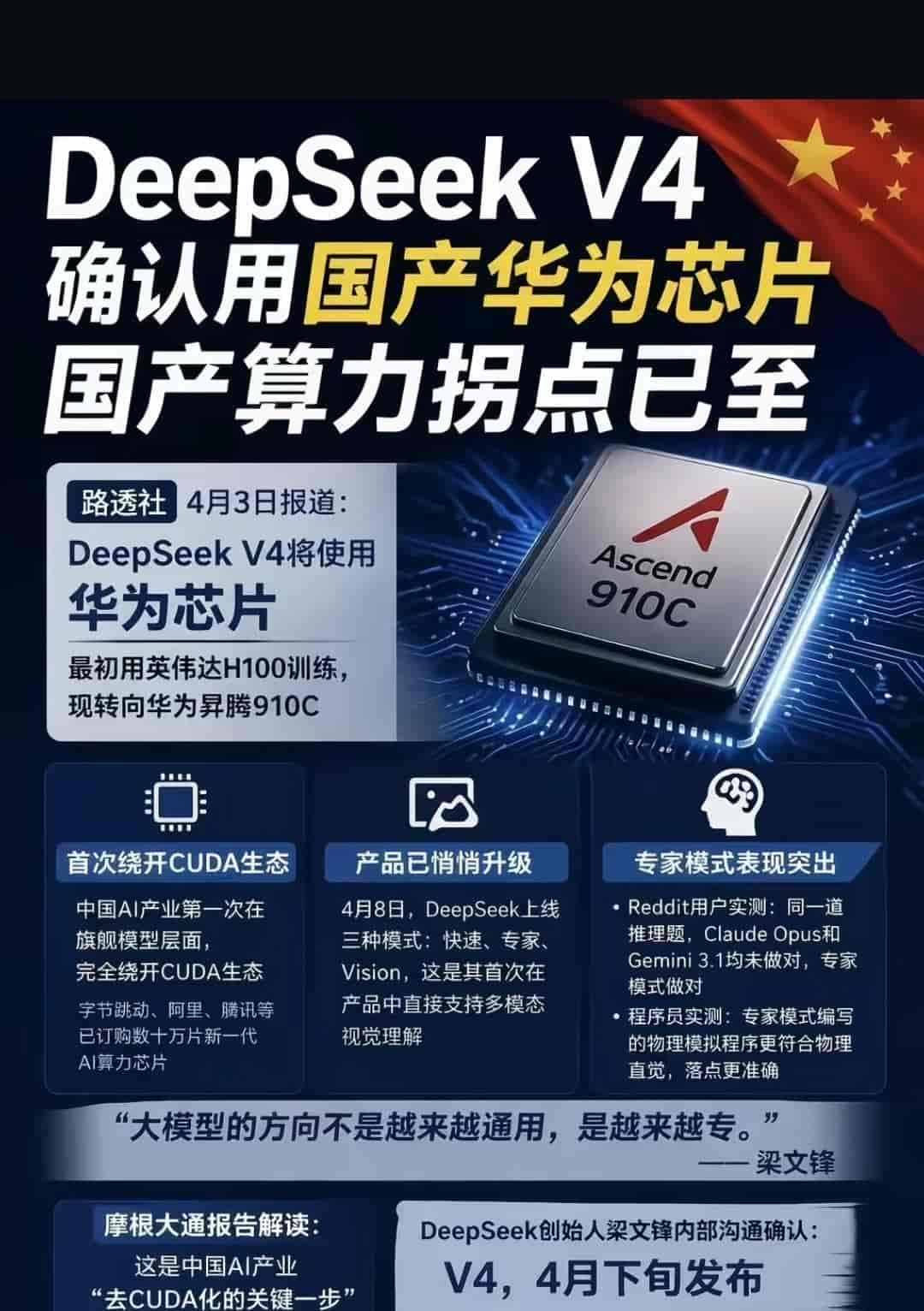

⑤ 国产算力生态全面适配,下半年前景可期

V4已经完成对华为昇腾NPU平台的深度适配,寒武纪也在首日同步完成了V4模型的推理优化。昇腾950超节点批量上市后,V4-Pro的价格还会大幅下调。

至此,DeepSeek的战略意图已再明显不过:极致效率×极致性价比×国产算力协同——V4虽然未必是市面上最强的模型,但它可能是最值得普通开发者和企业上手的那一个。

相关文章