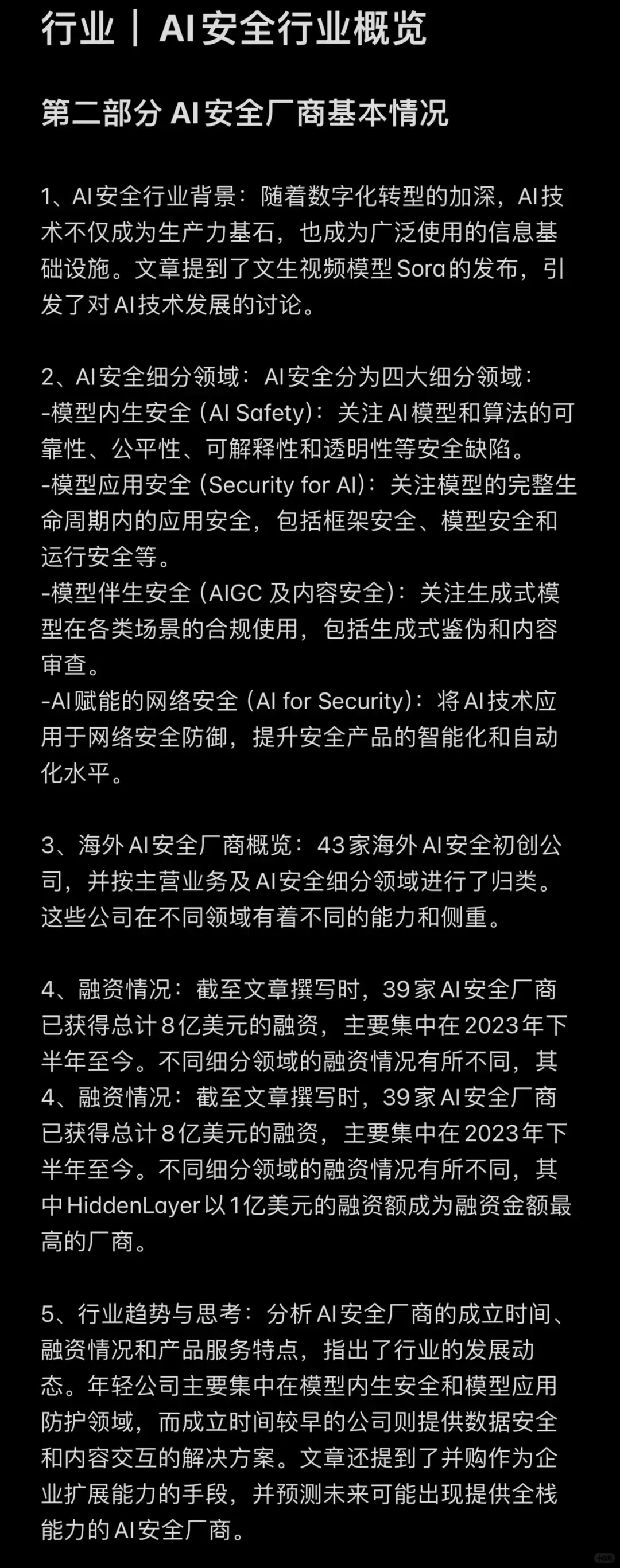

在数字化时代,企业和个人每天都会产生海量的文档数据,从 PDF、Word 等结构化文件到图片、网页等非结构化内容,这些数据分散存储、格式异构,导致信息检索效率低下、知识沉淀困难。传统的关键词检索方式难以理解上下文语义,无法满足复杂场景下的精准查询需求,而大语言模型 LLM 的兴起为文档智能处理提供了新的解决方案,但如何将 LLM 与文档检索高效结合,降低技术落地门槛,成为众多开发者和企业面临的难题。

腾讯开源的 WeKnora(维娜拉)框架应运而生,它基于 RAG 机制,融合多模态预处理、语义向量索引、智能召回与大模型推理,为复杂文档场景提供了端到端的解决方案。作为一款开源框架,WeKnora 打破了商业文档处理工具的垄断,支持本地化部署和灵活扩展,让企业和开发者能够以极低的成本构建智能文档问答系统,加速知识转化与应用,具有极高的技术价值和实践意义。

简介

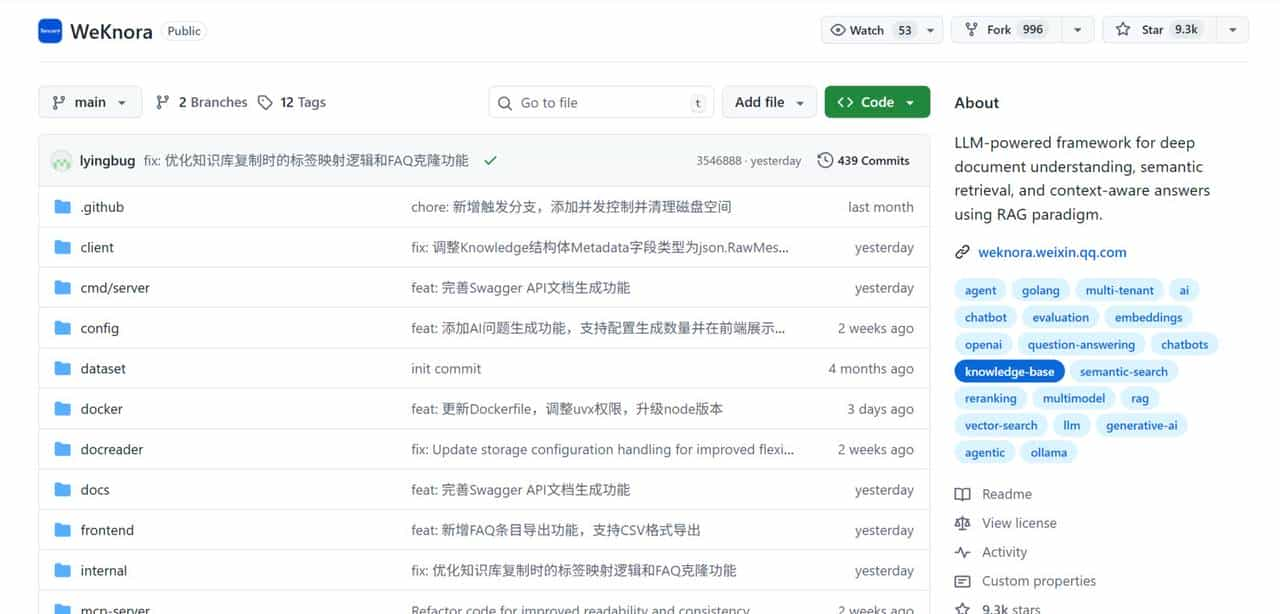

WeKnora 是腾讯推出的一款基于大语言模型的文档理解与语义检索框架,开源仓库地址为

https://github.com/Tencent/WeKnora,采用 MIT 开源协议。该框架专为结构复杂、内容异构的文档场景设计,通过模块化架构实现了文档解析、向量化处理、检索引擎和大模型推理等核心功能的解耦,支持灵活配置与扩展,适配不同行业和场景的个性化需求。

WeKnora 构建了完整的文档处理流水线:第一通过 OCR、布局分析等技术完成多格式文档的解析与结构化提取,再经过分块、向量化处理将文档转化为语义向量,存储于 PostgreSQL(pgvector)、Elasticsearch 等主流向量数据库中;检索阶段采用混合策略,结合关键词检索(BM25)、稠密检索(Dense Retrieve)和知识图谱检索(GraphRAG),确保检索结果的精准性和全面性;最后通过 LLM 与 ReACT Agent 模式的结合,实现上下文感知的多轮对话与智能问答。此外,框架还集成了 MQ 异步任务管理、数据库自动迁移、Docker 容器化部署等基础设施,保障系统的稳定性和可运维性。

WeKnora 的核心用途是解决复杂文档的理解与检索问题,支持 FAQ 和文档两种类型的知识库,可处理 PDF、Word、Txt、Markdown、图片等多种格式的文件,满足不同场景下的知识管理需求。在应用场景方面,它覆盖了企业知识管理、科研文献分析、产品技术支持、法律合规审查、医疗知识辅助等多个领域:企业可通过它构建内部文档检索系统,实现规章制度问答、操作手册查询,提升知识查找效率;科研人员可利用其快速检索论文、分析研究报告,加速文献调研进程;产品团队可搭建技术支持平台,自动响应用户的产品手册咨询和故障排查需求;法律和医疗行业则可通过它实现合同条款检索、诊疗指南查询等专业场景的应用。

值得一提的是,WeKnora 作为微信对话开放平台的核心技术框架,支持零代码部署,用户只需上传知识即可在微信生态中快速部署智能问答服务,无缝集成到公众号、小程序等场景中。同时,框架还支持通过 MCP 扩展 Agent 能力,内置 uvx、npx 启动工具,兼容 Stdio、HTTP Streamable、SSE 等多种传输方式,可灵活对接外部工具与服务,进一步拓展了应用边界。

使用

使用 WeKnora 前,需先确保本地环境满足以下要求:已安装 Docker、Docker Compose 和 Git 工具,提议使用 Linux 或 MacOS 系统以获得最佳兼容性,Windows 系统需开启 WSL2 支持。

第一克隆代码仓库。打开终端,执行以下命令将 WeKnora 源码克隆到本地,并进入项目目录:

git clone https://github.com/Tencent/WeKnora.git

cd WeKnora然后配置环境变量。项目提供了示例配置文件.env.example,需先复制该文件并修改为.env,根据实际需求配置相关参数:

cp .env.example .env编辑.env 文件时,主要配置项包括数据库连接信息、向量数据库类型、LLM 模型地址、API 密钥等,所有配置项均有详细注释,可根据注释说明填写。

完成后启动服务。WeKnora 支持多种功能组合的启动方式,可根据需求选择对应的命令:

# 启动最小功能(仅核心服务,不含知识图谱、文件存储等扩展功能)

docker compose up -d

# 启动全部功能(包含 Neo4j、MinIO、Jaeger 等所有扩展服务)

docker-compose --profile full up -d

# 按需启动特定功能组合,如同时启用 Neo4j 和 MinIO

docker-compose --profile neo4j --profile minio up -d启动成功后,终端会显示各服务的启动状态,等待约 1-2 分钟待服务初始化完成即可访问。服务启动后,可通过以下地址访问相关功能:

- Web UI:http://localhost(推荐使用 Chrome、Edge 等现代浏览器)

- 后端 API:http://localhost:8080

- 链路追踪(Jaeger):http://localhost:16686

首次访问 Web UI 时,系统会自动跳转到注册登录页面,需完成账号注册(输入用户名、密码、邮箱等信息),注册成功后登录系统。

初始化配置

登录后,需先创建知识库并完成初始化配置,步骤如下:

- 点击页面左侧 “知识库” 菜单,选择 “新建知识库”,填写知识库名称、描述,选择知识库类型(FAQ 或文档型),点击 “创建”。

- 进入知识库配置页面,完成以下关键配置:

- 模型配置:选择嵌入模型(如 BGE、GTE 或本地模型)和对话模型(如 Qwen、DeepSeek、Ollama 部署的模型等)。

- 检索配置:设置检索阈值(默认 0.7,数值越高检索结果越精准)、检索策略(可选择混合检索、向量检索等)。

- 对话策略:配置 Agent 模式和普通模式的 Prompt 模板,设置 Agent 最大迭代次数(默认 15 次)、温度参数(默认 0.7,控制输出随机性)等。

配置完成后,点击 “保存配置”,知识库即创建成功,可开始上传文档或录入知识。

文档导入与知识库管理

WeKnora 支持多种文档导入方式,包括拖拽上传、文件夹导入、URL 导入和在线录入,操作流程如下:

- 拖拽上传:直接将本地 PDF、Word、图片等文件拖拽到知识库页面的 “上传区域”,系统会自动解析文件内容并建立索引,上传进度实时显示在页面上。

- 文件夹导入:点击 “导入文件夹”,选择本地文件夹,系统会批量导入文件夹内的所有支持格式文件,适合批量上传多份文档。

- URL 导入:点击 “URL 导入”,输入网页地址(如技术文档、博客文章的 URL),系统会爬取网页内容并转化为文档存入知识库,支持批量输入多个 URL。

- 在线录入:对于 FAQ 类型知识库,可点击 “在线录入”,手动输入问题和答案,支持批量录入和标签管理,便于快速构建问答库。

文档导入完成后,系统会自动进行分块、向量化处理,并建立检索索引。在知识库管理页面,可查看所有文档的处理状态(待处理、处理中、已完成、处理失败),对已导入的文档进行编辑、删除、标签管理等操作。例如,可为文档添加自定义标签,便于后续按标签筛选检索;支持文档批量操作,提高管理效率。

智能问答与 Agent 模式使用

WeKnora 支持两种对话模式:普通模式和 Agent 模式,可在对话输入框上方切换。

- 普通模式:适用于简单的文档检索与问答,直接输入问题即可获得答案。例如,上传产品手册后,输入 “如何重置管理员密码?”,系统会检索相关文档片段并生成精准回答。

- Agent 模式:支持复杂任务处理,可调用内置工具、MCP 工具和网络搜索,通过多次迭代和反思给出全面总结报告。使用步骤如下:

- 切换到 Agent 模式,输入复杂查询,例如 “整理 2025 年热门游戏推荐,按 PC、主机、移动端分类”。

- 系统会自动分析问题,制定检索计划,调用知识库检索工具、网络搜索工具(如 DuckDuckGo)获取相关信息,过程中会显示 “思考中”“检索知识库”“调用工具” 等状态。

- 若需跨知识库检索,可在对话输入框左侧选择多个知识库,Agent 会同时检索所选知识库的内容。

- 检索完成后,Agent 会整合所有相关信息,生成结构化的回答(如表格、分点总结等),并展示检索过程和信息来源,便于验证答案的准确性。

总结

WeKnora 作为腾讯开源的 LLM 文档理解检索框架,凭借模块化架构设计和丰富的功能特性,构建了从文档解析、向量化处理到智能检索、问答生成的完整链路。其核心优势在于融合了多模态预处理、混合检索策略和 ReACT Agent 模式,能够高效处理结构复杂、内容异构的文档数据,支持 FAQ 和文档两种知识库类型,兼容多种格式文件和主流向量数据库,同时提供灵活的扩展能力和安全可控的部署方式。无论是企业内部的知识管理、科研领域的文献分析,还是产品技术支持、法律医疗等专业场景的应用,WeKnora 都能提供精准、高效的解决方案,协助用户打破信息孤岛,释放数据价值。

从应用价值来看,WeKnora 不仅降低了智能文档处理技术的落地门槛,让中小企业和开发者无需从零构建复杂的 LLM 应用,还通过开源社区的力量持续迭代优化,不断丰富功能模块和适配场景。其支持的本地化部署和私有云部署模式,确保了数据的安全性和自主性,满足了企业对于敏感信息保护的需求;而微信对话开放平台的集成能力,则为微信生态内的应用提供了便捷的智能问答解决方案,进一步拓展了框架的应用场景。随着大语言模型技术的不断发展,WeKnora 有望在知识管理、智能检索等领域发挥更大的作用,成为连接文档数据与 LLM 的核心桥梁,为各行各业的数字化转型提供有力支撑。

相关文章