香港大学黄超教授团队近期开源了视频生成框架ViMax!

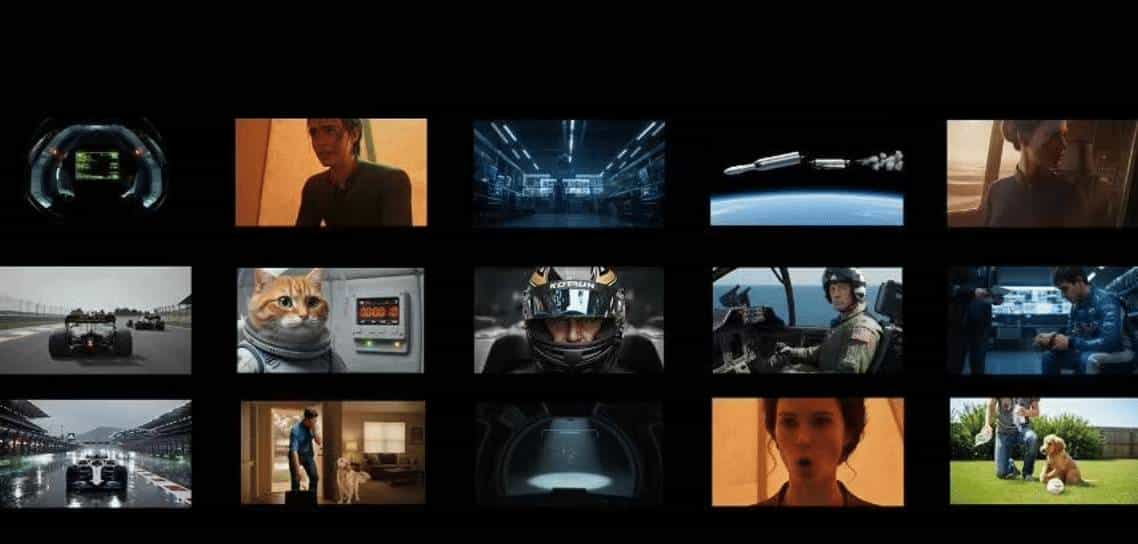

它整合了导演、编剧、制片人和视频生成器的功能,支持Idea2Video、Novel2Video、Script2Video 和 AutoCameo 等模式,通过智能分镜、多摄像机模拟和自动化一致性检测等技术,自动生成分钟级长视频并保持人物与场景一致性。

破解长视频两大核心瓶颈

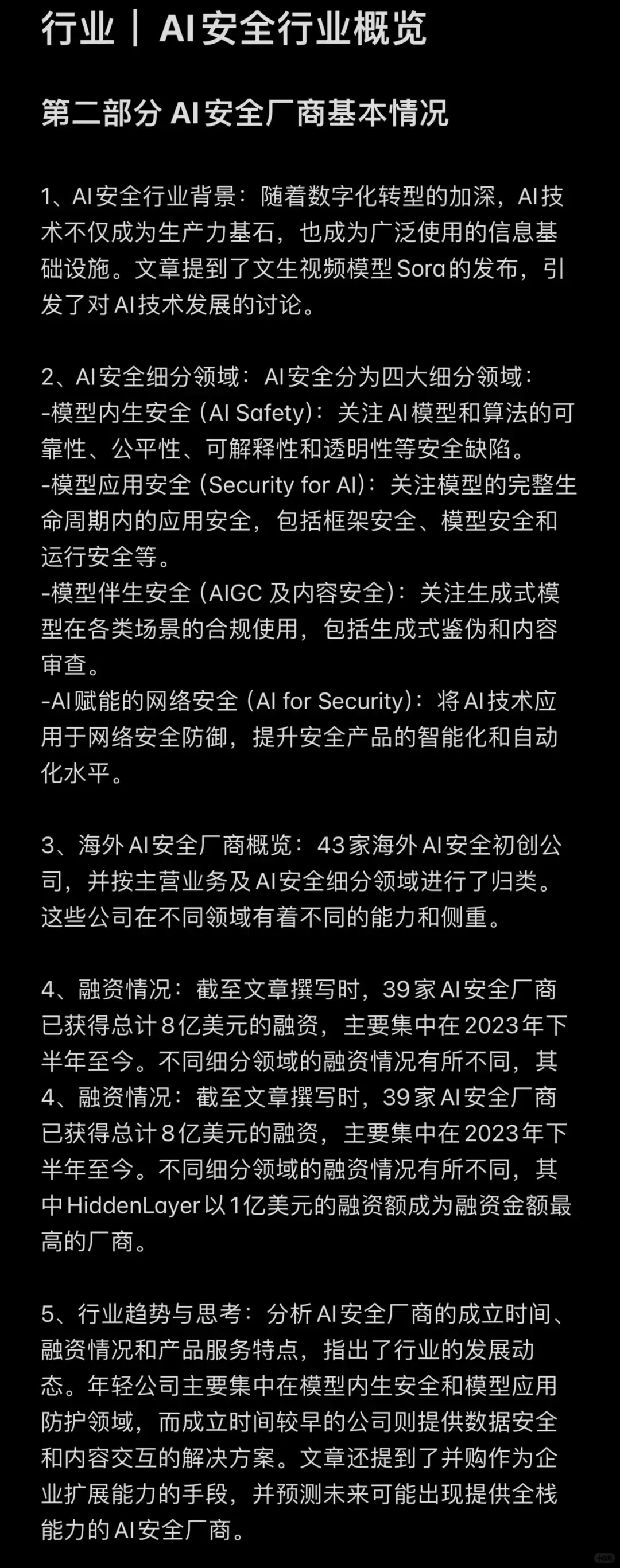

当前主流文本到视频模型如Sora、Runway等在短片段生成上表现优异,但在长视频制作中面临核心挑战:

1.叙事规划的复杂度爆炸:长视频需要统筹数百个镜头的叙事逻辑,涉及角色发展、情节推进和主题呼应等多维度考量,这超出了语言模型的单轮处理极限。

2.跨镜头视觉连贯性难题:现有生成模型缺乏对前序内容的记忆能力,导致角色形象、场景风格在不同镜头间频繁变脸,严重影响观感。

而ViMax采用 “事件 – 场景 – 镜头” 三层递归分解策略,将复杂故事拆解为可执行的模块,再通过 RAG 检索增强技术构建全局知识库,确保角色性格、情节逻辑不跑偏。

三层递归规划(事件-场景-镜头):

ViMax采用递归分解策略,将剧本自上而下分解为事件层、场景层和镜头层。这种分层处理让每个层级的规划任务都保持在可控范围内,有效驯服了长视频的叙事复杂性。

RAG增强全局知识库:

集成检索增强生成技术,在剧本分解和内容生成的每个阶段,动态检索和利用背景知识库信息,有效避免角色性格前后矛盾、情节逻辑漏洞等问题。

视觉元素图网络与过渡生成:

ViMax构建了一个视觉元素依赖关系图,智能地决定哪些镜头可以并行生成,哪些需要按顺序生成。对于同一场景的多角度镜头,它创新性地引入过渡视频生成技术,先生成视角间的平滑过渡视频作为几何基准,确保不同镜头中的空间关系严格一致,彻底解决变脸和场景跳变问题。

多智能体协同

ViMax则采用分层协作设计,将视频制作分解为五个专业阶段:

- 剧本创作:将用户输入(一句话想法、小说或剧本片段)转化为标准影视剧本

- 分镜规划:运用专业电影理论设计镜头语言、摄像机运动和光影布局

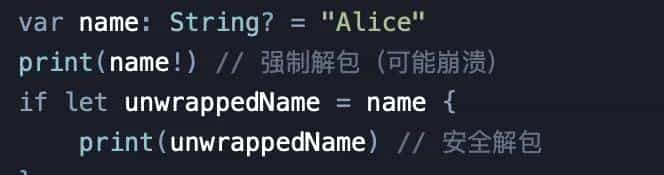

- 视觉资产生成:采用“先图后视频”策略,确保视觉风格精准控制

- 质量把控:并行生成多个版本,由质检智能体筛选最优结果

- 统筹协调:导演智能体监控全流程,维护风格统一和任务同步

应用场

短视频制作:创作者快速将创意转化为短视频,用于社交媒体平台(如抖音、B站等)。

教育视频:将复杂的教学内容转化为生动的视频,协助学生更好地理解和记忆。

互动视频:通过 AutoCameo 功能,用户将自己的形象融入视频,增加互动性和趣味性。

小说可视化:将长篇小说改编为视频内容,为文学作品提供新的传播形式。

个人故事视频:用户将自己的故事或创意转化为视频,用于个人纪念或分享。

GitHub:https://github.com/HKUDS/ViMax

#AI开源项目推荐##github##AI技术##ai视频生成##AI工具#

相关文章