大数据编目:数据治理的“导航地图”——从概念到实践的全解析

副标题:理解关键作用、应用场景与落地步骤

摘要/引言

你有没有遇到过这样的场景?

产品经理要做用户行为分析,找了3天还没找到“用户浏览记录”表,因为它在5个不同的数据库里有3个重复版本;运维工程师排查数据异常,发现“订单金额”字段被修改过,但没人知道是谁改的、什么时候改的;安全团队要 audit 敏感数据,却根本说不清哪些表包含“身份证号”“银行卡号”——因为没有统一的标注。

这些问题的根源,不是企业没有数据,而是数据没有“地图”。而大数据编目,就是解决这些痛点的“数据导航地图”。

本文将回答三个核心问题:

大数据编目到底是什么?为什么它是数据治理的核心?编目在实际场景中能解决哪些具体问题?如何用开源工具快速搭建一个基础的编目系统?

读完本文,你将:

彻底理解编目在数据治理中的“地基作用”;掌握编目的核心组件(元数据、分类、标签、血缘);能用 Apache Atlas 完成一个简单的编目实践;避免编目落地时的常见“坑”。

目标读者与前置知识

目标读者

数据治理初学者(产品/运营/技术):想理解编目的价值和落地方法;数据产品经理:需要设计编目功能或对接治理工具;运维/开发工程师:负责数据平台的搭建与维护;安全/合规人员:关注敏感数据的管理与审计。

前置知识

了解基础数据概念(数据库、表、字段、SQL);听过“数据治理”的基本目标(如数据质量、数据安全、数据共享);会用 Docker(可选,用于快速部署工具)。

文章目录

引言与基础为什么需要大数据编目?——企业数据的四大痛点大数据编目的核心:四个“关键词”编目在数据治理中的三大关键作用真实场景:编目能解决哪些问题?实践:用 Apache Atlas 搭建基础编目系统优化:从“能用”到“好用”的最佳实践常见问题与避坑指南未来:编目的智能化趋势总结

一、为什么需要大数据编目?——企业数据的四大痛点

在讲编目之前,我们先直面企业数据的四大核心痛点:

痛点1:数据“找不到”——数据孤岛与重复建设

企业的数据通常分散在:

业务数据库(MySQL、Oracle);数据仓库(Hive、Snowflake);湖仓一体平台(Databricks、Iceberg);甚至Excel表格和CSV文件里。

没有编目的话,用户想找“用户订单”数据,可能要问遍5个部门,查10个系统,最后发现有3个重复的表——数据的“可发现性”为0。

痛点2:数据“看不懂”——元数据缺失

即使找到数据,你可能还是不知道:

这个表是做什么的?(“user_info”到底是用户基本信息还是用户行为?)字段含义是什么?(“amt”是“金额”还是“数量”?单位是元还是美元?)数据的所有者是谁?(出了问题该找谁?)

这些信息叫做元数据(Metadata),没有元数据的话,数据就是“无意义的字符串”。

痛点3:数据“不敢用”——信任危机

如果数据经常出错:

“订单金额”昨天是100万,今天变成1亿,却没人知道原因;“用户年龄”里有“200岁”的异常值;敏感数据(如身份证号)没有加密,随便就能下载。

用户会对数据失去信任,宁愿用Excel手动统计,也不用系统里的“大数据”。

痛点4:数据“不好管”——合规与安全风险

GDPR、《个人信息保护法》等法规要求企业:

知道“敏感数据在哪里”;能追踪“数据的流向”(比如从用户表到报表的过程);能审计“谁访问了数据”。

没有编目的话,这些要求根本无法满足——你连“敏感数据在哪”都不知道,更别说管控了。

结论:

编目的本质,是解决“数据的可发现性、可理解性、可信任性、可管性”——这正是数据治理的核心目标。

二、大数据编目的核心:四个“关键词”

很多人对编目的理解停留在“给数据打标签”,但其实编目是一个系统工程,核心包含四个组件:

1. 元数据(Metadata)——数据的“身份证”

元数据是“描述数据的数据”,比如:

技术元数据:表名、字段名、数据类型、存储位置、更新频率;业务元数据:表的业务含义(“用户订单表”)、字段解释(“order_amt:订单总金额,单位元”)、所有者(“张三,电商业务部”);操作元数据:谁修改了表结构、什么时候查询过数据、数据的访问量。

举个例子:

| 元数据类型 | 内容 |

|---|---|

| 技术元数据 | 表名:user_order;存储位置:Hive 数据仓库;更新频率:每小时 |

| 业务元数据 | 含义:记录用户的电商订单信息;所有者:电商运营部 李四 |

| 操作元数据 | 最后修改时间:2024-05-01 10:00;最近7天访问次数:12次 |

2. 分类(Classification)——数据的“货架”

分类是给数据“分组”,就像图书馆的“文学类→小说→科幻小说”货架。企业常见的分类方式:

业务域分类:按业务线划分(电商:用户、订单、商品;金融:账户、交易、风控);数据类型分类:按存储形态划分(结构化数据:MySQL表;半结构化:JSON日志;非结构化:图片/视频);生命周期分类:按数据的“年龄”划分(实时数据:最近1小时;历史数据:超过1年)。

3. 标签(Tag)——数据的“关键词”

标签是更灵活的“属性标注”,用于补充分类无法覆盖的信息,比如:

敏感标签:“身份证号”“银行卡号”(用于合规审计);质量标签:“高质量”“待清洗”(用于数据使用者判断可信度);场景标签:“用户画像”“报表用”(用于快速定位特定场景的数据)。

注意:分类是“树形结构”(有层级),标签是“平面对象”(无层级),两者结合才能让数据更易发现。

4. 数据血缘(Data Lineage)——数据的“家谱”

血缘是记录数据的“来龙去脉”:

数据从哪里来?(比如“订单统计报表”来自“user_order”表和“product_info”表);数据到哪里去?(比如“user_order”表被用来生成“用户复购率”和“库存预警”报表);数据怎么变的?(比如“order_amt”字段是通过“price * quantity”计算得到的)。

血缘的价值在于追踪数据异常(比如报表错了,能快速定位是源表还是计算逻辑的问题)和合规审计(比如敏感数据被哪些报表使用了)。

总结:

大数据编目=元数据+分类+标签+血缘——这四个组件共同构成了数据的“导航地图”。

三、编目在数据治理中的三大关键作用

数据治理的目标是“让数据成为资产”,而编目是实现这个目标的地基,核心作用有三个:

1. 数据可发现:从“大海捞针”到“精准定位”

编目就像数据的“搜索引擎”——用户输入“用户订单”,能快速找到:

所有相关的表(按业务域分类);每个表的含义、所有者、更新频率(元数据);是否包含敏感字段(标签);被哪些报表使用(血缘)。

案例:某零售企业用编目后,数据查找时间从平均2天缩短到10分钟,数据重复率降低了40%。

2. 数据可理解:从“猜数据”到“信数据”

编目解决了“数据的歧义问题”——比如:

之前“user_info”表有3个版本,有人以为是“用户基本信息”,有人以为是“用户行为日志”;编目后,每个表都有明确的业务描述、字段解释和质量标签,使用者能快速判断“这个数据能不能用”。

案例:某金融企业用编目后,数据质量问题的投诉率下降了60%,因为用户能看到“待清洗”标签,不会用错数据。

3. 数据可管:从“被动救火”到“主动治理”

编目是数据治理的“指挥中心”:

安全治理:通过敏感标签快速定位所有含“身份证号”的表,统一设置访问权限;质量治理:通过质量标签统计“待清洗”数据的占比,推动数据团队优先处理;合规治理:通过血缘追踪敏感数据的流向,生成合规报告(比如GDPR要求的“数据流向审计”)。

四、真实场景:编目能解决哪些问题?

我们用三个真实场景,看编目如何解决具体问题:

场景1:数据查找——产品经理要做“用户复购率”分析

痛点:产品经理不知道哪个表有“用户购买记录”,问了3个开发,得到5个不同的表,最后发现有2个是重复的,1个是过时的。

编目解决方案:

产品经理在编目系统搜索“用户购买”;找到“user_order”表(业务域:电商→订单;标签:高质量、用户复购率用);查看元数据:“记录用户的所有订单信息,所有者:电商运营部,更新频率:每小时”;查看血缘:该表被用来生成“用户复购率”报表(确认数据来源正确)。

结果:产品经理10分钟找到正确数据,分析效率提升80%。

场景2:数据异常排查——运维工程师发现“订单金额”不对

痛点:报表显示“订单总金额”比昨天高了50%,但不知道是源表数据错了,还是计算逻辑错了。

编目解决方案:

查看“订单总金额”报表的血缘:来自“user_order”表的“order_amt”字段;查看“order_amt”的血缘:是“price * quantity”计算得到的;检查源表“product_info”的“price”字段:发现昨天有一个商品的价格被错误地从100元改成了1000元;追踪修改记录:是运营人员误操作,通过元数据的“操作日志”找到责任人。

结果:异常排查时间从4小时缩短到30分钟,避免了决策错误。

场景3:合规审计——安全团队要检查“身份证号”的使用情况

痛点:安全团队不知道哪些表包含“身份证号”,更不知道这些数据被哪些系统使用了,无法满足GDPR的审计要求。

编目解决方案:

在编目系统搜索标签“身份证号”,找到所有含敏感字段的表(比如“user_info”“customer_register”);查看每个表的血缘:这些表被用来生成“用户画像”报表和“实名认证”接口;生成审计报告:列出敏感数据的来源、使用者、访问记录,满足合规要求。

结果:安全团队第一次完成了全链路的敏感数据审计,合规通过率从60%提升到100%。

四、实践:用 Apache Atlas 搭建基础编目系统

讲了这么多理论,我们来做个小实践——用开源工具 Apache Atlas 搭建一个基础的编目系统。

Apache Atlas 是Hadoop生态的元数据管理工具,支持:

自动采集元数据(从Hive、MySQL、Spark等数据源);自定义分类与标签;自动生成数据血缘;搜索与发现功能。

环境准备

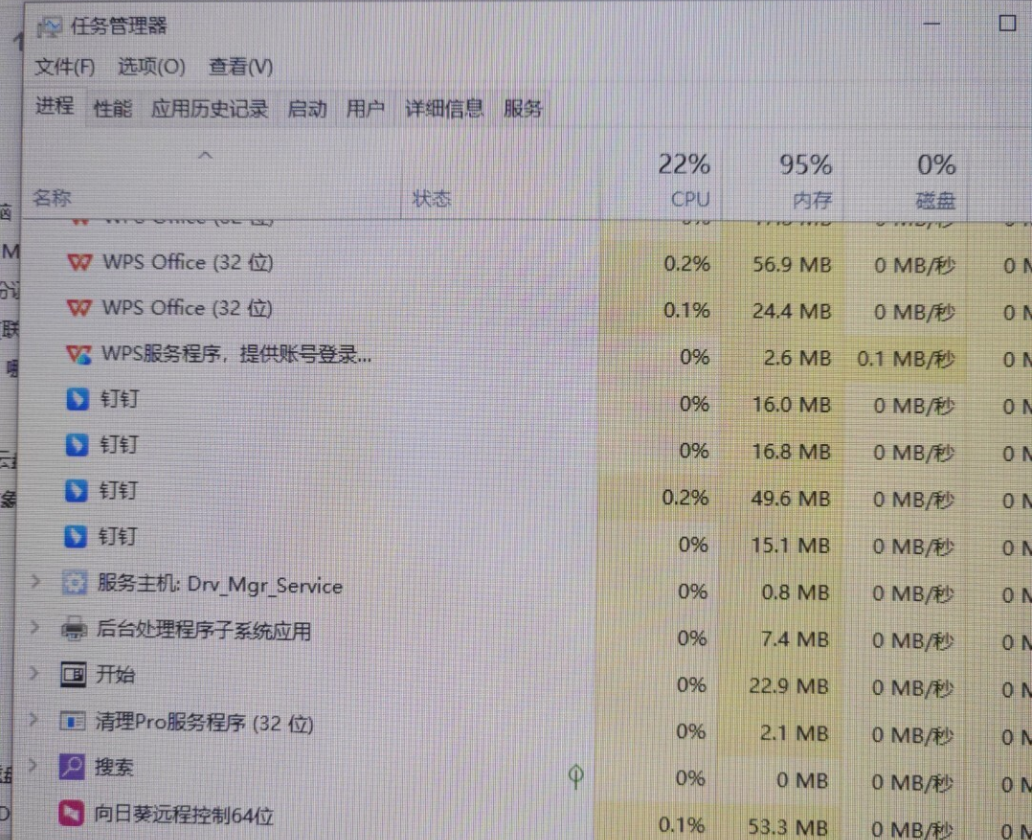

我们用 Docker 快速部署 Atlas(避免复杂的环境配置):

安装 Docker(参考Docker官网);拉取 Atlas 镜像:

docker pull apache/atlas:2.3.0

启动 Atlas 容器(映射端口21000):

docker run -d -p 21000:21000 --name atlas apache/atlas:2.3.0

访问 Atlas UI:打开浏览器,输入

http://localhost:21000

admin/admin

步骤1:接入数据源——采集MySQL的元数据

Atlas 支持自动采集多种数据源的元数据,我们以 MySQL 为例:

准备MySQL数据源:假设你有一个MySQL数据库,里面有

user_order

order_id

user_id

product_id

order_amt

进入Atlas容器:

docker exec -it atlas /bin/bash

mysql-connector-java-8.0.33.jar

/opt/apache-atlas-2.3.0/server/webapp/atlas/WEB-INF/lib/

/opt/apache-atlas-2.3.0/conf/atlas-application.properties

# MySQL 数据源配置

atlas.discovery.catalog.enabled=true

atlas.discovery.catalog.provider=mysql

atlas.discovery.catalog.mysql.url=jdbc:mysql://your-mysql-host:3306/your-db-name

atlas.discovery.catalog.mysql.user=your-username

atlas.discovery.catalog.mysql.password=your-password

重启Atlas:

docker restart atlas

user_order

步骤2:补充业务元数据——让数据“能看懂”

自动采集的元数据只有技术信息(比如字段类型),需要手动补充业务信息:

打开

user_order

步骤3:添加标签——标记敏感数据

假设

order_amt

user_id

打开

user_order

user_id

user_id

order_amt

步骤4:构建数据血缘——追踪数据的“来龙去脉”

Atlas 支持通过 SQL 解析自动生成血缘,我们以“订单统计报表”为例:

假设你用Spark SQL生成报表:

CREATE TABLE order_stat AS

SELECT user_id, SUM(order_amt) AS total_amt

FROM user_order

GROUP BY user_id;

配置Atlas的Spark连接器:参考MySQL的配置方法,添加Spark的JDBC驱动和配置;运行Spark任务:Atlas会自动解析SQL,生成血缘关系;查看血缘:在Atlas UI的“Lineage”页面,选择

order_stat

user_order

total_amt

order_amt

步骤5:搜索与发现——体验编目的价值

现在,你可以像用户一样使用编目系统:

在Search框输入“用户订单”,找到

user_order

user_id

order_amt

order_stat

五、优化:从“能用”到“好用”的最佳实践

上面的实践让你搭建了一个“能用”的编目系统,但要让它“好用”,还需要做这些优化:

1. 统一标签与分类体系——避免“各自为政”

问题:如果每个部门自己定义标签(比如A部门叫“敏感数据”,B部门叫“隐私数据”),会导致标签混乱,无法跨部门搜索。

解决方案:

制定企业级的分类标准:比如按业务域(电商→订单→用户订单)、按数据类型(结构化→MySQL→user_order);制定通用标签库:比如敏感标签(身份证号、银行卡号)、质量标签(高/中/低质量)、场景标签(报表用、分析用);定期审核:每月检查标签的使用情况,合并重复标签,删除过时标签。

2. 自动采集优先,手动补充为辅——提升效率

问题:手动录入元数据太耗时(比如1000张表,每张表要填5个字段,需要5000次操作)。

解决方案:

优先用自动采集工具:比如Atlas支持Hive、MySQL、Spark、Kafka等数据源的自动采集;对于无法自动采集的元数据(比如业务描述),用模板化录入:比如给每个表设计一个“元数据模板”(包含业务描述、所有者、更新频率),用户只需要填空;结合流程驱动:比如数据上线时,要求开发人员必须填写元数据,否则无法发布。

3. 结合数据质量工具——让数据“可信任”

问题:编目系统里的“高质量”标签是手动填的,可能不准确。

解决方案:

对接数据质量工具(比如Great Expectations、Apache Calcite);自动生成质量标签:比如当数据满足“非空率>99%”“重复率<1%”时,自动添加“高质量”标签;显示质量分数:比如给每个表打1-10分,用户能快速判断数据的可信度。

4. 优化搜索体验——像谷歌一样好用

问题:用户搜索“用户订单”,结果里有很多不相关的表(比如“用户订单历史”“用户订单备份”)。

解决方案:

支持模糊搜索:比如输入“订户”也能找到“用户订单”;支持过滤条件:比如按业务域、标签、所有者过滤;支持排序:按“访问量”“更新时间”排序,把常用的数据排在前面。

六、常见问题与避坑指南

问题1:元数据采集不全怎么办?

原因:

数据源的权限不够(比如Atlas没有访问MySQL的权限);驱动不兼容(比如用了旧版本的MySQL JDBC驱动);数据源类型不支持(比如Atlas不支持采集Excel文件的元数据)。

解决方案:

检查数据源的网络与权限:确保Atlas能访问数据源,账号有“SELECT”权限;升级驱动:使用与数据源版本匹配的JDBC驱动;用自定义脚本采集:对于不支持的数据源(比如Excel),写Python脚本读取元数据,再导入Atlas。

问题2:标签体系混乱怎么办?

原因:

没有统一的标签标准;标签的层级不清晰(比如把“敏感数据”和“高质量”放在同一层级);手动打标签的工作量太大。

解决方案:

先制定标签规范:明确标签的类型(业务/质量/敏感)、命名规则(比如“敏感-身份证号”“质量-高”);用自动打标签:比如用正则表达式匹配敏感字段(比如“身份证号”字段匹配

^d{18}$

问题3:数据血缘不准确怎么办?

原因:

SQL解析错误(比如复杂的存储过程无法解析);数据源不支持(比如Atlas无法解析MongoDB的血缘);手动修改了数据(比如直接修改表数据,没有通过SQL)。

解决方案:

使用支持复杂SQL的工具:比如Apache Atlas支持Spark、Hive的SQL解析,对于复杂存储过程,可以用自定义血缘工具(比如Apache Gobblin);对接ETL工具:比如Airflow、Flink,通过ETL任务的日志生成血缘;结合操作日志:比如记录谁修改了数据,什么时候修改的,补充血缘信息。

七、未来:编目的智能化趋势

随着AI技术的发展,编目正在从“手动/自动”向“智能”进化,未来的编目系统可能有这些功能:

1. 智能元数据生成——用LLM写业务描述

比如输入表名“user_order”,LLM能自动生成业务描述:“该表记录了用户在电商平台的订单信息,包含订单ID、用户ID、商品ID、订单金额等字段,主要用于用户复购率分析和订单统计报表”。

2. 智能标签推荐——自动识别敏感数据

比如用大模型自动识别“身份证号”“银行卡号”字段,不需要手动打标签;甚至能识别“用户行为日志”中的“手机号”字段(比如

138XXXX1234

3. 智能血缘追踪——跨系统的端到端血缘

比如能追踪从“用户App埋点”→“Kafka日志”→“Hive表”→“BI报表”的全链路血缘,即使数据经过了多个系统的转换。

4. 智能搜索——理解自然语言查询

比如用户输入“我要做用户复购率分析,需要哪些数据?”,编目系统能自动推荐:

“user_order”表(订单数据);“user_info”表(用户基本信息);“product_info”表(商品信息);并说明这些表的关系(通过血缘)。

八、总结

大数据编目不是“额外的工作”,而是数据治理的必经之路——没有编目,数据治理就是“空中楼阁”,无法解决企业的实际痛点。

本文的核心结论:

编目的本质是给数据做“导航地图”,包含元数据、分类、标签、血缘四个组件;编目的价值是让数据“可发现、可理解、可管”,解决企业数据的四大痛点;落地编目需要“工具+流程+人”的结合——工具(比如Atlas)是基础,流程(比如元数据录入规范)是保障,人(比如数据所有者)是关键;未来的编目会越来越智能,LLM、知识图谱等技术会让编目更“好用”。

最后,送给大家一句话:数据治理的核心不是“管数据”,而是“服务用户”——编目就是最直接的服务。希望本文能帮你理解编目的价值,让你的数据治理之路更顺畅!

参考资料

Apache Atlas 官方文档:https://atlas.apache.org/《数据治理实战》(作者:王珊):讲解编目的理论与实践;阿里云数据目录产品文档:https://help.aliyun.com/product/101027.html《大数据元数据管理》(作者:李战):深入解析元数据与血缘的技术细节。

附录:代码与资源

Apache Atlas Docker 部署脚本:https://github.com/apache/atlas/tree/master/docker元数据采集Python脚本示例(采集Excel元数据):https://github.com/pandas-dev/pandas/blob/main/pandas/io/formats/excel.py数据血缘工具推荐:Apache Gobblin(https://gobblin.apache.org/)、Amundsen(https://amundsen.io/)。

(注:以上链接为示例,实际使用时请以官方最新版本为准。)

相关文章