最后的守夜人:爬虫与反爬虫对抗到硅基流量治理的终局演变

2025年的技术观察者

“爬虫太高级了,我们需要更复杂的反爬……”

引言:丛林法则的终结

2025 年冬,可能今年的这个冬天格外的冷。

当我们坐在监控大屏前,看着服务器流量的波峰波谷,一种异样的沉默正在技术圈蔓延。

曾经喧嚣的“爬虫与反爬”战场,似乎在一夜之间改变了规则。那些熟悉的对手——通过 User-Agent 伪装的 Python 脚本、依靠 IP 代理池暴力撞击的 Scrapy 爬虫,甚至那些曾经让我们头疼的 Selenium 自动化脚本,正在逐渐退出历史舞台。

取而代之的,是一种全新的、安静的、却具有毁灭性力量的对手:MCP(Model Context Protocol)驱动的 AI Agent。

它们不再是死板的代码指令,它们拥有基于大模型(LLM)的“大脑”,拥有基于计算机视觉(CV)的“眼睛”,甚至拥有模拟人类意图的“逻辑”。它们像真人一样浏览、像真人一样思考,甚至能像真人一样被网页的视觉设计所迷惑——或者,看穿我们的迷惑。

这是一场不对称的战争。我们手中的武器——JS 混淆 + 加密、验证码、IP 封禁——在拥有“多模态理解能力”的智能体面前,变得如同马其诺防线般脆弱。

本文将复盘这场从“代码对抗”到“认知对抗”,最终走向“经济博弈”的完整演变史。这不仅是爬虫技术与反爬技术的迭代记录,更是一份关于互联网数据主权与商业模式重构的生存指南。

第一章:新物种的诞生 —— 当爬虫拥有了“大脑”

在 2024 年之前,爬虫是“盲目”的。它们依赖 DOM 结构,依赖固定的 div 类名,依赖硬编码的规则。反爬工程师只需要轻轻修改一下 HTML 结构,或者把价格数字变成图片,就能让数万个爬虫脚本一夜瘫痪。

但 MCP 协议的普及改变了一切。

1.1 什么是 MCP 爬虫?

MCP(模型上下文协议)让 AI Agent 能够标准化地连接浏览工具。现在的爬虫不再是“脚本”,而是“智能体”。

视觉感知:它们不看代码,看的是渲染后的屏幕截图。通过 CNN 或 Vision Transformer,它们直接识别出“那个红色的按钮是购买”,“那个最大的数字是价格”。

语义理解:它们不受类名混淆的影响。反爬者把

<div class="price">

改成

<div class="a1b2">

自主决策:它们不再执行线性逻辑。遇到弹窗,它们会分析弹窗内容;遇到验证码,它们会调用视觉模型尝试解答,甚至会像人一样“犹豫”和“重试”。

1.2 传统防线的崩塌

面对这种对手,传统的“技术硬碰硬”迅速失效:

指纹检测开始失效:在部分基于 MCP 的工具实现中,浏览器侧可能基于 Playwright 或深度定制的浏览器内核运行,并结合预先构建的指纹参数配置,在一定程度上复用或近似主流浏览器族群的 TLS 握手特征,同时通过脚本注入等方式规避基于 API 返回值的浅层 Canvas / WebGL 指纹检测。这类方案对依赖浏览器指纹和简单一致性校验的基础风控策略具有一定绕过效果,但在更复杂的网络层、行为分析和硬件级指纹检测面前仍存在明显限制。但是这只是开始。

DOM 陷阱失效:当对手不再阅读源码,而是直接凝视屏幕时,那些精心布置在HTML里的隐藏 div,成了写给旧世界解析器的墓志铭。

我们必须承认,在“拟人化”这条路上,AI 已经走到了终点。单纯比拼“谁更像人”,反爬团队必败无疑。

第二章:认知战 —— 针对 AI 的“幻觉”攻击

当基于行为仿真的对抗逐渐进入成本失衡区间,单纯在“拟真程度”上与自动化系统正面竞争,已经难以形成长期优势。防御策略需要转向更高层级的博弈设计。

现阶段的自动化系统,尤其是以概率模型为核心的生成式与代理式 AI,仍然依赖有限上下文、延迟决策以及统计一致性假设来完成判断。这些特性并非缺陷,但在高对抗环境中会形成可被利用的约束条件。

因此,的反自动化策略重点,不再只是连接层面的拦截或特征层面的对抗,而是通过引入不稳定、不可验证或高歧义的信号结构,提高系统决策的不确定性与验证成本。

换言之,防御的目标不是“阻止访问”,而是让自动化系统在可观测信息下难以形成稳定、可泛化的判断路径,从而在规模化运行中持续积累错误与成本。

2.1 控制论差异

人类操作中,感知—动作回路是连续、高频、可即时修正的;而多数视觉 AI 仍采用低频、分段式感知与动作执行,在决策到执行之间缺乏实时反馈,因此对微小变化高度脆弱。

防御战术

– hover → 停留 ≥ X ms → focus → click

– mousemove 轨迹连续性(不是速度,而是方向变化)

– click 前是否存在合理的 cursor history

2.2 攻击“视觉中枢”:

AI 依赖卷积神经网络(CNN)或 Transformer 进行视觉感知。由于这些模型对高频特征与局部纹理存在偏置,在受控条件下可以构造人类感知难以察觉、但对特定模型产生干扰的视觉扰动。

非稳健防御

这类扰动在个别 OCR 或多模态系统中可能诱发误识别,但其表现往往高度不稳定:效果强烈依赖具体模型与处理管线,对压缩、重采样和预处理极为敏感,稳定性与可迁移性均较差,难以作为可靠或通用的攻击或防御手段。

第三章:理论的边界 —— 生物拟态 AI (SNN) 的虚与实

然而,站在 2025 年的视角,SNN 在多数对抗性应用中仍更像是一个尚未脱离实验室语境的技术幽灵。脉冲神经网络(SNN)作为高度时间敏感、事件驱动的计算模型,在微观行为与时序感知层面展现出更强的生物相似性,但这种相似性并不天然转化为系统级对抗能力。

目前来看,SNN 确实在动态模式捕捉上具备潜在优势,但在静态识别任务中仍明显弱于 CNN / Transformer;同时,其训练过程依赖不可导近似、收敛不稳定,配套硬件又长期处于昂贵、稀缺且缺乏通用性的状态。

在灰黑产的经济账本里,这样的技术路径显然并不划算。爬虫开发者的目标是规模化套利,而非探索计算范式本身。

只有在以下条件之一真实成立时——SNN 训练被高度工程化、神经拟态硬件实现云化或通用化,或对抗目标从静态特征转向高频连续行为(如微时序交互、生物节律)——SNN 才可能获得相对优势,而当前 CNN / Transformer所依赖的算力与延迟优势也将不再具备决定性意义。

因此,SNN 的现实价值更可能体现在特定感知与实时交互场景中,而非作为爬虫与反爬虫博弈中的系统级“终极解法”。这场攻防对抗的主战场,短期内仍将围绕可工程化、可规模化的模型体系持续演进。

3.2 真正的对手:多模态大模型

当下现实中的反爬主要威胁仍然来自 CNN / Transformer 驱动的工程化系统,而非 SNN。

攻击者通常采用“感知 + 规划”的组合:

– 感知模块负责图像与界面元素的快速定位;

– 规划模块负责流程决策、验证码推理与策略选择。

因此,防御重点不应局限于提升视觉识别难度,而应转向限制攻击的规模化能力,通过引入状态相关、不可复用的逻辑消耗与工程摩擦,提高自动化系统的整体成本。

例如:

– 状态绑定的逻辑挑战:挑战内容与用户行为、页面上下文和时间状态绑定,避免被离线收集和复用,从而迫使攻击者维持完整交互与推理链路。

– 轻量级计算与流程摩擦:在关键路径中引入不可预测的 JS 执行、事件链依赖和微延迟,而非单纯依赖高强度 PoW,以防对正常用户造成过高负担。

防御目标并非“让单次破解代价极高”,而是使攻击无法低成本规模化扩展,从而破坏其经济可行性。

第四章:战略的转折

随着攻防的深入,一个残酷的现实摆在所有 CTO 面前:假设我们的数据真的真的值得投入这么成本来反爬重,或许技术上防住 AI 爬虫是可能的,但商业上可能是自杀。

假如我们将反爬做到极致,确实能挡住所有爬虫和 AI Agent。但在“AI 成为用户代理”的时代,挡住 AI,就等于挡住了核心流量。

4.1 流量主体的变迁

未来的互联网用户,不再是肉身刷手机的人类,而是代表人类意志的 Agent。

用户不再去“什么值得买”比价,而是问 ChatGPT:“哪里买 iPhone 最便宜?”

用户不再去 APP 看评论,而是让 AI 总结:“这家店口碑如何?”

如果我们封锁了 AI,我们就成为了互联网上的**“数据孤岛”**。在 AI 掌握流量分发权的世界里,孤岛意味着死亡。

4.2 商业模式的重构:B2A (Business to Agent)

反爬团队的使命,必须从“安全保卫科”转型为“资产运营部”。我们不再是把 AI 拒之门外,而重新定义自己的用户群体和所持有数据属性。

数据的“稀缺性”和“准确性”的像Bloomberg(彭博社)一样可以选择极严的反爬来确保核心竞争力。

分级准入

游客通道(Track A):面向普通 SEO 爬虫和人类。提供静态、模糊、延迟的数据。维持品牌曝光。

VIP 通道(Track B):面向认证的 AI Agent。提供实时库存、精准价格、交易接口。

代价:付费 API 调用,或者携带 Affiliate Token(返利链接)。

4.3 “赛博奶牛”的困境与突围

并非所有公司都是 Bloomberg 或 Reddit,拥有不可替代的数据垄断权。对于大多数中型平台,生存之道在于**“服务化”**。

第五章:终局 —— 铁路修进荒野

故事讲到这里,我们仿佛看到了一个时代的落幕。

曾经的“爬虫与反爬”,是一场属于程序员的浪漫战争。那是西部荒野上的牛仔对决,是 JS 逆向与混淆的智力博弈,是 IP 池与 WAF 的火力覆盖。

而未来的世界,将不再有这种“草莽气息”。

“大结局”的苍凉感

当 AI能看懂世间所有的验证码,当反爬系统的边际成本超过了数据价值,技术对抗本身就失去了意义。

规则取代了技术。

就像 19 世纪末,铁路和法律修进了西部,曾经的“爬虫与反爬”是牛仔与赏金猎人之间的枪战,充满了个人英雄主义、技术巧思和一种灰色的浪漫;未来的世界,将是**“铁路公司”(大模型平台)与“庄园主”(数据持有者)**之间枯燥的合同、法务与精密计费。

未来的开发者可能听不懂我们今天的故事了。

未来的人会很难理解:“为什么仅仅为了获取公开展示在屏幕上的信息,人类程序员要互相折磨整整二十年?”

他们会觉得匪夷所思:

– 为了看个价格,要识别红绿灯、还要把滑块拖到缺口处?

– 为了读行字,要解密混淆的 JS 代码,还要对抗字体加密?

– 为了发个请求,要伪装成 Chrome 浏览器,还要模拟鼠标轨迹抖动?

或许在他们眼里,这就像是在发明货币之前,两个人在菜市场通过摔跤来决定几个鸡蛋换一袋米——一种由于**“价值交换协议”尚未建立而产生的原始混乱。

生态的大分流:从“丛林”到“城市”

爬虫编写者和反爬者以及他们的用户群体、经济生态正在分流,走向两个截然不同的平行世界。这也标志着互联网从“数字丛林”进化到了“数字城市”。

1. 地上世界:合规的“数据物流业”

以前写爬虫的人,未来变成了“数据管道工程师”或“MCP 协议维护者”。

– 他们的用户:正规的 AI Agent、搜索引擎、商业分析公司。

– 他们的工作:不再是破解加密,而是维护 API 的连通性、优化 Token 的消耗成本、处理数据合规清洗。

– 经济生态:B2B 订阅制。通过官方接口(或联盟接口)“进货”,加工后“零售”给下游 AI。这已经不是“爬虫”了,这是供应链管理**。

2. 地下世界:隐秘的“信息黑市”

真正的“对抗”不会消失,但会极度收缩,变成类似现实世界中“网络安全攻防”的小圈子。

– 仅存的爬虫:针对的是极高价值且封闭的信息(如商业机密、社交关系链、未公开的漏洞)。

– 技术手段:不再是 JS 逆向,而是 0day 漏洞利用、硬件侧信道攻击、内网渗透。

– 经济生态:黑产与情报交易。这不再是普通程序员能参与的游戏,而是灰黑产巨头和国家级力量的博弈。

技术浪漫主义的消亡

我们这一代反爬工程师和爬虫工程师,其实是互联网**“无主之地”时代的最后守夜人。

– 爬虫工程师曾相信“互联网精神就是 Open Web”,认为 curl 能获取的都是自由的。

– 反爬工程师曾相信“我的代码能捍卫服务器的疆土”,以构建出这世界上最复杂的验证码为荣。

但 AI 时代的到来,用“资本”和“算力”**强行拉平了这一切。

在这个时代转折点,我们不需要悲伤。

也许十年后,当一个年轻的程序员问你:

“前辈,听说你们当年为了抓一个网页,还要买几万个代理 IP,还要训练一个神经网络去认图片里的文字,是真的吗?”

你会点上一根烟(或者电子烟),面对无数个正在自动交互的 AI Agent,淡淡地说:

“是啊。那时候互联网还很蛮荒,数据还不是商品,而是一种猎物。我们那是打猎,而你们现在……只是在超市购物罢了。”

这确实是一个属于过去的、喧嚣的、充满智力快感但也注定要终结的故事。我们正在目送它远去。

相关文章

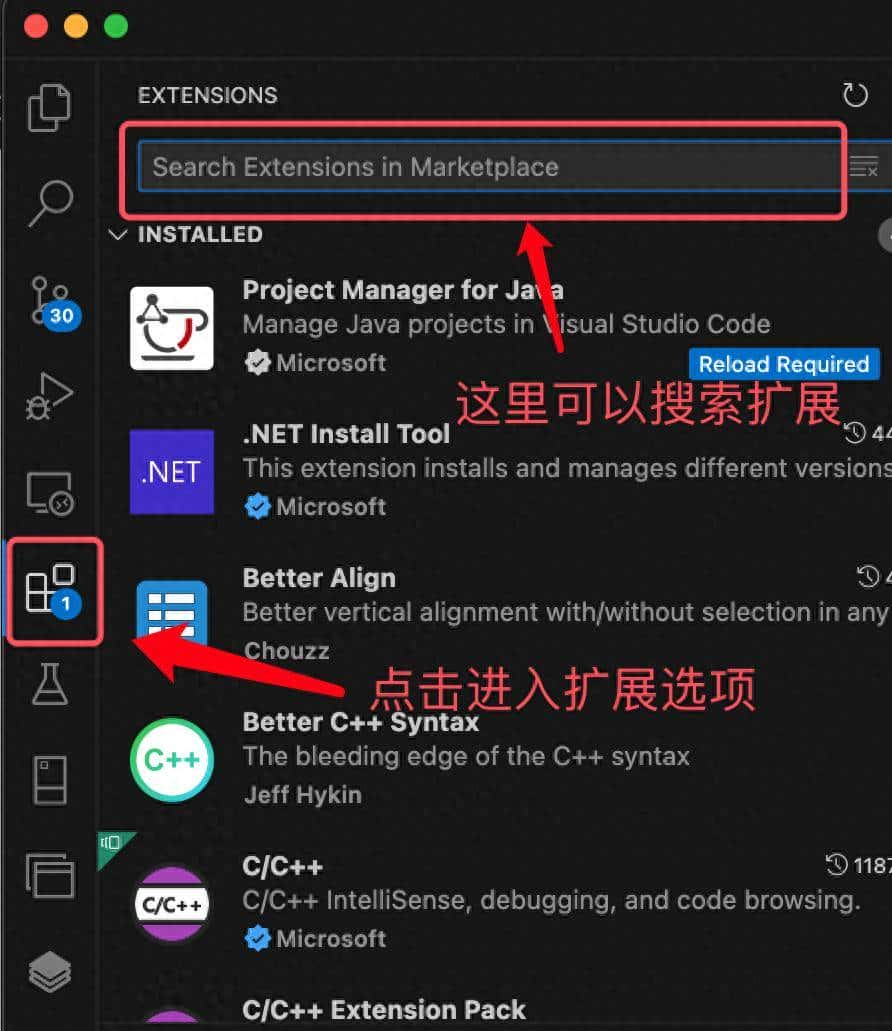

![[LaTeX] VScode+SumatraPDF 配置正反向索引](https://www.dunling.com/img/8.jpg)