AI Agent的概念形成:模拟LLM的抽象思维过程

关键词:AI Agent、大语言模型(LLM)、抽象思维过程、概念形成、智能模拟

摘要:本文聚焦于AI Agent概念形成过程中模拟大语言模型(LLM)抽象思维过程这一核心主题。首先介绍了研究的背景、目的、预期读者和文档结构。接着深入探讨了AI Agent和LLM抽象思维的核心概念及其联系,阐述了相关核心算法原理并给出Python代码示例,分析了其中涉及的数学模型和公式。通过项目实战展示了代码的实际应用和详细解读,列举了AI Agent在多个领域的实际应用场景。同时推荐了学习所需的工具和资源,包括书籍、在线课程、技术博客、开发工具框架以及相关论文著作。最后总结了AI Agent未来的发展趋势与挑战,并提供了常见问题解答和扩展阅读参考资料,旨在为读者全面深入地理解AI Agent模拟LLM抽象思维过程提供专业且系统的知识体系。

1. 背景介绍

1.1 目的和范围

随着人工智能技术的飞速发展,大语言模型(LLM)如GPT系列等展现出了强大的语言处理和知识运用能力。然而,LLM更多地是基于大规模数据的学习和模式匹配,在一些需要深度抽象思维和自主决策的任务中表现仍有局限。AI Agent作为一种能够感知环境、自主决策并执行行动的智能实体,模拟LLM的抽象思维过程可以使其具备更高级的智能水平,能够更好地应对复杂多变的任务和环境。

本文章的范围主要涵盖AI Agent概念形成中模拟LLM抽象思维过程的相关理论、算法、实际应用以及未来发展等方面。我们将探讨如何让AI Agent在理解和处理信息时,像LLM一样进行抽象概括、推理和决策,以及如何将这些理论应用到实际的项目开发中。

1.2 预期读者

本文预期读者包括人工智能领域的研究人员、开发者、学生以及对AI Agent和大语言模型感兴趣的技术爱好者。对于研究人员,本文可以为他们的学术研究提供新的思路和方向;开发者可以从中获取实际的算法和代码实现指导,用于项目开发;学生可以通过阅读本文系统地学习AI Agent和LLM抽象思维相关的知识;技术爱好者则可以借此深入了解这一前沿领域的技术原理和应用场景。

1.3 文档结构概述

本文将按照以下结构展开:

首先介绍背景信息,包括研究目的、预期读者和文档结构概述,以及相关术语的定义和解释。阐述AI Agent和LLM抽象思维的核心概念,分析它们之间的联系,并通过文本示意图和Mermaid流程图进行直观展示。讲解模拟LLM抽象思维过程的核心算法原理,并给出Python源代码示例。介绍相关的数学模型和公式,并通过具体例子进行详细说明。通过项目实战,展示代码的实际应用,包括开发环境搭建、源代码实现和代码解读。列举AI Agent模拟LLM抽象思维过程在实际中的应用场景。推荐学习所需的工具和资源,包括书籍、在线课程、技术博客、开发工具框架以及相关论文著作。总结AI Agent未来的发展趋势与挑战。提供常见问题解答。给出扩展阅读和参考资料。

1.4 术语表

1.4.1 核心术语定义

AI Agent(人工智能智能体):是一种能够感知环境,根据自身的目标和知识进行决策,并采取行动以实现目标的智能实体。它可以是软件程序、机器人等形式。大语言模型(LLM,Large Language Model):是基于深度学习技术,通过在大规模文本数据上进行训练得到的语言模型。它能够处理和生成自然语言文本,具有强大的语言理解和生成能力。抽象思维:是人类思维的一种高级形式,指在认识过程中,借助概念、判断、推理等思维形式,对客观现实进行间接的、概括的反映。在AI领域,抽象思维表现为对信息的抽象概括、推理和决策等能力。

1.4.2 相关概念解释

知识表示:是将知识以计算机能够理解和处理的方式进行表示的方法。在AI Agent模拟LLM抽象思维过程中,知识表示用于存储和管理Agent所拥有的知识,以便进行推理和决策。推理机制:是AI Agent根据已知的知识和信息,推导出新的知识和结论的过程。推理机制可以分为演绎推理、归纳推理、类比推理等不同类型。环境感知:是AI Agent通过各种传感器或输入接口,获取周围环境信息的过程。环境感知是Agent进行决策和行动的基础。

1.4.3 缩略词列表

LLM:Large Language Model(大语言模型)AI:Artificial Intelligence(人工智能)

2. 核心概念与联系

核心概念原理

AI Agent

AI Agent可以看作是一个具有自主性、反应性、社会性和主动性的智能实体。自主性意味着Agent能够独立地进行决策和行动,不受外部直接控制;反应性表示Agent能够感知环境的变化,并及时做出相应的反应;社会性体现了Agent可以与其他Agent或人类进行交互;主动性则是指Agent能够主动地发起行动,以实现自身的目标。

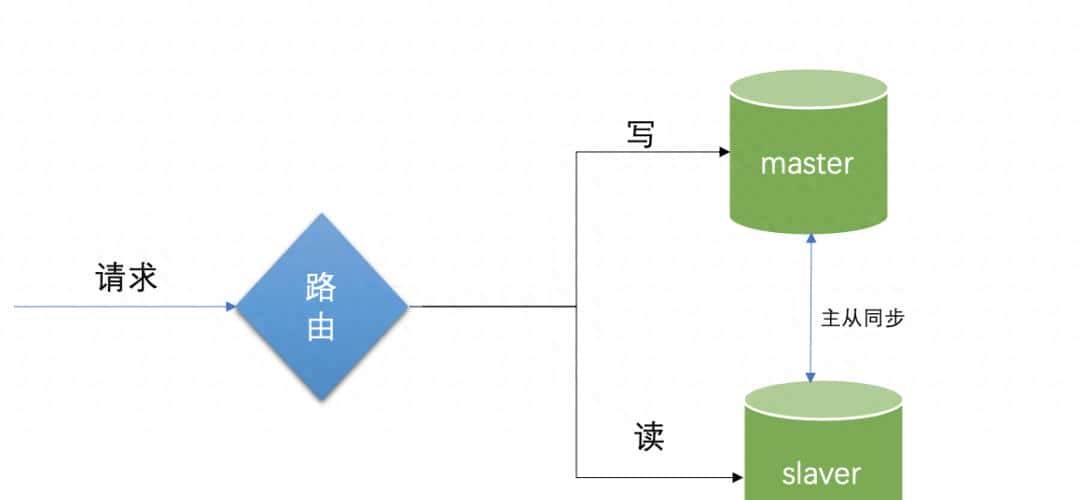

AI Agent通常由感知模块、决策模块和行动模块组成。感知模块负责获取环境信息,决策模块根据感知到的信息和自身的知识进行推理和决策,行动模块则执行决策模块生成的行动。

LLM的抽象思维过程

LLM的抽象思维过程主要体现在其对输入文本的理解、概括和推理能力上。在训练过程中,LLM通过学习大量的文本数据,掌握了语言的结构和语义信息。当接收到输入文本时,LLM能够对文本进行分词、词性标注、句法分析等处理,提取出文本的关键信息,并进行抽象概括。例如,将一段描述多个具体事件的文本概括为一个主题。

LLM还能够进行推理,根据已知的信息推导出新的结论。例如,通过对历史数据和相关知识的学习,预测未来的趋势。

核心概念联系

AI Agent模拟LLM的抽象思维过程,就是要让AI Agent具备类似于LLM的信息处理和决策能力。通过引入LLM的抽象思维机制,AI Agent可以更好地理解复杂的环境信息,进行更高级的推理和决策。

具体来说,AI Agent可以利用LLM的语言理解能力,对感知到的环境信息进行处理和分析,提取出关键信息。然后,借助LLM的推理能力,根据这些关键信息和自身的知识进行决策。最后,AI Agent的行动模块执行决策结果,对环境产生影响。

文本示意图

AI Agent

├── 感知模块

│ └── 获取环境信息

├── 决策模块

│ ├── 利用LLM抽象思维处理信息

│ │ ├── 信息理解

│ │ ├── 抽象概括

│ │ └── 推理

│ └── 生成决策

└── 行动模块

└── 执行决策

Mermaid流程图

3. 核心算法原理 & 具体操作步骤

核心算法原理

为了让AI Agent模拟LLM的抽象思维过程,我们可以采用基于强化学习和知识图谱的方法。强化学习可以让AI Agent在与环境的交互中不断学习和优化决策策略,知识图谱则可以存储和管理Agent所拥有的知识,为推理提供支持。

具体来说,我们可以将AI Agent的决策过程看作是一个马尔可夫决策过程(MDP)。在MDP中,Agent在每个时间步根据当前的状态选择一个行动,执行该行动后环境会发生变化,Agent会获得一个奖励。Agent的目标是通过不断地选择行动,最大化长期累积奖励。

在决策过程中,AI Agent可以利用知识图谱进行推理,根据已知的知识和当前的环境信息,推导出可能的行动和对应的奖励。然后,根据强化学习算法选择最优的行动。

Python源代码示例

import numpy as np

# 定义知识图谱类

class KnowledgeGraph:

def __init__(self):

# 简单示例,用字典表示知识图谱

self.graph = {

"苹果": ["水果", "红色"],

"香蕉": ["水果", "黄色"],

"汽车": ["交通工具", "金属"]

}

def get_related_info(self, entity):

if entity in self.graph:

return self.graph[entity]

return []

# 定义AI Agent类

class AIAgent:

def __init__(self, knowledge_graph):

self.knowledge_graph = knowledge_graph

# 简单的Q表,用于强化学习

self.q_table = {}

def perceive(self, environment_info):

# 模拟感知环境信息

return environment_info

def decision(self, state):

related_info = self.knowledge_graph.get_related_info(state)

possible_actions = []

for info in related_info:

action = f"根据{info}行动"

possible_actions.append(action)

if not possible_actions:

possible_actions = ["随机行动"]

# 简单的Q学习选择行动

if state not in self.q_table:

self.q_table[state] = {action: 0 for action in possible_actions}

best_action = max(self.q_table[state], key=self.q_table[state].get)

return best_action

def act(self, action):

print(f"执行行动: {action}")

# 主程序

if __name__ == "__main__":

knowledge_graph = KnowledgeGraph()

agent = AIAgent(knowledge_graph)

# 模拟环境信息

environment_info = "苹果"

state = agent.perceive(environment_info)

action = agent.decision(state)

agent.act(action)

具体操作步骤

知识图谱构建:收集和整理相关的知识,构建知识图谱。知识图谱可以用图数据库或字典等数据结构表示。AI Agent初始化:创建AI Agent对象,并将知识图谱传递给它。同时,初始化强化学习的Q表。环境感知:AI Agent通过感知模块获取环境信息。决策过程:AI Agent根据感知到的环境信息,利用知识图谱进行推理,生成可能的行动。然后,根据强化学习算法选择最优的行动。行动执行:AI Agent的行动模块执行决策结果。

4. 数学模型和公式 & 详细讲解 & 举例说明

马尔可夫决策过程(MDP)

马尔可夫决策过程可以用一个五元组 (S,A,P,R,γ)(S, A, P, R, gamma)(S,A,P,R,γ) 表示,其中:

SSS 是状态集合,表示环境的所有可能状态。AAA 是行动集合,表示Agent可以采取的所有行动。PPP 是状态转移概率函数,P(s′∣s,a)P(s'|s, a)P(s′∣s,a) 表示在状态 sss 下采取行动 aaa 后转移到状态 s′s's′ 的概率。RRR 是奖励函数,R(s,a,s′)R(s, a, s')R(s,a,s′) 表示在状态 sss 下采取行动 aaa 转移到状态 s′s's′ 时获得的奖励。γgammaγ 是折扣因子,0≤γ≤10 leq gamma leq 10≤γ≤1,用于衡量未来奖励的重要性。

Q学习算法

Q学习是一种基于价值的强化学习算法,用于学习最优的行动策略。Q函数 Q(s,a)Q(s, a)Q(s,a) 表示在状态 sss 下采取行动 aaa 的长期累积奖励。Q学习的更新公式如下:

sts_tst 是当前状态。ata_tat 是当前采取的行动。R(st,at,st+1)R(s_t, a_t, s_{t+1})R(st,at,st+1) 是从状态 sts_tst 采取行动 ata_tat 转移到状态 st+1s_{t+1}st+1 时获得的奖励。αalphaα 是学习率,0<α≤10 < alpha leq 10<α≤1,控制每次更新的步长。γgammaγ 是折扣因子。

详细讲解

在AI Agent模拟LLM抽象思维过程中,MDP用于描述Agent的决策过程,Q学习算法用于学习最优的行动策略。Agent在每个时间步根据当前的状态 sts_tst 选择一个行动 ata_tat,执行该行动后环境会转移到新的状态 st+1s_{t+1}st+1,并获得一个奖励 R(st,at,st+1)R(s_t, a_t, s_{t+1})R(st,at,st+1)。然后,Agent根据Q学习更新公式更新Q函数。

举例说明

假设AI Agent在一个简单的环境中,状态集合 S={s1,s2}S = {s_1, s_2}S={s1,s2},行动集合 A={a1,a2}A = {a_1, a_2}A={a1,a2}。初始时,Q表如下:

| 状态 | a1a_1a1 | a2a_2a2 |

|---|---|---|

| s1s_1s1 | 0 | 0 |

| s2s_2s2 | 0 | 0 |

假设当前状态 st=s1s_t = s_1st=s1,Agent选择行动 at=a1a_t = a_1at=a1,执行该行动后环境转移到状态 st+1=s2s_{t+1} = s_2st+1=s2,获得奖励 R(st,at,st+1)=1R(s_t, a_t, s_{t+1}) = 1R(st,at,st+1)=1。学习率 α=0.1alpha = 0.1α=0.1,折扣因子 γ=0.9gamma = 0.9γ=0.9。

根据Q学习更新公式:

| 状态 | a1a_1a1 | a2a_2a2 |

|---|---|---|

| s1s_1s1 | 0.1 | 0 |

| s2s_2s2 | 0 | 0 |

5. 项目实战:代码实际案例和详细解释说明

5.1 开发环境搭建

操作系统

本项目可以在Windows、Linux或macOS操作系统上进行开发。建议使用Ubuntu 18.04及以上版本的Linux系统,因为它在人工智能开发方面具有良好的兼容性和稳定性。

Python环境

安装Python 3.7及以上版本。可以从Python官方网站(https://www.python.org/downloads/)下载安装包进行安装。安装完成后,使用以下命令验证Python版本:

python --version

依赖库安装

本项目使用了一些Python库,如

numpy

pip

pip install numpy

5.2 源代码详细实现和代码解读

以下是完整的项目代码:

import numpy as np

# 定义知识图谱类

class KnowledgeGraph:

def __init__(self):

# 简单示例,用字典表示知识图谱

self.graph = {

"苹果": ["水果", "红色"],

"香蕉": ["水果", "黄色"],

"汽车": ["交通工具", "金属"]

}

def get_related_info(self, entity):

if entity in self.graph:

return self.graph[entity]

return []

# 定义AI Agent类

class AIAgent:

def __init__(self, knowledge_graph):

self.knowledge_graph = knowledge_graph

# 简单的Q表,用于强化学习

self.q_table = {}

# 学习率

self.alpha = 0.1

# 折扣因子

self.gamma = 0.9

def perceive(self, environment_info):

# 模拟感知环境信息

return environment_info

def decision(self, state):

related_info = self.knowledge_graph.get_related_info(state)

possible_actions = []

for info in related_info:

action = f"根据{info}行动"

possible_actions.append(action)

if not possible_actions:

possible_actions = ["随机行动"]

# 简单的Q学习选择行动

if state not in self.q_table:

self.q_table[state] = {action: 0 for action in possible_actions}

best_action = max(self.q_table[state], key=self.q_table[state].get)

return best_action

def act(self, action):

print(f"执行行动: {action}")

def update_q_table(self, state, action, reward, next_state):

if state not in self.q_table:

self.q_table[state] = {action: 0 for action in self.q_table[next_state].keys()}

if next_state not in self.q_table:

self.q_table[next_state] = {action: 0 for action in self.q_table[state].keys()}

max_q_next = max(self.q_table[next_state].values())

self.q_table[state][action] += self.alpha * (reward + self.gamma * max_q_next - self.q_table[state][action])

# 主程序

if __name__ == "__main__":

knowledge_graph = KnowledgeGraph()

agent = AIAgent(knowledge_graph)

# 模拟环境信息

environment_info = "苹果"

state = agent.perceive(environment_info)

action = agent.decision(state)

agent.act(action)

# 模拟奖励和下一个状态

next_environment_info = "香蕉"

next_state = agent.perceive(next_environment_info)

reward = 1

agent.update_q_table(state, action, reward, next_state)

print("更新后的Q表:", agent.q_table)

代码解读与分析

知识图谱类(KnowledgeGraph)

__init__

get_related_info

AI Agent类(AIAgent)

__init__

perceive

decision

act

update_q_table

主程序

创建知识图谱对象和AI Agent对象。模拟环境信息,让AI Agent感知环境并做出决策,执行行动。模拟奖励和下一个状态,调用

update_q_table

6. 实际应用场景

智能客服

在智能客服系统中,AI Agent可以模拟LLM的抽象思维过程,更好地理解用户的问题。通过对用户问题进行抽象概括和推理,AI Agent可以从知识图谱中找到相关的答案,并以自然语言的形式回复用户。例如,当用户询问“苹果手机的电池续航怎么样”时,AI Agent可以先将问题抽象为“苹果手机电池续航情况”,然后从知识图谱中查找相关信息,如不同型号苹果手机的电池容量、续航时间等,并进行总结和回复。

智能家居控制

在智能家居系统中,AI Agent可以根据环境信息和用户的习惯进行决策。例如,当感知到室内温度升高时,AI Agent可以根据知识图谱中关于空调使用的知识,判断是否需要打开空调。同时,AI Agent还可以通过学习用户的使用习惯,优化决策策略,提高用户的舒适度。

自动驾驶

在自动驾驶领域,AI Agent可以模拟LLM的抽象思维过程,对复杂的交通场景进行理解和决策。例如,当遇到前方车辆突然刹车时,AI Agent可以通过对交通规则和周围环境信息的推理,判断是紧急刹车还是缓慢减速,以确保行车安全。

金融投资

在金融投资领域,AI Agent可以分析大量的金融数据和市场信息,进行抽象概括和推理。例如,通过对公司财务报表、行业趋势等信息的分析,AI Agent可以预测股票的走势,并为投资者提供投资建议。

7. 工具和资源推荐

7.1 学习资源推荐

7.1.1 书籍推荐

《人工智能:一种现代的方法》(Artificial Intelligence: A Modern Approach):这是一本经典的人工智能教材,涵盖了人工智能的各个方面,包括搜索算法、知识表示、推理、机器学习等。《强化学习:原理与Python实现》:详细介绍了强化学习的基本原理和算法,并通过Python代码进行实现,适合初学者学习强化学习。《知识图谱:方法、实践与应用》:全面介绍了知识图谱的构建方法、技术和应用场景,对于理解知识图谱在AI Agent中的应用有很大帮助。

7.1.2 在线课程

Coursera上的“人工智能基础”课程:由知名教授授课,系统地介绍了人工智能的基本概念、算法和应用。edX上的“强化学习”课程:深入讲解了强化学习的理论和实践,提供了丰富的案例和实验。中国大学MOOC上的“知识图谱”课程:介绍了知识图谱的基本原理、构建方法和应用技术,适合国内学习者。

7.1.3 技术博客和网站

Towards Data Science:一个专注于数据科学和人工智能的技术博客,提供了大量的高质量文章和教程。Medium上的AI相关专栏:有许多人工智能领域的专家和从业者分享他们的经验和见解。开源中国(OSChina):国内知名的开源技术社区,有很多关于人工智能的技术文章和项目分享。

7.2 开发工具框架推荐

7.2.1 IDE和编辑器

PyCharm:一款专业的Python集成开发环境,提供了丰富的代码编辑、调试和分析功能,适合Python项目开发。Visual Studio Code:一款轻量级的代码编辑器,支持多种编程语言,通过安装插件可以实现强大的开发功能。

7.2.2 调试和性能分析工具

pdb:Python自带的调试器,可以帮助开发者定位代码中的问题。cProfile:Python的性能分析工具,可以分析代码的运行时间和函数调用情况,帮助优化代码性能。

7.2.3 相关框架和库

TensorFlow:一个开源的机器学习框架,提供了丰富的工具和库,用于构建和训练深度学习模型。PyTorch:另一个流行的深度学习框架,具有动态图的特点,易于使用和调试。NetworkX:一个用于创建、操作和研究复杂网络的Python库,可用于知识图谱的构建和分析。

7.3 相关论文著作推荐

7.3.1 经典论文

“Attention Is All You Need”:介绍了Transformer模型,是大语言模型的基础。“Reinforcement Learning: An Introduction”:强化学习领域的经典著作,系统地介绍了强化学习的理论和算法。

7.3.2 最新研究成果

可以关注顶级人工智能会议如NeurIPS、ICML、AAAI等的论文,了解AI Agent和大语言模型的最新研究进展。

7.3.3 应用案例分析

一些知名企业如Google、Microsoft等会发布关于AI Agent应用的案例分析报告,可以从中学习实际应用中的经验和方法。

8. 总结:未来发展趋势与挑战

未来发展趋势

更强的抽象思维能力

未来的AI Agent将具备更强的抽象思维能力,能够更好地理解和处理复杂的信息。例如,在面对大量的非结构化数据时,AI Agent可以自动进行抽象概括和分析,提取出有价值的信息。

多模态融合

AI Agent将不再局限于处理文本信息,而是会融合图像、音频、视频等多种模态的信息。通过多模态融合,AI Agent可以更全面地感知环境,做出更准确的决策。

自主学习和进化

AI Agent将具备自主学习和进化的能力,能够在没有人类干预的情况下不断学习和优化自身的决策策略。例如,通过与环境的交互和自我反思,AI Agent可以发现自己的不足并进行改进。

挑战

数据隐私和安全

随着AI Agent处理的数据量越来越大,数据隐私和安全问题变得尤为重要。如何保护用户的数据不被泄露和滥用,是AI Agent发展面临的一个重要挑战。

可解释性

AI Agent的决策过程往往是基于复杂的算法和模型,难以解释。在一些关键领域如医疗、金融等,可解释性是非常重要的。如何提高AI Agent决策的可解释性,是当前研究的一个热点问题。

伦理和法律问题

AI Agent的广泛应用也带来了一系列的伦理和法律问题。例如,当AI Agent做出错误的决策导致损失时,责任应该由谁来承担。如何制定相应的伦理和法律规范,确保AI Agent的安全和可靠使用,是需要解决的问题。

9. 附录:常见问题与解答

问题1:AI Agent和LLM有什么区别?

AI Agent是一个能够感知环境、自主决策并执行行动的智能实体,而LLM是一种基于大规模数据训练的语言模型,主要用于语言处理和生成。AI Agent可以利用LLM的能力,但它还具备感知环境、决策和行动等功能。

问题2:如何评估AI Agent模拟LLM抽象思维过程的效果?

可以从多个方面进行评估,如信息理解的准确性、抽象概括的合理性、推理的正确性和决策的有效性等。可以使用一些指标如准确率、召回率、F1值等进行量化评估,也可以通过人工评估的方式进行定性评估。

问题3:知识图谱的构建需要注意什么?

知识图谱的构建需要注意数据的质量和准确性,要确保知识的来源可靠。同时,要考虑知识图谱的可扩展性和维护性,以便在需要时能够方便地添加和更新知识。

问题4:强化学习算法在AI Agent中的应用有哪些局限性?

强化学习算法的训练过程通常需要大量的时间和计算资源,而且在一些复杂环境中可能会陷入局部最优解。此外,强化学习算法对奖励函数的设计比较敏感,奖励函数的不合理设计可能会导致Agent学习到错误的策略。

10. 扩展阅读 & 参考资料

扩展阅读

《AI 3.0》:深入探讨了人工智能的发展现状和未来趋势,对AI Agent和大语言模型的发展有一定的启示。《智能时代》:介绍了人工智能在各个领域的应用和影响,帮助读者了解AI Agent的实际应用场景。

参考资料

相关学术论文和研究报告,可以从IEEE Xplore、ACM Digital Library等学术数据库中获取。开源项目的文档和代码,如TensorFlow、PyTorch等项目的官方文档。

相关文章