2025年春节上来后,deepseek的火爆程度我就不多说了。这里先跟着自豪一下,国产AI终于扬眉吐气了一把!更重大的是,我们还开源免费,什么chatGPT、openAI啥的,还要付费翻墙加付费购买去上,拜拜吧你们!

闲话不多说,直接上干货。

本地化部署deepseek,企业用户(大中型企业或者由于保密性要求不能上外网的企业)的比较适合,一般企业和个人用户用deepseek官网或者市面上的第三方(阿里云、百度云、华为云等等)集成的deepseek应用即可,一般免费版的数量就够用了,个别用户使用量较大的,花点钱买套餐也不贵,绝对比自己搭建便宜许多许多。

为什么不提议普通企业和用户去本地化部署deepseek呢?缘由如下:

由于这玩意太烧硬件,对服务器的CPU、显卡啥的要求特别高。的确 有蒸馏版甚至可以部署在个人电脑上,但是小编不提议。一是蒸馏版的功能太差了不好用;二是就算是最低版的蒸馏版,在个人电脑上运行也很卡,我试过了,那是相当卡,卡到你根本不想用了(思考几分钟才开始答,答的过程钟也是一两秒出一个字,大家可以体会一下。)。

蒸馏版的答案根本不可靠

企业部署请尽量部署满血版,功能强劲好用,只是的确 需要很好的硬件配置服务器才行,硬件成本比较高。

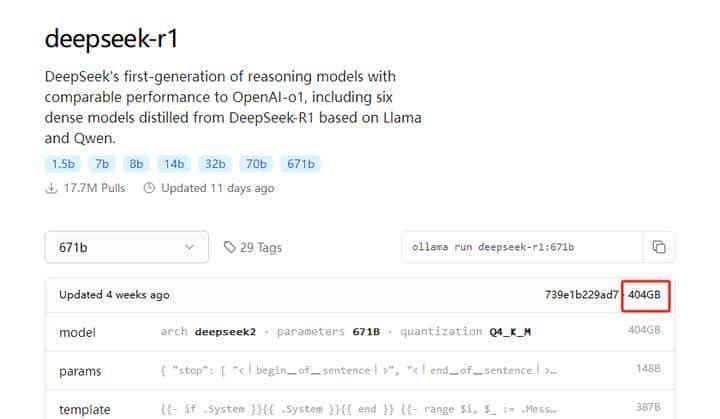

满血版模型就404GB了,要跑这个模型很费硬件

既然这么贵,那为啥要本地化部署,不是官网还有许多第三方都免费么?缘由如下:

第一:由于访问量太大,官网常常性的服务器忙,体验超级不好。

一般只能问一个问题,第二三个问题就崩溃了

第二:第三方的,由于他们接入官方deepseek的时候是出了接口费用的,另外他们的平台资源也不是免费的,所以他们开放给普通用户的时候,也只是限量免费,超过必定数量就收费了。所以如果使用量特别大的企业,还是提议自己本地部署。

第三:有些企业有保密性要求,不能直接访问云平台等外网平台。这种情况,就只能自己本地部署了。

下面重点介绍本地化部署的过程,网上有许多教程,其中有些关键步骤没有写清楚,本人这里的都是自己实测过的,可以保证落地。

一、关于系统软硬件环境的选择。

既然是企业部署、是满血版部署,那么肯定是服务器部署了,普通服务器还不行。

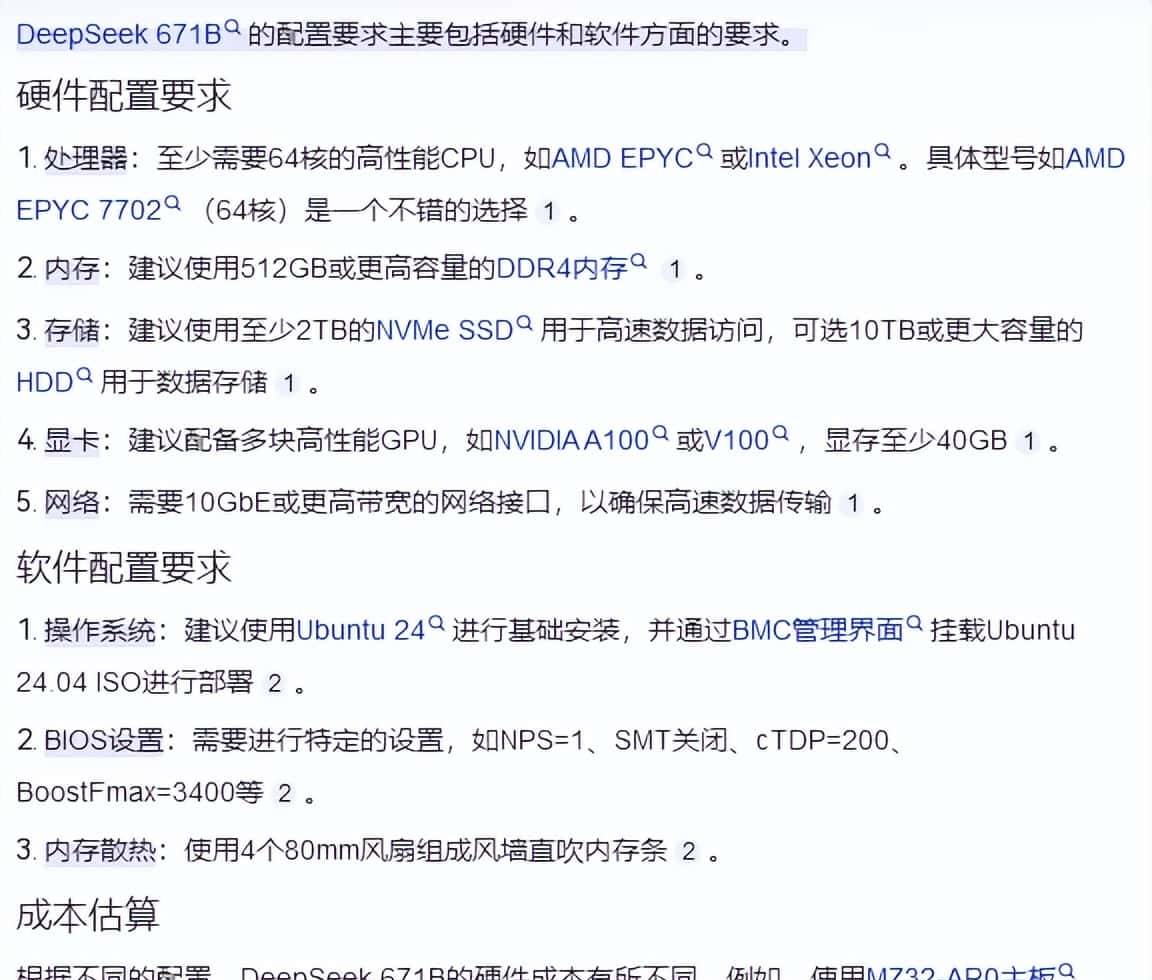

硬件:提议最低配置:64核CPU、512GB内存、2TB的SSD硬盘、40GB显存、万兆网络。

软件:操作系统提议选择linux系列,如debian、Ubuntu都可以,最好都选择最新版本。Windows的话需WSL2,那还不如直接上linux呢,所以本文直接以linux为例进行部署。

需要配置一台大几万的服务器

二、部署过程详解。

1、安装deepseek模型。

1)安装ollama

超级简单,运行下面这条命令即可。

curl -fsSL https://ollama.com/install.sh | sh

如果运行过程中提示命令不识别,安装一下curl就可以了,安装命令如下

apt update

apt install curl

安装完成后启动服务并设置开机自启。

systemctl start ollama

systemctl enable ollama

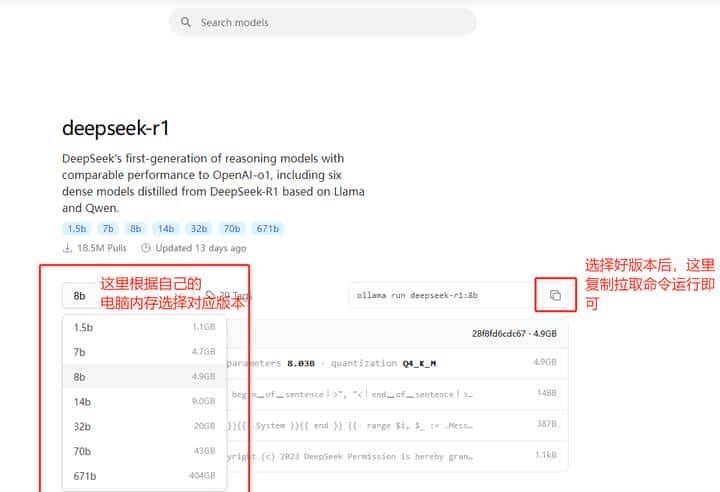

2)拉取deepseek-r1模型

安装好ollama后,需要用ollama拉取一下deepseek-r1的模型。这里默认拉取满血版,如果需要拉取蒸馏版,可以到官网ollama拉取deepseek-r1模型官网根据自己的配置去拉取(模型内容多大就需要多大的内存),拉取并运行满血版(671b),超级简单,命令如下:

ollama run deepseek-r1:671b

蒸馏版请根据自己电脑(服务器)配置进行选择

运行完成后,在当前的运行界面即可进行提问了。

不过这样提问超级不方便,特别是对于企业来说,肯定是希望所有人都能方便访问的。这时,就需要另外的插件,通过该插件接入deepseek模型,企业内所有人就都看看而已通过自己电脑的浏览器来访问企业搭建的deepseek模型了。这类插件有许多,我这里推荐MaxKB。

安装并使用MaxKB插件步骤如下:

一、配置ollama的远程访问权限。

上面搭建好的ollama,只能本机本地访问,如果企业要让所有人都能访问,必须放开ollama的远程访问权限。方法如下:

vim

/etc/systemd/system/ollama.service \或者用vi编辑也可以,反正是编辑左边这个文件

在[Service]标签下增加下面两行语句

Environment=”OLLAMA_HOST=这里填企业deepseek服务器的IP地址”

Environment=”OLLAMA_ORIGINS=*”

编辑保存后,重新加载一下systemd并重启ollama,命令如下:

systemctl daemon-reload

systemctl restart ollama

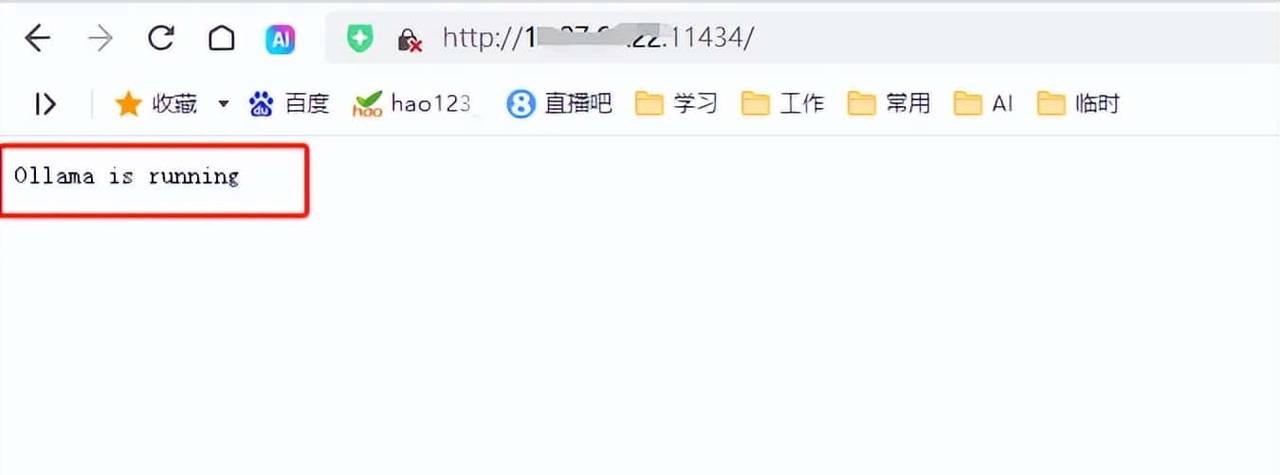

操作完后来,在浏览器输入http://企业deepseek服务器IP地址:11434,如果浏览器里面输出Ollama is running就表明已经可以了。

出现这个页面,表明内网所有电脑都能访问Ollama服务了

二、安装MaxKB插件

提议使用docker安装MaxKB插件,方便快捷,一条命令即可。如果linux服务器上没有安装docker,请用下面的命令先安装docker(以debian系统为例)。

apt-get update

apt-get install docker-ce docker-ce-cli containerd

安装完成后,启动Docker服务并设置它为开机启动:

systemctl start docker

systemctl enable docker

最后,验证Docker是否正确安装并运行:

docker –version 如果正确显示了Docker的版本信息,就表明成功了。

Docker安装成功后,用下面的命令安装MaxKB插件

docker run -d –name=maxkb -p 8080:8080 -v ~/.maxkb:/var/lib/postgresql/data cr2.fit2cloud.com/1panel/maxkb

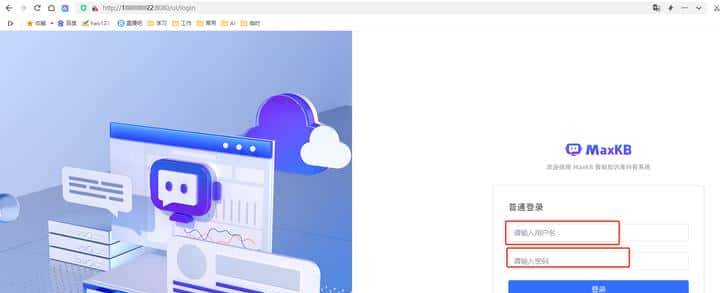

MaxKB插件安装成功后,在浏览器里访问http://企业deepseek服务器的IP地址:8080/ 页面,对MaxKB插件进行deepseek模型的接入配置。页面登录信息如下:

用户名: admin 初始密码: MaxKB@123..

这里填上上面的账号信息

登录进去后来,开始deepseek模型的接入配置,步骤如下:

添加模型

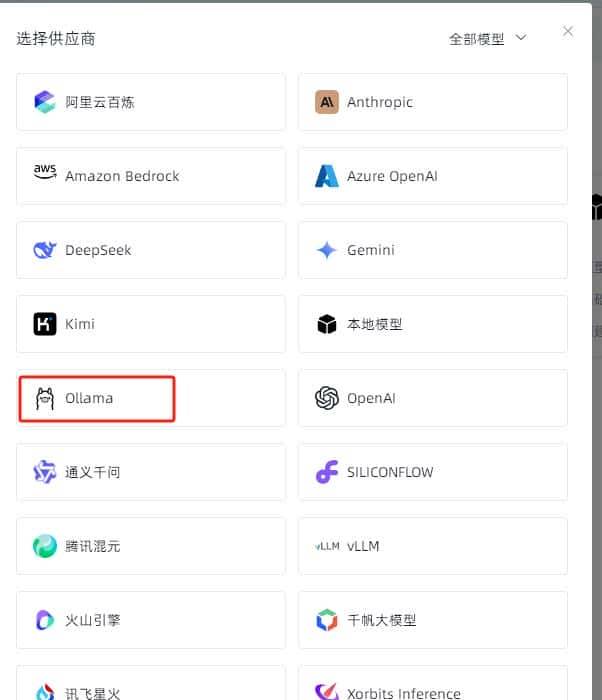

选择ollama

填好参数信息保存

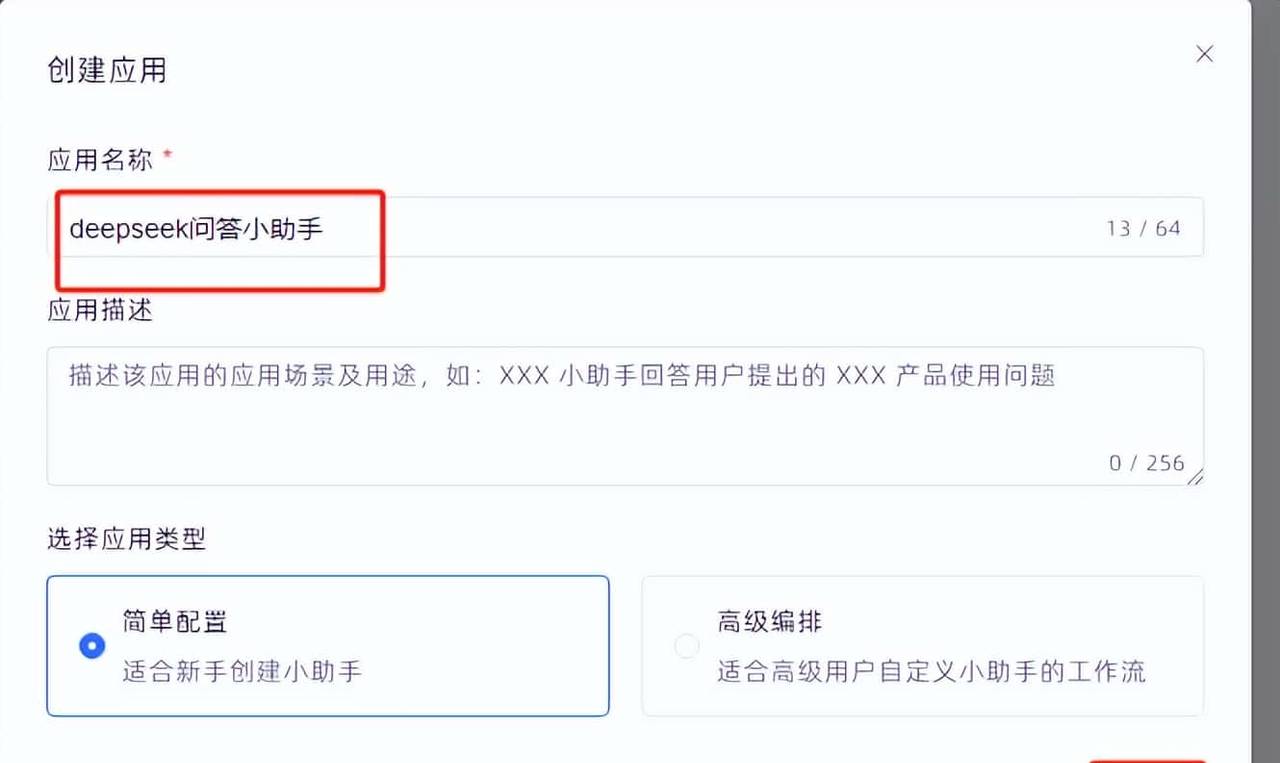

到首页去创建应用

取个易懂的名称创建

选择之前添加的模型,保存并发布

首页会显示刚才创建的应用,点击进去

复制这个公开访问链接,企业所有人都可以用浏览器通过这个链接去访问本地部署的deepseek了

好了,到这里整个deepseek企业linux服务器版的本地部署过程就完成了,开始用起来吧。

相关文章