上一篇写道v6.0,直接开始7.0

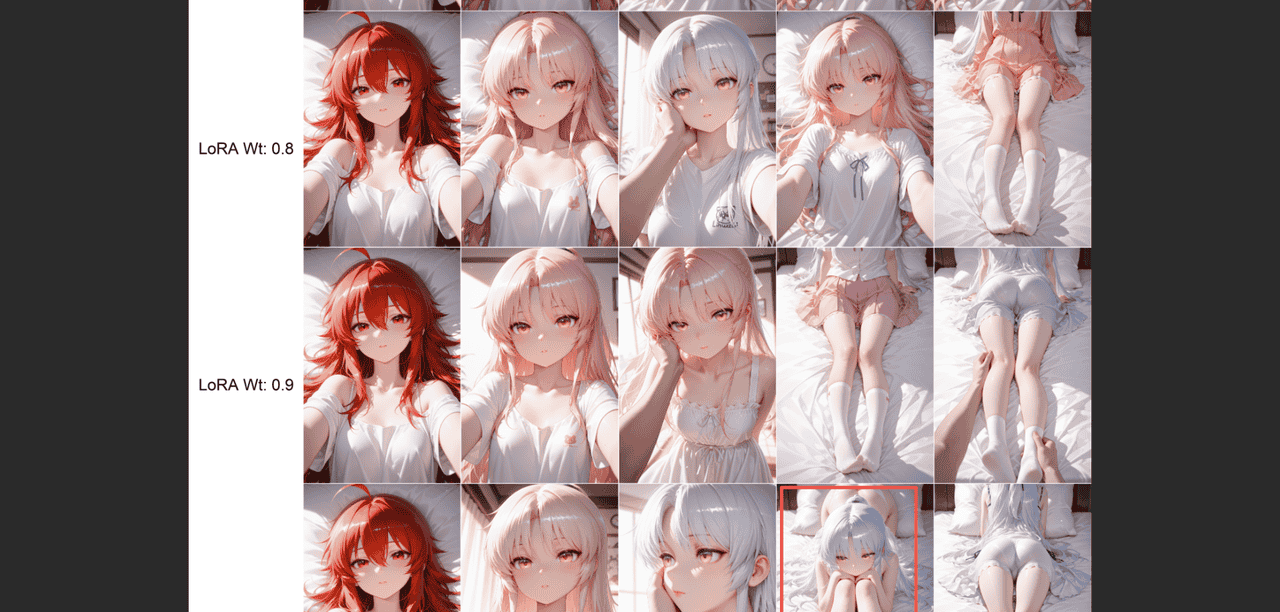

v7.0版本

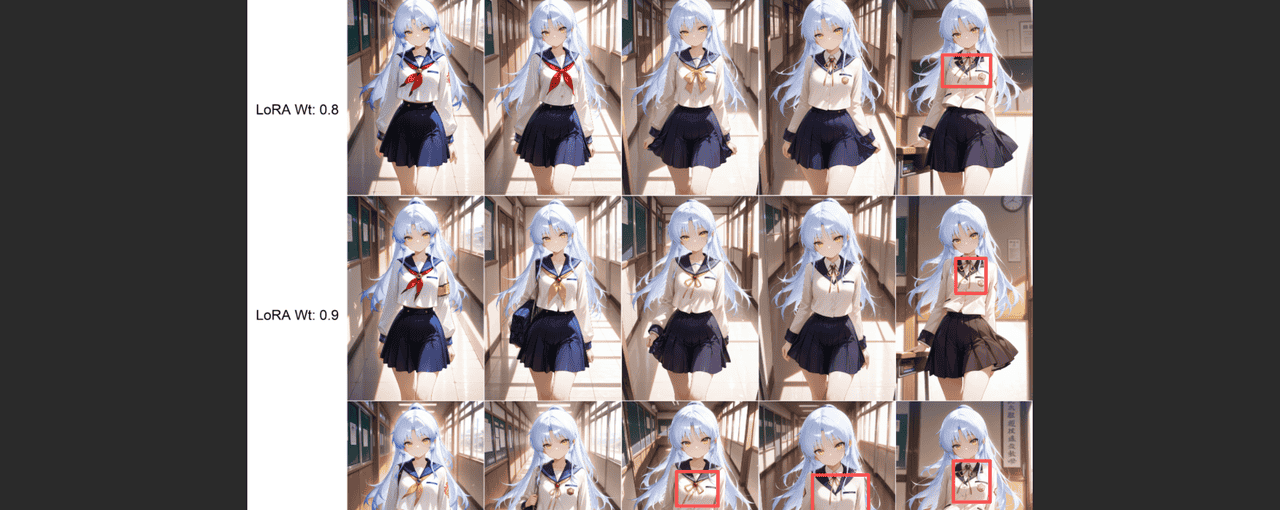

只使用触发词:lihuazhou

都挺不错眉心的红点也没了,比v6.0效果好一些,就是06的头发有点混乱

one是真的瑟,权重到1的时候06会出现坏点,最好在权重0.8左右

wai模型日常翻车,感觉就是spda的原因(v6.0也是)

完善触发词

没啥问题,06领带都有问题,最适合权重在0.8

one模型只有权重1时候领带才正常,看上去也就在08和10选择

wai模型也一样,不过10的模型表现会好一些,权重0.9左右

v7.0总结

最终选择是10,综合评分最好,不过手指方面没有太大问题

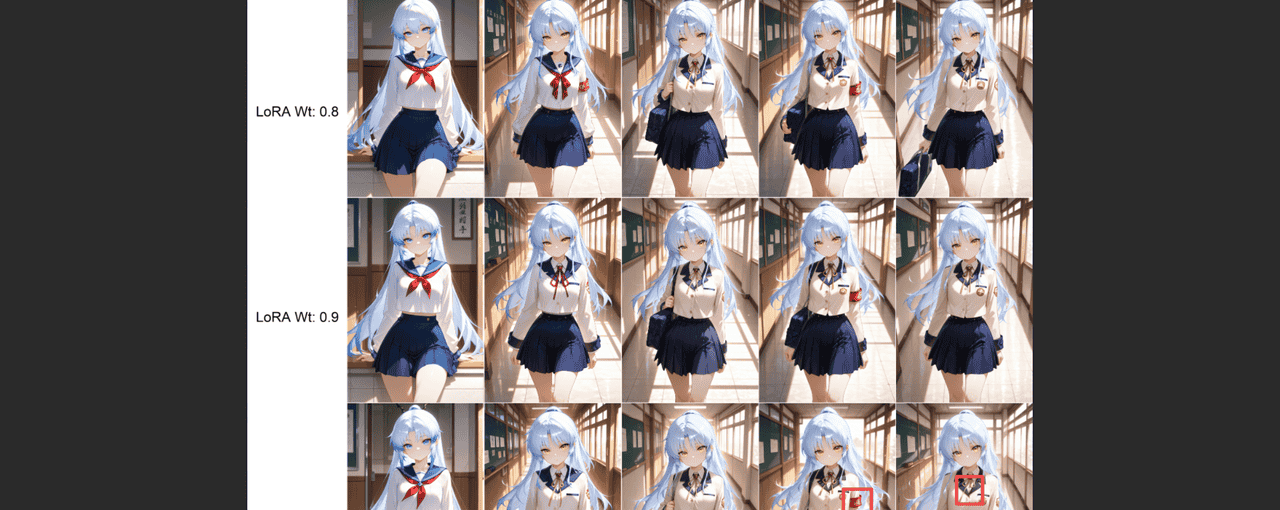

v8.0版本

只使用触发词:lihuazhou

都没啥问题,就是吐槽一下衣服….有衣领然后没有了??直接露肩,那这个衣领为啥不设计成吊带!!…有这种设计的吗?

10的衣服花纹很多很乱,那个衣服设计我怀疑就是ai自己没有完整生成,暂时预定06-10

one开始翻车,06手感觉反过来了,而且出现不明肢体,10的话,全是腿,我怎么知道这个角色是不是立华奏啊…..权重0.9最好

奇怪,wai竟然没翻车(一样有spda),10表现不好,反而是06表现好

完善触发词

janku竟然翻车了,明显细节全部不对,至于那个裙子我知道什么问题,训练集有一张裙子有问题,就是颜色一部分出错,权重0.9最适合,暂时看10表现最好

one看来08和10好一些(10更好),10权重高的时候会出现手指问题,最好权重在0.8

wai全面翻车…说实话v8.0只是把bs改为2,怎么会变化这么大?我查了一下lora的信息,发现我把学习率调度器改成了constant(恒定),看到有up说神童的话这个好一些…..

v8.0总结

基本上可以放弃了,效果都不太好,一定要选的话10好一些,盲猜是学习率调度器的问题,要么就是bs加大会影响质量

v9.0版本

只使用触发词:lihuazhou

janku效果都还行,06-10

one直接翻车,权重1的时候肢体甚至有问题,没有一个像的

wai也是翻车….

完善触发词

janku暂时看只有08和10,08领带容易出问题,10表现良好

one只有权重1正常,目前看只有10,算是翻车

wai的话….08校服出现了护臂,而且校服长度有问题,硬要选的话就是10

v9.0总结

硬要选的话就是10,v9.0版本我换回了余弦重启,把bs开到了4,明显bs开高了质量下降挺多…

大总结

先整理一下,我的电脑配置:

炼制lora肯定不能太久,才1900步怎么用一天太过分了….

所以肯定是使用3.0之后的版本了

时间对比

v3.0只启用xformers,速度2.44s/it,时间是1个多小时(忘了截图最后,但是速度肯定比一开始快)

v4.0、v5.0参数调节错误,导致显示有问题,并且完全没法用,等下后面讲

v6.0只启用了spda,速度2.15s/it,时间1小时8分

v7.0同时启用xformers和spda,速度1.89s/it,时间59分钟48秒

v8.0把batch_size设置为2,速度3.26s/it,时间52分钟8秒(960步)

v9.0把batch_size设置为4,速度6.48s/it,时间52分钟55秒(490步)

其实时间上差不多,盲猜spda和xformers差不多,可以同时开启,但是感觉质量会稍微下降

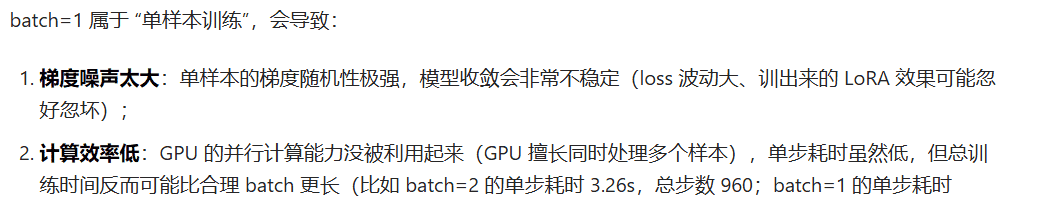

v8.0和v9.0我使用了多bs,8.0是2,9.0是4,依次翻倍

明显开启多批次是可以节省步数,但是我发现相应的速度也会升高,理论上不会才对…这样我开跟不开区别不大,因为只快一点点,质量确明显下降….

显卡问题(个人猜测)

看一下我开到4bs的时候

显存占了14g了,再开高应该就要爆炸了,当然我怀疑是5060ti的显存带宽还有核心都占满了,所以高bs的作用基本没有,速度翻倍增长…..

当然只是个人的猜测,准不准不知道,不然为啥多批次速度反而升高….

不过显存够了,还是能运行,总比运行不了的好

速度与质量

一般速度越快,质量会越低(当然除非显卡牛逼)

根据测试:

开启xformers,再开启sdpa,速度还会加快,但是质量会稍微降低

多bs的情况要看显卡情况,也是加速度降低质量(有时候效果会更好)

我自己的配置最多bs=2,再高没意义

如何知道你的显卡瓶颈在哪?

用「nvidia-smi」或「NVTop」(更直观的监控工具)观察训练时的显卡状态,快速定位瓶颈:

若显存占用接近 100% → 瓶颈是「显存容量」(再增大 bs 会 OOM,只能降 bs 或用梯度累积);若显存占用没满,但「显存带宽利用率」接近 100% → 瓶颈是「显存带宽」(再增大 bs 会让传输耗时激增,单步耗时变长);若「CUDA 核心利用率」接近 100%,但显存带宽没满 → 瓶颈是「CUDA 核心数」(此时增大 bs 能轻微提速,但边际效益递减);若 Tensor Core 没开启(比如没开 FP16 混合精度) → 瓶颈是「Tensor Core 未利用」(开启后能提升并行计算效率,让 bs 增大的提速效果更明显)

这里需要自己去测试了

建议

1.按照我第一篇的加速就行,不会有啥问题(关于随机打乱标签我下一篇讲)

2.xformers和sdpa可以同时开启,但是会降低质量,我推荐用xformers

3.bs的数量得看自己显卡,有时候批次高对模型也会有好处,看下图

4.如果时间只差了30分钟以内的,推荐不要加速,要质量

5.bs的加速会明显降低质量

相关文章