引言/导读

2025年,AI领域见证了继年初“Deepseek时刻”之后又一里程碑事件——中国前沿AI公司月之暗面(Moonshot Labs)发布了全新的Kimi K2 Thinking模型。这款模型不仅是完全开源、开放权重的(Open Weights),更在多项全球最严苛的基准测试中展现出超越美国顶级闭源模型(如GPT-5和Claude 4.5)的性能。Kimi K2 Thinking的核心价值在于其作为一款“思考型智能体”(Thinking Agent)的强大能力,它能够通过长时间、多步骤的推理并结合工具使用,解决远超传统大模型处理范围的复杂问题。本文将深入分析Kimi K2 Thinking的技术突破、实测数据,以及它对全球AI开源格局和未来产业趋势产生的深远影响。

核心技术突破:Kimi K2如何实现“长时思考”?

Kimi K2 Thinking并非传统意义上的基础模型,它被构建为一个思考型智能体(Thinking Agent)。这意味着该模型拥有将复杂任务分解、规划路径并执行的能力,使其能够进行连贯且持久的推理。

思考智能体(Thinking Agent)架构

Kimi K2 Thinking的核心在于其测试时推理扩展(scale up test time reasoning)的设计。它不再是简单地一次性给出答案,而是能够像人类一样,在推理过程中逐步使用工具。

惊人的工具调用与推理能力:Kimi K2 Thinking能够自主适应性地学习和规划,在不需要人类干预的情况下,连续执行高达200至300次工具调用。这种长程规划和适应性学习能力,使其能够跨越数百个步骤进行连贯推理,以解决最复杂的难题。高效的专家混合模型(MoE):Kimi K2 Thinking是一个万亿参数模型(Trillion parameters),拥有384个专家(experts),而DeepSeek R1拥有256个专家。尽管模型规模较大,但在推理过程中(inference)只有320亿参数处于活跃状态。这表明它在保持巨大能力的同时,也具备较高的运行效率。上下文长度:该模型具有128,000的上下文长度,但也有早期报告指出其上下文长度实际上达到了256K。此外,Kimi K2 Thinking的模型词汇量为160,000,大于DeepSeek R1的129,000。

SOTA基准超越:挑战“人类最后一考”

Kimi K2 Thinking在多项最具挑战性的基准测试中取得了最先进水平(SOTA)的表现,显著缩小了开源模型与前沿闭源模型之间的差距。

碾压性胜利:Humanity's Last Exam (HLE)

“人类最后一考”(Humanity's Last Exam, HLE)是公认的难度最高的基准测试之一。Kimi K2 Thinking在此测试中的得分达到了44.9分,超越了GPT-5的41.7分。这标志着一个完全开源、开放权重的模型在最高难度推理任务中,性能已经优于美国实验室的顶级闭源模型。

代理式浏览与信息整合(Browse Comp)

在评估模型持续浏览、搜索和对难以获取的真实世界网页信息进行推理的能力时,Kimi K2的表现尤为突出。

Kimi K2 Thinking在Browse Comp基准测试中得分60.2%,显著优于GPT-5的54.9%,更是远超Claude Sonnet 4.5 Thinking的24.1%。更令人震惊的是,Kimi K2 Thinking的成绩远远超过了人类基准线(Human Baseline)的29.2%。这表明在需要搜索并整合零散、复杂信息的工作中,AI智能体已经具备了超强的实用价值。

编程与复杂任务表现

Kimi K2 Thinking在编程领域同样表现出色,尤其在LiveCodebench V6这一竞争性编程基准测试中,获得了83.1分的成绩。虽然在Swebench Verified基准测试中略低于GPT-5和Claude Sonnet 4.5 Thinking,但71分的得分仍然是一个非常好的成绩。

案例展示:从高阶数学到地理空间分析

Kimi K2 Thinking的实战能力通过多个复杂用例得到了验证,尤其体现了其在多步骤、多工具协作任务中的独特优势。

解决复杂科学难题与信息推理

该模型展示了解决博士级别的数学问题的能力。在解决该数学问题时,Kimi K2在链式思考(chain of thought)过程中执行了23次工具调用。它不仅进行推理,还主动执行网络搜索,查找参考资料(如搜索“双曲正态分布PDF”)来辅助其解决问题,并在搜索和推理之间反复迭代,最终给出了正确的答案。

此外,在解决一个需要复杂逻辑推理和信息筛选的谜题(例如关于一位特定运动员、大学和科幻电影的线索)时,Kimi K2也通过一系列的搜索和推理步骤,成功锁定了正确人选。

交互式代码与可视化生成

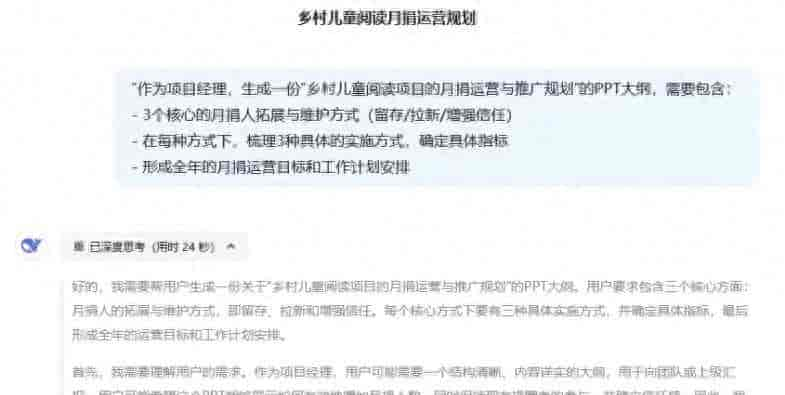

Kimi K2 Thinking在代码生成方面表现出高水平。用户只需通过单个提示词,它就能:

创建功能复杂的网页组件:例如一个功能齐全的类似Word的文本编辑器克隆,包含删除、不同字体、字号、加粗、下划线等功能,甚至能将文档保存到本地计算机。生成科学可视化:例如创建梯度下降(gradient descent)的完整可视化解释,这对于科学教学和B-roll素材制作具有极高价值。复杂系统模拟:比如创建病毒攻击血液中细胞的模拟,用户可以通过滑动条调整病毒数量、复制率、白细胞数量和检测范围等参数。

跨学科数据分析实例:加纳医疗可及性分析

最令人印象深刻的案例是其在地理空间数据分析方面的能力。在一个提示中,要求Kimi K2分析加纳的人口密度与医疗设施可及性之间的关系,需要它完成以下任务:

下载最新的World Pop人口栅格数据和医疗设施坐标数据集。计算每个设施周围10公里半径内的平均人口密度。按最低人均设施覆盖率对前10个地区进行排名。生成地图和条形图进行结果比较。

Kimi K2 Thinking在“Okay Computer”环境中,自主创建了完整的待办事项列表并开始执行。最终,它生成了一个完整的执行摘要报告,包含交互式地图、覆盖图层、地区级别差异的图表,以及数据来源和方法论。整个过程仅需一个提示和一次调试反馈。

深度分析与洞察:中国AI的“开源时刻”与成本革命

Kimi K2 Thinking的发布不仅是技术上的突破,更是对全球AI生态格局的一次有力冲击。

全球AI格局的重塑:中国势力的崛起

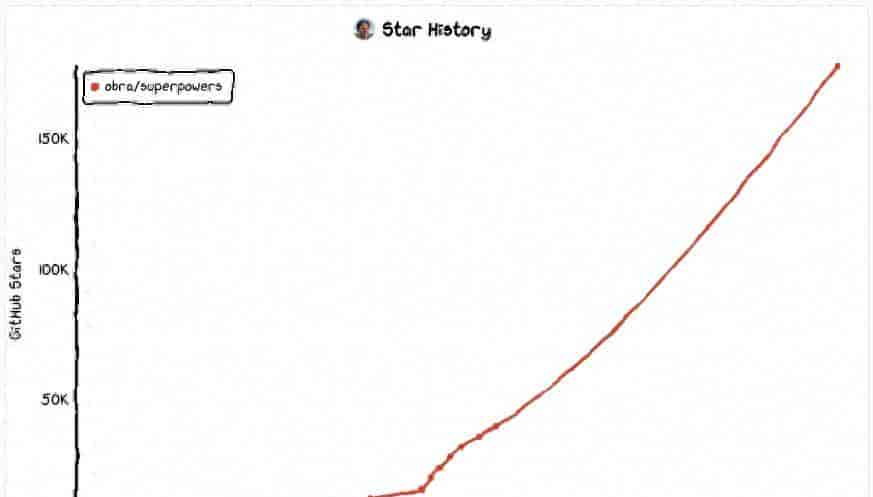

AI领域专家Nathan Lambert指出,在2025年年初,关注AI的人可能只知道少数几家公司。但到了2025年年末,DeepSeek、Qwen(通义千问)和Kimi已经成为家喻户晓的名字。这些中国公司仅用了大约六个月的时间,就追上了开放前沿模型的性能水平。

Kimi K2的出现,延续了“Deepseek时刻”所代表的“中国开源时刻”趋势。它与DeepSeek R1一同,共同推动了开源模型的性能上限,并且在许多前沿领域,特别是长时推理和工具调用方面,提供了新的利基(niche)优势。

开放与闭源的界限正在模糊

Stability AI创始人Emad Mostaque祝贺Moonshot Kimi在多项基准测试中取得SOTA,并强调了一个核心趋势:闭源模型与开源模型之间的差距正在持续缩小。随着像Kimi K2这样高性能的开放权重模型的出现,即使是经济价值越来越高的代币(tokens),其成本也在崩塌。

这对于开发者生态是巨大的福音。当最先进的模型以开放权重的形式提供时,开发者和企业可以避免“厂商锁定”(vendor lock-in),将应用程序部署到更靠近用户的全球基础设施上。

前沿模型训练成本的急剧下降

Emad Mostaque还揭示了一个关键的行业秘密:训练前沿模型的成本正在快速下降。

基础的Kimi K2模型使用了280万H800小时,14.8万亿Tokens进行训练,估计成本约为560万至600万美元。虽然推理版本的后训练细节未公开,但可能仅增加了20%的成本。这意味着,如果使用如Blackwell这样的尖端芯片,达到当前SOTA水平的训练成本可能会低于300万美元。训练成本的快速下降,是推动开源模型快速迭代和普及的关键动力。

总结与展望

Kimi K2 Thinking以其思考智能体架构和卓越的工具调用能力,不仅在数据上超越了目前的顶级闭源模型,更在应用上展示了强大的复杂任务处理潜力。它代表了开源AI领域的性能新高。

随着中国AI力量在开源前沿的集体爆发,行业焦点正从“能否达到顶尖性能”转向一个更深层的问题:这些高性能的开放模型,能否在特定的前沿利基市场中提供真正被用户需要的价值?

Kimi K2 Thinking在代理式浏览、长时推理和地理空间数据分析等领域的优势,预示着AI Agent时代正在加速到来,开发者将拥有更高效、更具成本效益的工具来构建下一代AI应用。

要点摘要

核心突破:Kimi K2 Thinking是月之暗面发布的完全开源、开放权重的“思考型智能体”。性能标杆:在“人类最后一考”(HLE)中得分为44.9,超越GPT-5的41.7。智能体能力:能够进行长程规划,并自主执行200至300次连续工具调用。推理优势:在代理式浏览基准Browse Comp中,Kimi K2 Thinking的60.2%得分远超人类基准线(29.2%)和GPT-5。架构效率:基于MoE架构,拥有1万亿参数,但在推理时仅激活320亿参数,效率高。行业趋势:训练前沿模型的成本正在快速下降至数百万美元量级;中国公司在2025年迅速跻身开源前沿,闭源与开源的性能差距持续缩小。

原始视频:https://youtu.be/s_YfqQ_KHYA?si=WVs7vBpnrrt1uBFs

中英文字幕:【Kimi K2 Thinking:中国开源AI的SOTA时刻,性能超越GPT-5的深度解析】

相关文章

![[LaTeX] VScode+SumatraPDF 配置正反向索引](https://www.dunling.com/img/7.jpg)