对于许多想深入AI领域的普通人和开发者来说,OpenAI的ChatGPT虽然强劲,但闭源的特性和高昂的API费用让人感觉像是租用了一个黑盒。真正的弄潮儿,早已将目光转向了开源大模型(Open Source LLM)。开源模型不仅可以免费商用,还能在自己的电脑上离线运行,彻底杜绝数据泄露的风险。而在当前的开源生态中,Meta的Llama 3和国产的DeepSeek无疑是两颗最耀眼的明星。

先说Llama 3。作为科技巨头Meta的诚意之作,Llama 3一经推出就席卷了全球各大排行榜。它的核心优势在于极佳的“基础能力”和强劲的“社区生态”。你可以把它理解为一个天赋异禀且性格温顺的空白画布。由于其开源特性,全球开发者都可以对其进行微调(Fine-tuning),以适应各种垂直领域的需求。无论是在普通的消费级显卡上运行轻量级版本,还是在服务器集群上部署405B的巨型版本,Llama 3都表现得游刃有余。对于想学习大模型底层原理的人来说,研读Llama 3的代码和架构是最佳途径。

而国产之光DeepSeek(深度求索)则走出了一条截然不同的道路——“极致性价比与长上下文”。DeepSeek最大的杀手锏是其惊人的128K上下文窗口,这意味着它可以一次性阅读并理解长达数百页的文档!此外,其在代码编写和数学计算方面的能力甚至超越了许多闭源模型。更让人震撼的是,DeepSeek完全开源了其训练框架和模型权重,并且API的定价堪称“白菜价”。这使得它成为了许多国内初创企业和独立开发者的首选后端。

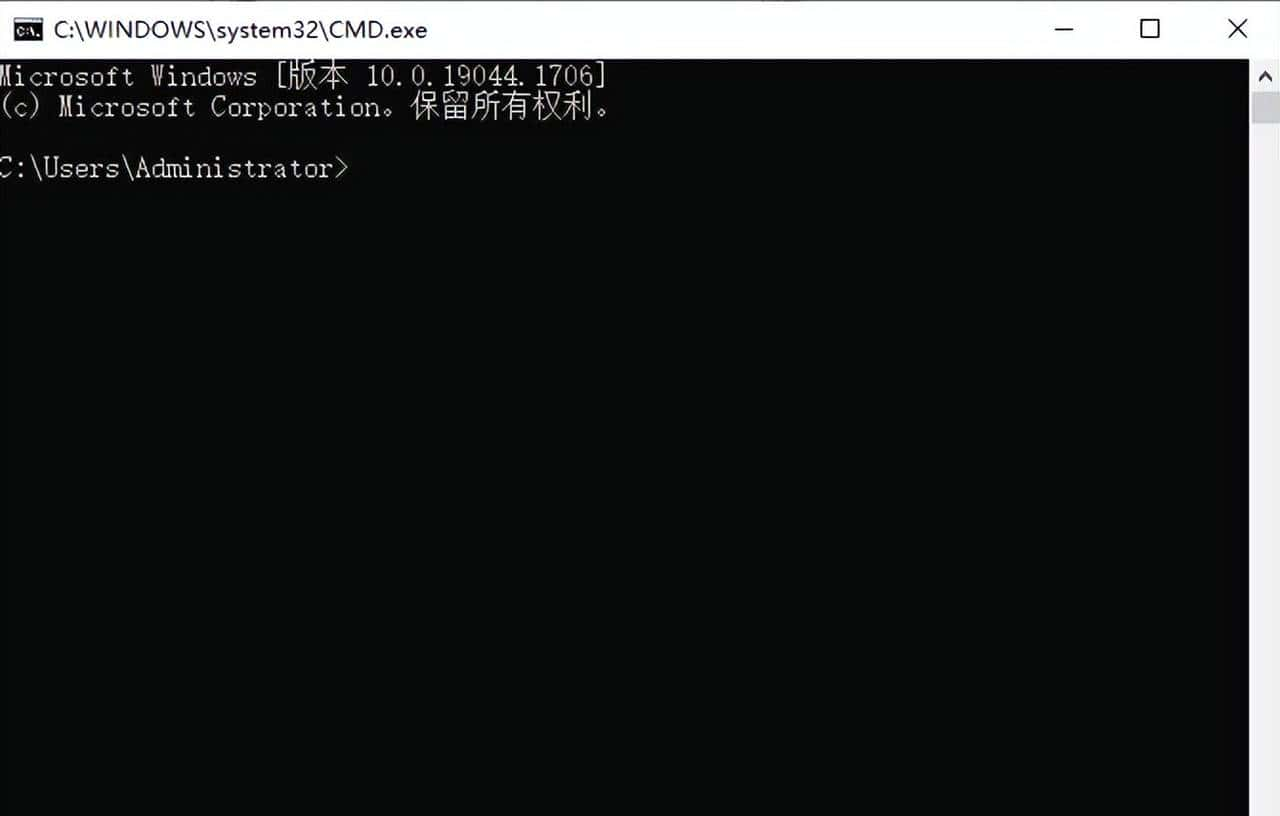

那么,普通人该如何上手这些开源模型呢?最便捷的方式是利用Ollama。这是一个专为本地运行大模型设计的轻量级工具。只需在终端输入一行简单的命令(如

“ollama run llama3″),它就会自动下载并运行模型。配合NextChat等开源的前端界面,你可以在自己的电脑上拥有一个完全私密、响应极快的AI助手,再也不用担心聊天记录被上传到云端。

如果你有一台配备NVIDIA显卡的电脑,还可以尝试LM Studio。这款软件提供了图形化界面,让你可以像安装手机APP一样,从Hugging Face等模型库中一键下载和管理各种开源模型。你可以直观地看到模型的运行速度、内存占用,并调整各项参数(如Temperature, Top P等),这对于理解大模型的运作机制大有裨益。

开源大模型的崛起,实际上是将AI的权力下放给了每一个普通人。你不再需要依赖大公司的施舍,可以根据自己的需求定制专属的AI。列如,你可以下载一个医疗问答数据集,微调一个专门解答健康疑问的AI(当然不能替代医生),或者结合自己的读书笔记,训练一个能与你探讨哲学的私人导师。

面对琳琅满目的开源模型,新手往往会陷入“选择困难症”。我的提议是:从Llama 3的8B版本或DeepSeek的7B版本开始。它们体积小、运行快,足以应付日常的文本生成和问答需求。随着经验的积累,再逐步尝试更大的模型。在这个开源力量蓬勃发展的时代,掌握本地部署和微调开源模型的能力,无疑是为自己点亮了一门通往未来的硬核技能。

相关文章