目前的 AI 竞赛,所有人都在谈论算力、能源和模型参数的军备竞赛,但这些都不是真正的瓶颈。真正的、也是最被低估的瓶颈,是人类现有组织架构对 AI 生产力的「吸收能力」。

技术已经狂奔到了一个我们甚至无法完全理解其潜力的地步,而我们的工作流程、安全范式、软件架构乃至法律体系,还停留在上一个时代。

这并非危言耸听,而是刚刚结束的思科 AI 峰会上,Sam Altman 等一众行业塑造者流露出的核心焦虑。

问题的核心是 Sam Altman 提到的一个概念,叫做「能力悬置」(Capability Overhang)。这个词完美地概括了当下的窘境:AI 模型的能力已经远远超过了企业和个人实际应用它的水平。

AI 已经可以进行严肃的科学发现,可以编写完整的软件,但绝大多数组织还在为如何将一个聊天机器人安全地接入内部知识库而反复开会。

思科的 CPO,Jeetu Patel,也提出了一个相互印证的观点,他称之为「进步的悖论」(Paradox of Progress)。一方面,AI 每天都在解决越来越复杂的问题;另一方面,企业却很难清晰地阐述出这些技术在投资回报率(ROI)上的具体影响。

这两位身处行业风暴中心的人,从不同角度指出了同一个实际:技术的发展速度,已经与组织的吸收速度严重脱钩。

这才是 AI 革命下半场真正需要解决的问题。否则,再多的算力投入,最终也只会变成昂贵的数字空转。

从「工具」到「队友」:下一个范式转变已经到来

要理解「吸收能力」为何如此重大,第一要理解 AI 在工作场景中的角色正在发生根本性变化。

如果说 ChatGPT 的诞生让 AI 成为了一个触手可及的「工具」,那么 Sam 所说的下一个「ChatGPT 时刻」,则来自于 OpenAI 最近发布的 Codex。

Sam 对这个应用的评价极高,他认为这让他第一次感受到了另一个「ChatGPT 时刻」的到来,由于它清晰地展示了知识工作的未来。

由于与 Codex 交互的感觉,不再是使用一个工具,而是与一个「队友」(Teammate)或「合作者」(Collaborator)一起工作。

这是一个极其关键的认知转变。

工具是交易性的、被动的。你给它一个指令,它返回一个结果。你用完就放在一边。而队友是协作性的、主动的,它拥有上下文,能够理解你的工作流,与你共同完成一个复杂的任务。

思科内部也经历了这个认知转变。Jeetu 提到,他们在早期使用 Codex 时,最初的几个月也只是把它当成一个“了不起的工具”,直到 OpenAI 的工程师点醒他们:“你们的思考方式错了,你们必须把它看作一个队友。”

Jeetu 举了一个具体的例子:在思科,目前 70% 的 AI 产品代码是由 AI 生成的。他预测,到 2026 年,思科将有至少半打产品实现 100% 的代码由 AI 编写。

这带来的直接结果是,过去软件开发的瓶颈在于「编写代码」,而未来,瓶颈将转移到「阅读和审查代码」。

人类工程师的角色,从一个埋头苦干的「写手」,变成了一个指挥、审查和修正 AI 队友工作的「项目经理」或「架构师」。你的工作不再是实现每一个细节,而是确保 AI 队友的产出符合最高标准。

这种人机协作模式,对现有的项目管理、团队分工、绩效考核,乃至企业文化,都提出了颠覆性的要求。

无法完成这种从「使用工具」到「管理队友」心态转变的组织,将无法真正利用 AI 带来的生产力跃迁。

他们会发现,即便给每个员工都配备了强劲的 AI,工作效率的提升也很快会遇到天花板。由于他们仍在用管理锤子的方式,去管理一个智能化的合作伙伴。

三大「非显性」障碍:真正拖后腿的不是芯片

当所有人都聚焦于算力、能源这些看得见的物理限制时,Sam Altman 指出了几个更为棘手,但往往被忽视的「非显性」障碍。这些才是制约「吸收能力」的根本缘由。

第一个障碍是安全与数据访问范式的缺失。

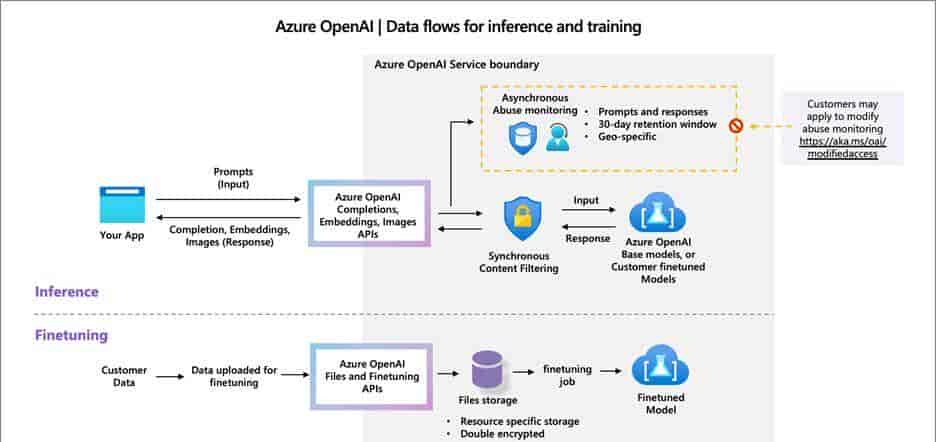

一个真正的 AI 队友,需要访问你的所有工作数据——你的会议记录、你的 Slack 聊天、你的电子邮件、你正在编辑的文档。只有这样,它才能提供有价值的、具备上下文的协助。但我们现有的安全模型是为此设计的吗?显然不是。

如何在保证数据安全、隐私合规的前提下,赋予 AI 必要的权限,这是一个至今没有完美答案的难题。Sam 认为,我们需要为此发明一种全新的安全或数据访问范式。

第二个障碍是软件架构的代际落后。Sam 举了一个例子:他很讨厌处理 Slack 信息,希望他的 AI 智能体能代劳。但问题是,当 AI 智能体访问 Slack 网页界面去阅读信息时,它会把所有未读消息都标记为“已读”,这彻底破坏了他本人的工作流。

这个揭示了一个问题:我们现有的软件,是为「人类用户」设计的,而不是为「人类与 AI 共同使用」设计的。未来的软件需要被重写,使其 API 和交互逻辑能够同时服务于人类和 AI 智能体,甚至主要由 AI 使用。这是一个庞大的工程,涉及到对过去几十年软件设计理念的根本性改造。

第三个障碍是硬件、权限系统和法律框架的滞后。我们畅想的 AI 助理是“永远在线”的,它能倾听你的会议,观察你的操作,并随时提供协助。但这需要计算机硬件从底层支持这种持续的、低功耗的感知能力。

我们的操作系统权限管理体系,并没有为“一个程序可以观察所有其他程序”这种情况做好准备。

这三个障碍,每一个都比“再建一个数据中心”要复杂得多。它们无法用钱和资源快速堆砌出来,需要的是整个行业在基础理论、工程实践和法律法规层面的协同进化。

而在此之前,AI 的「能力悬置」只会越来越严重。

物理基石:AI 时代的基础设施挑战

当然,强调「吸收能力」的重大性,并不意味着物理基础设施就不重大。恰恰相反,它是一切的必要条件。

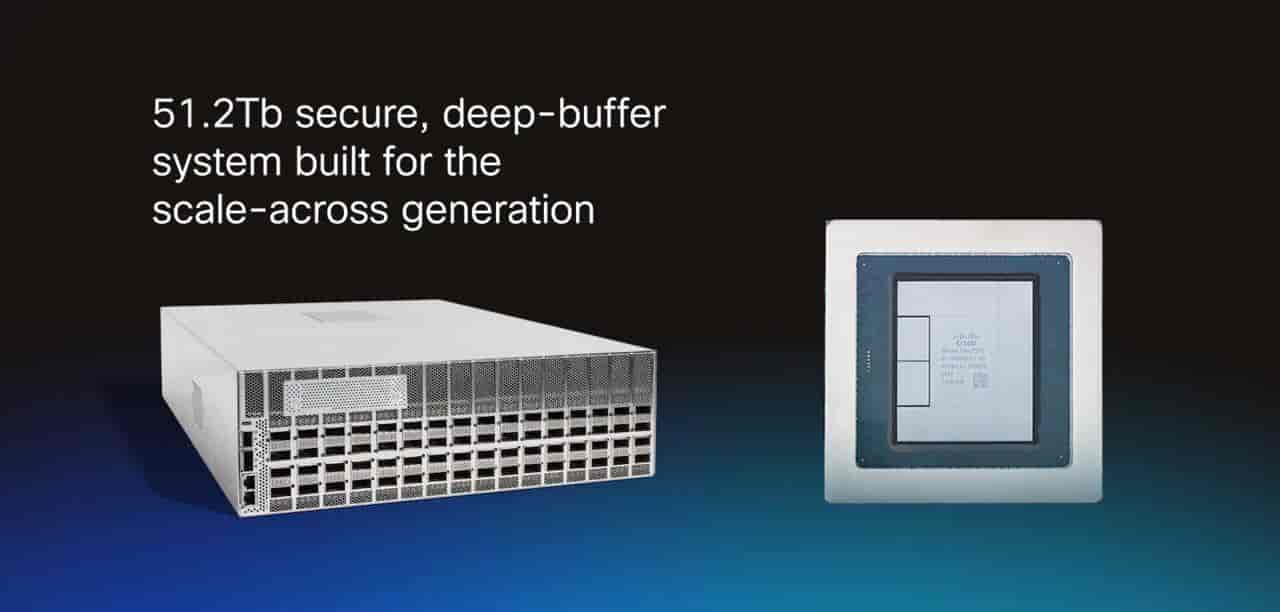

Jeetu Patel 详细阐述了思科如何从底层芯片开始构建 AI 时代的基础设施。例如,他们开发的 G200 芯片用于数据中心内部 GPU 集群的高速互联,由于单个不联网的 GPU 毫无意义。而随着模型规模越来越大,单个数据中心的电力和空间已经无法满足需求,于是他们又开发了 P200 芯片和相应的系统,让相隔数百公里的多个数据中心能够像一个“超级集群”一样协同工作。这背后是相干光通信等技术的极限突破。

AI 基础设施的复杂性已经远超普通认知。我们讨论的不再是单个服务器的性能,而是跨越城市甚至大洲的计算资源的整合能力。

Sam Altman 认为,世界对 AI 的需求,类似于对电力的需求。你不能笼统地问市场有多大,而要看在不同价格水平下需求有多大。如果 AI 变得足够强劲且足够便宜,需求将是无穷无尽的。他预测,世界将需要“多得多得多”的 token,即使每个 token 的生成效率会变得极高。

这种判断,解释了为什么 OpenAI 愿意在基础设施上投入天量资金,也解释了为什么资本市场和全球供应链正在围绕 AI 进行重构。这是一个基于“AI 将像电力一样无处不在”的宏大赌注。

还有一个战略层面的问题:在开源模型领域,美国正在失去领先地位。

虽然最前沿的模型可能会通过 API 提供服务,但用户对于能在本地运行、由自己控制的私有模型的需求会越来越大。特别是当你有一个 AI 智能体需要了解你生活的方方面面时,你更希望它运行在自己能控制的硬件上。

结论:真正的竞赛刚刚开始

技术的聚光灯下,是狂飙突进的模型能力和基础设施建设。但在聚光灯外的阴影里,是人类组织和社会结构缓慢而痛苦的适应过程。

Sam Altman 预测,到今年年底,AI 模型的能力可能会有主观感受上 10 倍的提升。这是一个惊人的速度。但对于企业决策者来说,真正的挑战不是如何跟上这 10 倍的速度,而是如何改造自己的组织,哪怕只是为了吸收其中 2 倍的生产力。

技术上的军备竞赛,比拼的是资本和工程能力,它会决出谁能率先撞线。但商业和社会的终极赛跑,比拼的是「吸收能力」,它会决出谁能在这场变革中真正胜出。

这既是巨大的机遇,也是严峻的挑战。对于个人而言,需要思考如何从一个「执行者」转变为一个「指挥家」。对于企业和国家而言,则需要尽快布局能够支撑这种新型生产力的基础设施,并建立相应的信任和治理体系。

在这场竞赛中,谁能更高效地生成和运用「Token」,谁就掌握了未来的主动权。

相关文章