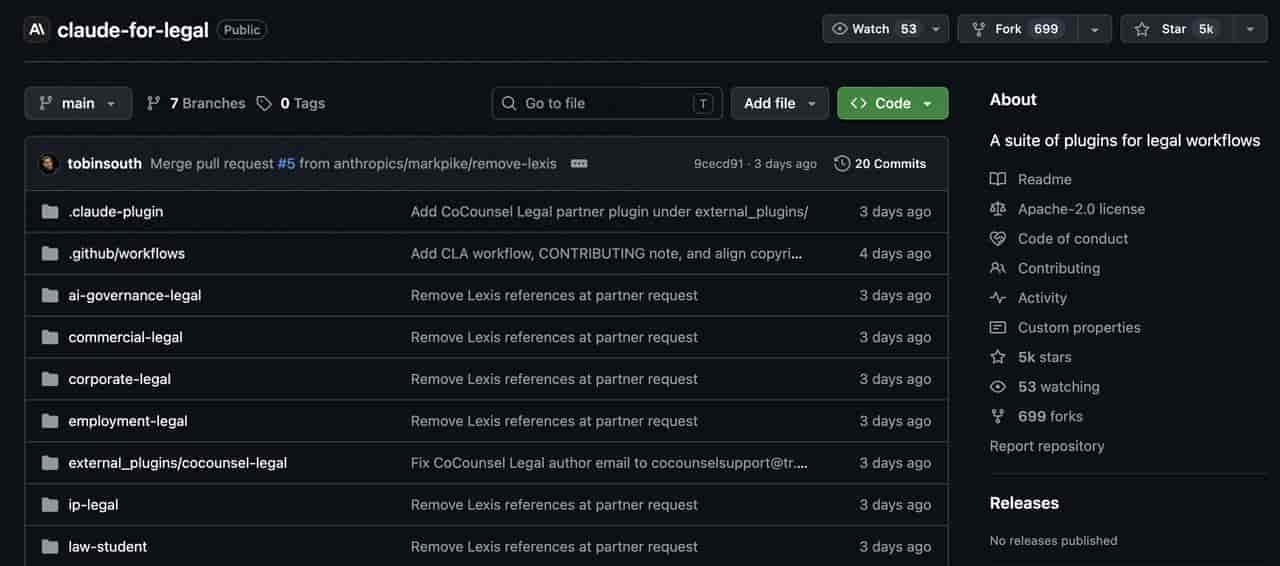

anthropics/claude-for-legal 发布页面

这两年,法律行业谈AI,最容易走向两个极端。

一种说法是:AI很快会替代律师,法律服务会被彻底改写。

另一种说法是:AI会编案例、会出错,所以法律人根本不能用。

这两种判断都太简单。

真正值得关注的,不是AI能不能一夜之间变成“电子律师”,而是它能不能把律师和法务日常工作中那些重复、耗时、文本密集的环节,变得更快、更稳定、更可追踪。

Anthropic 开源的 Claude for Legal,就是一个很典型的例子。

它不是一个单独从零训练出来的“法律大模型”,更不是可以直接替代律师给出最终法律意见的系统。更准确地说,它是一套围绕法律工作场景设计的 Claude 插件、技能、Agent 和数据连接器。

简单理解:通用大模型负责理解、生成、推理;法律专用系统负责把模型放进真实法律工作流里。

这中间的差别,对法律从业者超级重大。

一、法律AI的价值,不是“替你拍板”,而是“替你打底”

法律工作的核心当然是判断。

列如一个条款能不能接受,一个解雇决定是否有合规风险,一个产品功能能不能上线,一个监管变化是否影响公司业务,这些最终都需要法律专业人士负责。

但在作出判断之前,法律人要做大量基础工作:

阅读合同,找出异常条款;

对照公司模板,标出偏离点;

把邮件、附件、会议记录整理成实际时间线;

从尽调资料里提取关键风险;

把监管更新翻译成业务部门能听懂的话;

为客户、管理层或业务团队写第一版说明。

这些工作重大,但并不总是需要律师从零逐字完成。

Claude for Legal 这类系统的意义,恰恰在这里。它可以先帮法律人完成“第一轮处理”:归纳、比对、提取、分类、起草、标注风险,再交给律师审查、修正和作出判断。

这不是降低律师价值,而是把律师从重复性劳动中释放出来,把更多时间留给真正需要专业经验的部分。

Thomson Reuters 在 2025 年发布的 Future of Professionals Report 中提到,法律专业人士预期 AI 每年可释放接近 240 小时工作时间。这个数字不必定适用于每一家机构,但它说明了一个趋势:AI对法律行业的影响,第一不是“替代岗位”,而是重构流程。

二、它和通用大语言模型有什么不同?

许多人会问:既然 ChatGPT、Claude、Gemini 这些通用大模型已经能写合同、总结法规、解释条款,为什么还需要 Claude for Legal 这样的法律专用系统?

关键不在于“它是不是更会聊天”,而在于它是否懂法律工作的边界和流程。

通用大模型像一个能力很强的通用助手。你问什么,它就尽量回答什么。

但法律工作不能只靠“回答得像样”。

法律人真正需要的是:它能不能按我的公司模板审合同?能不能知道哪些条款必须升级审批?能不能区分可接受、需谈判、不可接受?能不能引用来源?能不能接入合同系统、文档库、邮件、法律研究工具?能不能提醒哪些地方必须由律师复核?

这就是专用法律AI和普通聊天机器人的区别。

Claude for Legal 的思路,是把法律实践拆成不同插件,列如商事合同、公司法务、雇佣法、隐私合规、知识产权、诉讼、监管、AI治理、产品法务、法律诊所等。

每个插件不是简单的“提示词模板”,而是围绕具体工作场景设计技能、团队规则、数据连接器和审查边界。

列如商事合同场景,重点不是“写一份美丽合同”,而是按公司的谈判立场审查 NDA、MSA、SaaS 协议,标出赔偿、责任限制、数据处理、终止、付款、管辖等关键条款风险。

隐私合规场景,重点是数据处理协议、个人信息请求、PIA/DPIA、跨境传输和产品隐私评审。

诉讼场景,则更重点关注案件材料整理、时间线、证据摘要、docket 监控、brief 草稿和实际核对。

也就是说,法律专用AI的重点不是“知道更多法律名词”,而是把模型能力嵌入法律工作的真实路径。

三、它和 Claude Code 又有什么不同?

Claude Code 是面向程序员和软件工程团队的 Agent。

它的工作对象是代码库、终端、测试、Git、依赖包和 CI 流程。它可以读项目、改文件、运行命令、修 bug、生成测试、解释架构。

Claude for Legal 面向的则是合同、法规、判例、邮件、尽调资料、诉讼材料、公司政策、业务需求和法律团队 playbook。

两者底层都可以使用大模型能力,但专业化方向完全不同。

Claude Code 的验证方式一般是:代码能不能运行?测试能不能通过?lint 是否报错?改动是否符合项目架构?

Claude for Legal 的验证方式则是:引用是否准确?是否适用当前管辖区?是否符合客户授权?是否触及保密或特权信息?是否需要升级给资深律师?是否只能作为草稿而不能直接发送?

软件工程里,许多问题可以用测试结果快速验证。法律工作里,许多问题没有简单的“通过/失败”按钮。

一个条款不是永远好或坏,它取决于交易地位、行业惯例、客户风险偏好、对价、谈判空间和管辖区。

所以,法律AI不能只追求生成速度,还必须强调来源、边界、审查和责任。

四、法律从业者实际能用在哪些地方?

如果只看技术,法律AI很容易被高估。

如果看具体流程,它反而很实用。

第一,是合同和交易工作。AI可以做合同初筛、条款差异对比、风险分级、摘要生成、谈判清单、标准条款提议。对于公司法务来说,这能减少低风险合同的等待时间,也能让业务部门更快知道问题卡在哪里。

第二,是合规和监管工作。合规人员每天面对大量政策、监管动态、内部制度和业务咨询。AI可以把监管变化整理成影响分析,把复杂要求拆成行动清单,再按不同部门生成不同版本的说明。

第三,是诉讼和争议解决。诉讼律师往往要处理大量实际材料。AI可以协助整理时间线、归纳证据、发现文件之间的矛盾、生成初步问题清单。它不能替律师判断诉讼策略,但可以让律师更快进入关键实际。

第四,是内部法律服务。大型企业法务部门每天会收到大量重复问题:合同能不能签、员工问题怎么处理、数据能不能共享、产品上线要不要评审。专用法律AI可以作为第一层入口,把问题分类、收集必要信息,并把高风险事项转给律师。

第五,是法律援助和法律教育。在法律服务供给不足的场景下,AI可以协助做 intake、材料整理、通俗解释和初稿生成。美国 Legal Services Corporation 曾指出,低收入群体大量民事法律需求没有得到充分协助。AI不能解决所有制度性问题,但可以降低一部分信息整理和初步沟通成本。

这些场景有一个共同点:AI做的是“辅助生产”,不是“最终负责”。

五、为什么不能直接让通用模型给法律意见?

缘由很简单:法律是高风险领域,错误成本太高。

LegalBench 论文强调,法律大模型能力不能靠主观感觉判断,而要拆成具体法律推理任务来评测。

发表在 Journal of Legal Analysis 的研究也指出,公开大语言模型在法律问题上会产生相当比例的错误内容,并且可能无法意识到自己错在哪里。

即使加入法律数据库和检索增强,也不能保证完全可靠。Stanford HAI 等研究对法律研究工具的测试显示,专业法律AI工具的错误率比通用模型有所降低,但依旧会出现不准确、缺失或误导性回答。

这说明一件事:专用法律AI有价值,但不能被神化。

它能减少低级重复劳动,却不能撤销律师审查。

它能提高起草和整理效率,却不能替代职业判断。

它能给出研究起点,却不能保证每一个法律结论自动正确。

美国律师协会在关于生成式AI的伦理意见中也强调,律师使用这类工具时依旧要履行胜任、保密、沟通、费用合理等职业义务。

技术变了,责任没有消失。

结语

未来几年,法律行业最可能发生的变化,不是律师消失,而是律师的工作方式改变。

基础整理、初稿生成、合同初筛、实际归纳、法规摘要、清单制作,这些工作会越来越多地交给AI先处理。

但法律判断、客户沟通、风险取舍、谈判策略、诉讼决策,依旧需要法律专业人士承担。

通用大模型解决的是“我问,它答”。

法律专用AI要解决的是“它能不能在我的法律工作流里,按我的规则、用可靠来源、产出可审查的草稿”。

这才是 Claude for Legal 这类系统最值得关注的地方。

它不是法律行业的终点,而更像是一个开始:把法律服务从个人经验驱动,逐步推向流程化、工具化、可复用的专业生产方式。

参考资料

- Anthropic:Claude for Legal 官方说明与开源项目

- Thomson Reuters:Future of Professionals Report 2025

- LegalBench:A Collaboratively Built Benchmark for Measuring Legal Reasoning in Large Language Models

- Journal of Legal Analysis:Large Legal Fictions

- American Bar Association:Formal Opinion 512 on Generative AI

- Legal Services Corporation:2022 Justice Gap Report

相关文章