许多人第一次听到 RAG,都会觉得这个词很“技术”,像是只有算法工程师才需要懂。

但实则,RAG 的核心思想一点都不复杂,甚至可以用一句大白话说清楚:

不是让大模型硬想,而是先帮它查资料,再让它回答。

这件事听起来简单,却恰恰解决了大模型落地中最关键的几个痛点。

今天就用最通俗的方式,聊聊:

RAG 到底是什么?它是怎么工作的?和直接微调大模型相比,它究竟解决了什么问题?

一、RAG 到底是什么?

RAG,全称叫 Retrieval-Augmented Generation,中文一般翻译成:

检索增强生成。

名字看起来有点绕,但本质实则很好理解。

过去我们直接问大模型问题,大模型主要依赖的是它训练时学到的知识,也就是“模型脑子里记住的内容”。

列如你问它:

- 什么是工业互联网?

- 什么是数据库事务?

- 什么是目标检测?

这些通用问题,它一般回答得不错,由于这些知识在训练阶段就已经“见过”许多了。

但问题来了:

如果你问的是你单位内部的制度文件、某个项目的实施方案、某门课程的教案内容,或者最新发布的一份政策,大模型往往就不必定知道了。

为什么?

由于这些内容不在它原本的训练数据里,或者它的知识已经过时了。

这时候,RAG 就派上用场了。

它的逻辑是:

先去知识库里找和你问题最相关的内容,再把找到的内容交给大模型,大模型基于这些资料来回答。

所以,RAG 不是让模型“凭空发挥”,而是让模型“开卷答题”。

二、RAG 是怎么工作的?

如果用一个生活化的比喻,RAG 很像这样一个过程:

你问一个助理问题。

这个助理不是立刻凭印象回答你,而是先去档案柜、资料库、电脑文件夹里把相关材料找出来,看完后来再回答。

这就是 RAG 的基本思路。

一般来说,它的工作流程可以分成 5 步。

1️⃣ 先把资料整理成知识库

企业制度、产品文档、教材、论文、FAQ、运维手册、项目资料……

这些内容先被收集起来,切分成许多小段。

然后系统会把这些文本转换成机器更容易比较的“向量表明”,存进向量数据库里。

你可以简单理解为:

把一堆文字资料,整理成一个可以按“语义类似度”搜索的知识仓库。

2️⃣ 用户提出问题,列如你问:

“学校智能评价平台中的教师画像模块有哪些功能?”

系统拿到这个问题后,不会立刻让大模型生成答案。

3️⃣ 先检索最相关的资料

系统会先去知识库里找和这个问题最相关的几段内容。

注意,这里找的不是简单的关键词匹配,而是更偏“意思相近”的语义检索。

也就是说,即使文档里没有完全一样的字,只要内容相关,也有机会被找出来。

4️⃣ 把资料和问题一起交给大模型

系统会把检索到的内容,连同用户的问题,一起喂给大模型。

相当于告知大模型:“别乱答,参考这几段材料来回答。”

5️⃣ 大模型生成最终答案

这时候,大模型生成的答案就不再只是依赖自身记忆,而是有了外部资料支撑。

所以,RAG 的本质可以总结成一句话:

让大模型从“闭卷考试”,变成“开卷考试”。

三、为什么 RAG 这么重大?

由于大模型虽然强,但它并不是万能的。

真正落地到企业、学校、政务、医疗、工业等场景时,大家很快就会发现:

真正难的,不是让模型会说,而是让模型说得准、说得有依据、说得跟你的业务相关。

而这正是 RAG 解决的问题。

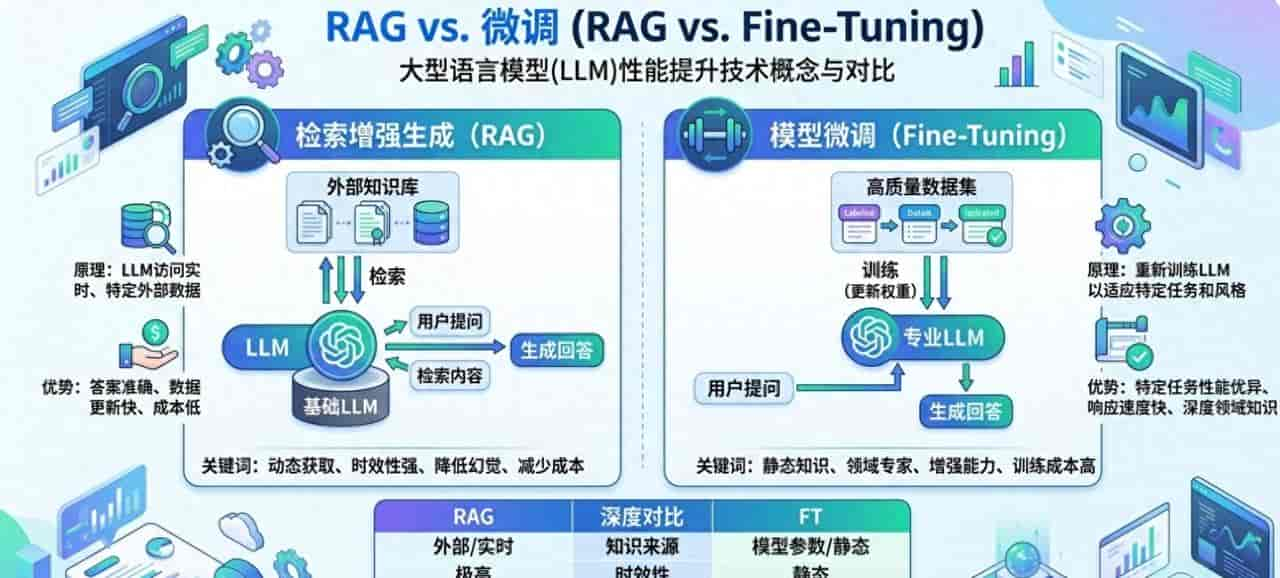

四、和直接微调相比,RAG 主要解决了什么问题?

许多人会问:

“既然大模型不懂我的知识,那我直接微调不就行了吗?”

这个想法并不完全错,但要看问题是什么。

微调是干什么的?

微调,本质上是把某些能力、风格、模式进一步“写进模型参数里”。

它更像是对模型做专项训练。列如:

- 让模型学会某种固定格式输出

- 让模型更适应某个行业表达方式

- 让模型更擅长分类、抽取、总结等特定任务

所以微调更偏向于:训练模型的“能力”和“习惯”。

RAG 是干什么的?

RAG 更偏向于解决:

模型没有最新知识、没有私有知识、回答缺乏依据的问题。

它不是把知识硬塞进模型里,而是把知识放在外部知识库,需要时再拿出来。

所以它解决的是:

知识接入问题,而不是单纯的能力训练问题。

五、RAG 相比微调,最核心解决了 4 个痛点

1. 解决“模型不知道你的私有资料”问题

通用大模型再强,也不知道你单位内部的规章制度、教学方案、项目文档、招投标文件、设备说明书到底写了什么。

这些资料往往既专业、又私有,还常常更新。

如果没有 RAG,大模型就只能“猜”。

而有了 RAG,它就能基于你的资料进行回答。

这也是为什么许多企业知识库助手、智能客服、智能问答系统,几乎都会用到 RAG。

2. 解决“知识过时”问题

大模型训练数据都有时间边界。

模型再机智,也不可能天然知道训练截止之后发生的新变化。

列如:

- 新政策发布了

- 产品手册更新了

- 制度修订了

- 教材换版了

- 设备参数变了

如果每更新一次知识,就重新微调一次模型,这件事几乎不现实。

成本高、周期长、维护复杂。

而 RAG 的优势在于:

你只要更新知识库,不用重训模型。

这在实际落地中超级关键。

3. 解决“幻觉”问题

大家用大模型最怕什么?

不是它不会说,而是它一本正经地胡说。

这就是所谓的“幻觉”。

尤其在专业场景里,幻觉超级危险。

由于用户往往不只是要一个“像样的答案”,而是要一个正确、可靠、能落地的答案。

RAG 的价值就在于,它给模型提供了明确的参考材料。

虽然不能彻底消灭幻觉,但一般可以显著降低“瞎编”的概率。

4. 解决“知识更新成本太高”问题

如果什么都靠微调,你会发现一个现实问题:

知识更新速度,远远快于模型训练速度。

企业资料、学校文件、行业规范、产品文档,可能每周都在变。

你不可能每次一改文件,就重新训练一次模型。

RAG 则更灵活:

- 文档更新了,重新入库即可

- 内容删改了,替换知识片段即可

- 新增资料了,增量加入即可

这使得它特别适合动态知识场景。

六、RAG 的优势,为什么越来越明显?

如果用一句话概括 RAG 的优势,那就是:

它让大模型真正开始“懂你的业务”。

具体来说,RAG 至少有下面几个明显优势。

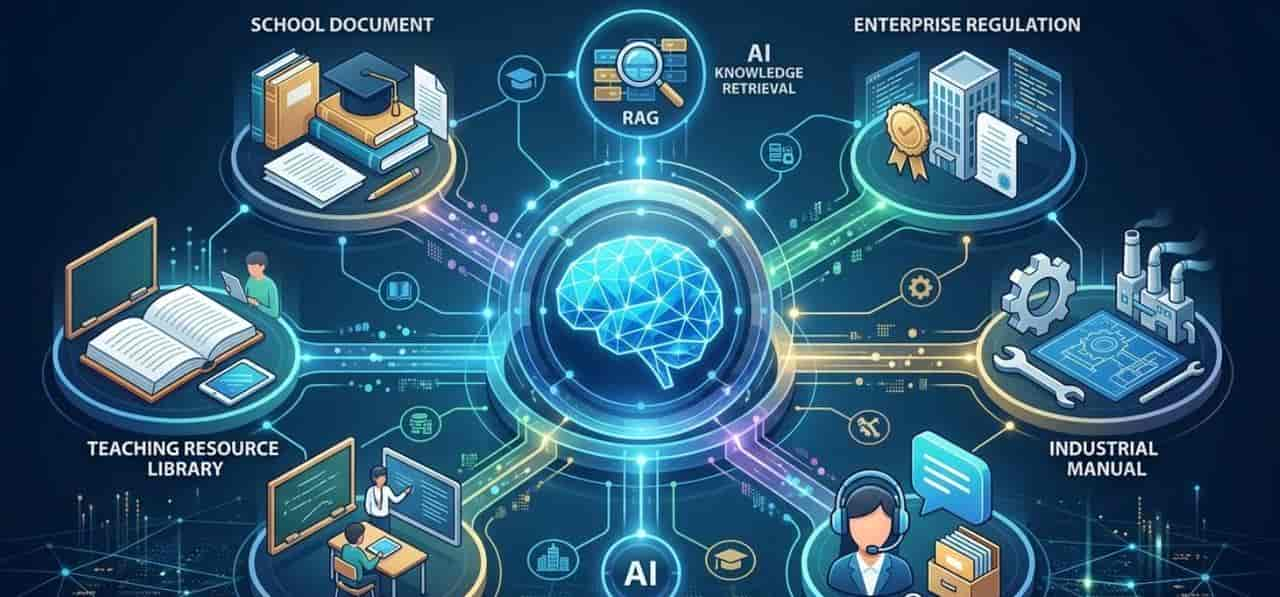

1. 可接入私有知识

企业内部文档、课程资源、科研资料、运维手册、制度文件,这些都可以成为大模型回答问题的依据。

这使得模型从“通用助手”升级为“懂你场景的助手”。

2. 知识更新快

不需要频繁训练,只要维护知识库即可。

在许多单位里,这一点比“模型参数更强”还重大。

3. 回答更可追溯

许多 RAG 系统都可以附带来源片段、引用出处、文档位置。

这意味着答案不是“拍脑袋来的”,而是“有依据可查的”。

在政务、教育、医疗、工业这些正式场景里,这一点尤其重大。

4. 落地成本相对更低

对大多数组织来说,做一个基于文档知识库的 RAG 应用,往往比自建微调体系更现实。

由于微调不仅要准备高质量数据,还涉及训练资源、模型管理、效果评估、迭代维护等一整套工程问题。

而 RAG 更像是:

把模型和知识库、检索系统、业务流程结合起来。

工程上更可控,也更容易快速见效。

七、那是不是有了 RAG,就不需要微调了?

第一,RAG和微调并不是完全对立关系,而是解决不同层面的问题。

你可以简单理解为:

- RAG 解决“知道什么”

- 微调解决“怎么做得更好”

举个例子:

如果你希望模型知道学校内部制度、知道某本教材内容、知道某个项目方案,RAG 很合适。

如果你希望模型输出更稳定、更符合某种模板、更擅长某个固定任务,那么微调可能更有价值。

所以现实里许多成熟系统并不是二选一,而是组合使用:

RAG + 微调 + 工作流/Agent

这是目前许多企业级 AI 应用的真实路线。

八、一个最容易懂的比喻

如果把大模型当成员工:

微调

像是给员工做长期培训,把知识和方法尽量“教进脑子里”。

✅ 优点是熟练、稳定。

❌ 缺点是培训成本高,知识一更新就得重新学。

RAG

像是给员工配了一个强劲的资料库、搜索系统和工作手册。

✅ 优点是更新快、查得准、有依据。

❌ 缺点是前提是你的资料库得整理得足够好。

九、为什么说 RAG 是大模型落地的关键技术?

由于现实世界不是一道道标准题,而是一堆复杂的、变化的、私有的、碎片化的信息。

企业要的不是一个只会泛泛而谈的大模型,

学校要的不是一个只会讲通识概念的大模型,

行业要的也不是一个只会“看起来很机智”的模型。

大家真正要的是:

- 能结合本单位资料回答

- 能跟最新知识保持同步

- 能减少幻觉

- 能给出依据

- 能真正接进业务流程

而这些,恰恰就是 RAG 最擅长解决的事。

所以,RAG 之所以火,不是由于它“概念新”,而是由于它真的解决了大模型落地的核心矛盾。

十、总结讨论

RAG 的本质,就是让大模型先查资料、再回答问题。

与直接微调相比,它主要解决的是私有知识接入、知识实时更新、降低幻觉、降低训练成本这些关键问题。

它最大的价值,不是让模型更会“背”,而是让模型更会“查”、更会“用”、更能“贴近真实业务场景”。

相关文章