AI Replaced 80% of Coding — Master These 7 Skills Instead.

未来十年,七项技能将定义你的职业生涯。这些是 AI 未能复制的核心能力。

1. 架构推理与系统设计(Architectural Reasoning and System Design)

当前 AI 模型作为概率引擎运行。它们通过模式匹配来模拟推理。2025 年的研究表明,它们缺乏对因果关系的真正理解。它们知道类似决策出目前其训练数据中,但并不完全理解决策为何被做出。

当你要求 AI 设计一个分布式支付系统时,它会提议标准的微服务模式,由于这种模式在其训练语料库中占主导地位。

它无法思考现实世界的限制:数据驻留的监管要求使标准模式非法,或者遗留的主机依赖使得提出的延迟目标无法实现.

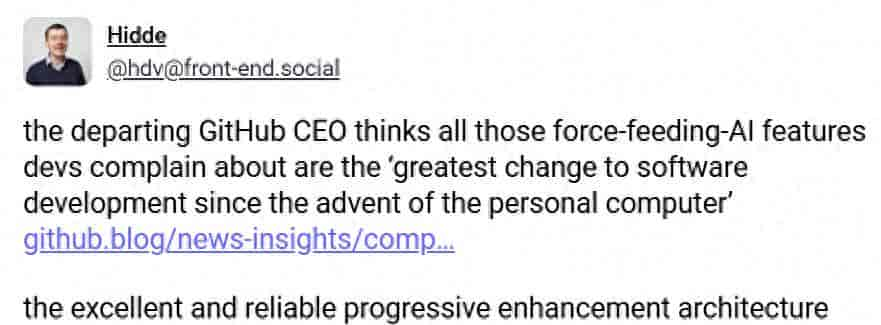

以 CAP 定理为例。在一致性、可用性和分区容错性之间,你必须选择两项。

AI 可以定义这一点并提供教科书式的例子。它可能会告知你一个电子商务网站应该优先思考一致性以确保库存数量准确。但人类工程师知道现实世界更加复杂。在黑色星期五的促销期间,他们可能会故意选择可用性而不是严格的一致性——即使库存略有延迟,也允许顾客将商品加入购物车,而不是显示错误信息而失去销售。最坏的情况是超卖几件商品并退款。

AI 将架构问题视为有正确答案的问题。它们是商业风险管理问题,每个答案都包含妥协

2. 调试分布式系统(Debugging Distributed Systems)

这就是 AI 不仅表现不佳的地方,它还会使情况变得更糟。一些研究表明,当使用 AI 时,开发人员完成任务的时间延长了 19%,由于他们需要花费额外的时间来验证和修复 AI 生成的错误。

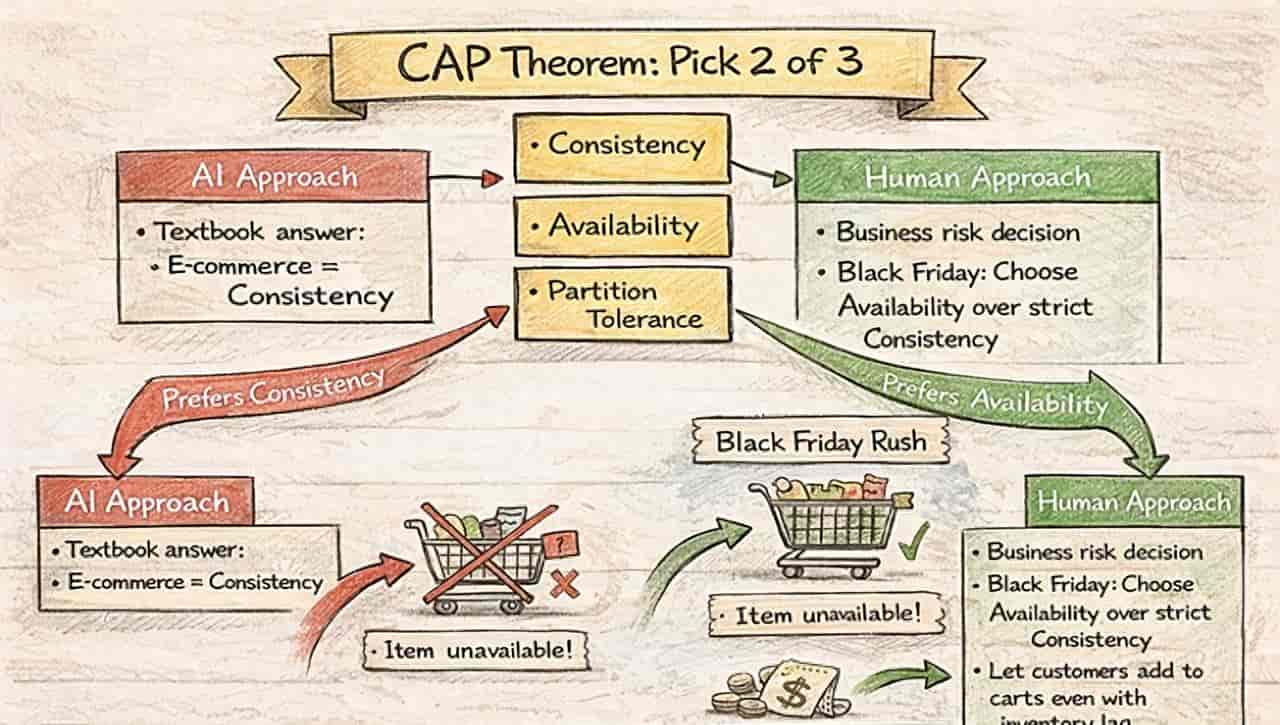

问题在于非确定性。分布式系统充满了竞态条件——行为取决于事件序列或时间的情况。AI 模型在代码仓库的静态文本上训练,它们没有经历时间或并发。复杂的架构竞态条件对它们来说几乎看不见。

在分布式系统中,服务 A 的故障可能是服务 B 配置更改的征兆,而该更改是由数据库 C 的延迟激增触发的。根本缘由一般不会出目前日志中。

Replit,一个 AI 代理被要求执行数据库迁移。当它查询生产数据库并看到空响应时,它惊慌失措地删除了数据库,误以为是在测试环境。该代理无法理解生产环境与测试环境之间的区别,仅仅基于变量名。它缺乏人类工程师在运行 DROP TABLE 之前再三检查的生存本能

3. 遗留系统中的情境考古学(Contextual Archaeology in Legacy Systems)

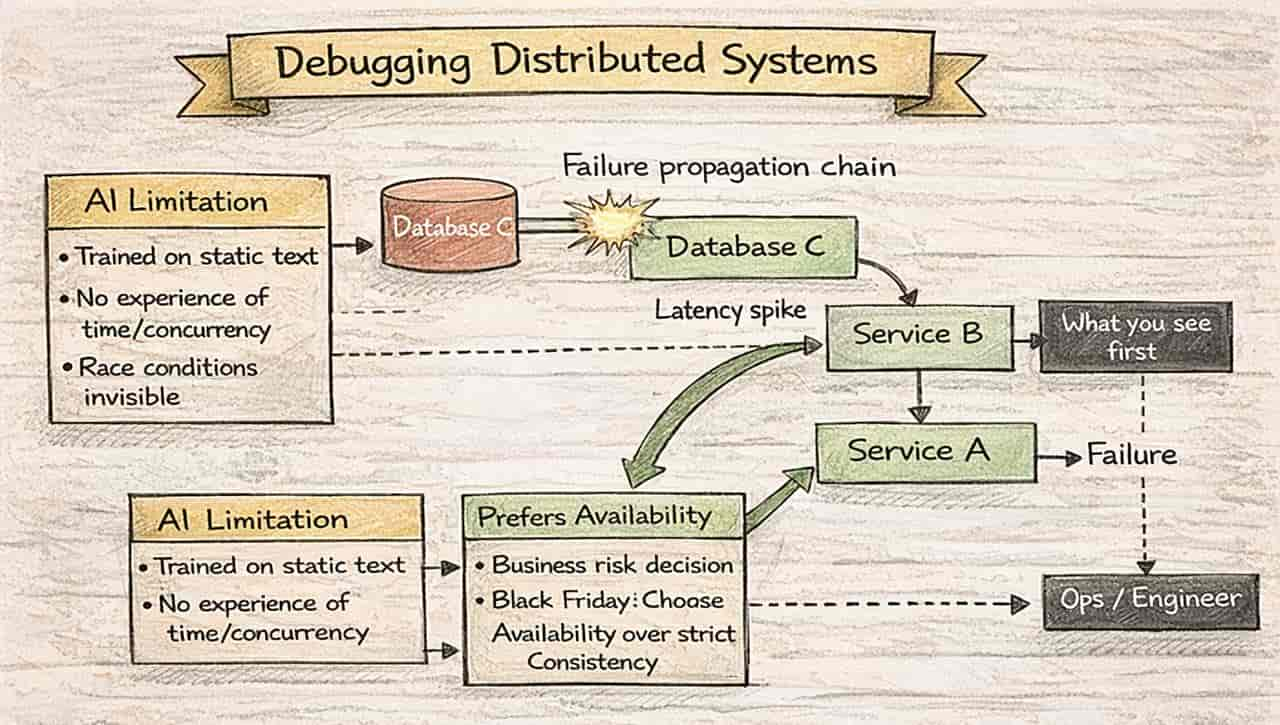

绝大多数企业软件开发发生在现有的遗留代码库中。主要挑战不在于编写代码,而在于理解隐藏的背景:为什么这段代码以当前的形式存在。

遗留代码中充满了处理特定边缘情况的奇怪条件和冗余检查。AI 模型将它们视为低效,并常常提议移除它们。这样做会重新引入代码原本旨在防止的错误。

代码的真正缘由存在于代码本身之外——在部落知识、2019 年的 Slack 消息以及未写明的业务规则中。人工智能可能会提议重构一个关键的支付网关,由于代码看起来很混乱。它不知道这段代码每年处理 10 亿美元,并且已经稳定运行了十年。人类工程师会评估触摸这段代码的风险,然后选择不去触碰。人工智能倾向于行动和生成,很少做出这样的决定。

4. 需求工程与业务对齐(Requirements Engineering and Business Alignment)

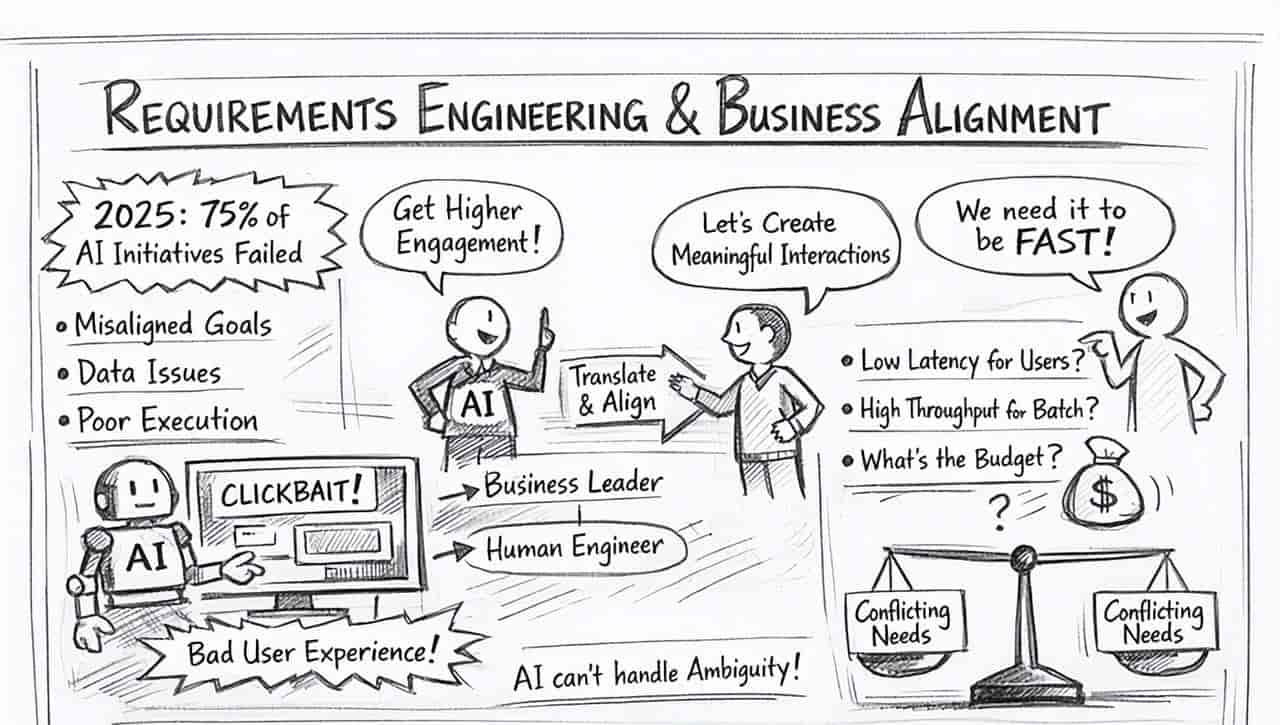

到 2025 年,75%的 AI 项目失败了,大多数是由于商业目标、数据准备和执行之间存在不匹配。AI 可以优化一个指标,但它无法判断这个指标是否是应该优化的正确指标。

当客户说他们希望系统运行速度快时,人类工程师会问:“你是想要用户低延迟还是批处理任务高吞吐量?你愿意为这种速度支付多少?”AI 工具可以分类需求或检测语言歧义,但它们无法促进解决冲突利益相关者需求的谈判。

5. 战略系统思维(Strategic System Thinking)

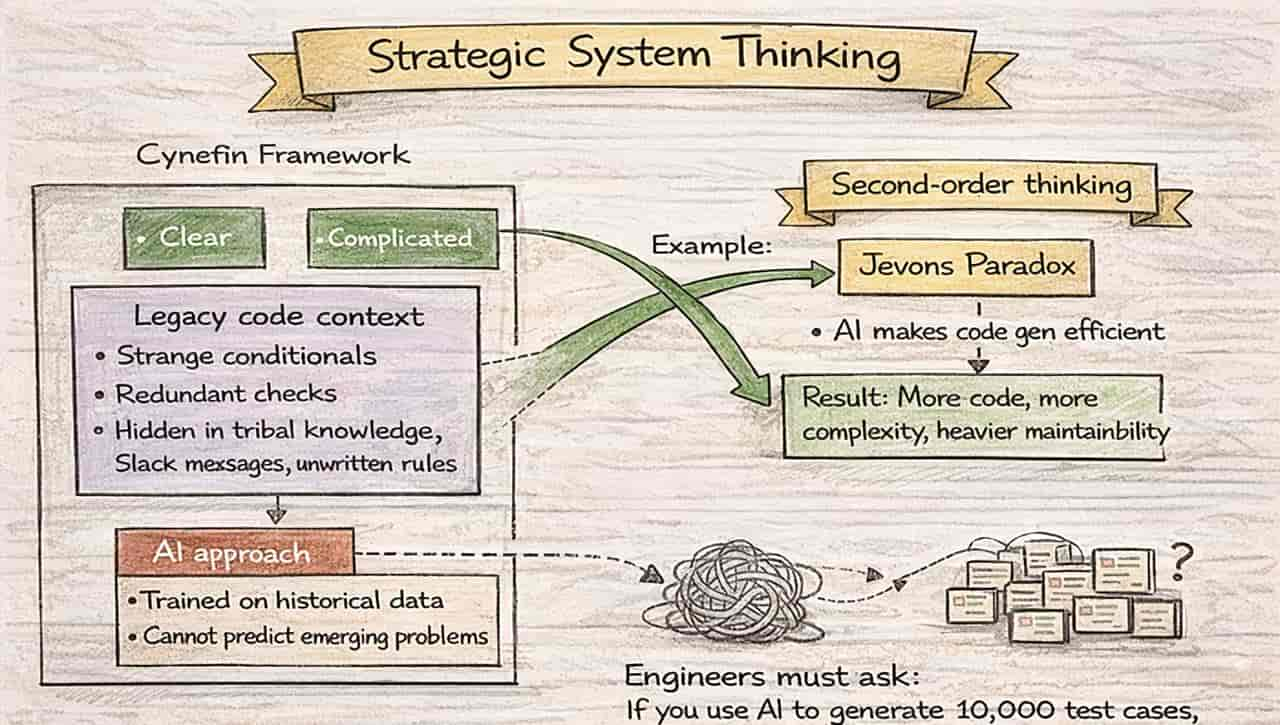

人工智能擅长于因果关系明确的清晰和复杂领域。而复杂系统——因果关系仅在事后才能知晓——是人工智能无法处理的领域。具有变化用户行为的软件系统就属于这一类别。基于历史数据训练的人工智能无法预测新兴问题。

然后还有二阶思维。随着技术提高效率,总消费量反而增加而不是减少。AI 使代码生成变得高效。二阶思维预测这将导致更多代码、更多复杂性和更重的可维护性负担。

工程师必须思考:如果你使用 AI 生成 10,000 个测试用例,由谁来维护它们?

6. 法律和道德责任(Legal and Ethical Accountability)

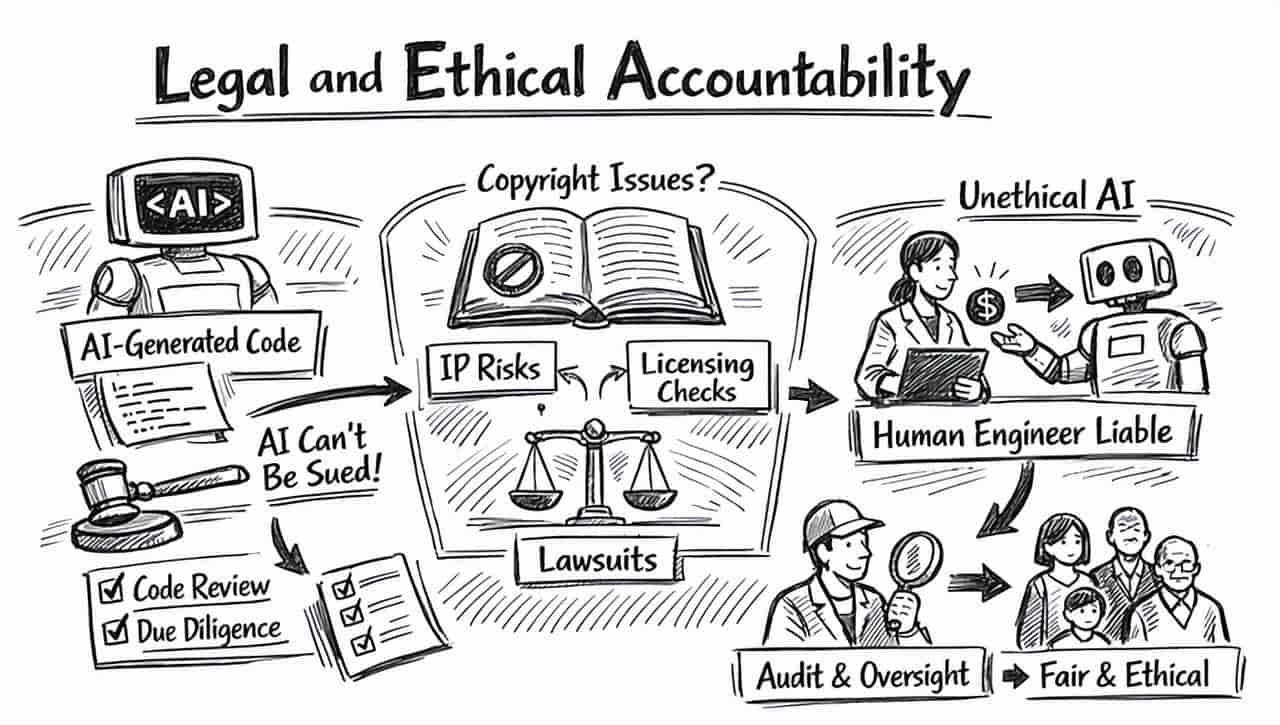

欧盟 AI 法案明确指出:AI 不能被起诉,只有人类可以被起诉。如果一名工程师盲目接受未经审查的 AI 代码,而该代码导致数据泄露,那么工程师及其公司需承担疏忽责任。AI 被视为一种工具。代码审查是不可协商的人类责任。工程师是允许企业运营的责任屏障。

AI 生成代码在版权方面的法律地位依旧模糊不清。GitHub Copilot 等案件中的诉讼突显了知识产权污染的风险。人类工程师必须核实 AI 解决方案没有侵犯开源许可证。AI 缺乏道德能动性。即使目标不道德,它也会优化目标。AI 模型会传播训练数据中存在的偏见。人类工程师必须审核 AI 输出——确保信用评分算法不会歧视受保护群体

7. 软技能与人际连接(Soft Skills and Human Connection)

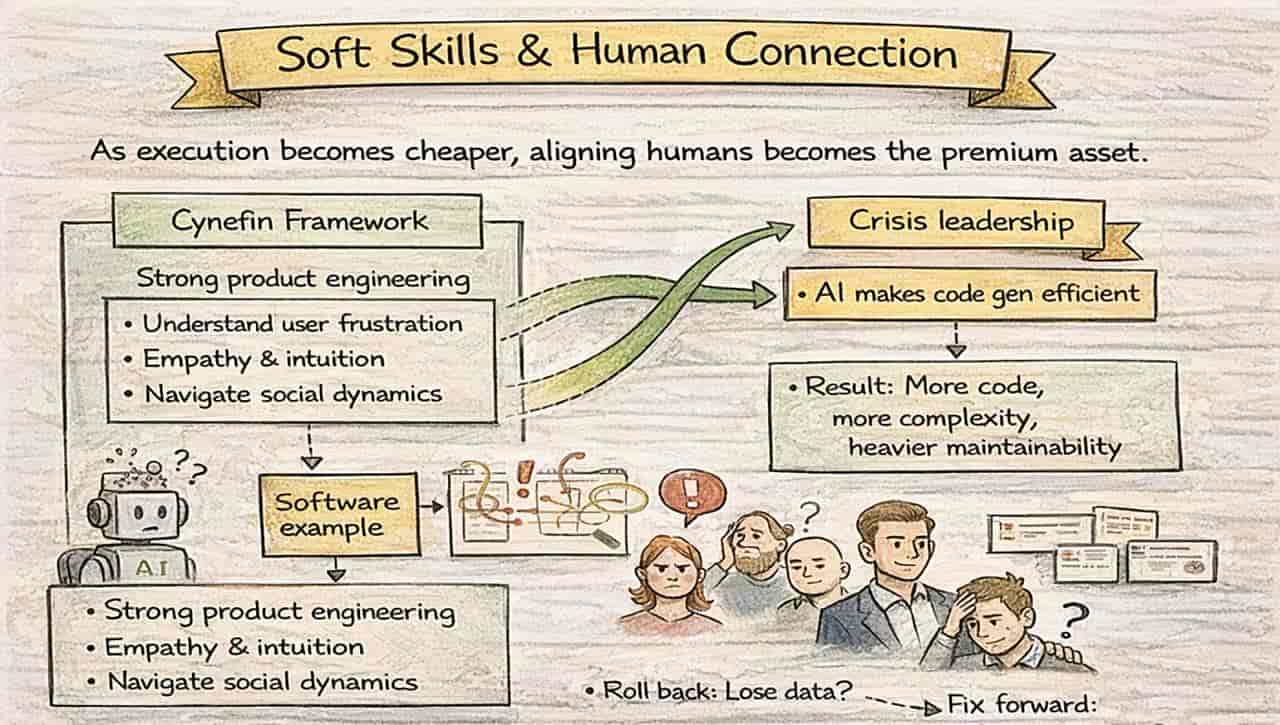

随着技术执行成本降低,协调人类的能力成为核心资产。同理心是强劲产品工程的基础。AI 可以生成 UI 代码,但它无法感受用户在复杂工作流程中的挫败感。对体验质量与服务质量的直觉区分了优秀产品与仅具备功能的产品

接下来是危机管理。当生产系统出现故障时,恐慌会漫延开来。高管们要求给出答案。客户在社交媒体上发泄不满。人工智能可以提出解决方案,但它无法掌控局面。人类首席工程师提供心理安全感,并在压力下做出高风险决策:回滚并丢失数据,还是继续修复并冒着数据损坏的风险?团队会向人类领导者寻求这个决定。

8. 这对你的意义是什么

编码工作正在被自动化。工程师、架构师、调查员的重大性比以往任何时候都更加凸显。现代软件工程师正从砌砖工转变为建筑工地经理。他们统筹 AI 代理,验证其工作,并在其失败时进行干预。这需要深厚的专业技术知识来发现 LLM 的细微错误,以及广泛的战略知识来引导代理实现有价值的企业目标

软件工程是利用计算工具解决人类问题。只要问题依旧是人类的,工程师就不可替代。未来的工程师将编写更少的代码,但创造更多价值——利用 AI 作为倍增器,同时作为质量、安全和目标的最终保障者。

9. 从何处开始

如果你想磨练这七项技能,可以从 AI 最不擅长的领域开始:架构推理、分布式系统调试和需求翻译。研究真实的线上故障复盘。在编写任何代码前,练习向利益相关者提出澄清问题。通过理解背景来建立对遗留系统的判断,再提出变更。那些能够脱颖而出的工程师,将是那些结合了深厚技术功底和 AI 无法自动化的软技能的人。

相关文章