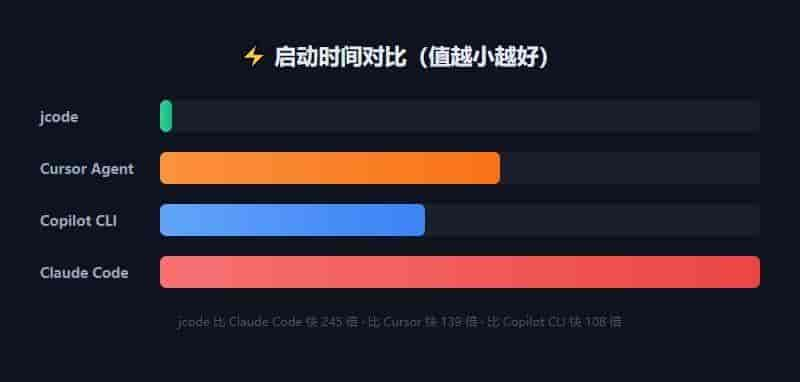

你见过开机比眨眼还快的AI编程工具吗?就14毫秒——比你手指松开回车键的神经信号还快。它跑起来只占27.8MB内存,而隔壁Claude Code吭哧半天才亮屏,已经吞掉386MB,风扇转得像直升机准备起飞。这不是营销话术,是GitHub上明晃晃贴着的Benchmark数据:首帧延迟245倍差距,10个会话总内存260.8MB vs 2300.6MB,差出将近九倍。我上个月写Go项目时,6个VS Code窗口加2个Cursor会话,32GB内存直接拉红,散热口烫得能煎蛋,隔壁工位老张探头问:“你这跑的是编译器还是宇宙模拟器?”

jcode这名字没翻译,作者1jehuang在README里轻描淡写写了句“AI Coding Agent Runtime”,但实际干的是把整套AI编码范式重锻了一遍。别人用TypeScript或Python搭代理框架,它用Rust从零手搓——没GC,没V8引擎,没Electron壳,连TUI渲染都是自己写的。你开10个会话,它多占不到100MB;Cursor开俩就敢把MacBook Pro内存条点成彩虹灯。OpenCode开10个会话直接飙到3.2GB,我试过一次,系统弹窗写着“内存压力高”,而jcode那边还在终端里安静地画着Mermaid流程图——对,它连Mermaid渲染器都重写了,快1800倍,不依赖浏览器,纯Rust。

它真会自己改自己代码。输入/self-dev,它就钻进源码树翻找、patch、编译、热重载,一气呵成。你喝口咖啡的功夫,它已更新完配置并给你发了commit summary。Swarm模式更邪门:一个仓库里同时跑仨agent,A改完main.rs,B立刻感知变更、检查冲突,C自动生成测试用例——像不像你组里三个程序员围在白板前吵半小时然后分头干活?它还记人,把每次对话转成向量存进本地数据库,用久了真能猜中你下一行想敲impl<T> Clone for Vec<T>还是Arc<Mutex<T>>。

装法就一行命令,Mac/Linux直接curl安装,WSL2也行。支持Claude、OpenAI、Gemini、Ollama……你白天让Claude写支付模块,晚上切Ollama本地跑Qwen2-7B调参,不用换终端、不改配置。要是Claude Code崩了,/resume一个命令,它接着你上一秒的上下文往下写。目前GitHub 3.7k star,每周涨三四百,issue里有人问文档在哪,作者回:“先跑起来,文档在代码里。”

风扇最近安静多了。

[db:评论]