Meta新AI模型能否解决Llama 4性能争议?

Meta新AI模型在技术上针对了Llama 4的短板,有望解决性能争议,但能否彻底挽回开发者的信任,还得看它公开后的实际表现。2026年1月21日,Meta首席技术官宣布内部交付了首批关键AI模型,性能被评价为“超级出色”,这标志着Meta在争议后的一次重大反击。

Llama 4争议根源

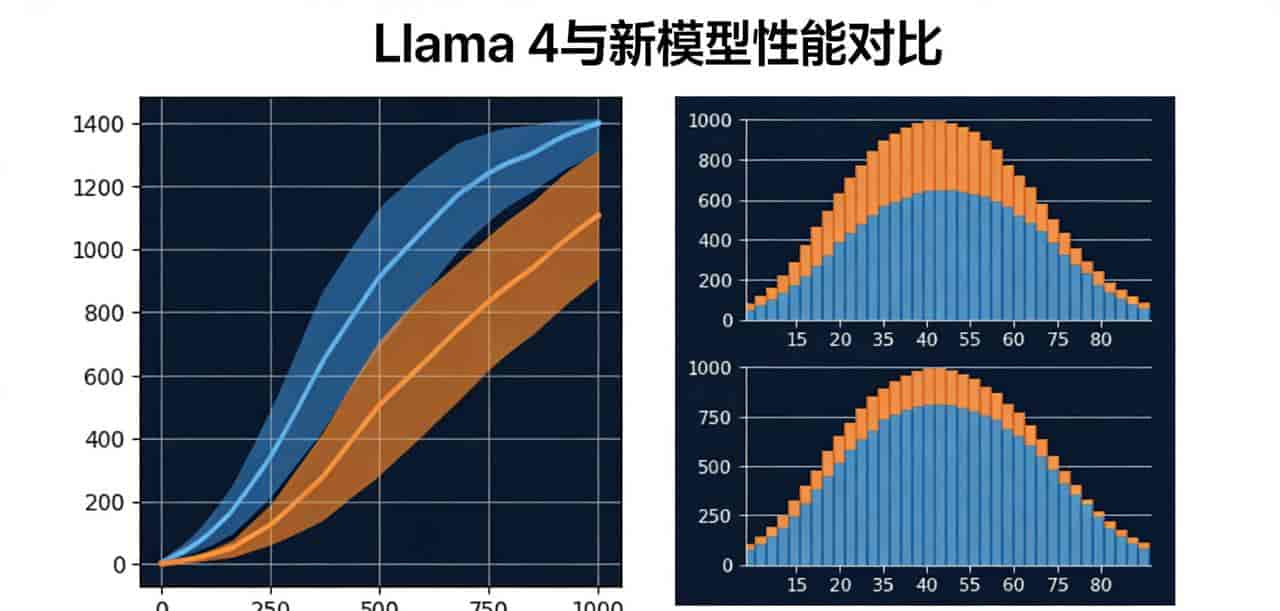

Llama 4在2025年4月发布后迅速“翻车”,核心问题在于宣传与实测的巨大落差。技术社区发现,模型在多个关键能力上表现崩盘。

- 编码能力垫底:在aider polyglot多语言编程基准测试中,Llama 4 Maverick(4020亿参数)得分仅16%,远低于GPT-4o等竞品,甚至被批评为“糟糕的编程模型”。

- 物理模拟失真:用户实测显示,模型生成的小球运动动画会违反物理规律,列如让球直接穿墙,而同期其他模型表现更稳定。

- 长文本处理缺陷:Llama 4 Scout在16K tokens后召回率暴跌至22%,长文本处理能力被指“中看不中用”。

更关键的是,有内部员工实名爆料,称团队在后训练阶段混入了基准测试集的数据,通过“灌题”来提升评测指标,这直接导致了模型在官方测试中虚高、在实际应用中“现原形”。沃顿商学院教授Ethan Mollick指出,这种过度优化基准测试的行为损害了行业公信力。

新模型的技术补位

Meta的新模型并非简单迭代,而是直接瞄准了Llama 4的弱点进行设计。尽管具体参数未全面公开,但从布局来看,它做了针对性升级。

新模型延续了Llama 4的混合专家(MoE)架构,但参数量可能突破2万亿级,激活参数达2880亿,远超Llama 4 Maverick的170亿激活参数。这意味着模型在保持高效推理的同时,能处理更复杂的任务。

内部测试显示,它在复杂任务规划中的准确率较Llama 4提升40%,代码生成效率提高35%。

同时,Meta通过专项技术模型补足短板:

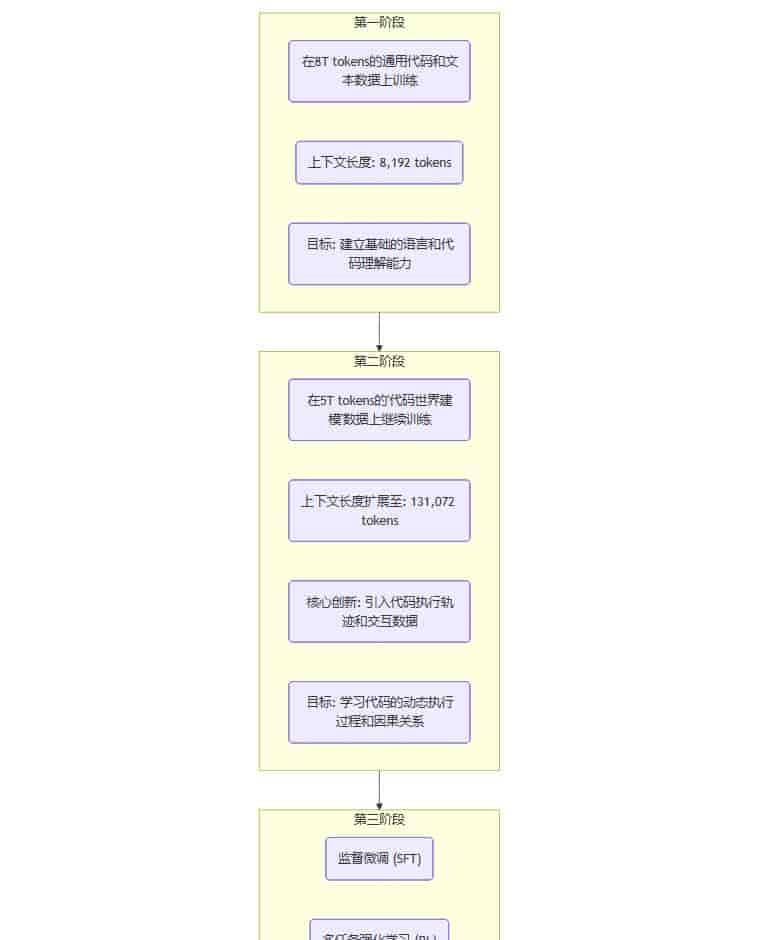

- CWM代码世界模型让AI从“会写代码”进化到“会推理逻辑”,通过模拟代码执行过程来提升编程能力。

- V-JEPA 2世界模型专注于视频理解和物理直觉,能准确分辨视频内容是否违反物理定律,甚至支持机器人在新环境中零样本规划。

- REFRAG方法优化长文本处理,将token使用减少2-4倍,首次生成延迟缩短30.85倍。

这些技术已开始赋能核心业务——例如,Instagram Reels的内容生成效率提升了10倍。用业务结果说话,比单纯的基准测试更有说服力。

信任重建之路

不过,技术升级只是第一步。要真正解决争议,Meta还需跨越两大障碍。

第一是公开性与透明度。新模型目前仅内部交付,参数和训练细节未完全披露。Llama 4事件后,社区对Meta官方评测的信任度已受损,担心重蹈“榜单特供版”的覆辙。只有开放模型供第三方独立实测,才能验证其真实性能。

其次是竞品压力。在Meta陷入争议时,其他模型正快速进步。例如,Claude Opus 4.5在SWE-bench编程基准上得分达80.9%,DeepSeek、Qwen等开源模型也在多项测试中表现亮眼。新模型必须在实际场景中证明自己,而不仅仅是参数堆砌。

AI模型的争议,从来不是靠发布参数就能解决的。Meta的新模型迈出了重大一步,但最终答案,掌握在时间和全球开发者的验证里。

相关文章