如果过去两年,你认定AI铲子的价值几乎等于GPU的价值,英伟达是唯一的、最大的赢家,这个判断在逻辑上完全成立。由于生成式AI的军备竞赛,本质是“大力出奇迹”的算力竞赛,GPU的并行计算能力,直接决定了模型训练的规模和速度。

在这个阶段,CPU、内存、存储都只是配角,硬件投资高度聚焦于GPU。

但数据正在给出完全相反的答案。

进入2026年,随着AI从“生成内容”的聊天机器人,转向“执行任务”的自主智能体(Agentic AI),算力需求的底层逻辑发生了根本性颠覆。AI铲子的价值不仅没有被削弱,反而在更广的维度上被重塑和放大,只是赢家不再只有GPU。

CPU:从辅助到主导的算力重构

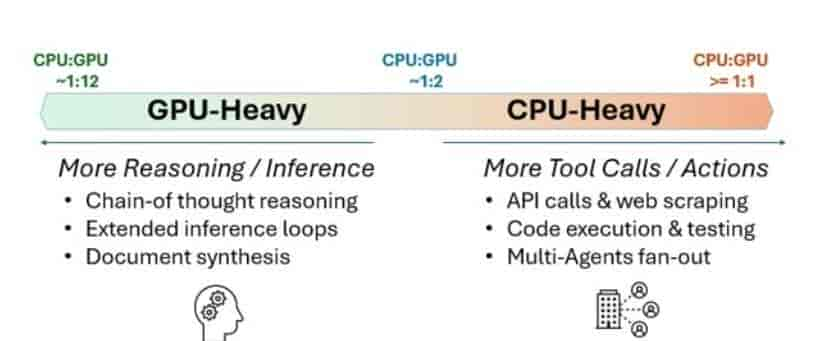

最直观的变化发生在CPU上。在传统AI数据中心,一个CPU往往要服务4到8个甚至12个GPU。但Agentic AI的核心是“执行”,它需要规划任务路径、调用各种API工具、在多步骤间传递数据,这些工作充满了分支判断和串行逻辑。

- 性能瓶颈转移:在完整的Agent执行链路中,工具调用(如网页检索、代码执行)在CPU上的耗时占比高达90.6%,GPU推理仅占不到10%。半导体分析机构SemiAnalysis指出,在Agentic AI工作负载中,CPU侧的处理占据了总延迟的50%到90%。

- 硬件配比反转:因此,数据中心CPU与GPU的配置比例正在从传统的1:4至1:8,向1:1至2:1演进。这意味着,未来为每块高性能GPU搭配一到两颗高性能CPU将成为常态。

市场已经用真金白银投票。英特尔2026年一季度数据中心与AI业务收入同比增长22%,成为增长最快板块,财报发布后股价盘后最高涨幅超40%。这并非英特尔突然技术飞跃,而是市场开始为“CPU在AI推理阶段的系统价值”重新定价。

存储:从周期品到战略资产的范式跃迁

如果说CPU的崛起是角色转变,那么存储的爆发则是量级的跃升。Agentic AI需要长时记忆和庞大的上下文窗口,这直接引爆了对内存的饥渴需求。

- 需求倍数增长:一台AI服务器对DRAM(内存)的需求量是传统服务器的8倍,对NAND Flash(闪存)的需求量是传统服务器的3倍。当模型支持100万token上下文时,其缓存(KV Cache)容量约200GB,远超单块高端GPU的显存,必须依赖CPU的大容量内存。

- 业绩爆发式兑现:需求直接转化为恐怖的财务数据。2026年一季度:

- 佰维存储营收68.14亿元,同比增长341.53%,净利润扭亏为盈至28.99亿元。

- 香农芯创(SK海力士HBM核心分销商)净利润13.27亿元,同比暴涨7835.06%。

- 国际巨头三星、SK海力士一季度营业利润也分别同比大涨755.01%和426%。

存储行业正从看下游手机、PC脸色的“周期品”,转变为AI算力底座不可或缺的“战略资产”,进入由结构性需求驱动的“超级周期”。

国产“铲子”:在全栈协同中寻找突破口

你可能会说,这不过是把蛋糕从英伟达(GPU)分给了英特尔、AMD(CPU)和三星、海力士(存储),依然是海外巨头的游戏。

但这次价值重构的另一个关键特征是 “全栈协同”。当算力瓶颈从单一芯片转向整个系统(CPU、GPU、内存、互连、散热)的效率时,具备细分领域技术优势和系统集成能力的厂商,获得了前所未有的机会。

- PCB(印制电路板):AI服务器架构升级,PCB层数从14-24层提升至20-30层,技术门槛和价值量齐升。龙头生益电子2025年净利润同比增长343.76%,总市值突破千亿。大族数控的AI专用钻孔机全球市占率约50%。

- 国产CPU与系统:海光信息2025年营收增长56.92%。龙芯中科已将OpenClaw智能体框架部署到国产终端。浪潮信息的服务器可稳定运行96路Agent实例,提供系统级算力支撑。

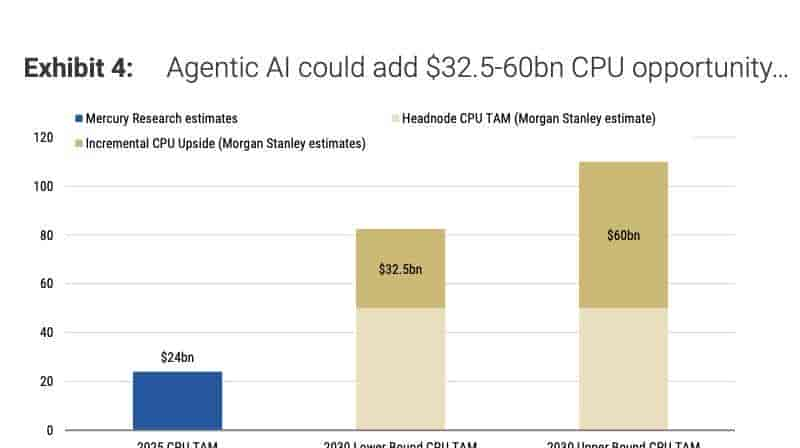

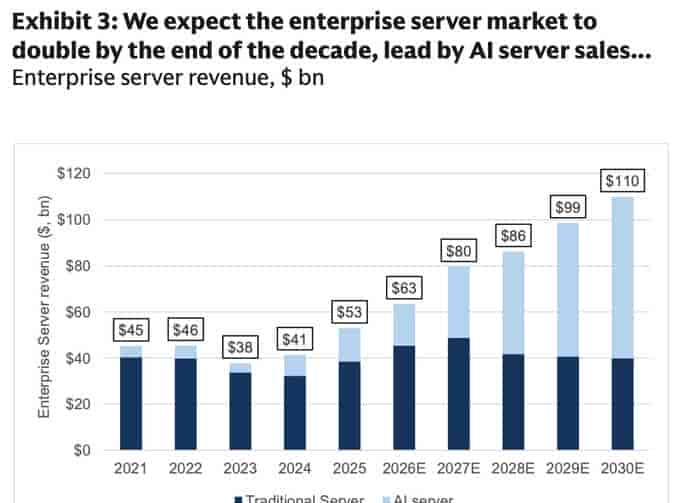

投资逻辑也随之清晰。高盛预测,到2030年企业服务器市场规模将从2025年的530亿美元翻倍至1100亿美元。摩根士丹利则预计,2030年全球数据中心CPU市场规模将达825-1100亿美元,其中325-600亿美元是Agentic AI带来的新增需求。

所以,Agentic AI没有终结“卖铲子”的生意,而是彻底改变了“铲子”的定义和利润分配图。

新的认知应该是:AI铲子的价值正从“GPU单极”转向“CPU、内存、存储、PCB及系统整合的全栈协同”。 这场变革不是零和游戏,而是将整个AI硬件产业链的蛋糕做得更大,并为在不同环节具备核心竞争力的玩家——包括正在崛起的中国供应商——打开了新的价值空间。

GPU依然重大,但它不再是唯一的故事;真正的竞争,目前是整个系统效率的竞争。

相关文章