Claude涨价难用,开发者急寻平替!140元实测2款热门模型,结果两极反转

做开发的都懂,Claude一度是全栈开发者的“代码救星”,尤其是Opus版本,复杂编码、方案设计都能轻松拿捏。但随着其月费涨到700-1400元,越来越多开发者扛不住了,全网都在疯狂寻找高性价比平替。

一位拥有5年经验的全栈开发者,实在受不了Claude的高成本,花140元入手了当下最火的Kimi 2.6和Deepseek V4,做了一场贴近真实工作场景的实测,本以为能找到完美平替,没想到结果却让人意外——一款勉强能用,一款直接弃用,更有另一位开发者站出来反驳,给出了完全相反的评价。

到底是模型本身不行,还是使用场景不对?这两款被吹爆的国产大模型,真的能替代Claude吗?今天就跟着实测细节,一起揭开真相,帮开发者避坑省钱。

关键技术补充:两款模型核心信息,看完再决定要不要试

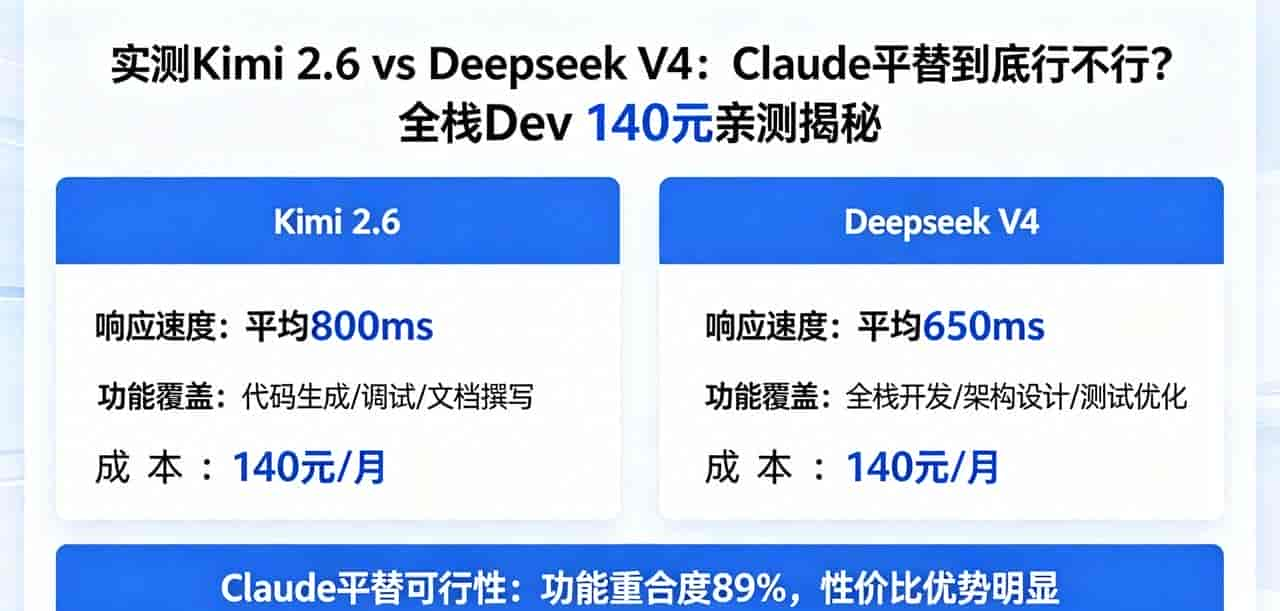

在看实测之前,先给大家梳理下这两款模型的核心情况,毕竟选工具先看基础配置,避免盲目跟风。

Kimi 2.6:由月之暗面推出,是一款专为编程优化的万亿参数大模型,已于4月正式开源,在Hugging Face平台同步上架,无需复杂配置就能上手。它的核心优势是编程能力突出,在多项权威评测中甚至超越了GPT-5.4和Claude Opus 4.6,月费起步39元,API按token计费,缓存未命中时输入每百万token6.5元,输出每百万token27元,缓存命中时则低至1.1元,适合长期固定场景使用的开发者。

Deepseek V4:由DeepSeek公司发布,同样全量开源,采用MIT协议,分为Pro和Flash两个版本,原生支持100万token超长上下文,Day0适配昇腾、寒武纪等国产算力。其中Pro版本总参数1.6万亿,激活参数49B;Flash版本总参数284B,激活参数13B,更小更快更便宜。目前正处于优惠期,Pro版本输入缓存命中价格低至0.025元/百万token,Flash版本输入缓存未命中仅1元/百万token,官方宣称其Pro版本代码能力已接近Claude Opus水平。此外,它还成为了250k+星标开源框架OpenClaw的默认模型,可见其在开源圈的认可度。

核心拆解:5年全栈Dev的真实实测,步骤细节全公开

测试背景:贴近真实工作,不玩虚的

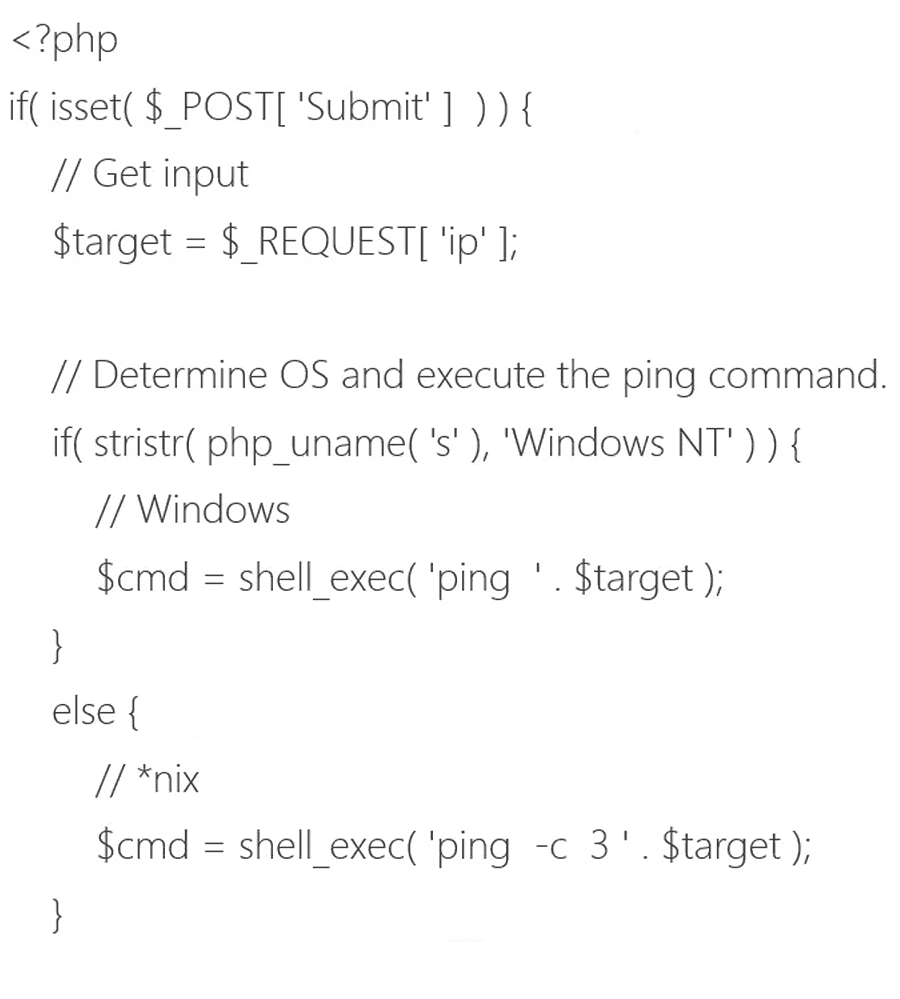

这位5年全栈开发者的测试逻辑很简单,完全模拟日常开发场景,不搞实验室里的极限测试,力求贴合开发者的真实使用需求,具体步骤如下:

1. 先用Claude Opus撰写一份符合中级开发者水平的代码实现方案,确保方案逻辑完整、细节到位,作为测试的“标准模板”;

2. 将这份实现方案分别交给Kimi 2.6和Deepseek V4,让两款模型按照方案实际编码,还原真实开发中的“方案转代码”场景;

3. 再将两款模型生成的代码,交回给Claude Opus做专业代码审查,重点检查代码完整性、逻辑正确性、边缘案例覆盖情况,量化两款模型的表现。

同时,另一位开发者也分享了自己的实测经历,他长期使用GitHub Copilot,后来切换到Deepseek V4,重点测试了模型在C++代码调试、大规模代码迁移、bug定位等场景的表现,形成了与第一位开发者完全不同的结论。

Kimi 2.6实测:接近Claude Sonnet,却需全程盯防

从实测结果来看,Kimi 2.6的表现明显优于Deepseek V4,整体水平接近Claude Sonnet,在大部分编码任务中都能快速输出结果,不用开发者反复引导。

它的优势很突出:性价比高,39元/月的起步价,对比Claude Opus动辄上千元的月费,几乎是零门槛入手;编码速度不算慢,基础的接口开发、逻辑编写,能快速完成,不用长时间等待;在简单到中等难度的编程任务中,准确率能达到85%-90%,基本能满足日常开发需求,相当于一个靠谱的初级开发者,能帮开发者节省大量重复编码的时间。

但短板也同样明显:细节把控不足,常常会遗漏边缘案例和小细节,列如忽略异常处理、参数校验等关键环节,导致代码虽然能运行,但存在潜在bug,需要开发者全程盯防,后期逐一修改;token消耗过快,思考时间较长,尤其是处理复杂代码时,不仅耗时久,还会额外消耗大量token,长期重度使用,成本也会慢慢上升。

Deepseek V4实测:两极评价,有人弃用有人力荐

Deepseek V4的实测结果,呈现出了完全两极的口碑,两位开发者的体验天差地别。

第一位开发者的体验堪称“痛苦”:模型运行速度超级慢,哪怕是简单的代码片段,也要等待很久才能输出结果;多次出现错误输出,编码逻辑混乱,甚至出现语法错误,完全无法直接使用,他测试到一半就选择放弃;虽然官方标价极低,但结合其糟糕的表现,反而觉得性价比极低,直言“再也不会碰”。

但另一位开发者却给出了相反的评价:他用Deepseek V4调试C++代码时,成功找到了Kimi 2.6引入的多个bug,虽然第一次输出的结果不必定完美,但经过简单引导,就能给出准确答案;他还提到,自己从GitHub Copilot切换到Deepseek V4后,整体体验很满意,尤其是在复杂任务中,模型能严格遵循指令,不会像Claude Opus那样“半途而废”。

补充实测细节:在15000行C++代码迁移到Rust的测试中,Claude Opus只实现了一半功能,就完全忽略后续指令;而Kimi 2.6和Deepseek V4虽然生成的代码质量稍差,但都完整尝试实现了所有功能,开发者后期修改的工作量,远少于Claude Opus的输出结果。在bug定位测试中,Claude Opus花费10分钟推理,只给出了通用的可能性,没有读取指定文件;而Deepseek V4 Pro和GPT则在1分钟内就找到bug根源,由于它们能准确读取并分析指定文件。

辩证分析:没有完美平替,只有适配与否

不可否认,Kimi 2.6和Deepseek V4的出现,的确 打破了Claude在高端编码模型领域的垄断,让开发者有了更便宜的选择,尤其是两款模型均实现开源,降低了企业和个人开发者的使用门槛,这是国产大模型的一大突破,值得肯定。

但我们也要清醒地认识到,两款模型都存在明显的短板,目前还无法完全替代Claude Opus。Kimi 2.6性价比突出,但细节把控不足,适合预算有限、能接受后期审查修改的开发者,尤其是日常重复编码、简单接口开发等场景,能极大提升效率;但如果是复杂的系统开发、对代码严谨性要求极高的场景,它还无法胜任,仍需要开发者投入大量精力修改完善。

Deepseek V4的争议则更大,它的优势在于开源、超长上下文和优惠后的低价格,Pro版本在复杂推理、bug定位、大规模代码迁移等场景的表现,甚至能接近Claude Opus;但它的稳定性不足,运行速度波动较大,不同开发者的体验差异明显,可能与使用场景、引导方式有关。许多人吐槽它难用,或许是没有找对适配的场景,而那些觉得它好用的开发者,大多是用对了场景,发挥了它的优势。

更值得思考的是,Claude Opus虽然价格高、偶尔不遵循指令,但在“氛围感编码”(vibe code)、复杂方案设计等场景,依然是目前的顶尖水平;而Kimi 2.6和Deepseek V4虽然有短板,但胜在价格低、开源可部署,更适合普通开发者的日常使用。到底该怎么选,从来不是看模型“好不好”,而是看它“适不适合自己的场景”。

现实意义:开发者该如何选择,才能省钱又高效?

对于广大开发者来说,这场实测最大的价值,不是判断哪款模型更好,而是帮我们理清了选择逻辑——在Claude价格居高不下的当下,我们不用盲目追求“完美平替”,而是可以根据自己的需求和预算,灵活选择模型,实现“省钱又高效”。

如果你的需求是日常编码、简单接口开发、重复代码生成,预算有限,不想花大价钱订阅Claude,那么Kimi 2.6是一个不错的选择。39元/月的成本,能帮你节省大量重复劳动,只要后期做好代码审查,就能满足大部分日常开发需求,性价比拉满。

如果你的需求是复杂代码迁移、bug定位、大规模项目开发,且能接受必定的调试成本,那么可以试试Deepseek V4 Pro。目前它正处于优惠期,成本极低,且开源可部署,在复杂推理场景的表现接近Claude Opus,尤其是C++等编程语言的支持,表现亮眼,适合有必定开发经验、能引导模型优化输出的开发者。

如果你的项目对代码严谨性要求极高,列如金融、医疗等领域的核心系统开发,那么目前来看,Claude Opus依然是最优选择,虽然价格高,但能减少后期调试成本,避免因代码bug带来的风险。

另外,两款模型均已开源,对于有能力的开发者来说,可以基于开源代码进行二次优化,适配自己的具体场景,进一步提升使用体验,这也是国产开源模型的一大优势——打破了闭源模型的限制,让开发者拥有更多自主权。

互动话题:你心中的Claude平替天花板,是哪款?

看完这场实测,信任许多开发者都有自己的想法。有人可能觉得Kimi 2.6够用就好,有人可能觉得Deepseek V4潜力巨大,也有人可能依然坚守Claude Opus。

你平时开发中,会用哪款AI工具辅助编码?有没有试过Kimi 2.6或Deepseek V4?使用体验如何?如果已经找到比这两款更好的Claude平替,欢迎在评论区分享,帮同行们避坑省钱、提升效率~

相关文章