文/郭性汶

随着人工智能大模型能力的持续跃升,Token(词元)已从技术语境中的一个计量单位,演变为驱动智能服务的核心经济媒介。有人提出“Token即数字石油”,Token为何成为AI时代的硬通货:其本质是智能的量化载体、模型厂商的定价锚点、开发者的成本函数以及企业AI支出的基本单元。Token经济催生的三层产业链结构——算力供给层、模型服务层与Token应用层,Token经济的底层逻辑是算力成本的再分配,可以说谁掌握廉价且充足的算力,谁就主导Token的定价权与流通规则。

一、引言

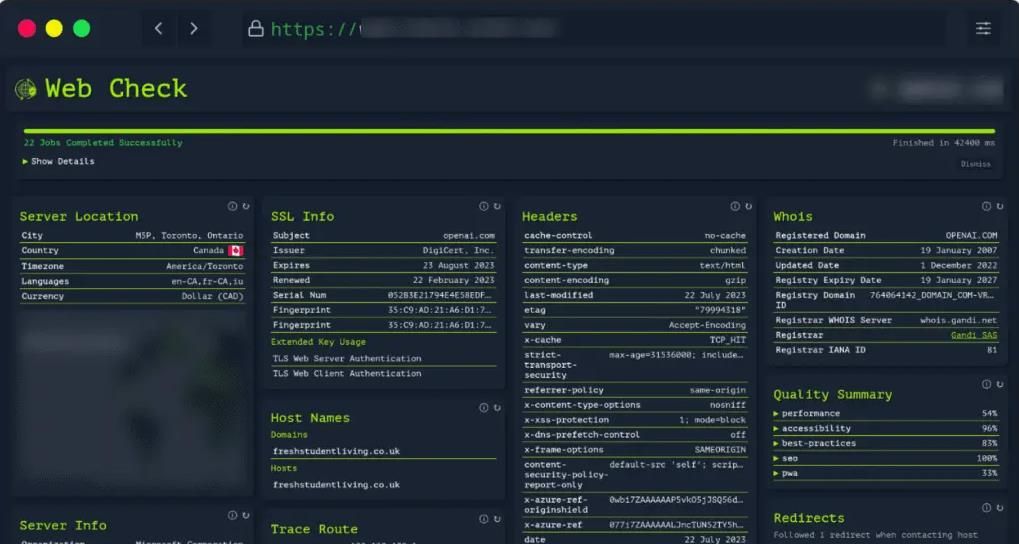

2023年以来,以GPT系列为代表的大语言模型展现了惊人的通用智能。用户每输入一句话,模型每生成一段回答,背后都伴随着数百至数千个Token的消耗。OpenAI、Anthropic等公司普遍采用按Token计费的商业模式,价格从每百万Token数美元到数十美元不等。这一看似简单的计价单位,正在成为人工智能时代最基础的经济细胞。

Token正在取代传统软件时代的CPU时间或API调用次数,成为AI时代最底层的计量单位与价值载体。其重大性源于三个不可逆的趋势:第一,模型能力越强,使用场景越广,社会总Token消耗量呈指数级增长;第二,用户对AI的依赖越深,Token需求越缺乏弹性,成为类似能源的刚性支出;第三,Token的生成与处理高度依赖算力,使其天然具备稀缺性,进而衍生出定价、交易与金融化的可能性。

二、Token为何成为硬通货:四个经济学维度

2.1 作为智能的量化单位

智能难以直接度量,但Token提供了间接但可操作的量化方案。一次翻译、一段代码生成、一份报告摘要,均可拆解为特定数量的输入Token与输出Token。研究表明,在固定模型版本下,输出Token数量与任务复杂度呈现显著正相关。这意味着Token消耗量能够近似反映智能活动的“工作量”,从而为定价提供客观依据。

2.2 作为模型厂商的定价锚点

当前主流大模型API均采用Token计费。以GPT-4 Turbo为例,输入Token约10美元/百万,输出Token约30美元/百万。这必定价模式之所以可行,是由于Token消耗与模型推理成本高度线性相关——模型对每个Token的处理都需要完整的前向计算,算力成本随Token数量近似等比例增加(Patterson et al., 2021)。Token因此成为连接用户使用量与厂商成本的最直接桥梁。

2.3 作为开发者的成本函数

对于构建AI应用的开发者而言,Token不再只是技术概念,而是每月云账单上的核心条目。一个日活十万的AI客服应用,若每轮对话平均消耗500 Token,日均消耗即达5000万Token,月成本可达数万美元。开发者被迫将Token效率作为产品设计的重大维度——压缩提示词、缓存常见回复、选用更小的模型,本质都是为了降低Token支出。

2.4 作为企业控制成本的基本单元

企业内部对AI的规模化应用,使得Token像纸张、电力一样进入成本核算体系。一家市场部门批量生成产品文案、法务部门审阅合同、研发部门辅助代码编写,每个场景的Token消耗均可被追踪与预算化管理。已有企业开始设立“AI支出管理员”岗位,专门监控各部门的Token使用量与产出效益。

综上所述,Token满足了作为硬通货的核心条件:广泛接受性(所有主流模型API均支持)、可量化分割(最小单位为单个Token)、成本传导清晰(与算力支出挂钩)以及需求刚性(智能活动越频繁,消耗越多)。

三、Token经济的底层支点:算力作为油田

Token不能凭空产生。每一个Token的生成,都需要GPU或专用AI芯片执行数十亿乃至数万亿次浮点运算。算力供给的成本结构直接决定了Token的边际成本。

当前,训练一个千亿参数的大模型需要数千张H100 GPU连续运行数月,仅电费就达数百万美元。推理阶段虽然单次成本较低,但规模化后累计成本更为惊人。据估计,ChatGPT每日推理的Token数量超过百亿,对应算力成本达数十万美元/天(Shoeybi et al., 2023)。

由此引出一个关键推论:Token的长期价格取决于算力的边际成本。谁拥有最大规模、最低电费、最高芯片利用率的算力集群,谁就能以更低的单价提供Token服务,从而主导市场。这正是为什么微软、谷歌、亚马逊等云巨头竞相部署自研AI芯片、投资核能数据中心、探索液冷技术——他们本质上是在争夺Token经济的定价权。

如果把算力相当于油田储量与开采能力,Token相当于提炼后的成品油。控制油田者控制油价,控制算力者控制Token价。

四、未来Token派生的三层产业链

Token经济将催生一个比传统软件业更为庞大的产业链。本文将其划分为三个相互关联的层级。

4.1 第一层:算力供给与Token铸造

这是产业链的最上游,负责将电力与芯片转化为Token。参与者包括:

· AI芯片厂商(NVIDIA、AMD、华为昇腾):决定Token生成的物理效率。每美元能购买多少Token,取决于芯片的性价比。

· 云算力提供商(AWS、Azure、Google Cloud、CoreWeave):将芯片部署为可租赁的算力池,以Token为单位对外服务。利润来自Token收入与算力成本之差。

· 分布式算力网络(如Together.ai、RunPod):聚合闲置GPU资源,以更低价格提供Token生成能力。这类模式可能催生Token的“现货市场”,价格随供需实时波动。

未来可能出现Token铸造合约:用户提前锁定未来某段时间内的Token购买价格,类似石油远期合约,以对冲AI支出波动风险。

4.2 第二层:模型服务与Token路由

这一层将原始算力转化为特定能力的Token流。参与者包括:

· 模型开发商(OpenAI、Anthropic、Google、智谱AI):训练专有模型,通过API输出Token。他们的核心资产是模型权重,而非算力本身。

· 模型路由层(如LangChain、Portkey):根据任务复杂度、成本预算、响应速度要求,自动将请求路由到最合适的模型。例如,简单分类任务用廉价小模型,复杂推理用大模型。路由层实质是Token的“套利者”——在不同模型的Token价格与能力之间寻找最优匹配。

· 开源模型托管平台(Hugging Face、Replicate):提供开源模型的Token生成服务,形成与闭源模型的竞争。

这一层的关键商业模式是Token差价:从算力层按成本价获得Token能力,经模型价值加成后以更高价格出售。

4.3 第三层:Token应用与衍生市场

最接近终端用户的一层,Token在此被转化为具体价值:

· AI原生应用(如Cursor、Perplexity、Midjourney):按订阅制或按使用量向用户收费,背后是Token成本。成功的应用需要确保用户付费高于Token成本。

· 企业内部AI中台:大型企业自建或采购模型服务,将Token作为内部成本中心与部门结算的虚拟货币。

· Token代理市场:AI Agent之间自主交易Token。设想一个场景:用户的主Agent委托若干子Agent分别查询航班、酒店、天气,子Agent各自消耗Token完成任务,主Agent统一结算。这将催生Agent间的Token信用体系与小额支付网络。

· Token金融衍生品:基于Token价格波动开发期货、期权或指数基金。算力成本变化(如电价上涨)、模型效率提升(如新架构减少推理计算量)都会影响Token价格,创造套利与对冲空间。

更进一步,可能出现Token与碳信用的挂钩机制:生成Token消耗电力,产生碳足迹。未来监管可能要求每百万Token对应必定数量的碳配额,Token价格中内化环境成本。

五、挑战与展望

Token经济虽然前景广阔,但面临几个根本性挑战:

定价权的聚焦风险:当前高端算力高度聚焦于NVIDIA,模型能力聚焦于少数几家巨头。若这一格局持续,Token定价可能偏离竞争性市场均衡,形成垄断租金。

Token效率的技术跃迁:模型架构的持续优化(如MoE混合专家、稀疏注意力、推测解码)可能大幅降低每Token所需算力。从长期看,Token价格的下降速度可能超过需求增长速度,压缩产业链利润。

计费单位的碎片化:多模态模型、长上下文、推理链等新能力难以简单用Token衡量。未来可能出现更精细的计费维度(如推理步数、图像块数),挑战Token作为通用单位的地位。

尽管如此,我们认为Token作为AI时代经济基础单元的地位将在至少五到十年内保持稳固。它提供了一个简单、透明、可比较的度量体系,使得智能服务可以像水电一样被计量、交易与优化。

六、Token的重大性不言自明

Token已从技术细节跃升为人工智能时代的关键经济变量。它是智能的量化载体、厂商的定价锚点、开发者的成本函数与企业的AI支出单位。Token经济的底层是算力供给,算力的成本结构决定了Token的长期价格。围绕Token,将生长出算力铸造、模型路由、应用与衍生品三层产业链,形成规模远超传统软件业的新经济形态。

理解Token,就是理解AI如何重塑商业的基本逻辑。

参考文献

[1] Kaplan, J., McCandlish, S., Henighan, T., et al. (2020). Scaling Laws for Neural Language Models. arXiv preprint arXiv:2001.08361.

[2] Patterson, D., Gonzalez, J., Le, Q., et al. (2021). Carbon Emissions and Large Neural Network Training. Communications of the ACM, 65(4), 64-73.

[3] Shoeybi, M., Patwary, M., Puri, R., et al. (2023). Megatron-LM: Training Multi-Billion Parameter Language Models Using Model Parallelism. arXiv preprint arXiv:1909.08053 (updated 2023).

[4] OpenAI. (2023). GPT-4 Technical Report. OpenAI Research.

[5] NVIDIA. (2024). H100 Tensor Core GPU Architecture White Paper. NVIDIA Corporation.

[6] Thompson, N. (2022). The Compute Cost of AI: Trends and Implications. Center for Security and Emerging Technology (CSET).

相关文章