随着大模型技术的爆发,AI生成内容(AIGC)已从黑科技变为普惠工具。

无论是文字创作、图像生成还是代码辅助,掌握AIGC的核心流程和优化技巧,能极大提升效率。本文将拆解AIGC内容生成的全链路实操要点。

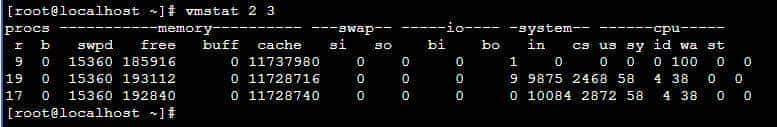

一、 环境准备:本地部署 vs 云平台

AIGC的入门门槛已大幅降低。对于本地部署的绘画及专业类型软件,需关注显卡性能(提议N卡RTX 3090/4090或同等算力),并安装Python环境、Git工具以及PyTorch框架。

例如:Stable Diffusion WebUI或ChatGLM等开源项目提供了友善的图形界面。

若硬件受限,云平台是更优解。Google Colab、阿里云PAI-DSW或女娲云教室等平台提供即开即用的GPU资源,其中女娲云教室本人亲测,还能有干货知识给出惊喜。

这类云平台解决了无需配置新电脑,直接加载模型即可运行软,适合新手快速上手,有效训练,快速应用于未来各行各业。

二、 分步指南:提示词工程的核心逻辑

AIGC的本质是“输入决定输出”,你是不是还在把你的智能体当做百度功能?

实则,优质的提示词(Prompt)是成功的一半,在应用纯文本类的提示词时,标准的提示词结构就一句话:

**‘请扮演【角色】,

为我【干什么任务】,

要求是【具体需求】,

核心是:**带来什么优化**

而你对自己的认知要换位成一个发布指令的CEO,它就是你招聘到的一个没有感情但知识渊博的“打工仔”,还是24小时在线,不要你工钱的那种。学会了吗?

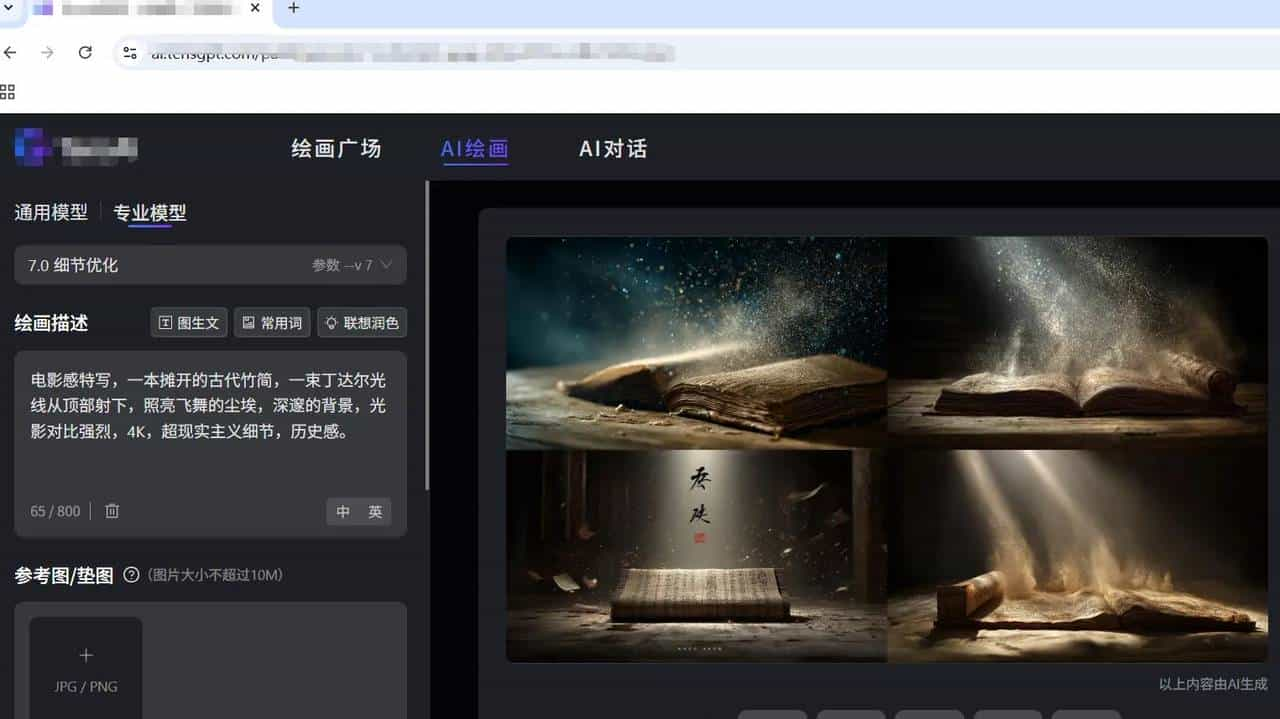

而绘画时你需要在大模型里设定的参数是:指定AI扮演的身份(如“插画师”、“写实风格”,“国风”……)。

背景描述:提供上下文信息(如“在一个赛博朋克风格的未来都市……”)。

核心需求:明确生成目标(如“生成一只会发光的机械猫……它的穿着打扮……”)。

输出格式:规定结果的呈现形式(如“8K分辨率,高清细节,无水印”)。

三、 配置详解:模型参数的调优

在专业的SD软件生成过程中,关键参数直接影响结果质量:

采样方法(Sampler):如DPM++ SDE Karras,一般能在较短步数内生成高质量图像。

步数(Steps):一般设置在20-50步。步数过少细节不足,过多则可能过拟合且耗时。

四、 验证测试:迭代与反馈

生成初稿后,需从三个维度验证:

相关性:是否紧扣提示词核心?

连贯性:逻辑是否通顺,画面是否存在违和感?

实际准确性:对于知识型内容,需交叉验证数据真实性。

若不满意,使用“反向提示词”(Negative Prompt)排除不想要的元素(如“模糊、变形、低画质”),并微调参数重新生成。

再不满意,反复“抽卡”(指反复生成),云平台软件反正是免费的。

五、 优化技巧:LoRA与ControlNet

进阶玩家可通过以下工具显著提升效果:

LoRA小模型(Low-Rank Adaptation):轻量级微调技术。只需少量样本(如10-20张照片),即可让模型学习特定风格或角色,且不会占用大量显存。

ControlNet:图像生成的“脚手架”。它允许用户通过线稿、深度图或姿势图准确控制AI生成图像的结构,解决了传统扩散模型难以控制构图的痛点。

结语

AIGC不是魔法,而是新一代技术革命的强劲工具。

小编我真正希望宝子们能和我一起,共同享受纯粹求知的乐趣,还能在前路赋能。前期还有任何不懂得的宝子们,欢迎来个小芯芯+欢住,别把我搞丢了,接下来我会逐步带领你们从熟悉工具、到打磨提示词,后台私我,能进一步指导你们如何调优参数、运用插件,让每步精进都带来质的飞跃。

让学友们一起保持共同进步,关注新模型和技术,信任自己,你将在这场AI革命中抢占先机。

相关文章