项目概况与优化框架

TiDB 作为一款开源的分布式关系型数据库,采用计算 – 存储分离架构,其核心组件包括 TiDB Server(无状态 SQL 层)、TiKV Server(分布式存储引擎)、PD Server(调度中心)和 TiFlash(列式存储扩展)。面对您未提供具体集群信息的情况,本方案将构建一个全方位、多层次的 TiDB 优化框架,涵盖架构诊断、性能调优、存储优化、事务优化等核心维度,为不同规模和应用场景的 TiDB 集群提供系统性优化指导。

根据 TiDB 最新版本 8.5.3(2025 年 8 月 14 日发布)的特性,本方案将结合最新的技术特性和最佳实践,确保优化策略的前瞻性和有效性。优化框架将按照诊断分析→性能调优→架构优化→运维优化的逻辑展开,为您的 TiDB 集群提供从基础健康检查到高级性能优化的完整解决方案。

一、TiDB 集群诊断与健康检查

1.1 核心组件架构诊断

TiDB 集群的健康状态首先需要从核心组件的运行状况入手。TiDB Server 作为无状态的 SQL 层,负责接收 SQL 请求、进行解析优化并生成分布式执行计划。诊断时需要重点关注:

连接池状态:通过 TiDB Dashboard 查看总连接数(total)和活跃连接数(active connections),确保连接池配置合理,避免连接泄漏或不足

CPU 利用率:监控所有 TiDB 实例的平均 CPU 利用率(avg)和最大最小差值(delta),识别 CPU 瓶颈节点

内存使用情况:包括进程占用内存和 Go 语言堆内存的统计,确保内存配置充足且使用合理

PD Server 作为集群的 “大脑”,负责元数据管理、Region 调度和全局事务 ID 分配。PD 集群的诊断要点包括:

节点健康状态:确保 PD 节点数量为奇数(推荐至少 3 个),满足多数派原则,提供高可用性保障

调度负载:监控 PD 的调度操作频率,包括 Leader 移动、Region 分裂合并等,避免过度调度影响性能

元数据一致性:检查 PD 集群内部的元数据同步状态,确保各节点数据一致

TiKV Server 作为分布式存储引擎,采用 Raft 协议实现数据的强一致性和高可用性。TiKV 的诊断重点包括:

Region 分布状态:检查 Region 的数量、大小分布和负载均衡情况,默认每个 Region 为 96MB

存储利用率:监控各 TiKV 节点的磁盘使用率、IOPS 和吞吐量,确保存储资源充足

Raft 日志健康度:检查 Raft 日志的同步状态、复制延迟和日志大小,确保数据一致性

1.2 性能监控指标体系构建

建立完善的监控指标体系是 TiDB 优化的基础。TiDB 采用Prometheus+Grafana 监控框架,其中 Prometheus 负责存储监控和性能指标,Grafana 用于可视化展示。核心监控指标包括:

TiDB 层关键指标:

tidb_server_qps:TiDB 查询吞吐量,正常范围取决于业务负载,建议设置超过历史峰值 80% 的告警阈值

查询延迟:包括 99% 延迟(p99)和 99.9% 延迟(p999),用于识别长尾查询

慢查询数量:默认记录执行时间超过 300ms 的查询,可通过 tidb_slow_log_threshold 配置调整

KV 请求量:kv request total 指标反映所有 TiDB 实例每秒总的 KV 请求数量

TiKV 层关键指标:

CPU 和 IO 使用率:监控所有 TiKV 实例的平均 CPU 利用率(cpu-avg)和 IO 吞吐量(io mbps)

存储性能指标:包括磁盘 IO 延迟、吞吐量和 IOPS,确保存储设备性能满足业务需求

Raft 性能指标:包括日志复制延迟、心跳响应时间和快照同步状态

系统层基础指标:

资源使用率:包括节点 CPU、内存、磁盘使用率等基础资源指标

网络指标:监控集群内部网络延迟、带宽使用率和丢包率

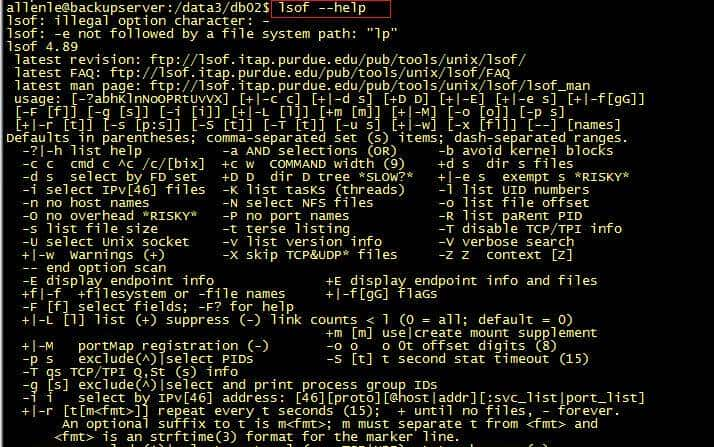

操作系统指标:包括文件句柄使用数、进程状态和系统负载

1.3 慢查询分析与优化诊断

慢查询分析是性能优化的核心手段。TiDB 提供了完善的慢查询分析机制,默认记录执行时间超过 300 毫秒的查询。慢查询分析的具体方法包括:

慢查询日志分析:

日志内容解析:慢查询日志包含完整的执行计划信息,其中 cop_wait 字段可帮助判断 TiKV 响应是否缓慢

执行阶段分解:通过 Time 选项卡查看 SQL 执行各阶段耗时,包括 TiDB 处理时间、Coprocessor 时间和网络传输时间

执行计划分析:使用 EXPLAIN 和 EXPLAIN ANALYZE 语句分析执行计划的效率,对比估算值(estrows)与实际值(actrows)的差异

TiDB Dashboard 慢查询功能:

TiDB Dashboard 提供了强大的慢查询分析功能,可按时间范围、数据库、SQL 类型、关键字等条件过滤慢查询。关键分析功能包括:

查询详情查看:点击任意慢查询可查看详细执行信息,包括 SQL 文本、执行计划和其他执行统计信息

执行计划可视化:支持表格、文本和图形三种格式展示执行计划,其中图形格式更适合复杂查询的分析

性能瓶颈定位:通过分析执行计划中的各个算子,识别性能瓶颈所在的具体环节

1.4 集群健康状态全面检查

TiDB 提供了多种集群健康检查工具,用于全面评估集群的运行状态和潜在风险。

官方诊断工具集:

TiUP 一键检查:执行 tiup cluster check {cluster-name} –cluster 命令,可自动检查 SELinux、swap、网络、THP、CPU 使用模式等配置项

自动修复功能:使用 tiup cluster check {cluster-name} –cluster –apply 命令可自动修复部分检查发现的问题

Clinic 诊断服务:TiDB Clinic 是官方提供的诊断服务,支持远程定位集群问题和本地快速检查集群状态,可通过 diag 客户端与 Clinic Server 云诊断平台配合使用

TiDB Dashboard 诊断功能:

TiDB Dashboard 提供了集群诊断页面,可诊断指定时间范围内集群可能存在的问题,并生成包含诊断结果和负载监控信息的诊断报告。诊断报告支持对比分析功能,可比较异常时间段与正常时间段的系统状态差异。

深度巡检流程:

建议建立定期的深度巡检机制,包括:

基础配置检查:检查操作系统版本、内核参数配置、文件描述符限制等基础配置

服务状态检查:检查各组件进程状态、端口监听情况和服务日志

性能指标分析:分析历史性能数据,识别性能趋势和潜在瓶颈

安全配置检查:检查认证授权、网络安全策略和数据加密配置

二、查询性能优化策略

2.1 执行计划分析与优化

TiDB 的查询优化器负责生成高效的执行计划,其优化过程可以看作是在巨大的搜索空间内寻找最优执行计划的过程。理解和优化执行计划是提升查询性能的关键。

执行计划基础分析:

TiDB 的执行计划包含以下核心要素:

Operator ID:执行计划中算子的唯一标识符,采用树状结构表示

Estimated Rows (estrows):算子预期输出的行数,基于统计信息和算子逻辑估算

Task 类型:分为 root 任务(在 TiDB-server 执行)和 cop 任务(在 TiKV 或 TiFlash 并行执行)

Access Object:算子访问的数据对象信息,包括表、索引和分区

Operator Info:算子的其他详细信息

EXPLAIN 与 EXPLAIN ANALYZE 的使用:

EXPLAIN 语句:返回 SQL 的执行计划,但不实际执行查询

EXPLAIN ANALYZE 语句:实际执行 SQL 并返回执行计划和运行时信息,包括 actrows(实际行数)、execution info(执行信息)、memory(内存使用)、disk(磁盘使用)等

通过对比 estrows 和 actrows 的差异,可以判断统计信息的准确性。当两者差异较大时,需要执行 ANALYZE TABLE 更新统计信息。

执行计划优化技巧:

算子下推优化:尽可能将过滤、聚合、排序等操作下推到 TiKV 执行,减少数据传输

分区裁剪:确保查询能够利用分区表的分区裁剪功能,减少扫描的数据量

索引使用优化:通过执行计划确认索引是否被正确使用,避免全表扫描

2.2 索引优化策略

索引优化是提升查询性能的最直接手段。TiDB 支持多种索引类型,包括普通索引、唯一索引、主键索引和表达式索引。

索引创建最佳实践:

列选择原则:仅在查询中使用的列上创建索引,避免过度索引

高选择性列:在区分度高的列上创建索引,如身份证号等,避免在性别等低区分度列上创建索引

联合索引策略:多条件查询时使用联合索引,注意等值条件列应放在联合索引前面

覆盖索引优化:设计索引时尽量包含查询所需的所有列,避免回表查询

联合索引使用规则:

联合索引必须遵循最左匹配原则。例如,创建联合索引 idx_title_published_at ON books (title, published_at) 后,以下查询可以使用该索引:

SELECT * FROM books WHERE title = 'database';

但以下查询无法使用该索引,因为缺少最左列的条件:

SELECT * FROM books WHERE published_at = '2018-08-18 21:42:08';

索引使用限制与优化:

避免索引列计算:在查询条件中对索引列使用函数、计算或类型转换会导致索引失效

-- 无法使用published_at索引

SELECT * FROM books WHERE YEAR(published_at) = 2022;

-- 优化写法

SELECT * FROM books WHERE published_at >= '2022-01-01' AND published_at < '2023-01-01';

-- 使用表达式索引

CREATE INDEX published_year_idx ON books((YEAR(published_at)));

范围查询限制:使用!= 或 NOT IN 的查询无法使用索引

LIKE 查询限制:以通配符 % 开头的 LIKE 查询无法使用索引

索引维护与优化:

冗余索引清理:定期检查并删除未使用的冗余索引,减少写操作开销

前缀索引使用:对于长文本字段,可使用前缀索引优化存储空间和查询性能

索引统计更新:定期执行 ANALYZE TABLE 更新索引统计信息,确保优化器能够做出准确的执行计划选择

2.3 优化器 Hint 使用

当优化器选择了非预期或不优的执行计划时,可以使用优化器 Hint进行调整。TiDB 支持 MySQL 风格的索引 Hint(USE INDEX、FORCE INDEX、IGNORE INDEX)以及 TiDB 特有的 Optimizer Hints 语法。

TiDB Hint 语法:

TiDB 的 Optimizer Hints 基于 MySQL 5.7 的注释语法,格式为 /*+ hint_name (…) */,不区分大小写,可在 SELECT、UPDATE 或 DELETE 语句的关键字后指定。

主要 Hint 类型:

索引选择 Hint:

-- 强制使用指定索引

SELECT /*+ USE_INDEX(t1, idx1) */ * FROM t1 WHERE id = 1;

-- 强制不使用指定索引

SELECT /*+ IGNORE_INDEX(t1, idx2) */ * FROM t1 WHERE id = 1;

连接算法 Hint:

-- 使用Hash Join算法

SELECT /*+ HASH_JOIN(t1, t2) */ * FROM t1 JOIN t2 ON t1.id = t2.id;

-- 使用Index Join算法

SELECT /*+ INL_JOIN(t1, t2) */ * FROM t1 JOIN t2 ON t1.id = t2.id;

聚合优化 Hint:

-- 使用Hash聚合

SELECT /*+ HASH_AGG() */ COUNT(*) FROM t1;

-- 使用Stream聚合

SELECT /*+ STREAM_AGG() */ COUNT(*) FROM t1;

Hint 使用注意事项:

Hint 作用范围:可通过指定查询块名称(如 @sel_1)控制 Hint 的作用范围

多 Hint 组合:多个 Hint 之间用逗号分隔,可组合使用多个优化建议

Hint 验证:通过 EXPLAIN 和 EXPLAIN ANALYZE 验证 Hint 是否生效,避免错误 Hint 导致性能下降

2.4 特定场景查询优化

针对不同的业务场景,需要采用相应的查询优化策略。

OLTP 场景优化策略:

OLTP 场景的特点是高并发、短查询、频繁更新,优化重点包括:

事务优化:

减少事务大小和持续时间,避免长事务

使用乐观事务模型,减少锁竞争

合理设置事务隔离级别,默认使用 SI(Snapshot Isolation)级别

连接优化:

使用连接池管理数据库连接,避免频繁创建和销毁连接

合理设置连接池大小,根据业务并发量调整

使用长连接,减少连接建立的开销

批量操作优化:

使用批量 INSERT、UPDATE 语句,减少 SQL 执行次数

合理设置批量大小,避免内存溢出

使用 TiDB 的批量 API,提升批量操作性能

OLAP 场景优化策略:

OLAP 场景的特点是大结果集、复杂查询、读多写少,优化重点包括:

并行查询优化:

合理设置并行度,根据查询复杂度和系统资源调整

使用 TiFlash 进行列式存储查询,提升分析查询性能

优化 JOIN 操作,使用合适的连接算法和索引

分区表优化:

使用 Range 或 List 分区,根据查询条件设计分区键

确保查询能够利用分区裁剪,减少扫描的数据量

定期进行分区维护,包括分区合并、拆分和删除

物化视图使用:

对于频繁执行的复杂查询,可考虑使用物化视图

合理设置物化视图的刷新策略,平衡查询性能和更新开销

混合负载场景优化策略:

混合负载场景需要同时满足 OLTP 和 OLAP 的性能要求,优化策略包括:

资源隔离:

使用 TiDB 7.1 + 版本的 Resource Control 功能进行资源隔离

为不同类型的负载分配独立的计算资源

设置合理的资源配额,避免相互影响

查询优先级:

为 OLTP 查询设置较高的优先级

为 OLAP 查询设置资源限制,避免影响在线业务

使用连接管理功能,限制并发查询数量

数据分层存储:

使用 TiFlash 存储历史数据,TiKV 存储实时数据

根据数据访问频率进行冷热数据分离

使用 Placement Rules 实现数据的精细化分布

三、集群架构优化策略

3.1 不同规模集群的部署架构

TiDB 集群的部署架构需要根据业务规模和性能需求进行合理设计。标准的最小推荐配置包括 3 个 TiKV 节点、3 个 PD 节点和 2 个 TiDB 节点。

小规模集群(10 节点以内)优化策略:

小规模集群的特点是资源有限、成本敏感,优化重点在于资源的高效利用:

部署架构设计:

TiKV 节点:3 个节点,满足 3 副本要求,2T 数据建议至少 3 节点分摊存储压力

PD 节点:3 个节点,确保高可用性和多数派原则

TiDB 节点:2 个节点,通过负载均衡对外提供服务

存储配置:建议使用 NVMe SSD,单盘容量不超过 4TB

性能特征:

10 节点以内,TiDB 写容量(INSERT TPS)与节点数量呈约 40% 的线性增长关系

相比 MySQL 的单节点写入,TiDB 具有更好的扩展性

但受限于节点数量,整体性能提升有限

优化建议:

启用 TiKV 的内存引擎(IME)功能,提升 MVCC 查询性能

合理配置 Region 大小,默认 96MB 适用于小规模集群

优化 RocksDB 参数,根据硬件配置调整内存使用

中等规模集群(10-100 节点)优化策略:

中等规模集群需要平衡性能、可用性和成本,优化重点在于架构的可扩展性:

部署架构设计:

可根据业务需求扩展 TiKV 或 TiDB 节点

TiKV 节点:根据存储容量需求扩展,建议每节点 4-8TB 存储

TiDB 节点:根据并发查询需求扩展,支持弹性扩缩容

PD 节点:保持 3-5 个节点,确保高可用性

性能特征:

支持水平扩展至 PB 级数据量

PD 动态调度 Region 实现负载均衡,默认 96MB/Region

支持在线扩缩容,业务无感知

优化建议:

考虑将 Region 大小调整为 128-256MB,减少 Region 数量和调度开销

使用 TiDB Operator 实现自动化运维,包括扩缩容、滚动升级等

启用 Titan 插件优化大值存储,减少写放大

大规模集群(100 节点以上)优化策略:

大规模集群面临的主要挑战是管理复杂度和性能优化,需要采用更精细化的管理策略:

部署架构设计:

支持扩展至数百个节点,如某案例中 TiKV 30 节点、TiDB 10 节点

采用分层架构设计,包括计算层、存储层和管理层

支持多数据中心部署,实现容灾和就近访问

性能特征:

能够支撑十万级 QPS 的业务负载

需要更复杂的调度和管理机制

对网络延迟和带宽要求更高

优化建议:

将 Region 大小调整为 256MB 或更高,适用于≥20 节点、≥数 TB 数据的场景

启用 Bucket 机制提升大 Region 的并发查询性能

实施更精细的资源隔离策略,使用 Placement Rules 实现数据分布控制

3.2 扩缩容机制与负载均衡

TiDB 提供了完善的在线扩缩容机制,支持在不中断服务的情况下调整集群规模。

扩缩容操作流程:

扩容流程:

编写扩缩容配置文件(scale-out.yml)

执行预检查:tiup cluster check {cluster-name} scale-out.yml –cluster

执行扩容:tiup cluster scale-out {cluster-name} scale-out.yml

监控扩容过程,确保数据均衡完成

缩容流程:

编写缩容配置文件,指定要保留的节点数量

执行预检查,确保缩容后集群仍满足高可用要求

执行缩容操作,数据会自动迁移到保留的节点

监控数据迁移过程,确保数据完整性

自动负载均衡机制:

TiDB 的 PD 组件提供了强大的自动负载均衡能力:

实时监控:PD 实时监控集群中的热点数据

动态迁移:支持 Region 的自动合并与分裂

负载均衡效果:某电商平台通过自动规避热点,查询延迟降低 60%

扩缩容性能优化:

扩容时机选择:建议在业务低峰期进行扩容,避免影响正常业务

扩容策略:优先扩容 TiDB 节点提升读性能,根据存储需求扩容 TiKV 节点

缩容注意事项:缩容前需确保数据已完全迁移,避免数据丢失

性能监控:扩缩容过程中密切监控系统性能指标,及时调整策略

3.3 多租户与资源隔离

TiDB 从 7.1 版本开始引入了基于流控的资源隔离方案(Resource Control),大大简化了分布式架构中的资源管理复杂度。

资源隔离层次:

TiDB 提供了多层次的资源隔离机制:

物理隔离:通过独立的 TiDB 和 TiKV 节点实现

逻辑隔离:通过数据库、表级别的资源控制实现

细粒度隔离:通过 CPU、IO、SQL 级别和后台任务级别的资源控制实现

多租户架构设计:

独立集群方案:为核心业务部署独立的 TiDB 集群,确保资源独占

共享集群方案:使用 Placement Rules 实现存储层隔离,使用 Resource Control 实现计算层隔离

连接管理:使用 TiProxy 实现连接的负载均衡和故障转移

Resource Control 功能详解:

Resource Control 的核心特性包括:

统一资源抽象:将 CPU、I/O、网络资源统一抽象为 RU(Request Unit)

三层隔离架构:

数据库用户级别:为不同租户分配独立的资源配额

SQL 语句级别:根据 SQL 类型或模式进行资源限制

后台任务级别:为 DDL、备份等后台任务分配独立资源

动态调整:支持在数秒内完成配置变更,无需数据迁移

多租户最佳实践:

核心业务隔离:

-- 创建Placement Policy

CREATE PLACEMENT POLICY policy_order CONSTRAINTS = "(+zone=order)";

CREATE PLACEMENT POLICY policy_inventory CONSTRAINTS = "(+zone=inventory)";

-- 为不同数据库应用Placement Policy

ALTER DATABASE retail_order PLACEMENT POLICY policy_order;

ALTER DATABASE retail_inventory PLACEMENT POLICY policy_inventory;

资源配额设置:

-- 创建资源组

CREATE RESOURCE GROUP group_oltp RU_PER_SEC = 10000, BURSTABLE RU = 20000;

CREATE RESOURCE GROUP group_olap RU_PER_SEC = 5000, BURSTABLE RU = 10000;

-- 为用户分配资源组

GRANT USAGE ON DATABASE * TO 'user_oltp'@'%' RESOURCE GROUP group_oltp;

GRANT USAGE ON DATABASE * TO 'user_olap'@'%' RESOURCE GROUP group_olap;

连接池配置:

使用 TiProxy 作为连接代理,支持自动发现新增或删除的计算节点

配置合理的连接池大小,避免连接泄漏

设置连接超时和重试策略,提高系统稳定性

四、存储引擎性能优化

4.1 TiKV 存储引擎优化

TiKV 作为 TiDB 的核心存储引擎,其性能直接影响整个集群的读写性能。TiKV 采用RocksDB 作为底层存储引擎,并在此基础上进行了大量优化。

TiKV 架构优化:

Raft Engine 优化:

新一代 Raft Engine 采用 LSM-tree 优化结构,相比原生 RocksDB 减少 50% 写放大

分离日志索引与数据块,实现快速日志检索

支持异步快照生成,使用 zstd 压缩算法将快照体积降低至原始数据的 30%

MVCC 内存引擎(IME):

IME 主要用于加速需要扫描大量 MVCC 历史版本的查询:

适用场景:频繁更新或删除的表、需要查询历史版本的业务场景

工作原理:缓存最新的 MVCC 版本,在内存中快速执行 GC,减少查询时扫描的版本数量

配置建议:

[in-memory-engine]

enable = true # 启用内存引擎

capacity = "16GiB" # 配置16GB内存,建议至少8GB,32GB或更多为最佳

gc-run-interval = "3m" # GC运行间隔,默认3分钟

mvcc-amplification-threshold = 10 # MVCC放大阈值,默认10

存储介质优化:

推荐配置:生产环境建议使用 NVMe SSD + EXT4 文件系统

单盘容量限制:单 TiKV 实例的单盘容量建议不超过 4TB

挂载建议:优先横向扩容而非单节点增加多块硬盘,避免单节点负载过高

4.2 RocksDB 参数调优

RocksDB 的参数配置对 TiKV 性能有决定性影响,需要根据硬件配置和业务场景进行优化。

核心参数配置建议:

内存配置:

[rocksdb]

max_open_files = 4096 # 最大打开文件数

[rocksdb.defaultcf]

block_size = 65536 # 块大小,64KB

block_cache_size = "16GB" # 块缓存大小,建议为系统内存的20-40%

压缩配置:

OLTP 场景:使用 ZSTD 3-6 级压缩,平衡性能与空间

OLAP 场景:可提升至 ZSTD 9-12 级,获得更好的压缩率

分层压缩策略:

[rocksdb.defaultcf]

compression = "zstd"

compression_level = 6

bottommost_compression = "zstd"

bottommost_compression_level = 12

写入优化配置:

[rocksdb]

write-buffer-size = "128MB" # 写缓冲区大小

max-bytes-for-level-base = "512MB" # L0层基础大小

target-file-size-base = "32MB" # SST文件目标大小

线程配置:

[performance]

max-procs = 8 # CPU核心数,建议设置为实际核心数

[rocksdb]

max-sub-compactions = 2 # 最大并发压缩数,建议2-3

Titan 插件优化:

Titan 是 TiKV 提供的键值分离存储插件,适用于大值存储场景:

适用条件:平均行大小大于 512 字节

配置示例:

[rocksdb.titan]

enabled = true # 启用Titan

[rocksdb.defaultcf.titan]

min-blob-size = "1KB" # 最小BLOB大小

blob-file-compression = "zstd" # BLOB文件压缩算法

性能提升:当行大小为 1KB 时,Titan 获得的 QPS 是 RocksDB 的 2 倍;当行大小为 32KB 时,QPS 是 RocksDB 的 6 倍

4.3 Region 管理与性能调优

Region 是 TiKV 存储数据的基本单位,合理的 Region 配置对性能有重要影响。

Region 大小配置:

默认配置:96MB(自 TiDB v8.5.0 起默认提升至 256MB)

调整范围:48MB 到 258MB 之间

大集群优化:≥20 节点、≥数 TB 数据的场景建议使用 256MB

调整方法:

[coproc]

region-split-size = "256MB" # 设置Region分裂大小

Bucket 机制优化:

当 Region 较大时,可以启用 Bucket 机制提升并发查询性能:

适用场景:大 Region 的范围查询、需要高并发读取的场景

配置方法:

[coproc]

enable-region-bucket = true # 启用Bucket机制

region-bucket-size = "96MB" # Bucket大小,默认96MB

注意事项:这是 TiDB v6.1.0 引入的实验性功能,生产环境使用需谨慎

Region 调度优化:

自动调度机制:

PD 自动监控 Region 负载,进行自动分裂和合并

支持基于负载、大小和数量的多种调度策略

可通过 PD 配置调整调度速度和并发度

手动调度控制:

使用 pd-ctl 工具进行 Region 的手动调度

可调整 Region 的副本分布,实现跨机架、跨机房部署

支持设置调度优先级,确保关键业务的数据优先调度

4.4 存储介质选择与配置

存储介质的选择对 TiDB 性能有决定性影响,需要根据成本、性能和可靠性要求综合考虑。

存储介质对比:

NVMe SSD:

性能优势:PCIe 传输速率 8G/s,支持多通道线性扩展

适用场景:生产环境推荐配置

配置建议:选择性能 20 万 IOPS 以上的型号,使用 EXT4 文件系统

SATA/SAS SSD:

性能特点:SATA 最高 6G/s,支持热插拔;SAS 支持 RAID 阵列

适用场景:成本敏感的场景

配置建议:可用于非核心业务或读密集型场景

存储配置最佳实践:

文件系统选择:生产环境推荐 EXT4 文件系统

I/O 调度器:建议设置为 noop 调度器,减少调度开销

多盘配置:单节点不建议挂载过多磁盘,避免单节点故障影响过大

TiFlash 存储优化:

TiFlash 作为 TiDB 的列式存储扩展,其存储配置也需要特别优化:

缓存盘配置:第一块磁盘推荐使用高性能 SSD,性能不低于 TiKV 使用的磁盘

容量规划:TiFlash 容量建议为 TiKV 容量的 1.5-2 倍,确保有足够的存储空间

数据同步优化:通过调整同步策略和线程数,优化 TiKV 到 TiFlash 的数据同步性能

五、事务与一致性优化

5.1 事务模型选择与优化

TiDB 支持乐观事务和悲观事务两种模型,从 3.0.8 版本开始默认使用悲观事务模式。理解和选择合适的事务模型对性能有重要影响。

事务模型对比分析:

乐观事务模型:

工作原理:直接提交事务,冲突时回滚,适合低冲突率场景

性能特点:

低冲突场景:无需获取行锁,性能优势明显

高冲突场景:回滚成本高,性能下降严重

使用建议:

SET @@tidb_txn_mode = 'optimistic'; # 设置为乐观事务模式

BEGIN OPTIMISTIC; # 开始乐观事务

悲观事务模型:

工作原理:执行阶段加锁,避免冲突重试,适合高冲突率场景

性能特点:

高冲突场景:避免回滚,成功率更高

低冲突场景:加锁开销相对较高

使用建议:

SET @@tidb_txn_mode = 'pessimistic'; # 设置为悲观事务模式

BEGIN PESSIMISTIC; # 开始悲观事务

事务模型选择策略:

业务场景分析:

金融交易、库存扣减等高冲突场景:推荐使用悲观事务

读多写少、冲突率低的场景:推荐使用乐观事务

性能测试验证:

通过压力测试对比两种模型的性能表现

根据业务特点选择合适的事务模型

动态调整策略:

支持在应用层根据业务场景动态切换事务模式

通过监控冲突率和回滚率,适时调整事务模型

5.2 隔离级别优化

TiDB 支持两种隔离级别:RC(Read Committed)和 SI(Snapshot Isolation),其中 SI 与 MySQL 的 RR(Repeatable Read)隔离级别基本等价。

隔离级别特性对比:

SI(Snapshot Isolation)隔离级别:

特性:避免脏读、不可重复读,但可能出现写偏斜(Write Skew)

实现原理:基于 Percolator 模型实现分布式事务,支持两阶段提交(2PC)

使用场景:默认隔离级别,适用于大多数业务场景

RC(Read Committed)隔离级别:

特性:一个事务可以看到其他事务已经提交的修改

性能优化:TiDB v6.0 提供了 rc_read 优化,减少 TSO(Timestamp Oracle)获取开销

配置方法:

[global]

tidb_isolation_read_engines = "tikv,tiflash" # 启用RC隔离级别优化

隔离级别性能优化:

RC 隔离级别优化:

优化原理:尝试使用前一个有效的时间戳进行数据读取,减少 TSO 获取次数

适用场景:读写冲突较少的场景

性能提升:可显著减少 TSO 获取开销,提升事务性能

隔离级别选择建议:

核心业务:使用 SI 隔离级别,确保数据一致性

报表查询:可使用 RC 隔离级别,提升查询性能

混合场景:根据具体业务需求,在应用层动态设置隔离级别

5.3 分布式事务性能优化

TiDB 的分布式事务采用两阶段提交(2PC)协议,需要优化以减少延迟和提高成功率。

分布式事务优化策略:

事务大小控制:

减少事务涉及的记录数和数据量

避免跨过多 Region 的大范围更新

拆分大事务为多个小事务

锁优化:

使用 SELECT FOR UPDATE 时,确保条件使用索引

减少锁的持有时间,尽快提交事务

避免在事务中进行耗时操作

TSO 优化:

增加 PD 的 TSO 缓存,减少网络往返

调整 TSO 分配策略,提高并发性能

使用批量 TSO 获取,减少获取频率

事务重试机制优化:

乐观事务重试:

应用层实现智能重试策略

设置合理的重试次数和间隔

避免无限重试导致系统负载过高

悲观事务优化:

使用 SELECT … FOR UPDATE SKIP LOCKED 避免锁等待

设置合理的锁等待超时时间

优化索引使用,减少锁冲突

5.4 事务监控与调优

建立完善的事务监控体系是优化事务性能的基础。

事务监控指标:

事务性能指标:

事务平均执行时间

事务成功率和失败率

事务回滚率和原因分析

锁竞争指标:

锁等待时间和次数

死锁发生次数

锁冲突率

TSO 相关指标:

TSO 获取延迟

TSO 获取频率

PD 的 TSO 服务负载

事务调优实践:

慢事务分析:

通过慢查询日志分析长事务

使用 EXPLAIN ANALYZE 分析事务执行计划

识别事务中的性能瓶颈

锁优化分析:

使用 TiDB Dashboard 查看锁等待情况

分析锁冲突的原因和模式

优化索引和查询语句减少锁竞争

性能基准测试:

使用 sysbench 等工具进行事务性能测试

对比不同事务模型和隔离级别的性能

根据测试结果选择最优配置

六、资源配置与容量规划

6.1 硬件资源配置建议

合理的硬件资源配置是 TiDB 性能的基础,需要根据业务场景和性能需求进行优化。

TiDB 节点配置建议:

CPU 配置:

核心数:建议 8-64 核,根据并发查询数和查询复杂度调整

主频要求:3.0GHz 或更高,确保计算性能

绑定策略:建议使用 CPU 绑定,避免线程迁移开销

内存配置:

容量要求:16-512GB,建议为系统内存的 50-70% 用于 TiDB

配置原则:

内存总量 = TiDB进程内存 + RocksDB块缓存 + 系统预留

TiDB 内存配置:

[memory]

limit = "32GB" # TiDB内存限制

网络配置:

带宽要求:万兆以太网或更高

延迟要求:集群内部延迟低于 1ms

冗余配置:建议配置双网卡,实现网络冗余

TiKV 节点配置建议:

CPU 配置:

核心数:建议 16-64 核,根据数据量和并发写入调整

配置原则:支持 RocksDB 和 Raft 的并发处理

内存配置:

容量要求:32-1024GB

RocksDB 配置:

[rocksdb]

block-cache-size = "32GB" # RocksDB块缓存

其他内存需求:MVCC 内存引擎、Write Buffer 等

存储配置:

介质选择:NVMe SSD(推荐)或 SATA/SAS SSD

容量规划:单盘不超过 4TB,总容量根据数据量计算

RAID 配置:建议使用 RAID 0 或单独使用,避免 RAID 开销

PD 节点配置建议:

CPU 配置:

核心数:建议 4-16 核,PD 对 CPU 要求相对较低

配置原则:满足元数据管理和调度需求

内存配置:

容量要求:8-64GB,根据集群规模调整

配置建议:每 1000 个 Region 约需 1GB 内存

存储配置:

介质选择:SSD 或高性能磁盘

容量要求:100-500GB,存储元数据和日志

配置建议:使用独立磁盘,避免与其他组件竞争

6.2 软件参数优化

TiDB 的软件参数配置对性能有重要影响,需要根据硬件配置和业务场景进行优化。

TiDB 通用参数优化:

连接配置:

[server]

max-connections = 2000 # 最大连接数

查询优化配置:

[optimizer]

max-execution-time = 300 # 查询超时时间(秒)

执行配置:

[executor]

max-tasks = 1024 # 最大并发任务数

TiKV 参数优化:

RocksDB 配置:

[rocksdb]

max-open-files = 4096 # 最大打开文件数

性能配置:

[performance]

max-procs = 16 # CPU核心数

存储配置:

[storage]

ssd = true # 使用SSD存储

PD 参数优化:

调度配置:

[scheduler]

region-schedule-limit = 2048 # Region调度并发数

配额配置:

[quota]

leader-schedule-limit = 4 # Leader调度限制

6.3 容量规划方法论

合理的容量规划是确保系统稳定运行和控制成本的关键。

容量规划流程:

数据量评估:

现有数据量统计

数据增长趋势分析

未来 3-5 年的数据量预测

性能需求分析:

当前系统性能基准

业务增长预期

性能 SLA 要求

资源计算模型:

TiKV存储需求 = 数据量 × 副本数 × 1.5(预留空间)

TiDB内存需求 = 连接数 × 单连接内存 + 查询缓存 + 系统开销

CPU需求 = 最大并发查询数 × 单查询CPU消耗

容量规划工具:

TiDB Lightning:

用于大规模数据导入

支持性能基准测试

可用于评估导入时间和资源需求

TiDB Benchmark:

官方提供的基准测试工具

支持多种工作负载模型

可用于性能评估和容量规划

监控数据分析:

使用 Prometheus 收集历史性能数据

使用 Grafana 进行可视化分析

基于历史数据进行趋势预测

扩容策略建议:

垂直扩容限制:

单节点资源有上限

成本效益递减

建议优先考虑水平扩容

水平扩容策略:

TiDB 节点:根据并发查询数扩容

TiKV 节点:根据存储容量和写入性能扩容

PD 节点:保持 3-5 个,确保高可用

扩容时机判断:

CPU 使用率超过 70%

内存使用率超过 80%

磁盘使用率超过 80%

查询延迟明显上升

6.4 不同业务场景的配置策略

针对不同的业务场景,需要采用差异化的配置策略。

OLTP 场景配置策略:

硬件配置:

CPU:高主频,8-32 核

内存:32-256GB,重点配置 TiDB 查询缓存

存储:NVMe SSD,低延迟

参数优化:

启用乐观事务(低冲突场景)

配置较小的事务超时时间

优化连接池参数,减少连接开销

索引策略:

为 WHERE、JOIN 条件创建索引

使用覆盖索引减少回表

定期清理冗余索引

OLAP 场景配置策略:

硬件配置:

CPU:多核,16-64 核

内存:64-512GB,配置大内存用于计算

存储:大容量 SSD 或 NVMe

参数优化:

启用 TiFlash 进行列式存储查询

配置较高的并行度

优化聚合和 JOIN 操作

查询优化:

使用 TiFlash 进行分析查询

优化分区表设计

使用物化视图加速复杂查询

混合负载场景配置策略:

架构设计:

使用独立的 TiDB 节点处理不同负载

使用 TiFlash 分离 OLAP 查询

实现资源的物理隔离

资源控制:

使用 Resource Control 进行资源隔离

为不同负载设置资源配额

实现优先级管理

性能监控:

分别监控 OLTP 和 OLAP 性能

设置独立的告警策略

根据负载变化动态调整资源

七、高可用与故障恢复优化

7.1 多副本机制与数据一致性

TiDB 采用Raft 协议实现多副本数据一致性,默认配置为 3 副本,能够容忍单节点故障而不影响数据可用性和一致性。

Raft 协议机制:

基本原理:

每个 Region 有多个副本(默认 3 个)

通过 Raft 协议保证数据强一致性

支持自动故障检测和恢复

Leader 选举:

采用多数派原则(quorum)

3 副本配置可容忍 1 个节点故障

故障恢复时间通常在秒级

数据同步:

写操作需要多数副本确认

支持线性一致性读

提供 Snapshot 隔离级别

副本配置优化:

副本数量配置:

[raftstore]

replication-factor = 3 # 副本数,默认3

跨机架部署:

[placement]

required-zone = "rack" # 要求跨机架部署

优先级配置:

[raftstore]

leader-priority = 1 # Leader优先级

7.2 自动故障转移机制

TiDB 提供了完善的自动故障转移机制,确保在节点故障时能够快速恢复服务。

故障检测机制:

心跳检测:

PD 定期向各节点发送心跳

检测节点存活状态和服务健康度

支持自定义健康检查

故障发现时间:

节点故障检测时间:3-5 秒

Leader 选举时间:通常小于 10 秒

总故障恢复时间:10-30 秒

自动恢复流程:

节点故障场景:

PD 检测到节点失联

自动触发 Raft Leader 重新选举

数据访问自动切换到新的 Leader

数据恢复过程:

新节点加入时自动同步数据

使用 Snapshot 和日志进行数据恢复

支持断点续传,提高恢复效率

服务恢复验证:

恢复后自动进行数据一致性校验

验证服务可用性

更新路由信息

故障转移优化策略:

快速故障检测:

[pd]

health-check-timeout = "3s" # 健康检查超时时间

优雅停机:

使用 tiup cluster stop 命令优雅停止服务

确保数据同步完成

避免强制终止导致的数据不一致

故障恢复监控:

设置故障恢复告警

监控恢复过程中的性能指标

记录故障恢复时间和原因

7.3 备份恢复策略优化

完善的备份恢复策略是保证数据安全和业务连续性的关键。

备份策略设计:

备份类型:

全量备份:定期(如每周)进行全量备份

增量备份:每日进行增量备份

逻辑备份:使用 TiDB Dumpling 进行逻辑备份

备份工具选择:

BR(Backup & Restore):

tiup br backup full --pd "pd-ip:2379" --storage "s3://bucket/path"

TiDB Dumpling:

tiup dumpling --host tidb-host --port 4000 --filetype sql

备份存储策略:

本地备份:快速恢复,但存在单点风险

远程备份:异地容灾,成本较高

云存储备份:弹性扩展,成本可控

恢复策略优化:

恢复流程:

# BR恢复示例

tiup br restore full --pd "pd-ip:2379" --storage "s3://bucket/path"

# TiDB Lightning恢复示例

tiup tidb-lightning --config lightning.toml

恢复时间优化:

使用 TiDB Lightning 进行并行导入

配置多个 TiKV importer 并发

优化数据分片策略

一致性验证:

恢复后进行数据校验

对比备份和恢复的数据

验证业务功能正确性

备份恢复最佳实践:

备份频率:

生产环境:每日增量备份,每周全量备份

测试环境:根据变更频率调整

关键业务:考虑实时备份

备份验证:

定期验证备份的完整性

进行恢复演练

记录备份和恢复时间

存储策略:

至少保留 3 份备份

备份存储在独立的存储系统

定期清理过期备份

7.4 容灾架构设计

容灾架构设计需要考虑数据中心级别的故障,确保在极端情况下业务连续性。

两地三中心架构:

TiDB 支持基于 Raft 协议的两地三中心架构:

架构设计:

生产中心:主数据中心,部署完整集群

同城灾备:同城第二数据中心,部署只读副本

异地灾备:异地数据中心,部署异步复制副本

数据同步:

生产中心与同城灾备:同步复制

生产中心与异地灾备:异步复制

使用 TiCDC 进行 CDC 复制

故障切换:

同城故障:自动切换到同城灾备

异地故障:手动切换,确保数据一致性

支持跨数据中心的事务

多活数据中心架构:

架构特点:

多个数据中心同时提供服务

数据在多个数据中心间同步

支持就近访问,降低延迟

技术实现:

使用 Placement Rules 配置数据分布

基于 TiCDC 实现 CDC 复制

支持全局唯一 ID 生成

挑战与解决方案:

跨数据中心延迟:优化网络,使用就近访问

数据一致性:采用最终一致性模型

冲突处理:设计合理的冲突解决策略

容灾切换流程:

故障检测:

监控数据中心状态

检测网络连接和服务可用性

触发容灾切换流程

切换步骤:

停止故障数据中心的写操作

将写操作切换到灾备中心

验证服务可用性

逐步切换读操作

切换验证:

验证数据一致性

测试业务功能

监控性能指标

八、成本优化策略

8.1 资源使用效率优化

通过提高资源使用效率,可以在保证性能的前提下降低运营成本。

计算资源优化:

弹性伸缩策略:

根据负载变化自动调整 TiDB 节点数量

业务低峰期减少 TiDB 节点

高峰期自动扩容,满足性能需求

资源隔离优化:

使用 Resource Control 实现资源隔离

避免资源浪费和相互影响

提高整体资源利用率

连接池优化:

合理设置连接池大小

使用连接复用减少创建开销

设置连接超时避免资源泄漏

存储资源优化:

数据压缩:

使用 ZSTD 压缩算法

启用 Titan 插件优化大值存储

定期清理历史数据

冷热数据分离:

使用 TiFlash 存储历史数据

将冷数据迁移到低成本存储

保持热数据在高性能存储

存储效率提升:

优化索引设计,减少索引空间

使用列式存储提高压缩率

定期进行数据整理

8.2 云原生部署成本优化

TiDB 在云环境中的部署可以充分利用云平台的弹性和成本优势。

云平台优化策略:

按需实例选择:

根据负载选择合适的实例类型

使用预留实例获得折扣

考虑使用 spot 实例降低成本

存储成本优化:

使用云平台的分层存储

将备份存储在低成本存储

优化存储 IOPS 配置

网络成本控制:

使用 VPC 内网通信

优化跨区域数据传输

使用 CDN 加速静态资源

容器化部署优化:

资源配额优化:

resources:

limits:

cpu: "4"

memory: "16Gi"

requests:

cpu: "2"

memory: "8Gi"

自动扩缩容:

apiVersion: autoscaling/v2beta2

kind: HorizontalPodAutoscaler

metadata:

name: tidb-server

spec:

scaleTargetRef:

apiVersion: apps/v1

kind: Deployment

name: tidb-server

minReplicas: 2

maxReplicas: 10

metrics:

- type: Resource

resource:

name: cpu

targetAverageUtilization: 70

8.3 监控告警成本控制

合理的监控告警策略可以在保证系统可见性的同时控制成本。

监控策略优化:

指标采集优化:

减少低价值指标的采集频率

使用 Prometheus 的规则进行指标聚合

只保留必要的历史数据

存储优化:

合理设置 Prometheus 数据保留时间

使用高效的存储格式

定期清理过期数据

告警策略优化:

设置合理的告警阈值

避免告警风暴

使用告警抑制和分组

成本监控工具:

云平台成本监控:

使用云平台提供的成本分析工具

设置成本预算和告警

分析成本构成和趋势

TiDB 成本分析:

监控各组件资源使用情况

分析资源使用效率

识别成本优化机会

优化建议:

根据业务负载调整资源配置

利用云平台的优惠政策

采用混合云部署降低成本

九、实施建议与优化路线图

9.1 优化实施优先级建议

基于风险收益分析,建议按以下优先级进行优化:

高优先级优化项(立即实施):

基础健康检查:

执行 tiup cluster check 全面体检

修复所有 fail 级别的问题

优化关键配置项

慢查询优化:

分析慢查询日志,识别 Top 20 慢查询

优化执行计划,添加必要索引

设置合理的慢查询阈值

监控体系建设:

部署完善的 Prometheus+Grafana 监控

设置关键指标告警

建立性能基线

中优先级优化项(1-2 周内实施):

索引优化:

清理冗余索引

创建缺失的关键索引

优化联合索引设计

参数调优:

根据硬件配置优化 TiDB 参数

调整 RocksDB 配置

优化连接池参数

资源隔离:

实施基本的资源隔离策略

为不同业务分配独立资源

设置资源配额

低优先级优化项(1-2 月内实施):

架构优化:

根据业务发展调整集群规模

实施多租户架构

优化数据分布策略

高级特性应用:

启用 TiFlash 加速分析查询

使用 Placement Rules 优化数据分布

实施自动扩缩容

容灾架构:

完善备份恢复策略

实施异地容灾

建立容灾演练机制

9.2 分阶段优化实施计划

建议采用分阶段的优化实施策略,确保优化过程的可控性和安全性。

第一阶段:诊断与基础优化

阶段目标:

全面了解集群现状

解决严重性能问题

建立监控体系

主要任务:

执行集群健康检查

分析慢查询和执行计划

部署监控告警系统

优化基础配置参数

预期收益:

识别主要性能瓶颈

解决明显的配置问题

建立性能基线

第二阶段:性能调优

阶段目标:

提升查询性能

优化索引设计

提高资源利用率

主要任务:

优化关键查询语句

调整索引策略

优化 TiDB 和 TiKV 参数

实施资源隔离

预期收益:

查询性能提升 30-50%

减少慢查询数量

提高系统稳定性

第三阶段:架构优化

阶段目标:

优化集群架构

提升扩展性

完善高可用架构

主要任务:

调整集群规模

实施多租户架构

优化数据分布

完善备份恢复策略

预期收益:

支持更大的业务规模

提高资源利用效率

增强系统可靠性

第四阶段:持续优化(长期)

阶段目标:

持续性能监控

适应性调整

技术升级

主要任务:

建立性能监控体系

定期性能评估

新技术评估和应用

容量规划和预测

预期收益:

系统性能持续优化

成本效益最大化

技术领先优势

9.3 风险控制与回滚策略

优化过程中需要充分考虑风险控制,制定完善的回滚策略。

风险评估与控制:

变更风险评估:

评估变更影响范围

制定风险缓解措施

设置变更审批流程

影响范围控制:

小范围试点,逐步推广

灰度发布策略

分批次实施变更

监控与预警:

变更前后性能对比

设置性能告警阈值

实时监控系统状态

回滚策略设计:

配置备份:

变更前备份所有配置文件

使用版本控制系统管理配置

记录变更历史

回滚流程:

1. 立即停止问题变更

2. 评估影响范围

3. 执行回滚操作

4. 验证系统状态

5. 分析问题原因

应急预案:

准备应急配置

建立快速恢复机制

制定降级策略

优化效果评估:

评估指标:

性能指标:QPS、延迟、吞吐量

资源指标:CPU、内存、磁盘使用率

业务指标:业务成功率、响应时间

评估方法:

A/B 测试对比

历史数据对比分析

业务影响评估

持续改进:

建立反馈机制

定期回顾优化效果

根据反馈调整优化策略

总结与建议

TiDB 作为一款优秀的分布式关系型数据库,其优化是一个系统性工程,需要从架构设计、参数配置、查询优化、存储优化、事务优化等多个维度进行综合考虑。本方案提供了全面的 TiDB 优化策略,涵盖了从基础诊断到高级优化的完整路径。

核心优化要点总结:

诊断先行:建立完善的监控体系和健康检查机制,定期进行深度巡检,及时发现潜在问题。

查询优化:通过执行计划分析、索引优化、优化器 Hint 等手段,重点提升关键查询的性能。

存储优化:合理配置 Region 大小、优化 RocksDB 参数、选择合适的存储介质,从底层提升系统性能。

架构优化:根据业务规模选择合适的部署架构,实施资源隔离和多租户策略,提升系统的可扩展性和稳定性。

事务优化:根据业务场景选择合适的事务模型和隔离级别,优化分布式事务性能。

高可用保障:完善多副本机制、自动故障转移和备份恢复策略,确保数据安全和业务连续性。

成本控制:通过资源优化、弹性伸缩、监控告警优化等手段,在保证性能的同时控制运营成本。

实施建议:

建议采用分阶段实施策略,从基础优化开始,逐步深入到架构优化

优先解决影响最大的性能问题,确保优化效果的可衡量性

建立完善的监控和回滚机制,确保优化过程的安全性

持续进行性能评估和优化调整,保持系统的最佳运行状态

相关文章