最近,我发现了一个极具潜力的开源项目 —— LangChain,它正日益成为构建大语言模型(LLM)应用、智能代理(agent)以及复杂 AI 工作流的核心工具。如果你对 AI 开发感兴趣,尤其想深入了解如何把大模型与业务逻辑串联起来,这篇文章绝对值得一读。

一、引人入胜的开头:为什么 LangChain 是当前必须关注的项目

想象一下,你不仅能让大语言模型(如 GPT)回答问题,还能让它自己做决策、调用外部工具、读取数据库、与用户对话,甚至记住之前的对话内容。这不再是科幻,而是许多开发者正在用 LangChain 实现的现实。

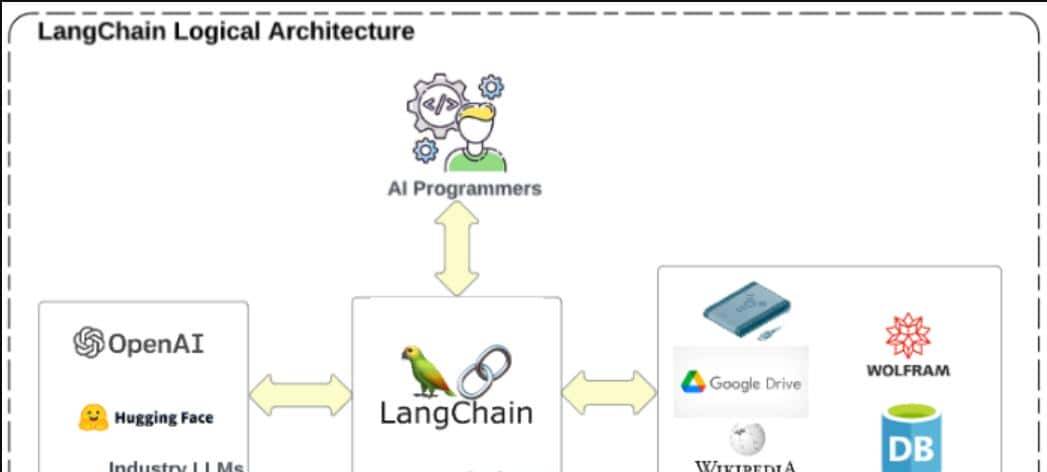

LangChain 并不是简单地封装模型调用,它是一个框架:帮你把模型、记忆(Memory)、代理(Agent)、检索、外部工具第三方集成等这些零散能力“串”在一起,像搭积木一样,构建更复杂、更可靠的智能应用。对于追求灵活性、可扩展性和未来可维护性的开发者来说,它提供了超级强的抽象能力。

二、LangChain 是什么?它能做什么?

1. 核心定义

LangChain 是一个开源框架,专为 LLM 应用而生。通过标准化接口,它让开发者可以轻松地连接不同的大模型(如 OpenAI、Hugging Face 等)、构建提示模板(prompts)、组织记忆机制、调度工作流(chain)、并构造复杂的智能代理(agent)。

它的设计哲学是模块化。你不必从零写所有逻辑,而是可以把组件按需组合:模型 + 工具 + 检索 + 记忆 + 代理。

2. 关键模块与组成

- Prompt 模板(Prompt Templates):定义模型与用户交互的提示格式,列如常规问答、ELI5 式解释、带上下文的对话模板等。

- 模型层(LLMs):你可以接入 OpenAI、Anthropic、Hugging Face 等模型,并且轻松切换。

- 记忆(Memory):LangChain 支持短期对话记忆和长期记忆,可以为对话机器人、智能助手构建更自然、持续性的上下文。

- 检索 / 索引(Retrieval / Indexes):通过向量存储(如 ChromaDB、FAISS 等),实现 RAG(Retrieval-Augmented Generation),让模型可以访问外部知识库。

- 链(Chains):把多个步骤(如检索 → 提问 → 生成)组织成一个有逻辑顺序的 pipeline,让复杂任务更可控。

- 代理(Agents):这是 LangChain 最强劲的能力之一。代理是“有思考能力”的实体,它能根据目标自己决定调用哪个工具(如调用搜索 API、运行代码、查询数据库等),然后串联行动。

- 集成与工具(Integrations):支持许多第三方系统,列如数据库、Web 服务、搜索引擎等,这使得 LangChain 能与现实业务系统无缝连接。

3. 使用场景

LangChain 可以应用在超级多样化的场景中。常见示例包括:

- 智能客服 / 对话机器人:通过 agent + memory 实现连续对话、上下文感知的聊天机器人。

- 问答系统(RAG):把文档、知识库作为检索源,让 LLM 对用户问题给出基于真实数据的答案。

- 自动化工作流:列如邮件生成 + 分析、报告生成、日常办公辅助等。

- 代码助手:通过模型+工具,分析代码、生成代码片段、做简单调试。

- 插件 / 工具代理:让 LLM 调用外部 API,例如发邮件、查询行情、调用计算器等。

三、LangChain 的优势和亮点

- 模型互换性强

LangChain 并不绑定某一家模型厂商,你能自由选择、替换模型。这个灵活性特别重大,由于大模型生态在快速演进。 - 模块化 + 可组合性

框架把模型、记忆、链、工具等拆分成组件,你可以像搭积木那样拼装。这样既能快速原型,又能构造生产级复杂系统。 - 生产就绪

除了原型开发,LangChain 还关注生产环境。它内置监控、评估、调试机制(搭配 LangSmith 或可视化工具),协助团队把 agent 部署到真实业务中。 - 社区强劲

作为开源项目,它有丰富的社区贡献和生态。目前有许多第三方工具集成、模板、示例流、agent 模式等,由社区不断扩展。 - 未来可扩展性

LangChain 设计时就思考到未来扩展 — 无论是增加新的模型类型、记忆机制,还是更复杂的 agent 编排,都有良好的抽象基础。

四、局限与挑战

当然,没有框架是完美的,LangChain 也有它的瓶颈:

- 学习曲线:对新手来说,组件众多、抽象层级较高,一开始可能难以理解:什么是 chain、什么是 agent、怎么用 memory 这些香槟。

- 破坏性更新:社区用户反馈,该库会随着版本更新引入破坏性变更,升级成本较高。

- 调试复杂:当你构建复杂的 agent 工作流时,一旦出问题,定位 bug 可能不如传统后端那样直观。

- 性能开销:使用 RAG、大量 agent 以及记忆机制时,如果设计不当,对计算和存储资源要求较高。

五、LangChain 的生态与未来

LangChain 并不是孤立存在。它有自己的生态配套:

- LangGraph:一个用于构建可控 agent 工作流的框架,适合更复杂、可视化的 agent 架构。

- LangSmith:用于观察、评估和调试 agent 的平台,可以协助开发者监控 agent 行为、分析失败缘由。

- 社区模板 & 集成:社区贡献了大量预构建的 chain、agent 和集成,开发者可以快速上手。

- 低代码 / 可视化工具:借助可视化界面 (如 LangFlow 等),非专业开发者也可以通过拖拽方式构建 LLM 应用。

从趋势来看,LangChain 的生态会继续扩大。随着大模型越来越强,业务方对智能系统的需求越来越复杂,LangChain 提供的能力正好契合这种趋势。

六、实践提议:如何上手 LangChain

如果你想尝试 LangChain,这里是一个实际提议流程:

- 安装与准备环境

安装 Python 包 langchain,准备好你想使用的 LLM API,列如 OpenAI、Hugging Face。 - 构建简单的 Prompt + Chain

从最基础的问答链 (chain) 开始:定义 prompt 模板 → 调用模型 → 输出答案。 - 加入检索 (Retrieval)

把一个向量存储 (如 ChromaDB) 作为知识库,尝试构建检索-增强问答 (RAG)。 - 引入 memory

构建对话机器人,让它记住用户历史对话,并依据历史做出上下文相关回应。 - 探索 Agent

创建一个简单 agent,让它调用一个外部工具(列如执行一个 HTTP 请求、或者读写文件),完成一个小任务。 - 监控和调试

如果你准备上线,让 agent 跑起来,然后用调试/评估工具观察它在执行时的行为,看看哪些地方可以改善。 - 参与社区

加入 LangChain 开源社区 (例如 Discord、论坛),贡献你的 chain / agent 模板,或学习他人的实践。

七、LangChain 的开源协议(License)

这个项目是以 MIT 许可证 发布的。这意味着你可以自由地用于商业项目、教育用途,也可以修改、分发代码,只要在代码中保留版权声明与许可证声明即可。

八、小结

- LangChain 是一个强劲而灵活的开源框架,用于构建 LLM 应用、智能 agent 和复杂 AI 工作流。

- 它以模块化设计为核心:模型、链、记忆、检索和代理都可以自由组合。

- 它支持生产环境,拥有监控和评估能力,同时社区生态正在快速扩展。

- 虽然存在学习成本和版本升级等挑战,但它为未来大语言模型应用提供了极具想象力的可能性。

- 项目使用 MIT 许可证,开源友善,超级适合创业公司、开发者和研究者深入研究。

如果你对 AI 开发有野心,特别是想以大模型为基础构建真正可用、可控、智能的系统,LangChain 绝对是不能错过的一块基石。你可以从一个小链 (chain) 开始,一步步积累经验,最终打造出属于自己的智能体 (agent) 应用。

欢迎热爱 AI 的你,一起探索 LangChain 的无限可能!

相关文章